据TechnologyReview报道,当机器人决定走特定路线前往仓库,或无人驾驶汽车决定左转或右转时,它们的人工智能(AI)算法是靠什么做出决定的?现在,AI还无法向人们解释自己做出某项决定的理由,这或许是个需要搞清楚的大问题。

2016年,美国新泽西州蒙茅斯县(Monmouth County)安静的公路上出现一辆奇怪的无人驾驶汽车。这是芯片制造商英伟达的研究人员开发出的试验车,尽管它看起来与谷歌、特斯拉以及通用汽车公司研发的无人驾驶汽车没什么不同,但它展现出AI的更多力量。

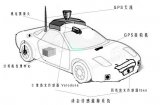

帮助汽车实现自动驾驶堪称是令人印象深刻的壮举,但同时也让人感觉有点儿不安,因为现在我们还不是非常清楚汽车如何作出决策。汽车传感器收集的信息被直接传给庞大的人工神经网络,后者可对数据进行处理,然后发出相应指令,指挥汽车方向盘、制动以及其他系统运行。

表面看起来,它似乎与能与人类驾驶员的反应相匹配。但是当其发生意外事件,比如撞上树或闯红灯时,我们可能很难从中找出原因。这些AI算法非常复杂,甚至就连设计它们的工程师都无能为力。现在我们还没有办法设计出这样的系统:它总是能够向人们解释为何要做出上述决定。

这些无人驾驶汽车的“神秘意识”正指向一个与AI有关的、迫在眉睫的问题。这些汽车算法以AI技术(又被称为深度学习)为基础,近年来其已被证明是解决诸多问题的强大工具。这种技术被广泛用于图像字幕、语音识别以及语言翻译等领域。现在,同样的技术也被期望能够帮助诊断致命疾病、做出价值数百万美元的交易决策以及无数足以改变整个行业的其他事情。

但是直到我们找到新的方式,能让深度学习等技术变得更容易被其创造者所理解、更容易向用户就自己的行为作出解释后,上述场景才会出现或应该出现。否则很难预测它们何时会出现故障,而且出现故障将是不可避免的。这也是英伟达无人驾驶汽车依然处于测试状态的原因之一。

目前,数学模型正被用于帮助确定谁该获得假释、谁应获得贷款以及谁该求职被录用。如果你能接触到这些数字模型,很可能了解它们的推理过程。但是银行、军队、雇主以及其他人现在正将注意力转向更复杂的机器学习上,它可以帮助自动决策变得更令人匪夷所思,而深度学习可能从根本上改变了计算机的编程方式。麻省理工学院机器学习教授汤米·雅科拉(Tommi Jaakkola)表示:“这个问题不仅与当前有关,更攸关未来的许多问题。无论是投资决策、医疗决策亦或是军事决策,我们都不能简单地依赖这种‘黑箱’。”

已经有人提议,将询问AI系统如何得出结论或做出决定作为一项基本法律权利。从2018年夏季开始,欧盟可能要求公司向用户提供其自动化系统作出决策的理由。这似乎是不可能的,即使对于表面来看相对简单的系统来说,比如使用深度学习服务广告或推荐歌曲的应用和网站。运行这些服务的计算机已经在进行自我编程,它们正以我们无法理解的方式工作,即使开发这些应用的工程师也无法明确解释它们的行为。

这就引出许多令人难以置信的问题。随着技术的进步,我们可能很快就会越过一些门槛,帮助AI实现飞跃。虽然我们人类也并非总是能够解释清楚自己的思维过程,但我们能找到通过直觉信任和判断某人的方法。机器也有类似人类的思维吗?此前,我们从未开发出创造者也无法理解其运行方式的机器,我们如何与这些不可预测、无法理解的智能机器交流或和睦相处?这些问题促使我踏上了解密AI算法的征途,从苹果到谷歌再到其他许多地方,甚至包括会见了我们这个时代最伟大的一位哲学家。

图:艺术家亚当·费里斯(Adam Ferriss)利用谷歌Deep Dream程序创造了这张图,Deep Dream可以通过刺激深度神经网络的模式识别能力调整图像。这张图是利用神经网络中间层创作的。

2015年,纽约西奈山医院的研究团队获得灵感,将深度学习应用到医院中庞大的病例数据库中。这个数据集中有攸关病人的数百个变量,包括测试结果以及医生诊断等。由此产生的程序被研究人员命名为Deep Patient,它被利用70多万名病人的数据训练。但测试新的病例时,它展现出令人不可思议的能力--非常擅长预测疾病。无需专家指导,Deep Patient可以在医院数据中找出隐藏模式,并通过病人的各种症状确认疾病,包括肝癌。西奈山医院团队的项目领导者约珥·杜德利(Joel Dudley)说:“利用病例数据,许多方法都能预测出疾病,但我们的方法更好用。”

与此同时,Deep Patient也让人觉得有点儿困惑,它对于诊断精神疾病(比如精神分裂症)非常准确。但是众所周知,即使是医生也很难诊断精神分裂症,为此杜德利想知道为何Deep Patient具备这样的能力,但他未能找到答案,这种新工具未提供任何线索。如果像Deep Patient这样的工具真能帮助医生,在理想情况下,它应该可以提供预测推理,以确保其结论的准确性。但杜德利说:“虽然我们可以建立模型,可是我们真的不知道它们是如何做出决定的。”

AI并非总是如此。从一开始,就有两个学派就如何理解或解释AI产生分歧。许多人认为,根据规则和逻辑开发的机器最有意义,因为它们的内部运作是透明的,任何人都可以检查它们的代码。其他人则认为,如果机器能够从生物学中获得灵感,并通过观察和体验学习,更有可能出现智能。这意味着,计算机具备了编程能力。它们不再需要程序要输入指令以解决问题,程序本身就可以基于示例数据和期望输出产生算法。根据后一种模式,这种机器学习技术后来进化为今天最强大的AI系统,机器本身就是程序。

最初,这种方法在实际使用中十分有限,20世纪60年代到70年代,它在很大程度上依然被限于“场地边缘”。随后,许多行业的计算机化和大数据集出现重新引发人们的兴趣。这鼓励更强大的机器学习技术诞生,特别是最新被称为人工神经网络的技术。到20世纪90年代,神经网络已经可以自动数字化手写内容。

但是直到2010年初,经过几次巧妙的调整和改进,更加庞大或更有深度的神经网络才在自动知觉方面有了巨大进步。深度学习是促使当今AI呈现爆发式增长的主要驱动力,它赋予计算机非凡的能力,比如像人那样识别口语的能力,代替手动向机器输入复杂代码的能力等。深度学习已经改变了计算机视觉,并大幅改进机器翻译。现在,它正被用于指导医疗、金融以及制造业等领域的各种关键决策。

与手动编码系统相比,任何机器学习技术的运作本质上都是不透明的,即使对于计算机科学家来说也是如此。这并非是说将来所有AI技术同样不可预知,但就其本质而言,深度学习是特别黑的“黑箱”。你无法透视深度神经网络内部看其如何运行。网络推理实际上是数以千计的模拟神经元的共同行为,它们排列成数十甚至数百个错综复杂的互联层中。第一层的每个神经元都会接收输入,就像图片上的像素强度,然后进行运算,并输出新的信号。这些输出会进入更复杂的网络,即下一层的神经元中。这样一层层传递,直到最后产生整体输出结果。此外,还有被称为“反向传播”的过程,通过调整单个神经元的计算,让网络了解到需要产生的“期望输出”。

图:艺术家亚当·费里斯(Adam Ferriss)利用谷歌Deep Dream程序创造的图像

深度网络的多层结构让它能在不同的抽象层上识别事物,以被设计用于识别狗狗的系统为例,较低的层次可识别颜色或轮廓等简单的东西,更高的层次则可识别更复杂的东西,比如皮毛或眼睛等,最顶层则会确定其对象是狗。同样的方法也可被应用到其他输入方面,这些输入可让机器自学,包括演讲中所用词汇的发音、文本中形成句子的字母和单词或驾驶所需的方向盘动作等。

为了捕捉和更详细地解释这些系统中到底发生了什么,研究人员使用了许多巧妙策略。2015年,谷歌研究人员修改了基于深度学习开发的图片识别算法,它不需要在图片中发现目标,而是生成目标或修改它们。通过有效地反向运行该算法,他们发现这种算法可被用于识别鸟或建筑物。

被称为Deep Dream的程序产生的图像,显示出看起来非常怪诞的动物从云层或植物中现身,如幻境中的宝塔出现在森林或山脉上。这些图片证明,深度学习并非完全不可理解,算法也需要熟悉的视觉特征,比如鸟喙或羽毛等。但这些图片也显示,深度学习与人类感知截然不同,会让我们忽略的东西变得不可思议。谷歌研究人员注意到,当算法生成哑铃图像时,也会生成举着它的人类双臂。机器得出的结论是,手臂是哑铃的一部分。

利用来自神经科学和认知科学领域的想法,这种技术取得更大进步。由美国怀俄明大学副教授杰夫·克卢恩(Jeff Clune)领导的团队已经采用光学错觉AI测试深度神经网络。2015年,克卢恩的团队展示了特定图像如何欺骗神经网络,让它们误以为目标不存在,因为图像利用了系统搜索的低层次模式。克卢恩的同事杰森(Jason Yosinski)还开发出类似探针的工具,它以网络中部的神经元为目标,寻找最容易被激活的图像。尽管图像以抽象的方式显现,但却凸显了机器感知能力的神秘本质。

可是,我们不仅仅没法窥探AI的思维,也没有简单的解决方案。深层神经网络内部计算的相互作用对高层次模式识别和复杂的决策至关重要,但是这些计算堪称是数学函数和变量的泥潭。雅克拉说:“如果你有很小的神经网络,你可能会理解它。但是当其变得非常庞大时,每层都会有数千个单元,而且有数百层,那么它会变得相当难以理解。”

雅克拉的同事雷吉纳·巴尔齐莱(Regina Barzilay)专注于将机器学习应用到医学领域。2年前43岁时,巴尔齐莱被诊断患上乳腺癌。这个诊断本身就令人感到震惊,但巴尔齐莱也很沮丧,因为前沿统计和机器学习方法还未被用于帮助肿瘤学研究或指导治疗。她说,AI很可能彻底改变医疗行业,而意识到这种潜力意味着其不仅仅可被用于病例中。她希望使用更多未被充分利用的原始数据,比如影像数据、病理资料等。

去年结束癌症治疗后,巴尔齐莱和学生们开始与马萨诸塞州综合医院的医生们合作,开发能够通过分析病理报告确定病人的系统,这些患者是研究人员可能想要研究的特殊临床病例。然而,巴尔齐莱知道,这套系统需要能够解释其推理。为此,巴尔齐莱与雅克拉等人增加新的研究,该系统可以提取和突出文本中的片段,这些片段也处于已经被发现的模式中。巴尔齐莱等人还开发出深度学习算法,它可在乳房X线照片中发现乳腺癌的早期症状。他们的目标是给于这种系统解释推理的同样能力。巴尔齐莱说:“你真的需要一个回路,机器和人类可通过其加强协作。”

美国军方正向多个项目投资数十亿美元,这些项目可利用机器学习引导战车和飞机、识别目标、帮助分析师筛选大量情报数据。与其他领域的研究不同的是,美国国防部已经确定,可解释性是解开AI算法神秘面纱的关键“绊脚石”。国防部下属研发机构DARPA项目主管大卫·甘宁(David Gunning)负责监督名为Explainable Artificial Intelligence的项目,他此前曾帮助监督最后促使Siri诞生的DARPA项目。

甘宁表示,自动化正渗透到无数军事领域。情报分析师正测试机器学习,将其作为在海量情报数据中确认模式的新方法。许多无人驾驶地面战车和飞机正被开发和测试,但坐在无法自我解释的机器人坦克中,士兵们可能不会感觉不舒服,分析师也不愿意根据没有推理支持的信息采取行动。甘宁说:“这些机器学习系统本质上经常产生大量假警报,为此网络分析师需要额外帮助,以便理解为何它们给出如此建议。”

今年3月份,DARPA从学术界和工业领域挑选了13个项目,以便获得甘宁团队的资助,其中包括华盛顿大学教授卡洛斯·盖斯特林(Carlos Guestrin)领导的项目。盖斯特林与同事们已经找到一种新方法,让机器学习系统为自己的输出提供推理解释。实质上,按照他们的方法,计算机可自动从数据集中查找例证,并以它们为佐证。举例来说,可以分类恐怖分子电子邮件信息的系统,可能需要使用数以千万计的信息进行训练和决策。但利用华盛顿大学团队的方法,它可以凸显信息中出现的特定关键词。盖斯特林的团队还设计了图像识别系统,通过凸显图像中最重要的部分提供推理支持。

这种方法和其他类似技术的1个缺点在于,它们提供的解释总是被简化,意味着许多重要信息可能遗失。盖斯特林说:“我们还没有实现整个梦想,将来AI可以与你对话,并作出解释。距离打造真正可解释的AI,我们还有很长的路要走。”

了解AI的推理不仅在癌症诊断或军事演习等高风险领域至关重要,当这种技术被普及成为日常生活中的重要组成时,AI能够给出解释同样重要。苹果Siri团队负责人汤姆·格鲁伯(Tom Gruber)说,对于他的团队来说,可解释性是个关键因素,因为他们正尝试让Siri变成更聪明、更有能力的虚拟助理。格鲁伯没有讨论Siri未来的具体计划,但很容易想到,如果你收到Siri推荐的餐厅建议,你可能想知道它推荐的理由。苹果AI研究总监、卡内基-梅隆大学副教授鲁斯兰·萨拉克霍特迪诺夫(Ruslan Salakhutdinov)将可解释性作为人类与智能机器之间不断进化的关系的核心。

正如人类的许多行为都是无法解释那样,或许AI也无法解释它所做的一切。克卢恩说:“即使有人能给你看似合理的解释,可能也不够充分,对AI来说同样如此。这可能是智能的本质部分,只有部分行为能用推理解释。有些行为只是出于本能,或潜意识,或根本没有任何理由。”如果真是这样的话,那么在某个阶段,我们可能必须绝对相信AI的判断,或根本不使用它。同样的,这种判断必须要纳入社会智能。正如社会是建立在预期行为的契约之上那样,我们需要设计出遵守和适应我们社会规则的AI系统。如果我们想要制造出机器人坦克和其他杀人机器,它们的决策也需要符合我们的道德判断标准。

为了探索这些抽象概念,我拜访了塔夫茨大学著名哲学家、认知科学家丹尼尔·丹尼特(Daniel Dennett)。丹尼特在其最新著作《From Bacteria to Bach and Back》中称,智能本身进化的本质部分在于创造能够执行任务的系统,而这些任务是系统的创造者都不知道如何执行的。丹尼特说:“问题在于,我们必须做出什么样的努力才能做到这一点,我们给他们定下的标准是什么,我们自己的标准呢?”

丹尼尔还对可解释性AI的探求发出警告,他说:“我认为,如果我们要使用这些东西,并依赖它们,那么我们就需要尽可能牢牢把握住它们如何以及为何给我们这样的答案。”但是由于还没有完美答案,我们应该对AI的可解释性保持谨慎,无论机器变得多么聪明。丹尼特说:“如果它们无法比我们更好地给出解释,那么我们就不该相信它们。”

电子发烧友App

电子发烧友App

评论