近月来,中国手机与苹果的“诸神之战”让大家在OPPO的“马里亚纳”、华为的“原色双影像单元”、小米x徕卡联合研发、苹果的“灵动岛”和“4800万像素广角镜头+1200 万像素超广角以及长焦镜头”的信息焦虑中眼花缭乱。

原本或许是为了对冲手机系统和APP设计无力感而诞生的拍照功能,现今却成为了众手机厂家除背部设计外为数不多可“卷”的地方,自拍、全景、夜景、小视频等旺盛的需求让这一技术的江湖地位迅速变化,比翻书还快。 对圈内人士而言,这一波变化带来的后摄、双摄、多摄、暗光、防抖、广角、长焦、变焦,也再次将CMOS传感器等图像市场炒热。 对于独立数码相机,镜头/CMOS传感器画幅越大,效果就会越好越专业。但由于手机面积小等局限性,手机摄影与成像对摄像头的依赖性极低,对图像处理技术的依赖性极高,使得手机摄影更充满逻辑上的科技与狠活儿(褒义),背后的功臣按贡献来算,ISP(图像信号处理)确实为CMOS加上了诸多化腐朽为神奇的“海克斯科技“(依然是褒义)。

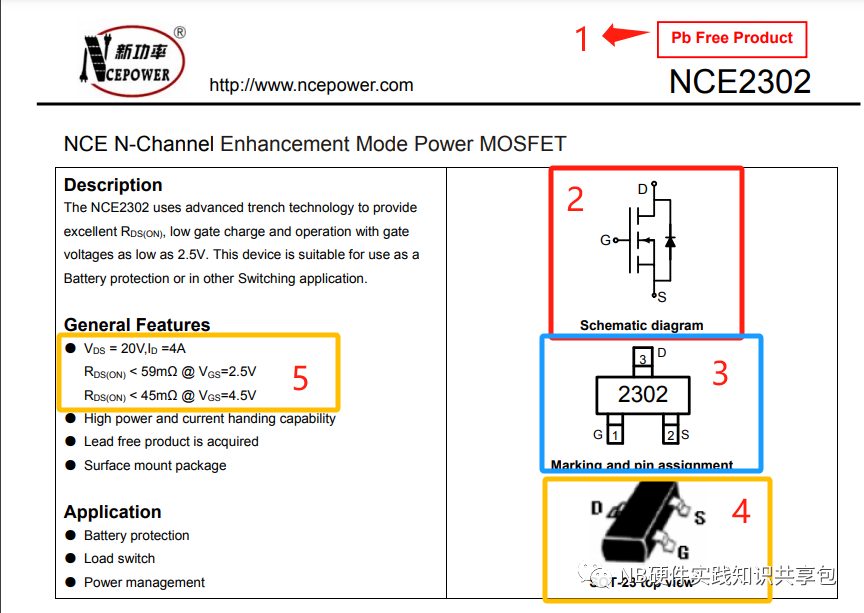

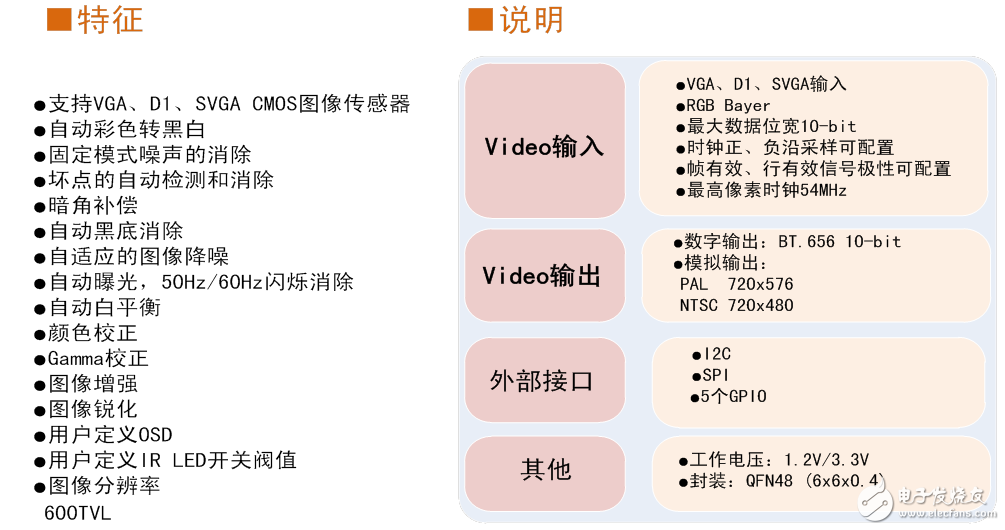

CMOS图像传感器的功能简而言之就是把光信息转换成电信号,最后变成一幅人眼可以识别的图像。ISP会再对图像做处理,使其更符合人眼所看到的世界的样子。

CMOS和ISP是紧密合作的关系,一个粗加工,一个精加工,一个前置摄像头拍照,一个十级美颜加滤镜。

CMOS图像传感器相比它的前任CCD图像传感器可以复用更多的通用半导体制造设备,因此生产成本更低。事实上,在将光转换为光信号的过程中,CMOS相较CCD也抑制了更多电噪声。但在有限的物理条件和摄像头规格面前,仅靠吸收光信号的简单转化只能是巧妇难为少米之炊。真正献上神级换头术的,还是ISP。

底层逻辑

扫盲专区

传感器产生的电压波形信号幅度和空间特性都与其所感知的光照有关。为了产生一副数字图像,需要把连续的感知数据转换为数字形式,该过程被称为图像采样和量化。

所以图像处理的基础就是采样(拍摄)、量化(利用RGB或者YUV把像素编码)再将数字放进想要效果的函数模型中进行调试。 底层逻辑搭好了我们再输入专业术语。

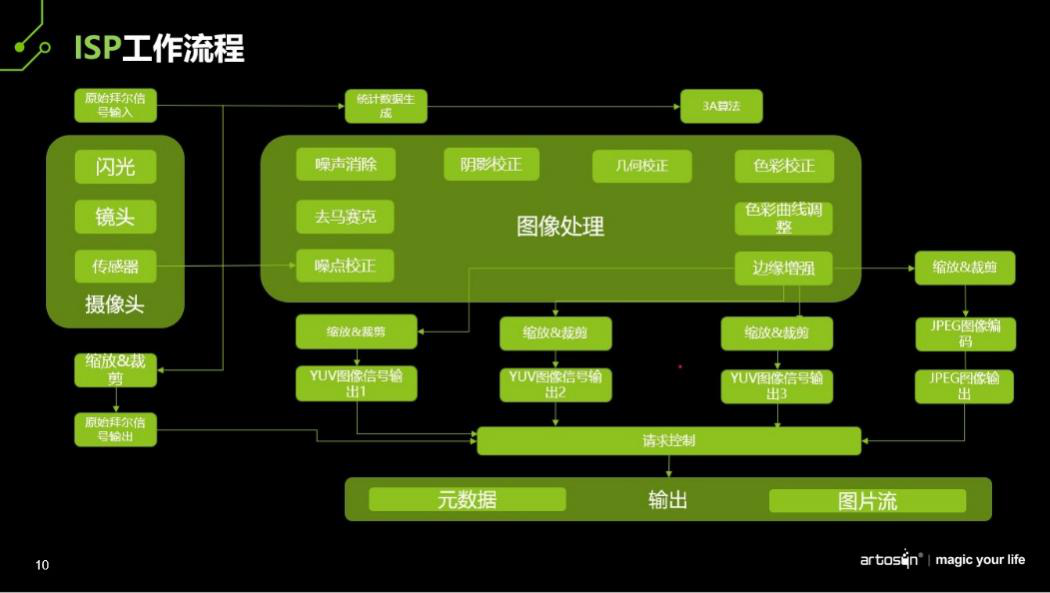

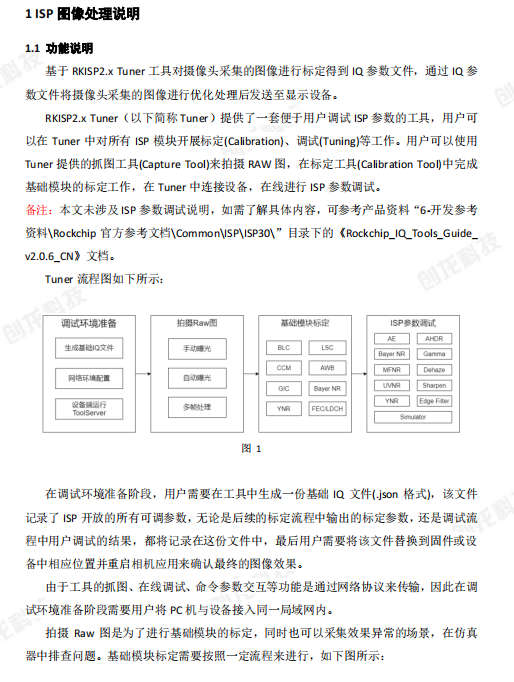

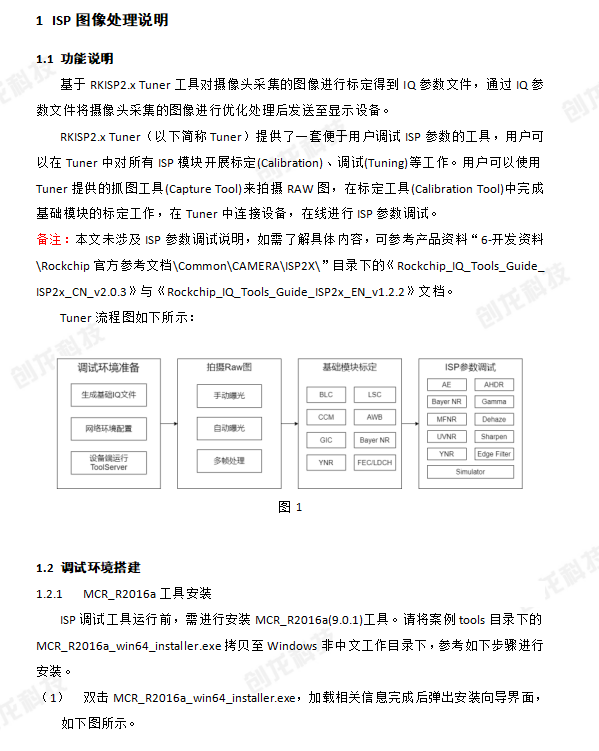

一张图让你知道ISP做了多少事

哪些因素让ISP技术越来越受依赖?

1

核心诉求

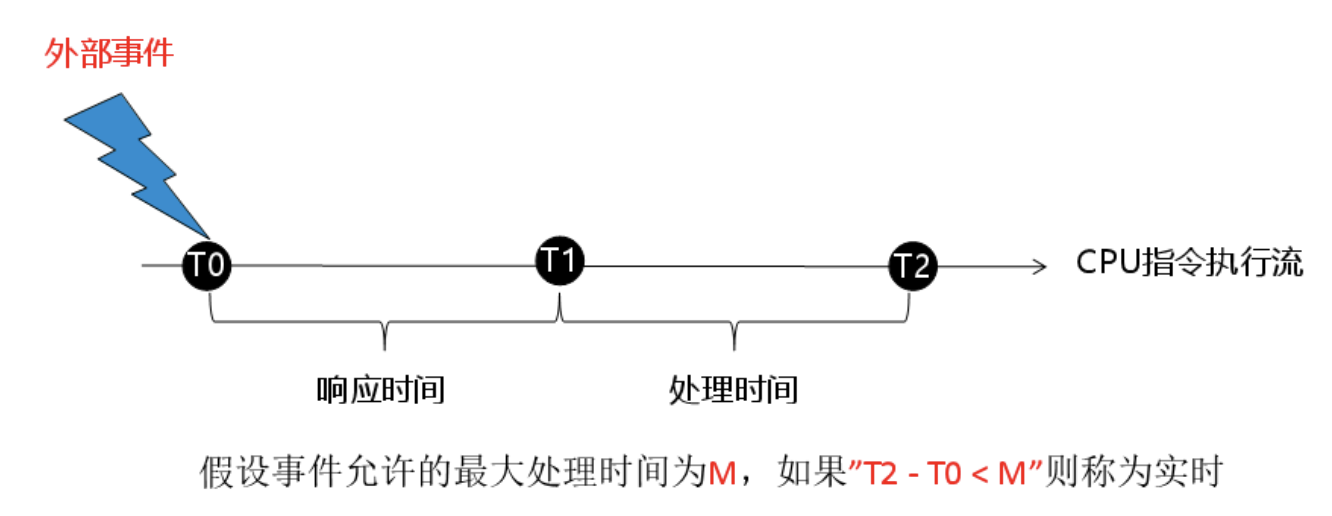

由于镜头和传感器的物理缺陷以及拍摄环境的多样性,传感器输出的原始数据和人类预期的图像有巨大差异,因此ISP就起到了相当重要的作用。

2

行业诉求

公安需要监控设备提升夜视能力,延长监控有效时间,以获取更多取证信息,提升破案率;

智慧城市需要实时收集和保存高清视频数据,以供城市大脑进行全局分析,利用可靠数据优化调整公共资源;

自动驾驶:前视ADAS需要ISP快速分析远近物体,镜头聚焦在远距离范围内,需要较高的系统灵敏度;后视和环视则需要ISP应用畸变矫正算法和多图像拼合。

一些ISP技术老生常谈

但常谈常新的技术难点:

1

HDR高动态图像融合

动态范围指的是图像亮度最大值与最小值的比例范围,范围越大图像显示的场景细节越多,视觉效果越逼真,越能全面展现自然场景的动态范围细节。 具体步骤:采用多张不同曝光度的普通图像来计算实际场景亮度,再用Tone-Mapping压缩合成HDR影像。 形象化地说,就好像上帝手上一杯阳光(过曝照片)、一杯忧郁(曝光不足)、一杯稳重(曝光正常),想造什么性格的人全由比例调配,但是鉴于性格因素的多元化,每样都要来一点才不会走极端。

上帝造人容易,HDR却有如何标定相应曲线、高动态范围图像存储、tone-mapping压缩显示算法、RGB三个独立通道数据量大难合成、迭代算法输出图片质量缺乏稳定性等问题。

2

图像边缘增强

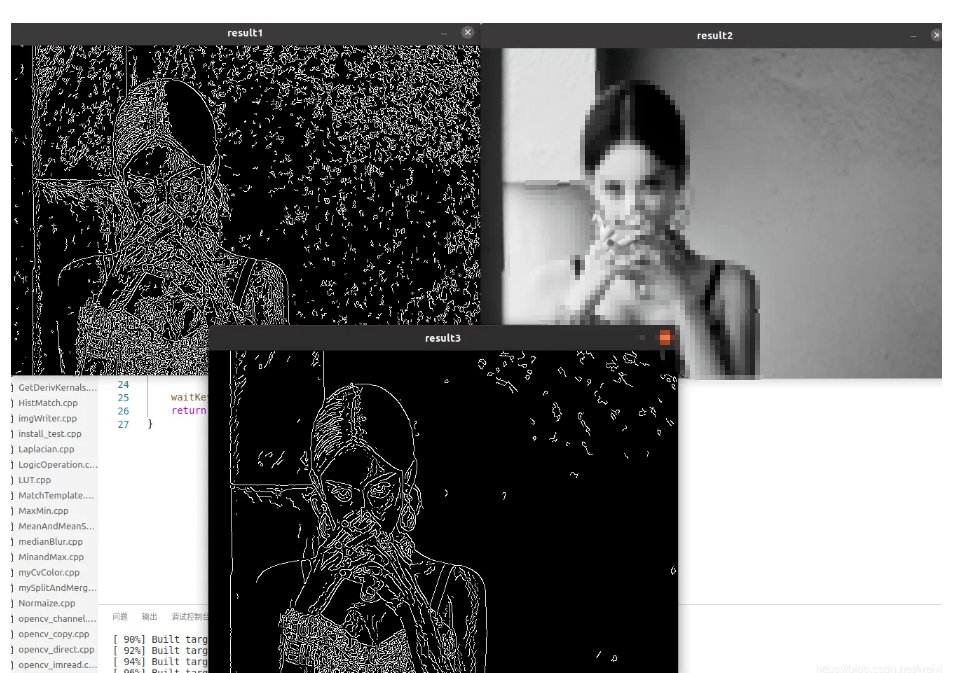

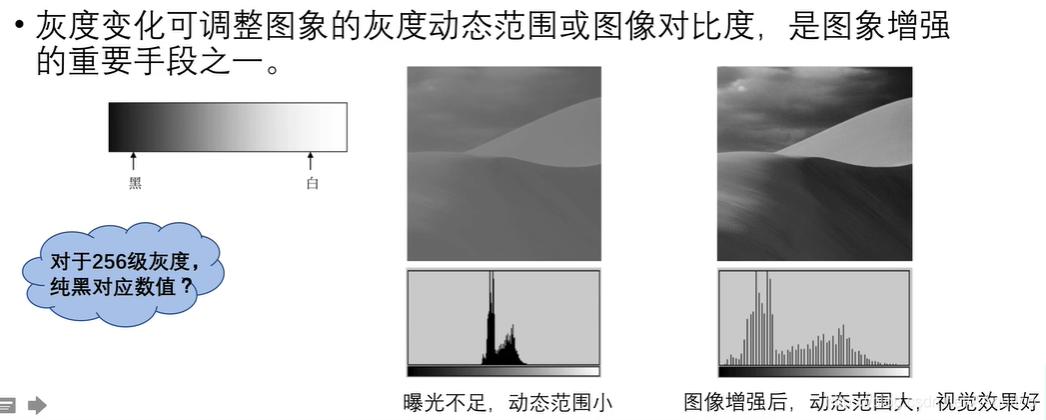

灰度是指亮度的明暗程度。图像边缘是图像中灰度值不连续处的合集,边缘像素点蕴含更为丰富的图像信息,边缘识别也就将图片信息从“二进制数字识别”向“编程语言的语义识别”迈进。 找出哪些像素点是边缘的方式非常简单: 将一张黑白照片翻转颜色成为一张新的照片后,两张照片小距离错动得到镶边信息并突出其显示效果,边缘增强即完成。也就是掩膜技术。 由于夜间光照不足、大雾、沙尘等影响,捕获图像中突发事件如相机运动、或是场景中目标运动等,都会使采集的图像或是图像序列遭受损失,存在成像模糊、噪声污染及曝光不均等问题,图像增强显得尤为重要。

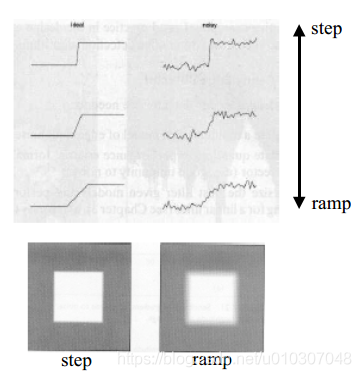

图像的边缘即明暗程度明显的像素点规则分布排列出一道线,在进行图像灰度分析中呈现明显的直角阶梯感,称为阶跃边缘。与之相较的模糊、噪声污染、曝光不均的模糊边缘,像素明暗的交替会在有限距离内发生,呈现出坡度感,故称为斜坡边缘。

对于边缘区域,根据梯度方向及当前点在斜坡边缘的位置,采用边缘方向均值、边缘梯度方向的高灰度均值和低灰度均值来代替当前像素灰度值,从而缩短斜坡边缘的宽度来增强图像边缘。

3

对比度增强

在获取图像质量不高的情况下,通过后期调整灰度值、锐化等来改善图像视觉效果,使其更适用于人或机器分析处理,突出有意义的信息,提升图像使用价值。

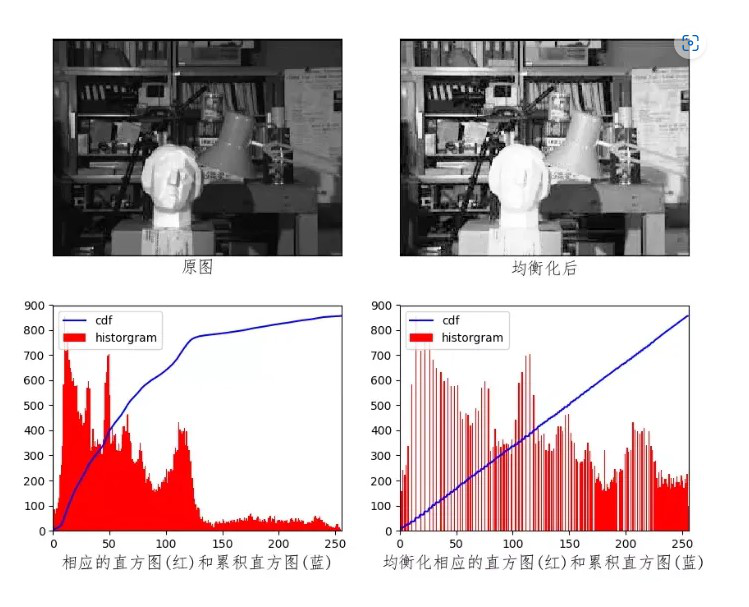

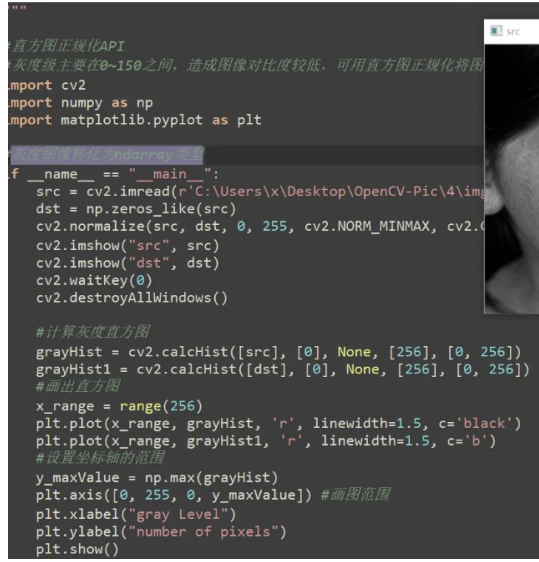

常用方法有线性变换、直方图归一化、伽马变换、全局直方图均衡化、限制对比度的自适应直方图均衡化等。

直方图归一化前&后

直方图均衡化

自适应增强

4

2d/3d降噪(DNR)

知乎中给到的“比较简单的”解释说:一个算法如果只利用同帧图像信息,称为2D降噪; 利用前后帧信息称为3D降噪。

再简单些:

降图片的噪是2D降噪(空域降噪Spatial),降视频的噪是3D降噪(时域降噪Temporal),视频播放键暂停的每一帧都会布满噪声,时长越久需要处理的噪声就越多。3D降噪主要是在时间轴上利用概率找到随机噪声幅值的相关性并进行排序,在运动序列中找到每个像素点的位置,从而得到一张干净的图像。

要导出一张像素排列有序的图像,就需要不断精进的运动估计和运动补偿技术,噪声建模(将噪声幅值建立对应概率密度函数分布模型)、块匹配(找到关系相近的像素块来捕捉运动轨迹)、光流(同时捕捉物体移动和摄像头的移动)等方法缺一不可。

5

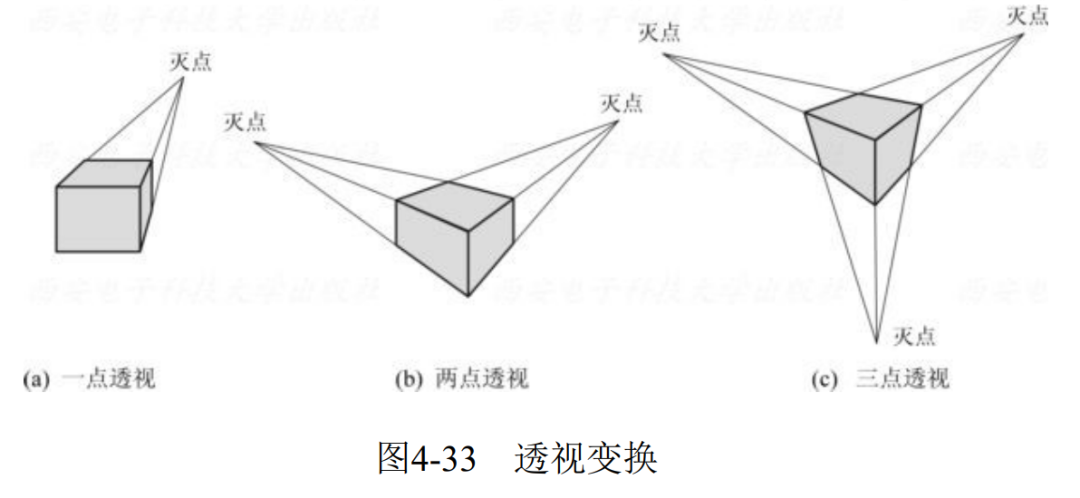

几何畸变矫正

消除由摄像机导致的数字图像的几何畸变,使其更符合人眼视觉下的呈现方式。类似素描的时候平面作画画得有三维立体感和数学里的立体几何计算。

这部分也是在2d图像下好解决,一遇上3d,难度系数就指数级上升。典型应用场景之一也是另外一个图形技术大卷之地——光线追踪技术。

光线追踪技术是一种通过透彻了解光线在物理世界传播、反射、折射等的变化原理,再通过计算机模拟光线,力求做到在PC端和移动端的手机应用中,模拟场景变化效果也能像人类视觉在现实世界中观察到的变化效果相近。目前,英伟达、AMD、英特尔已经支持硬件层面的相关技术,移动端Imagination、三星、Arm也纷纷入局。

现实世界中,人眼接收到的光线一部分是直接光源的照射,另一部分是其他物体表面的反射。稳定光源的光线好模拟,物体表面反射光源的路径可能千千万且十分“光怪陆离”。在模拟世界实现光线追踪便需要反复推演预设场景,在模拟坐标中重现视觉感,将空间点发出的光抽象为光线,通过修正光线的传播路径在虚拟世界中逼真还原,以求沉浸式的游戏体验。

以上繁多的图片处理需求还只是在ISP众多“基本功”里窥得一隅,实操作中还需要戴着“低功耗”和“低带宽占用率”的脚镣跳舞,在不占用公共资源的前提下为其他硬件的性能上升留出空间。

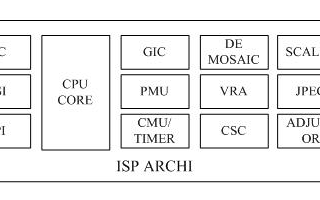

设计出符合技术和行业需求的ISP

需要哪些基操和绝技?

1

ISP和NPU全自研,竞争力说话,做熟不做生

公版IP的通用性和灵活性差不言而喻。安防、车载、AR/VR的弯道超车式发展让每个赛道都存在不断更新的细分需求,自研技术在自适性、按需灵活定制创新功能、缩短开发周期、沟通便利上都更符合客户和行业的发展需求。

锐化、降噪、色彩矫正、边缘增强等很多功能的实现,抑制与增强需求夹杂其中彼此矛盾。还原度、信噪比、噪声平稳性的客观标准与颜色风格的主观标准参杂其中。自研芯片的持续迭代可以保证达到平衡。

2

对多种类型客户需求的充分了解,

默契是时间与坚守品质的必然产物

传统ISP在HDR和降噪模块上仍有非常大的改进空间。一个ISP与多种自研算法相结合,灵活满足不同客户不同场景的需求。

以HDR和降噪算法为例,酷芯研发团队经历过从DSP到ASIC再到更为细化的改进迭代、直到最终固化,多种特定算法之间的相互组合与迭代,以及不同ISP调试风格参数调整,到最后与tuning相结合,都需要有认可的系统厂商内部支持和一定采购量为立足点,将不断提升的产品系统需求分解为芯片迭代方案。是一种相互赋能和成就。

以安防监控为例,公安需要存储和核查证据,需采用一路高码率的码流用于本地高清存储,视频中的大噪声分码率网络设备无法承担,就码率的平稳性需求和ISP的需求都有别于其他行业。

3

非常需求,独有方法

当芯片面临能效比、低带宽占用率的硬性需求和火警、测温等特殊侦察需求时,传统ISP成像将无法满足,酷芯凭借多年累积,巧妙地将热成像技术与高ISP成像质量相结合,在红外图像基础上做降噪、锐度增强等处理,用特有双光方案满足夜间/低光照视觉监测需求。

所以,你以为ISP技术的优劣是研发实力问题,但真实情况是,在芯片行业发生的一切,更多是一场技术迭代+多元场景和需求的落地实操+客情关系+供应链管理等时与势的把握,每一个都互为因果,每一种都权重相当。

就像呈现出一张最终效果令人满意的照片,每个像素的表达都必不可少,也是借由ISP技术的升级(背后是图像处理技术中算法的不断创新+参数的反复调试)才能让每个像素点都充分表达自我,完成本职工作。

编辑

电子发烧友App

电子发烧友App

评论