本月,高通推出其首款基于云端的 AI 加速器:Qualcomm Cloud AI 100,正式宣布进军云计算领域。根据高通的说法,Qualcomm Cloud AI 100 是一款用于数据中心的 AI 推理处理器。

2019-04-29 17:46:59 5450

5450 存储器厂商华邦电 3 日宣布,旗下低功耗、高效能的 LPDDR4X DRAM 技术将用于 Flex Logix 全新 InferX X1 边缘推理加速器,满足物体识别等高要求 AI 应用的需求,助力 Flex Logix 在边缘运算领域取得突破性成果。

2021-02-04 10:27:24 2435

2435 限度地降低DRAM容量增加所带来的功耗增加。ICMAX LPDDR4X搭配5G 手机,将能使手机功耗降低20%左右,降低手机的发热度,提高了手机的续航能力,待机时间更长。作为与CPU交互的存储器

2019-08-17 10:10:01

LPDDR4、LPDDR3与LPDDR4X分别是什么?LPDDR4与LPDDR3区别是什么?LPDDR4X与LPDDR4区别是什么?

2021-06-18 07:59:30

LPDDR4X与LPDDR4的区别到底在哪里?LPDDR4X在LPDDR4的基础上有哪些提升?

2021-06-18 09:07:43

手机参数为什么都是8GB+128GB?手机的这些参数是越大越好吗?这些数字代表什么?LPDDR4X是什么?UFS2.1又是什么?LPDDR4X与UFS2.1有什么差别?

2021-06-18 07:54:29

有人说嵌入式闪存芯片LPDDR5和LPDDR4X差不多?真的如此吗?两者究竟有多大区别?

2021-06-18 06:15:11

LPDDR5和LPDDR4X有什么区别?

2021-06-18 07:01:11

LPDDR5代表着什么意思?LPDDR4X又代表着什么意思?LPDDR5和LPDDR4X的区别在哪里?

2021-06-18 07:07:26

我想知道 X-CUBE-AI 和 NanoEdge AI Studio 在 ML 和 AI 开发环境中的区别。我可以在任何一个开发环境中做同样的事情吗?使用的设备有什么限制吗?

2022-12-05 06:03:15

;3. 对符合安创加速器需求、经过商业模式验证的创业团队,安创加速器提供合理的投资对接服务,为其快速孵化成长提供助力。中国硬件创新创客大赛(简称华秋硬创)是新时代硬件创业者综合性服务平台,大赛始于

2022-06-22 17:39:27

发布全球首款RISC-V架构商用边缘AI芯片,探索AISC技术在高性能计算和人工智能领域的最大潜能。目前,嘉楠科技自主研发两代视觉神经网络加速器IP核,勘智系列AI芯片在智能家居、智能门禁、STEAM

2022-07-22 11:11:33

区定制创新方案,助力科技加速与产业升级;注重本土产业与国际市场的合作,通过全球化布局帮助国外先进技术在国内落地,以及国内项目在国外推广和落地。

权益介绍

为助力第九届中国硬件创新创客大赛,安创加速器将为

2023-08-18 14:37:37

;3. 对符合安创加速器需求、经过商业模式验证的创业团队,安创加速器提供合理的投资对接服务,为其快速孵化成长提供助力。中国硬件创新创客大赛(简称华秋硬创)是新时代硬件创业者综合性服务平台,大赛始于

2022-06-22 17:41:43

;3. 对符合安创加速器需求、经过商业模式验证的创业团队,安创加速器提供合理的投资对接服务,为其快速孵化成长提供助力。中国硬件创新创客大赛(简称华秋硬创)是新时代硬件创业者综合性服务平台,大赛始于

2022-06-22 17:34:34

;3. 对符合安创加速器需求、经过商业模式验证的创业团队,安创加速器提供合理的投资对接服务,为其快速孵化成长提供助力。中国硬件创新创客大赛(简称华秋硬创)是新时代硬件创业者综合性服务平台,大赛始于

2022-06-22 17:32:45

/PyTorch/Caffe 等一系列框架的网络模型

·具有高性能的 4 通道外部存储器接口(LPDDR4/LPDDR4X/LPDDR5),能够支持苛刻的存储器带宽

2023-04-26 10:14:06

和功能规格边缘TPU模块CPU:i.MX 8M应用处理器(四核Cortex-A53,Cortex-M4F)GPU:集成的GC7000 Lite图形ML加速器:Google Edge TPU协处理器RAM

2019-05-29 10:43:33

的高可靠性AI BOX本次推出的EdgeBoard FZ5计算盒及计算卡基于XCZU5EV(4核Cortex-A53融合FPGA)自适应可伸缩计算架构;支持二次开发,支持快速模型迭代;4GB/8GB

2020-08-31 14:12:48

FP-AI-MONITOR1 功能包有助于为使用 X-CUBE-AI 或 NanoEdge™ AI Studio 设计的基于传感器监控的应用程序启动边缘 AI 实施和开发。

2022-11-29 06:33:39

。可以轻松实现终端设备和边缘段设备的AI赋能方案。MLU220-M.2加速卡用于离线模型的部署,离线模型在MLU220上运行, 不依赖AI框架,只需要利用CNRT库,即可实现高效的AI推理运算。如果需要

2022-08-08 17:37:55

NVIDIA GPU训练和评估其识别模型并对其1750亿条Pin贴文执行实时推理。Snap使用NVIDIA T4加速器在谷歌云平台上执行推理。相比于仅采用了CPU的系统,这提高了其广告的效果,同时降低

2019-11-08 19:44:51

RK3588、RK3588S是瑞芯微2022年初量产的旗舰8核高能处理器,CPU、GPU、NPU性能强劲,并支持最高32GB 内存LPDDR4/LPDDR4x/LPDDR5,特别适合arm阵列

2022-07-18 17:54:32

STM32L1 和 STM32L0 可以用于 AI 开发(运行神经网络推理)吗?我希望将这些芯片与 X-CUBE-AI 一起使用。然而,当我阅读用户手册时,这些芯片被排除在微控制器列表之外。为什么会这样?

2022-12-28 08:21:26

LPDDR3+16GB eMMC(可选6GB LPDDR3+16GB eMMC或8GB LPDDR3+16GB eMMC),内置千兆以太网PHY芯片。TB-96AI设计为通过4个100Pin的松下高速板对板连接器

2022-06-20 16:28:28

硬件加速。板卡设计满足工业级要求。如下图所示: 图 1:硬件加速卡实物图 二、技术指标图 2:硬件加速卡结构框图 标准PCIe半高、半长卡,符合PCI Express 3.0 规范。 支持PCIe x1

2019-10-25 16:00:50

i.mx8m 加支持 lpddr4 和 lpddr4x

2023-04-21 06:11:49

大家好,我目前正在 manjaro linux 上使用 STM32CubeMX。我直接从嵌入式软件包管理器下载了X-CUBE-AI人工智能v5.2.0包。我主要对 stm32ai 命令行界面感兴趣

2023-01-09 07:12:17

首先感谢电子发烧友论坛提供的书籍和阅读评测的机会。

拿到书,先看一下封面介绍。这本书的中文名是《AI加速器架构设计与实现》,英文名是Accelerator Based on CNN Design

2023-09-17 16:39:45

随着技术的发展,宏旺半导体ICMAX LPDDR4X 8GB已经实现量产,走在行业前端,现在部分高端旗舰手机已经使用了LPDDR4X,我们可以将LPDDR4X理解为LPDDR5之前的一个过渡技术

2019-07-04 14:24:29

更新。

更新完系统,一切准备妥当,那就跑分好了。

使用鲁大师进行了评测,具体情况如下:综合评分:AI评分:

四、项目计划

要进行的项目,是作为一个探索型的项目,将在youyeetoo X1硬件和系统平台

2024-02-01 00:20:33

后2个星期内提交不少于一篇试读报告要求300字以上图文并茂。4、试读报告发表在电子发烧友论坛>> 社区活动专版标题名称必须包含《 AI加速器架构设计与实现》+自拟标题

注1

2023-07-28 10:50:51

边缘计算产品的深度学习开发者,是具备强大的人工智能编程及深度学习能力的AI加速器。1、开箱让AI开发更简单RK1808S计算棒正面照RK1808人工智能计算棒算是众多边缘计算设备中的佼佼者,外观时尚

2019-10-17 22:48:34

通过网络可以了解到,算能RADXA微服务器的具体规格:

处理器:BM1684X

算力:高达32Tops INT8峰值算力

内存:16GB LPDDR4X 内存

存储:64GB eMMC

编程框架

2024-02-28 11:21:57

介绍使用 AMD-Xilinx FPGA设计一个全连接DNN核心现在比较容易(Vitis AI),但是利用这个核心在 DNN 计算中使用它是另一回事。本项目主要是设计AI加速器,利用Xilinx

2023-02-21 15:01:58

成为 AI 边缘计算应用或云加速器卡的理想选择。该平台集成了用于嵌入式计算的下一代标量引擎、用于硬件灵活性的自适应引擎,以及由 DSP 引擎和用于推理和信号处理的革命性 AI 引擎组成的智能引擎。其

2022-11-25 16:29:20

你好我使用 STM32CUBE-AI v5.1.2 ApplicationTemplate 将简单的 CNN 导入到 STM32L462RCT我发现压缩模型对推理时间没有影响。aiRun 程序在 8

2023-01-29 06:24:08

LPDDR5究竟是什么?有什么特点?同样1ynm制程的LPDDR4X和LPDDR5在性能上两者究竟有多大区别?

2021-06-18 06:48:12

。K510是嘉楠公司推出的第二代AI加速芯片,它采用双核RISC-V CPU@800Mhz,内置DSP协处理器和强大的AI运算单元KPU,支持 BF16浮点数据格式,可在边缘端进行高精度推理,是国内少有

2022-11-22 15:52:15

内部默认

加速器时钟 1000 MHz

设计峰值 SRAM 带宽 16.00 GB/s

设计峰值 DRAM 带宽 3.75 GB/s

使用的 SRAM 总量 370.91 KiB

使用的 DRAM

2023-06-05 11:36:22

基于SRAM的方法可加速AI推理

2020-12-30 07:28:28

硬件加速。板卡设计满足工业级要求。如下图所示: 图 1:硬件加速卡实物图二、技术指标图 2:硬件加速卡结构框图标准PCIe半高、半长卡,符合PCI Express 3.0 规范。支持PCIe x1、x4

2018-07-27 16:49:30

。 支持PCIe x1、x4、x8模式。 支持2x72bit(数据位宽64bit+ECC)DDR4存储,数据传输速率2400Mb/s。 DDR4单簇容量4GB,总容量为8GB。 板载4个用户可编程LED

2018-08-22 17:31:55

TPU 本体。该 SoM 具有加密协处理器、板载 Wi-Fi 并支持蓝牙 4.1,外加 1G LPDDR4 内存与 8GB eMMC。更多细节配置信息,请参阅该单片的产品参数表。Coral 开发单片,以及

2019-03-05 21:20:23

保驾护航。下面让我们来了解如何不借助手动工具或手动编程来选择模型、随时随地训练模型并将其无缝部署到TI处理器上,从而实现硬件加速推理。图1: 边缘AI应用的开发流程第1步:选择模型边缘AI系统开发

2022-11-03 06:53:28

Carmel(ARM v8.2 64位,具有6 MB L2 + 4 MB L3缓存),主频最高位1.4GHz;384核Voltra GPU;加上包含48个张量核心和两个深度学习加速器(DLA) 引擎

2021-12-10 10:18:20

南亚科第二季营收将成长于5%,获利有机会季增3~5成。南亚科及华邦电下半年旺值得注意的是,南亚科20奈米制程微缩顺利,下半年8GB DDR4将进入量产,年底前可望完成LPDDR4试产并进入量产,届时

2017-06-13 15:03:01

1 简介AI任务管理与统一的推理能力提供了接口的统一标准系统上CPU提供了AI任务调度管理的能力,对AI的能力进行了开放的推理和推理,同时,提供了一个不同的生命周期框架层级的应用程序。推理接口

2022-03-25 11:15:36

商业发行之前就已经过时了。算法明天需要对架构、内存/数据进行彻底改革资源和能力。推理的梦幻建筑重新定义重写在计算和交付突破性的人工智能加速和灵活的计算能力超越了服务器级CPU和比GPU/ASIC通用

2020-11-01 09:28:57

预估,内存预估模拟调试,量化精度分析,可视化功能Toybrick 1808计算棒提供主动和被动两种工作模式被动模式下,模型部署在上位机,计算棒是一个通用计算棒,担当AI加速器的功能;主动模式下,模型部署

2020-07-24 10:58:40

LPDDR4X、LPDDR5这些究竟指的是什么意思?它们又有什么区别?相比较于LPDDR4X,LPDDR5有哪些优势?

2021-06-18 07:17:28

芯片之间的价格差异[用于支持硬件,如DRAM,引导ROM,闪存,通常是PMIC] “。FPGA AI加速FPGA也适用于边缘的AI,因为它们可以提供可编程的硬件加速。虽然大型高端FPGA可能对我们的智能

2019-05-29 10:38:09

将AI推向边缘的影响通过在边缘运行ML模型可以使哪些具体的AI项目更容易运行?

2021-02-23 06:21:10

2019年下半年开始了,新一代旗舰手机内存容量越来越大,6GB只是起步,8GB才算是标准,而除了容量更大、频率越高之外,手机内存还有趋势,那就是LPDDR4X类型的内存越来越多,与标准的LPDDR4

2019-07-03 11:39:09

如何去选择并优化IDCT快速算法?怎样去设计一种MPEG-4加速器?如何对MPEG-4加速器进行仿真验证?

2021-06-04 07:20:42

本帖最后由 曾12345 于 2018-5-23 15:49 编辑

全新的毫瓦级功耗FPGA解决方案为机器学习推理在大众市场物联网应用中实现快速部署创造机遇。1. 将AI加速部署到快速增长

2018-05-23 15:31:04

能力的AI加速器NPU。板载4GB 64bit LPDDR4X 内存,32GB eMMC 存储,高达8K@60 HDMI OUT, 并支持HDMI IN, MIPI DSI, MIPI CSI

2023-04-24 09:29:06

,Imagination GE9920 GPU。 NPU高达6 .75 tops算力。 板载4GB LPDDR4内存和16GB EMMC存储,支持4个USB 3.0接口,1个千兆网口。 板载1个HDMI-rx

2022-11-24 16:15:16

尤里云科技推理运算加速卡UXC2000内置TF16110高性能异构处理器及大容量内存,兼容各类标准外扩式机架服务器,可直接提供业务层级的软件交互接口。12.8TOPS@INT818GB

2022-11-17 14:05:09

AI 边缘计算盒子(MF-AI-020) 1、产品简介 MF-AI

2023-07-31 13:02:16

关于新一代LPDDR3移动DRAM技术,三星电子表示,这是继去年12月在电子行业首次开发30纳米级4Gb LPDDR2移动DRAM之后,不到九个月又成功开发出使用30纳米级工艺的4Gb LPDDR3移动DRAM技术的新一代产

2011-09-30 09:30:13 2176

2176 2017年新一代旗舰手机内存容量越来越大,4GB只是起步,6GB才算是标准,而除了容量更大、频率越高之外,手机内存还有趋势,那就是LPDDR4X类型的内存越来越多,与标准的LPDDR4内存相比它的多数指标相同,但是电压更低,有效降低了内存能耗,降幅40%以上也不奇怪。

2017-05-09 16:21:37 74924

74924 4月25日,三星电子宣布已开始批量生产汽车用10nm级16Gb LPDDR4X DRAM。这款最新的LPDDR4X产品具备高性能,同时还显著提高需要在极端环境下工作的汽车应用的耐热性水平。这款

2018-08-23 15:48:26 2143

2143 需要快速连续地将数百万个权重加载到网络中,这就是每秒要做数万亿次到数十万亿次运算的AI系统为什么需要那么多DRAM芯片的原因。DRAM芯片上的每个引脚每秒最多可以传输4Gb数据,因此要达到所需的每秒数百Gb的数据传输速度,就需要多个芯片。

2018-11-08 14:12:26 2990

2990 美光科技股份有限公司推出业内容量最高的单片式 16Gb 低功耗双倍数据率 4X (LPDDR4X) DRAM。美光16Gb LPDDR4X 能够在单个智能手机中提供高达 16GB1 的低功耗 DRAM (LPDRAM),显示了美光为当前和下一代移动设备提供卓越内存容量和性能的前沿地位。

2019-09-10 10:28:00 4268

4268 2020年9月16日,Qualcomm宣布,高性能的AI推理加速器Qualcomm Cloud AI 100正面向全球部分客户出货。凭借先进的信号处理能力和领先的能效,Qualcomm Cloud

2020-09-17 17:04:23 2217

2217 虽然推理加速器最初用于数据中心,但它们已经迅速发展到应用程序的边缘推理,如自动驾驶和医学成像。通过这种转变,客户发现,同样的加速器,在数据中心处理图像很顺利,但移到边缘推断方面却显得糟糕。其实原因很简单:一个处理数据池,而另一个处理的是数据流。

2020-09-19 11:31:44 1522

1522 InferX X1芯片面积为54mm2, 仅为1美分硬币的1/5大小,更是远远小于其它同类产品。InferX X1 芯片的批量价格仅有目前行业领军产品的1/10左右。这是高质量、高性能的AI推理产品第一次真正走向普罗大众。原本昂贵的AI推理将不再遥不可及。

2020-10-22 10:24:06 2640

2640 倍以上。 而在 2020 年 9 月 16 日,高通宣布 AI 推理加速器 Cloud AI 100 已经面向全球部分客户出货。 高通 Qualcomm Cloud AI 100 加速器拥有先进的信号处理

2020-10-28 17:59:39 2408

2408 Flex Logix公司推出了InferX X1P1 PCIe板卡,并宣布了其系列产品的技术路线图。该系列PCIe板卡都将搭载Flex Logix专为边缘侧系统设计的高性能、高效率的 InferX X1加速器。

2020-10-29 15:53:53 1628

1628 AI加速器是一类专门的硬件加速器或计算机系统旨在加速人工智能的应用,主要应用于人工智能、人工神经网络、机器视觉和机器学习。

2022-02-06 12:47:00 3645

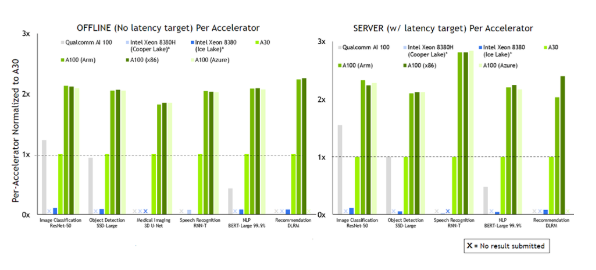

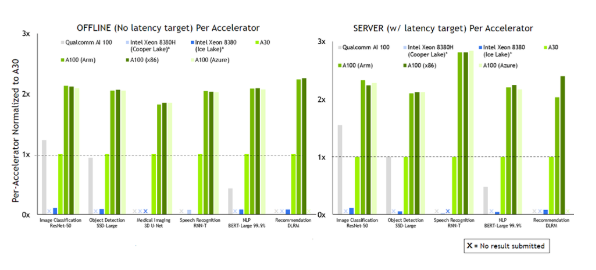

3645 在首次参加行业 MLPerf 基准测试时,基于 NVIDIA Ampere 架构的低功耗系统级芯片 NVIDIA Orin 就创造了新的AI推理性能纪录,并在边缘提升每个加速器的性能。

2022-04-08 10:14:44 4199

4199

最新发布的 NVIDIA Jetson AGX Orin 提升边缘 AI 标杆,使我们在最新一轮行业推理基准测试中的领先优势更加明显。

2022-04-09 08:24:14 1192

1192 SiFive 将 RISC-V 处理器 IP 引入其下一代 AI 推理加速器,为边缘设备中的计算机视觉和语音提供更快、更高效的计算能力。

2022-05-31 10:47:55 770

770 此外,开放神经网络交换 (ONNX) 格式的兼容性允许 InferX X1M 工具以最佳方式自动将框架中表示的任何模型映射到 X1 加速器。

2022-07-11 09:56:46 909

909 瑞萨电子开发了一种新的内存处理器 (PIM) 技术,用于在低功耗边缘设备中加速 AI 推理。用于基于 SRAM 技术的测试芯片实现了 8.8 TOPS/W 的运行卷积神经网络 (CNN) 工作负载

2022-07-21 15:50:32 1072

1072 当 AI 设计人员将硬件加速器整合到用于训练和推理应用的定制芯片中时,应考虑以下四个因素

2022-08-19 11:35:55 1267

1267

SiFive 将 RISC-V 处理器 IP 引入其下一代 AI 推理加速器,为边缘设备中的计算机视觉和语音提供更快、更高效的计算能力。

2022-08-16 11:24:05 829

829 昆仑芯AI加速器组R480-X8,基于OCP-OAI设计标准,UBB基板搭载8个包含昆仑芯2代芯片的OAM模组。 提供高达1 Peta FLOPS@FP16算力,支持200 GB/s片间互联聚合带宽,适用于云数据中心大规模训练和推理场景。 规格参数 审核编辑 黄宇

2023-02-10 17:05:40 514

514

lpddr4x过时了吗?lpddr4x显卡怎么样?电脑LPDDR4X够用吗? LPDDR4X是低功耗双数据速率第四代SDRAM的一种版本,主要用于低功耗移动设备。它在功耗、性能和尺寸上,都有了很大

2023-08-21 17:16:46 3706

3706 能力的优化,同时也为设备提供了更好的性能。虽然这两种方法很相似,但它们之间还存在一些区别。下面将详细讨论LPDDR4X和LPDDR5之间的区别,以及它们如何影响设备的性能和使用情况。 1. 存储速度和容量 LPDDR4X的最大存储容量为16GB,而LPDDR5的最大容量为32GB。这意味着使

2023-08-21 17:28:27 3862

3862 lpddr4x和lpddr5区别 lpddr4x和ddr5的区别大不大 随着智能手机、平板电脑、笔记本电脑等消费电子产品的不断升级和发展,人们对设备运行速度和效率的要求也越来越高。在这样的背景

2023-08-21 17:28:29 19733

19733 已保留有6位SDR空间。最后,它占用的片上空间更少,单个封装最多可以包含12GB的DRAM。不利的一面是,LPDDR4X不能与LPDDR4向后兼容。即使设备与更快的LPDDR4内存兼容,它也可能不适用于LPDDR4X。

2023-09-19 11:09:36 8386

8386

如果在数据中心和边缘设备中部署上人工智能(AI)加速器,那么它们将能够快速处理PB级的数据量,还能帮助克服传统的冯·诺依曼瓶颈。

2023-10-26 09:18:43 810

810 从线上购物时的“猜你喜欢”、到高等级自动驾驶汽车上的实时交通信息接收,再到在线视频游戏,所有的这些都离不开人工智能(AI)加速器。AI加速器是一种高性能的并行计算设备,旨在高效处理神经网络等AI工作负载并提供近乎实时的处理方案,从而实现一系列应用。

2023-11-18 10:36:30 1144

1144

电子发烧友App

电子发烧友App

评论