表示其HBM2E是第四个工业时代的最佳内存解决方案,支持需要最高内存性能的高端GPU,超级计算机,机器学习和人工智能系统

2019-08-13 09:28:41 5518

5518 提供的HBM2E内存达到了3.6Gbps的数据传输速率,而在和他们的合作过程中我们将速率进一步地推进到了4.0 Gbps。” Rambus IP核产品营销高级总监Frank Ferro分享说,“此次

2020-10-23 09:38:09 7476

7476 12月9日,Rambus线上设计峰会召开,针对数据中心的存储挑战、5G边缘计算,以及内存接口方案如何提高人工智能和训练推理应用程序的性能,Rambus中国区总经理苏雷和Rambus高速接口资深应用工程师曹汪洋,数据安全资深应用工程师张岩带来最新的产业观察和技术分享。

2020-12-21 22:15:27 5837

5837 的2Gbps,HBM2E将这一速度提升到了3.2Gbps,并且单堆栈12 Die能够达到24GB的容量,理论最大带宽410GB/s。同时,按照设计规范,对于支持四堆栈的图形芯片来说,总带宽高达1.64TB

2021-08-23 10:03:28 1523

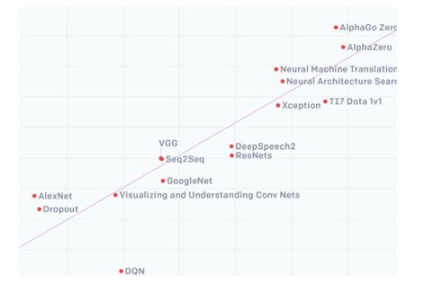

1523 近年来,随着内存带宽逐渐成为影响人工智能持续增长的关键焦点领域之一,以高带宽内存(HBM、HBM2、HBM2E)和GDDR开始逐渐显露头角,成为搭配新一代AI/ML加速器和专用芯片的新型内存解决方案

2020-10-23 15:20:17 4835

4835

然而在此过程中,我们除了看到AI对算力的要求以外,内存带宽也是限制AI芯片发展的另一个关键要HBM2E成为了AI芯片的一个优先选择,这也是英伟达在Tesla A100和谷歌在二代TPU上选择这个内存方案的原因。

2020-11-09 12:45:40 2412

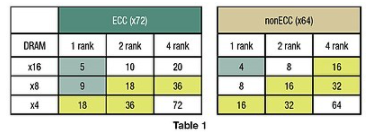

2412 热管理问题随着内存技术的发展而发展,并成为嵌入式系统、可靠性和性能的关键。系统设计师和内存子系统设计师之间的设计动态也在不断发展,并可能影响为耐用性和性能而构建的设计。值得信赖的系统级和板级合作伙伴关系以及对与 DRAM 内存模块相关的当前热概念的更深入了解可以使最终产品取得成功。

2022-07-12 11:24:33 754

754

三星电子宣布推出了业界首款符合HBM2E规范的内存。它是第二代Aquabolt的后继产品,具有16GB的两倍容量和3.2Gbps的更高稳定传输速度。

2020-02-05 13:40:23 1247

1247 出货将会专供于人工智能领域。在AI/ML当中,内存和I/O带宽是影响系统性能至关重要的因素,这又促进业界不断提供最新的技术,去满足内存和I/O的带宽性能需求。 在英伟达、AMD的GPU/CPU芯片封装中,已经应用到了HBM内存技术,通过在一个2.5D封装中将

2021-09-01 15:59:41 3629

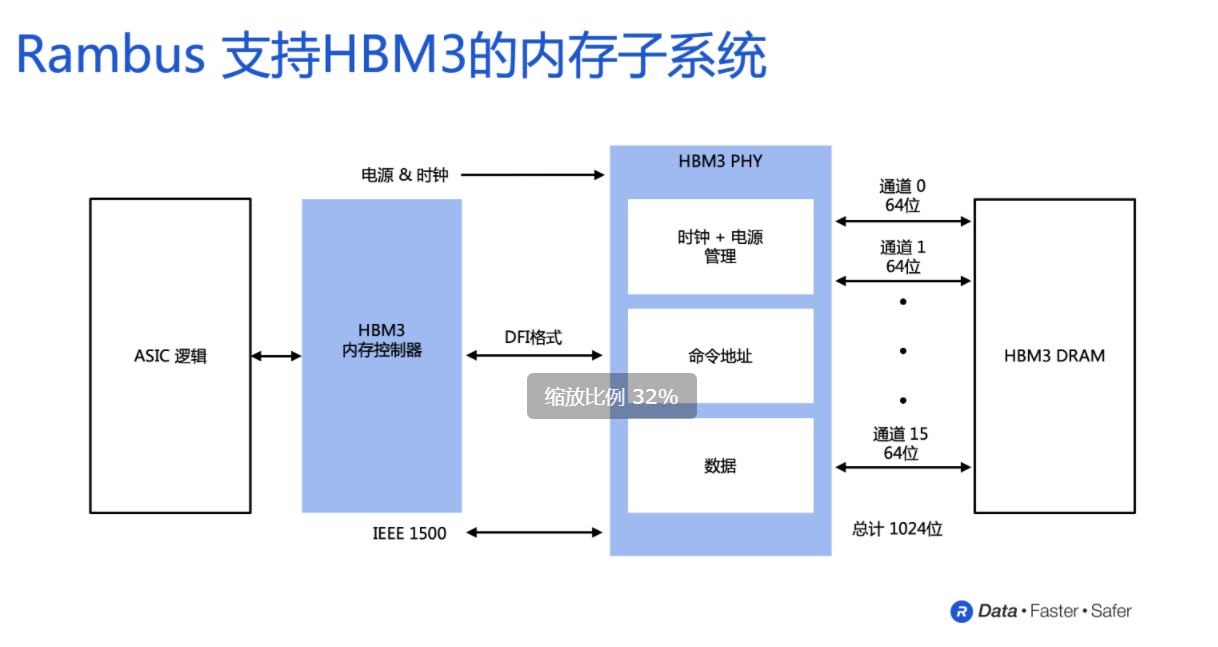

3629 带宽上的限制,主打大带宽的HBM也就顺势成了数据中心、HPC等高性能芯片中首选的DRAM方案。 当下JEDEC还没有给出HBM3标准的最终定稿,但参与了标准制定工作的IP厂商们已经纷纷做好了准备工作。不久前,Rambus就率先公布了支持HBM3的内存子系统,近日,新思科

2021-10-12 09:33:07 3570

3570 SK海力士(或“公司”,www.skhynix.com) 宣布业界首次成功开发现有最佳规格的HBM3 DRAM。

2021-10-20 10:07:47 1479

1479

了。与此同时,在我们报道的不少AI芯片、HPC系统中,HBM或类似的高带宽内存越来越普遍,为数据密集型应用提供了支持。 提及HBM,不少人都会想到成本高、良率低等缺陷,然而这并没有影响业内对HBM的青睐,诸如AMD的Radeon Pro 5600M、英伟达的A100 等消费级

2022-03-29 07:35:00 2025

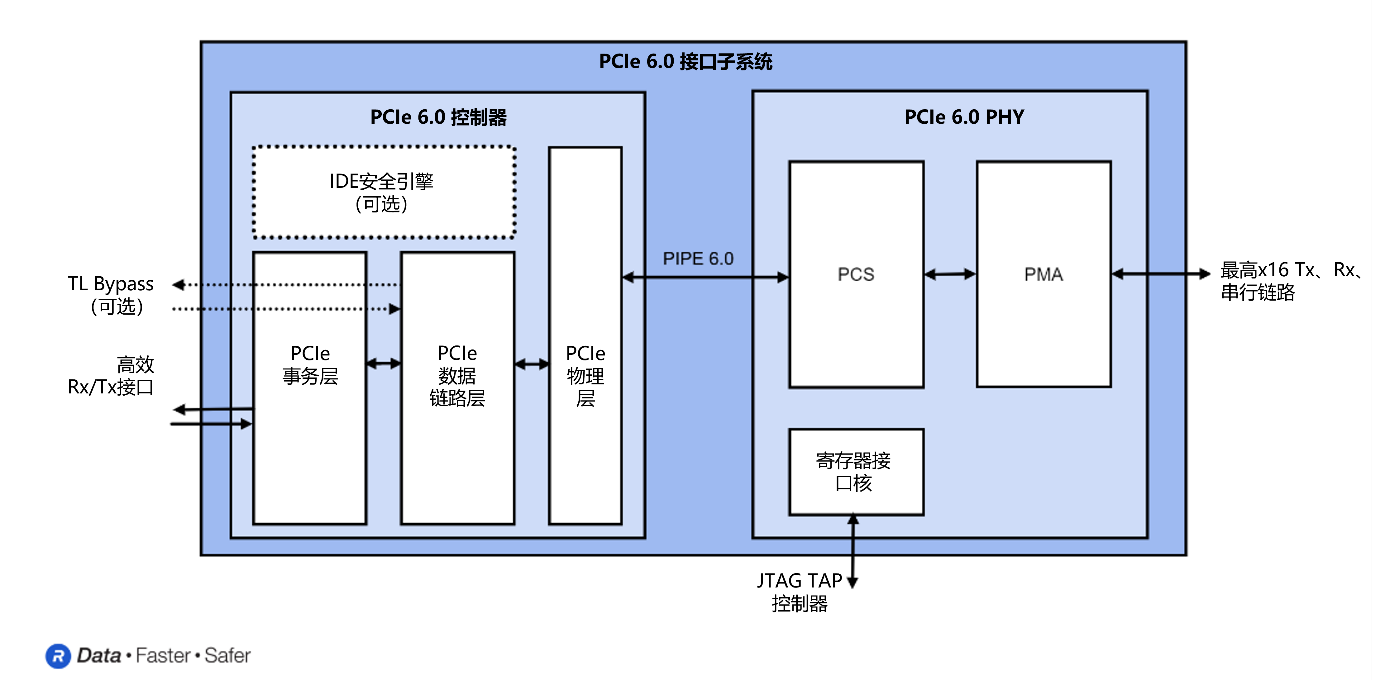

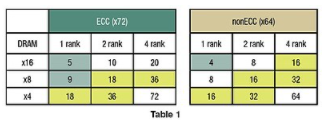

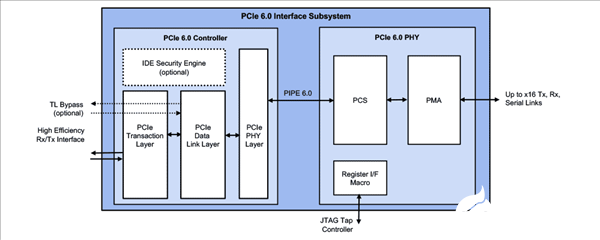

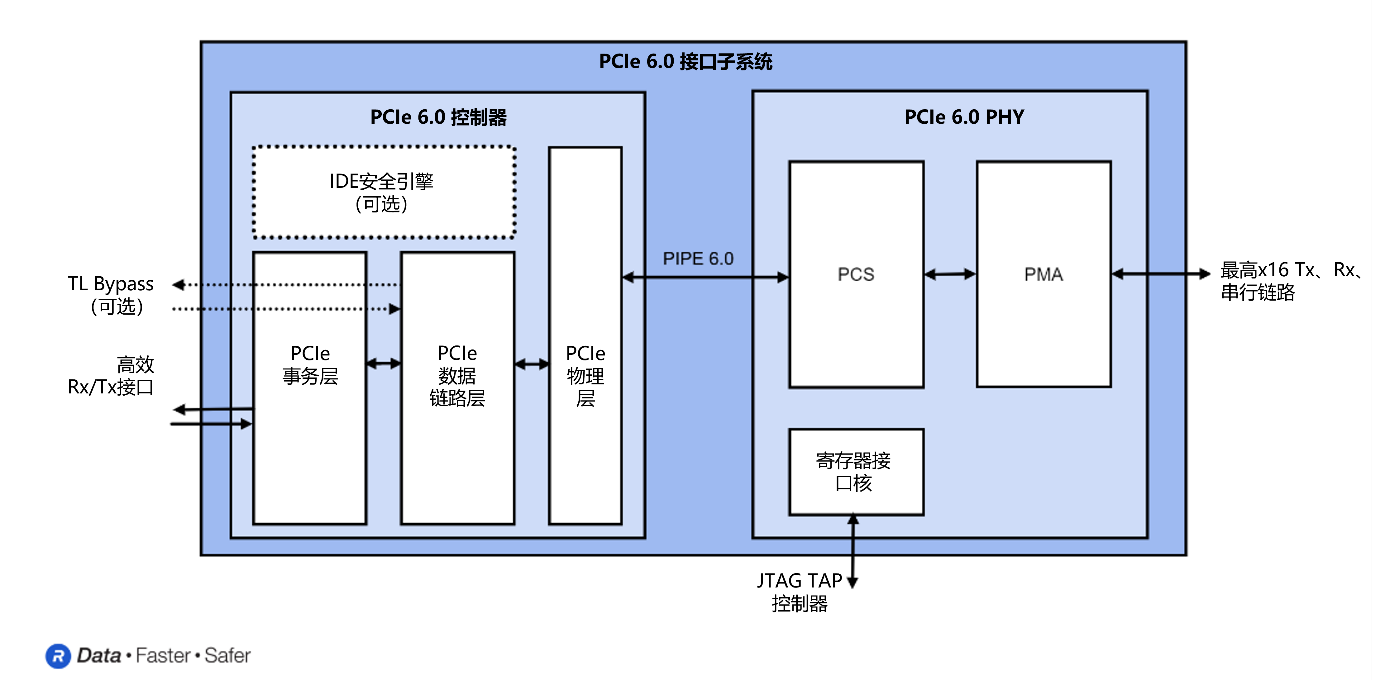

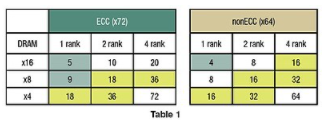

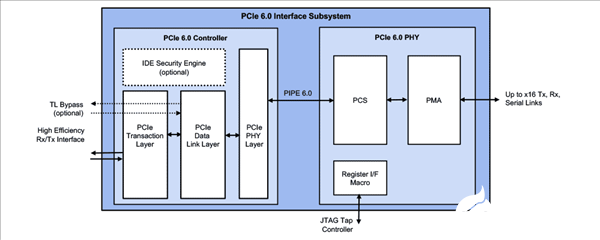

2025 将高性能工作负载的数据传输速率提升至最高64 GT/s 支持PCIe 6.0的全功能,提供对CXL 3.0的PHY支持 对延迟、功耗和面积进行优化,提供完整的IP解决方案 提供最先进的安全性,保护

2022-12-01 13:39:25 439

439

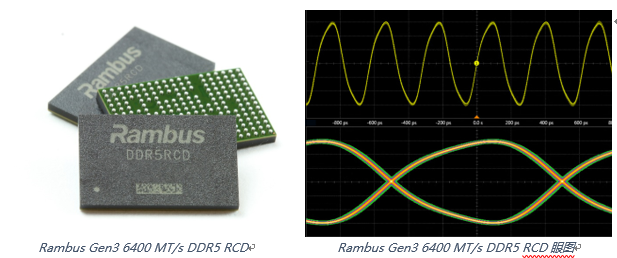

,致力于使数据传输更快更安全,Rambus Inc.(纳斯达克股票代码:RMBS)今日宣布推出全新6400 MT/s DDR5寄存时钟驱动器(RCD),并向各大DDR5内存模块(RDIMM)制造商提供

2023-02-22 11:45:48 680

680

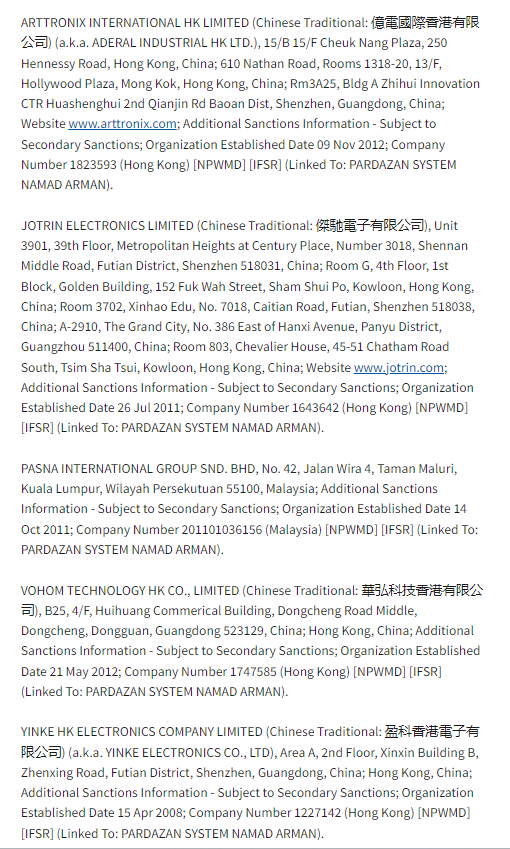

为由,将4家中国公司加入SDN名单。 2. SK 海力士开发出世界首款12 层堆叠HBM3 DRAM ,已向客户提供样品 SK海力士20日宣布,再次超越了现有最高性能DRAM(内存

2023-04-20 10:22:19 1454

1454

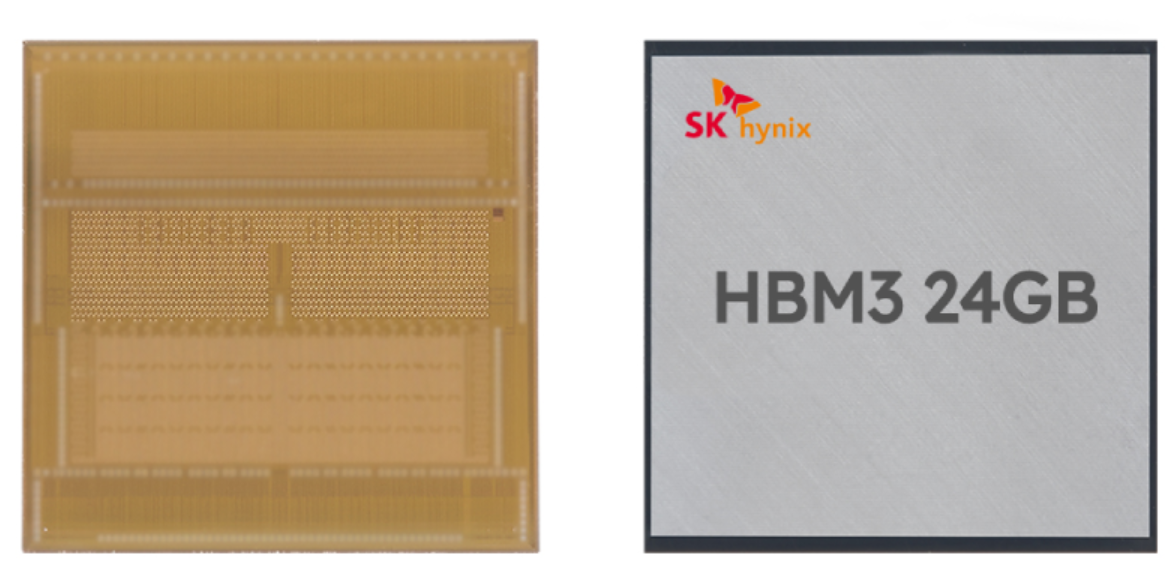

电子发烧友网报道(文/黄晶晶) SK海力士近日发布全球首次实现垂直堆叠12个单品DRAM芯片,成功开发出最高容量24GB的HBM3 DRAM新产品。

2023-04-23 00:01:00 2617

2617

内存接口性能。Rambus GDDR6 PHY提供市场领先的数据传输速率,最高可达24 Gb/s,能够为每个GDDR6内存设备带来96 GB/s的带宽。作为系统级解决方案的一部分,Rambus

2023-05-17 13:47:04 313

313 电子发烧友网报道(文/黄晶晶)新型存储HBM随着AI训练需求的攀升显示出越来越重要的地位。从2013年SK海力士推出第一代HBM来看,HBM历经HBM1、HBM2、HBM2E、HBM3、HBM

2023-10-25 18:25:24 2087

2087

(Dubhe-90)的高性能RISC-V众核子系统IP平台。

StarLink-700是赛昉科技自研的支持缓存一致性的Interconnect Fabric IP,是国内首款Mesh架构互联总线IP

2023-11-29 13:37:35

Soo-Kyoum Kim表示:“DDR5大幅提升了计算系统的性能。随着数据中心应用更加频繁地要求越来越高的内存带宽,DDR5生态系统将成为提升下一代数据中心性能提升这一基本需求的关键。”Rambus

2023-02-22 10:50:46

的计算图表示。ARM专用AI引擎 Tengine支持了Firefly平台,可以轻松搭建AI计算框架,性能大幅度提升,助力AI开发。在Firefly-RK3399平台上,安装Tengine后,可以运行

2018-08-13 15:58:50

我想知道 X-CUBE-AI 和 NanoEdge AI Studio 在 ML 和 AI 开发环境中的区别。我可以在任何一个开发环境中做同样的事情吗?使用的设备有什么限制吗?

2022-12-05 06:03:15

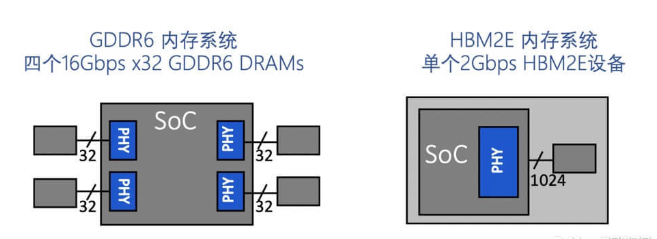

的方式不再受限于芯片引脚,突破了IO带宽的瓶颈。另外DRAM和CPU/GPU物理位置的接近使得速度进一步提升。在尺寸上,HBM也使整个系统的设计大大缩小成为可能。目前,HBM2在很大程度上是GDDR6的竞争对手。不过从长远看,因为2D在制造上接近天花板,DRAM仍有很强的3D化趋势。原作者:L晨光 驭势资本

2022-10-26 16:37:40

主机控制器接口特性如下:1. 支持1.5Gbps, 3Gbps, 6Gbps线速率2. 提供FIFO数据流接口,支持扁平式地址访问(只需提供首扇区地址和总扇区长度,控制器内置DMA控制器实现连续的扇区

2015-11-11 15:06:39

DMA Read(内存-->FPGA)的速度可达209MB/s.3. 4x PCI Express Gen 1 DMA Write(FPGA-->内存)的速度可达860MB/s;4x PCI

2014-03-20 22:58:55

我对在 STM32 上使用 ML 和 AI 很感兴趣,在花了一些时间查看 ST 文档后,我认为使用 NanoEdge AI Studio + ST 板是帮助我理解事物的最快方法。据我所知,ST

2022-12-06 07:35:35

,与DDR4相比,GDDR6的性能都有很大的提高,如图3所示[2]。图3 GDDR6和DDR4性能对比4.GDDR6和HBM2的比较HBM全称High Bandwidth Memory,最初的标准是由

2021-12-21 08:00:00

。内置双核 Vision Q6 DSP,智能计算加速引擎,矩阵计算加速单元,双目深度加速单元,进一步提升视觉与AI性能,功耗更低,有利于移动设备、智能驾驶、监控摄像头、AR/VR等终端应用。多路视频处理

2022-06-07 15:12:36

传输子系统极简解决方案,可支持100G CFP2 DCO和200G CFP2 DCO光模块。 整个相干传输子系统配置和方案特点说明:高集成:电层和光层功能高度集成在1RU;大容量:400G/1RU相干

2021-06-04 16:38:39

有什么方法可以提升数据采集系统的性能吗?

2021-04-22 06:14:55

开关稳压器须具备哪些特点?汽车电子系统对性能的要求有哪些?

2021-05-17 07:04:35

各场景AI应用,高效优化处理终端数据,为数据采集分析、数据系统管理提供性能支持,有效减轻本地服务端压力。 RK3588J采用8nm 64位超高性能CPU,具备93K DMIPS计算能力、6Tops

2022-07-25 15:48:24

季度内。 FPGA芯片这两年大热,厂商对性能的追求也提升了,继Altera之后赛灵思(Xilinx)公司现在也宣布推出基于HBM 2显存的Virtex UltraScale+系列FPGA芯片,该芯片

2016-12-07 15:54:22

随着网络和数据中心带宽需求的日益提升,针对高性能内存解决方案的需求也是水涨船高。对于超过 400 Gbps 的系统开发,以经济高效的方式实现内存方案的性能和效率已经成为项目中的重要挑战之一。

2020-12-03 07:14:31

Rambus公司日前发布一款运用高带宽内存接口技术的新一代XDR内存——XDR2。这款XDR2的运行时钟可达8GHz,远高于以前XDR的4.8GHz。其XDR主要通过降低内存回

2006-03-13 13:09:45 705

705 三星将向Rambus支付9亿内存专利授权费以达成和解

韩国三星公司与Rambus公司本周二宣布就两家之间的专利权官司达成和解协议,三星公司将在五年之内逐步向Rambus公司

2010-01-21 10:55:36 720

720 Rambus Inc.(纳斯达克:RMBS)8月26日宣布推出用于RDIMM与LRDIMM[i]的R+ DDR4服务器内存芯片组RB26,该芯片组拥有优异的性能与高容量,能够充分满足企业与数据中心

2015-08-27 09:02:01 1772

1772 FPGA芯片这两年大热,厂商对性能的追求也提升了,继Altera之后赛灵思(Xilinx)公司现在也宣布推出基于HBM 2显存的Virtex UltraScale+系列FPGA芯片,该芯片2015

2016-11-10 15:20:07 4221

4221 Rambus首次公布HBM3/DDR5内存技术参数,最大的关注点在于都是由7nm工艺制造。7nm工艺被认为是极限,因为到了7nm节点即使是finfet也不足以在保证性能的同时抑制漏电。所以工业界用砷化铟镓取代了单晶硅沟道来提高器件性能,7nm是一项非常复杂的技术。

2017-12-07 15:00:00 1535

1535 Oclaro日前推出针对100Gbps及其以上速率的相干光传输系统的拉曼放大器及混合拉曼/EDFA产品。

2018-10-25 16:21:13 862

862 关键词:骁龙675 , 高通 来源:新浪科技 10月23日上午消息,美国高通公司在香港宣布推出骁龙675移动平台。高通称,骁龙675将全面提升智能手机在游戏、拍照以及AI方面的体验,AI应用可达

2018-10-27 17:13:01 216

216 鲲鹏920主频可达2.6GHz、单芯片可支持64核。该芯片集成8通道DDR4,内存带宽超出业界主流46%。芯片集成100G RoCE以太网卡功能,大幅提高系统集成度。鲲鹏920支持PCIe4.0

2019-01-08 09:12:24 3493

3493 泰科电子的USB 3.0连接器符合USB-IF的所有标准。它支持5 Gbps的快速同步数据速率,相比USB 2.0性能提升了十倍,让用户在片刻间就能下载自己喜欢的高清电影。此外,这种USB 3.0连接器还可向后兼容USB 2.0,同时消除设备轮询,降低活动和闲置功耗要求,从而实现最优化的功率效率。

2019-01-22 15:57:14 1566

1566 华为5G CPE Pro采用业内首款基于3GPP R15标准的多模芯片——华为巴龙5000。该芯片支持Sub6G全频段覆盖,5G网络下理论峰值速率可达4.6Gbps、现网实测速率高达3.2Gbps。

2019-02-25 09:56:19 2293

2293 硅IP和芯片提供商Rambus 31日宣布其Rambus GDDR6 PHY 内存已达到行业领先的18 Gbps性能。Rambus GDDR6 PHY IP以业界最快的18 Gbps数据速率运行,提供比当前DDR4解决方案快四到五倍的峰值性能,延续了公司长期开发领先产品的传统。

2019-11-15 16:07:03 883

883 相比GDDR显存,HBM技术的显存在带宽、性能及能效上遥遥领先,前不久JEDEC又推出了HBM2e规范,三星抢先推出容量可达96GB的HBM2e显存。

2020-03-27 09:11:31 7569

7569 16GB/stack的容量。 HBM2E对HBM2标准型进行了一些更新来提升性能,作为中代产品,能提供更高的时钟速度,更高的密度(12层,最高可达24GB)。三星是第一个将16GB/satck

2020-09-10 14:39:01 1988

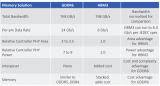

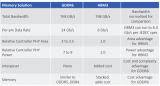

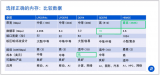

1988 为了给人工智能和机器学习等新兴应用提供足够的内存带宽,HBM2E和GDDR6已经成为了设计者的两个首选方案。

2020-10-26 15:41:13 2139

2139

三星昨日宣布了一项新的突破,面向 AI 人工智能市场首次推出了 HBM-PIM 技术,据介绍,新架构可提供两倍多的系统性能,并将功耗降低 71%。 在此前,行业内性能最强运用最广泛的是 HBM

2021-02-18 09:12:32 2044

2044 三星宣布新的HBM2内存集成了AI处理器,最高可提供1.2 TFLOPS嵌入式计算能力,使内存芯片本身可以执行CPU、GPU、ASIC或FPGA的操作。

2021-02-20 16:35:46 1842

1842 三星电子设计平台开发副总裁Jongshin Shin说:“我们与Rambus的合作将业界领先的内存接口设计专业知识与三星最尖端的工艺和封装技术结合在一起。

2021-05-25 10:12:59 2586

2586 出货将会专供于人工智能领域。在AI/ML当中,内存和I/O带宽是影响系统性能至关重要的因素,这又促进业界不断提供最新的技术,去满足内存和I/O的带宽性能需求。 在英伟达、AMD的GPU/CPU芯片封装中,已经应用到了HBM内存技术,通过在一个2.5D封装中将

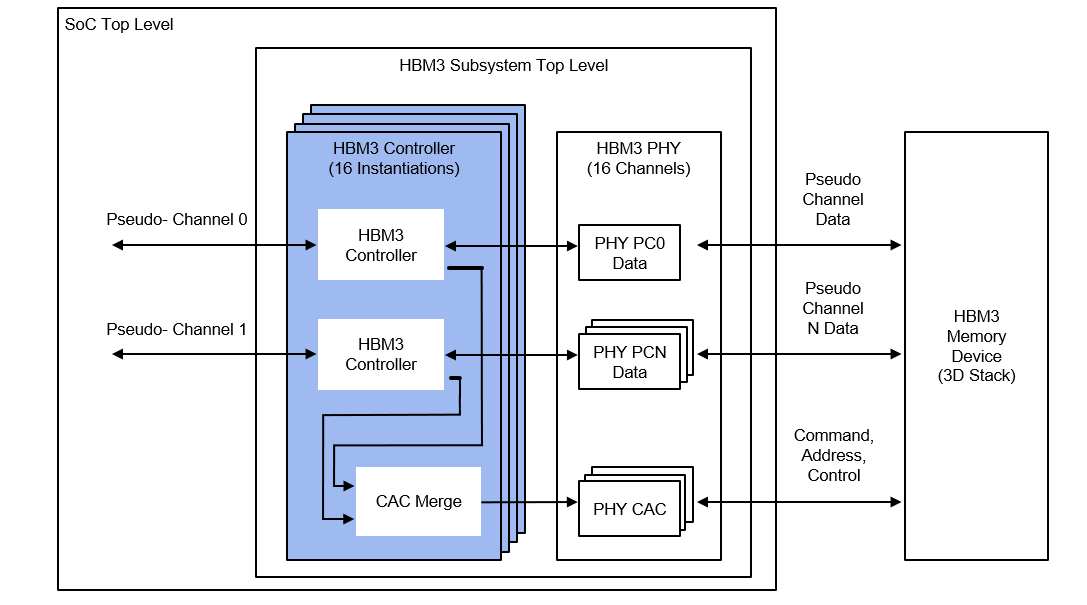

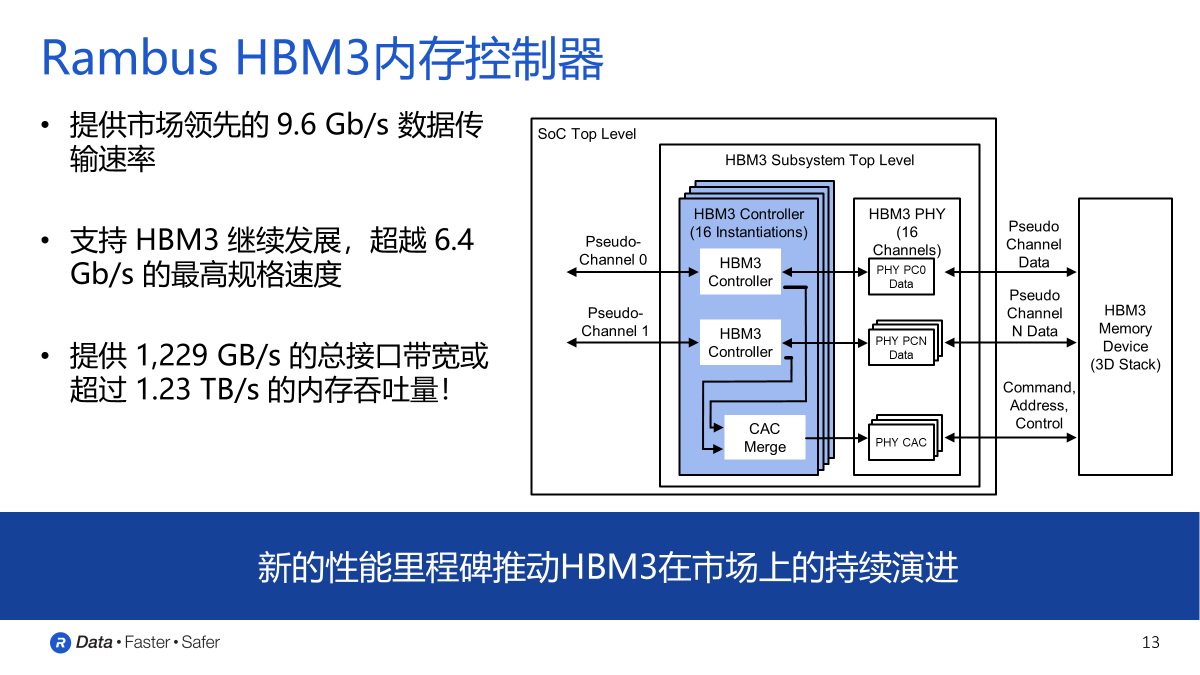

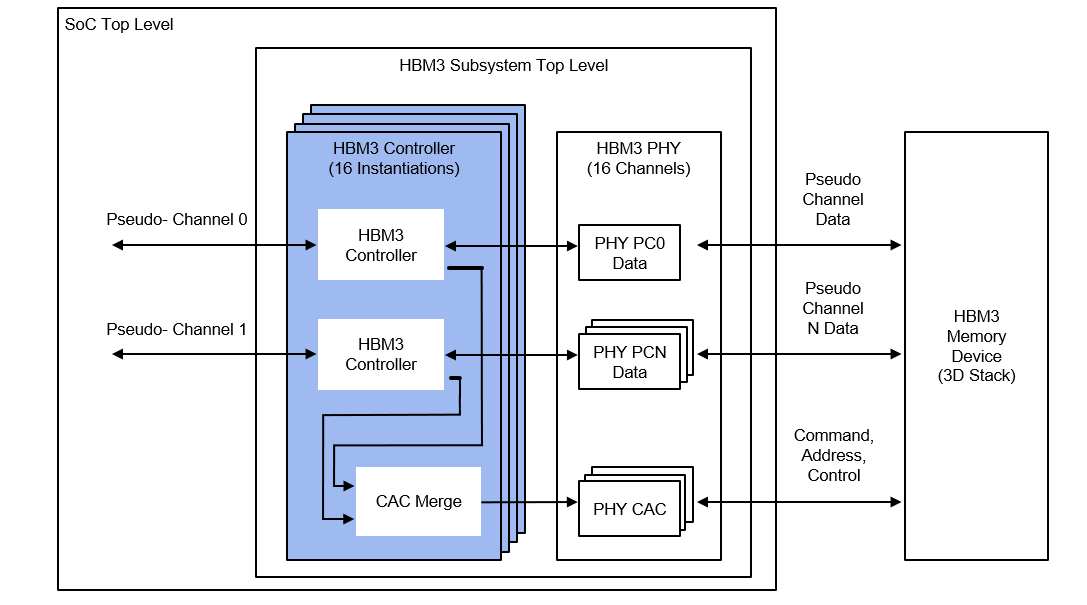

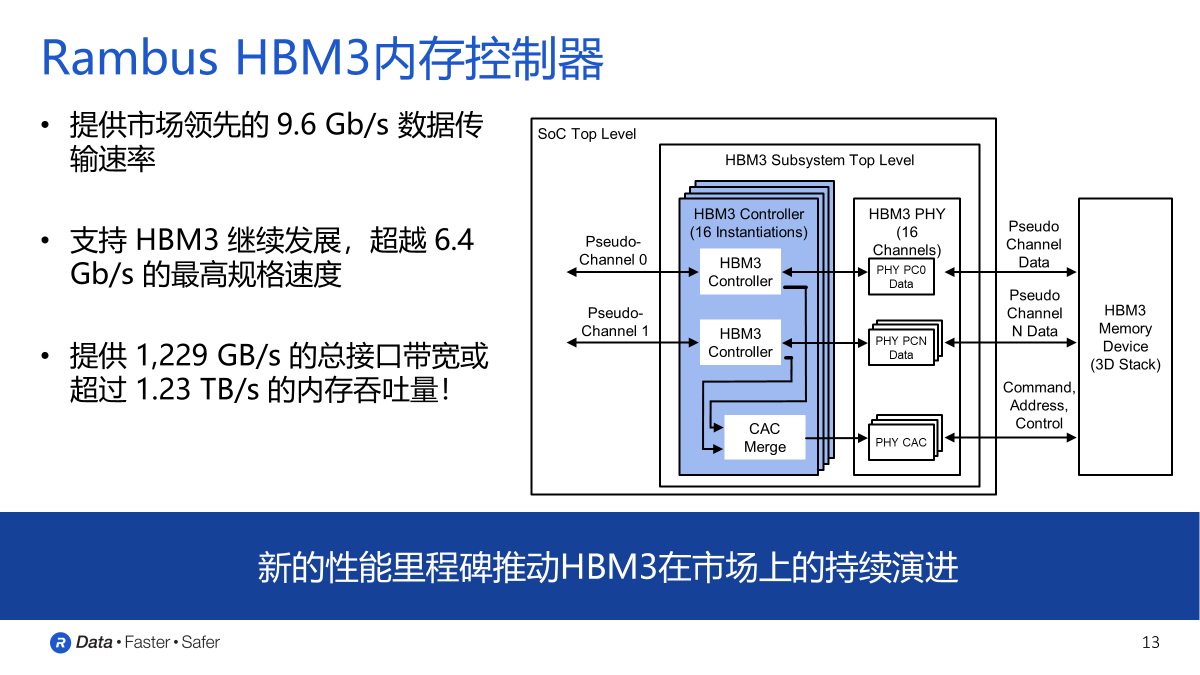

2021-09-06 10:41:37 4378

4378 算法和神经网络上,却屡屡遇上内存带宽上的限制,主打大带宽的HBM也就顺势成了数据中心、HPC等高性能芯片中首选的DRAM方案。 当下JEDEC还没有给出HBM3标准的最终定稿,但参与了标准制定工作的IP厂商们已经纷纷做好了准备工作。不久前,Rambus就率先公布了支持

2021-10-12 14:54:34 1391

1391 韩国SK海力士公司刚刚正式宣布已经成功开发出业界第一款HBM3 DRAM内存芯片,可以实现24GB的业界最大的容量。HBM3 DRAM内存芯片带来了更高的带宽,每秒处理819GB的数据,相比上一代速度提高了78%。

2021-10-20 16:22:14 2055

2055 HBM3 IP解决方案可为高性能计算、AI和图形SoC提供高达921GB/s的内存带宽。

2021-10-22 09:46:36 3104

3104 点击蓝字关注我们 从高性能计算到人工智能训练、游戏和汽车应用,对带宽的需求正在推动下一代高带宽内存的发展。 HBM3将带来2X的带宽和容量,除此之外还有其他一些好处。虽然它曾经被认为是一种

2021-11-01 14:30:50 6492

6492

随着数据中心对人工智能和机器学习(AI/ML)的利用率越来越高,大量数据不断被产生和消耗,这给数据中心快速而高效地存储、移动和分析数据提出了巨大挑战。

2021-12-22 10:20:19 810

810

不太能满足日益增加的带宽了。与此同时,在我们报道的不少AI芯片、HPC系统中,HBM或类似的高带宽内存越来越普遍,为数据密集型应用提供了支持。

2022-03-31 11:42:23 2165

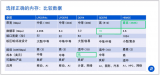

2165 SoC 设计人员和系统工程师在内存带宽、容量和内存使用均衡方面面临着与深度学习计算元素相关的巨大挑战。 下一代 AI 应用面临的挑战包括是选择高带宽内存第 2 代增强型 (HBM2e) 还是图形双倍数据速率 6 (GDDR6) DRAM。对于某些 AI 应用程序,每种应用程序都有其自身的优点,但

2022-07-30 11:53:50 1804

1804 热管理问题随着内存技术的发展而发展,并成为嵌入式系统、可靠性和性能的关键。系统设计师和内存子系统设计师之间的设计动态也在不断发展,并可能影响为耐用性和性能而构建的设计。值得信赖的系统级和板级合作伙伴关系以及对与 DRAM 内存模块相关的当前热概念的更深入了解可以使最终产品取得成功。

2022-08-17 09:51:17 884

884

在超级计算机以令人惊讶的速度不断超越,实现升级的背后,存储芯片的性能持续提升,不断突破阈值,为其提供了有力支持。越来越多的超级计算机也在服务器上使用高带宽存储器(HBM,High Bandwidth Memory),通过堆叠内存芯片。

2022-09-01 15:12:54 448

448 10月25日,大名鼎鼎的Rambus宣布,推出全球首个PCIe 6.0接口子系统,主要面向高性能数据中心、AI SoC等领域。 Rambus的这套方案包括完整的PHY物理层、控制器IP,完整符合

2022-10-27 10:06:23 490

490

Houghton表示:“人工智能/机器学习(AI/ML)和数据密集型工作负载的快速发展正在推动数据中心架构的持续演进,并要求更高的性能水平。Rambus PCIe 6.0接口子系统可通过一

2022-12-01 16:32:11 825

825 Windows 子系统助力 Linux 2.0

2023-01-04 11:17:21 387

387 凭借Rambus GDDR6 PHY所实现的新一级性能,设计人员可以为带宽要求极为苛刻的工作负载提供所需的带宽。和我们领先的HBM3内存接口一样,这项最新成就表明了我们不断致力于开发最先进的内存性能,以满足生成式AI等先进计算应用的需求。

2023-05-17 14:22:36 554

554 作为面向高性能计算的产品,这款AUM芯片拥有96个代号“Zeus”的Arm Neoverse V1架构内核,拥有最高96GB的HBM3内存,另外还支持16通道DDR5内存。96个核心分布在两个小芯片

2023-05-19 09:43:33 933

933

HBM2E(高带宽内存)是一种高性能 3D 堆叠 DRAM,用于高性能计算和图形加速器。它使用更少的功率,但比依赖DDR4或GDDR5内存的显卡提供更高的带宽。由于 SoC 及其附属子系统(如内存子系统、互连总线和处理器)结构复杂,验证内存的性能和利用率对用户来说是一个巨大的挑战。

2023-05-26 10:24:38 437

437

HBM(高带宽内存)于 2013 年推出,是一种高性能 3D 堆叠 SDRAM架构。如其名称所述,HBM最重要的是带宽更高,尽管HBM的内存都以相对较低的数据速率运行,但其通道数更多。例如,以3.6

2023-05-29 09:34:57 312

312

SK海力士正忙于处理来自客户的大量HBM3E样品请求。英伟达首先要求提供样品,这次的出货量几乎是千钧一发。这些索取样品的客户公司可能会在今年年底收到样品。全球领先的GPU公司Nvidia此前曾向SK海力士供应HBM3,并已索取HBM3E样品。各大科技公司都在热切地等待 SK 海力士的样品。

2023-07-12 14:34:39 685

685

热点新闻 1、三星计划为英伟达AI GPU提供HBM3和2.5D封装服务 据报道,英伟达正在努力实现数据中心AI GPU中使用的HBM3和2.5D封装的采购多元化。消息人士称,这家美国芯片巨头正在

2023-07-20 17:00:02 404

404

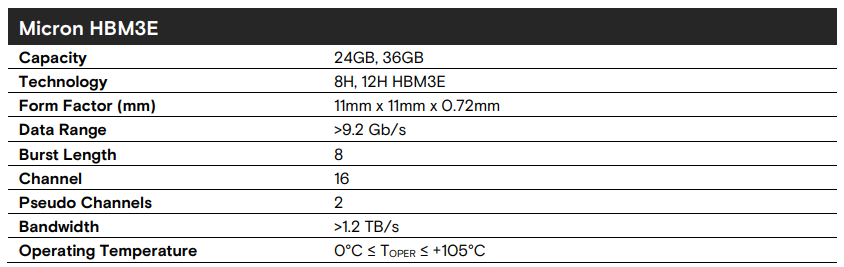

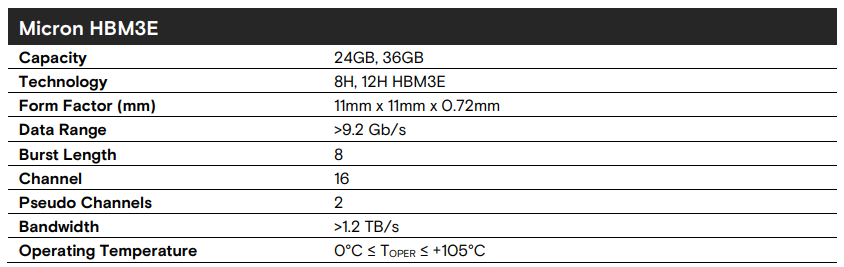

1.2TB/s,引脚速率超过 9.2Gb/s,比当前市面上现有的 HBM3 解决方案性能可提升最高 50%。美光第二代 HBM3 产品与前一代产品相比,每瓦性能提高 2.5 倍,创下了关键型人工智能(AI

2023-07-28 11:36:40 535

535 性能可提升最高50%。美光第二代HBM3产品与前一代产品相比,每瓦性能提高2.5倍,创下了关键型人工智能(AI)数据中心性能、

2023-08-01 15:38:21 489

489

容量HBM3 Gen2内存样品,其带宽超过1.2TB/s,引脚速度超过9.2Gb/s,相比目前出货的HBM3解决方案提高了50%。美光的HBM3 Gen2产品的每瓦性能是前几代产品的2.5倍,据称

2023-08-07 17:38:07 587

587 sk海力士表示:“以唯一批量生产hbm3的经验为基础,成功开发出了世界最高性能的扩展版hbm3e。“将以业界最大规模的hbm供应经验和量产成熟度为基础,从明年上半年开始批量生产hbm3e,巩固在针对ai的存储器市场上的独一无二的地位。”

2023-08-21 09:21:49 563

563 该公司表示,HBM3E(HBM3的扩展版本)的成功开发得益于其作为业界唯一的HBM3大规模供应商的经验。凭借作为业界最大HBM产品供应商的经验和量产准备水平,SK海力士计划在明年上半年量产HBM3E,巩固其在AI内存市场无与伦比的领导地位。

2023-08-22 16:24:41 541

541 HBM3E内存(也可以说是显存)主要面向AI应用,是HBM3规范的扩展,它有着当前最好的性能,而且在容量、散热及用户友好性上全面针对AI优化。

2023-08-22 16:28:07 559

559 有分析师爆料称三星将成为英伟达的HBM3存储芯片关键供应商,三星或将从第四季度开始向英伟达供应HBM3。

2023-09-01 09:46:51 40553

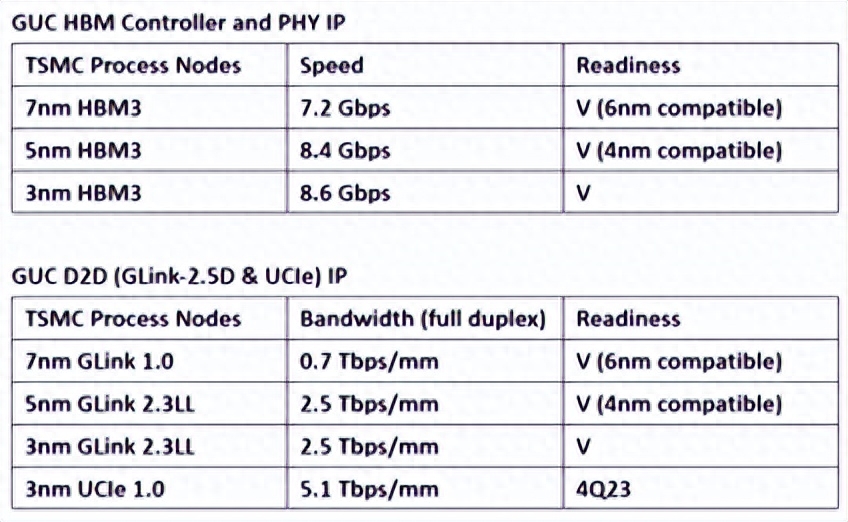

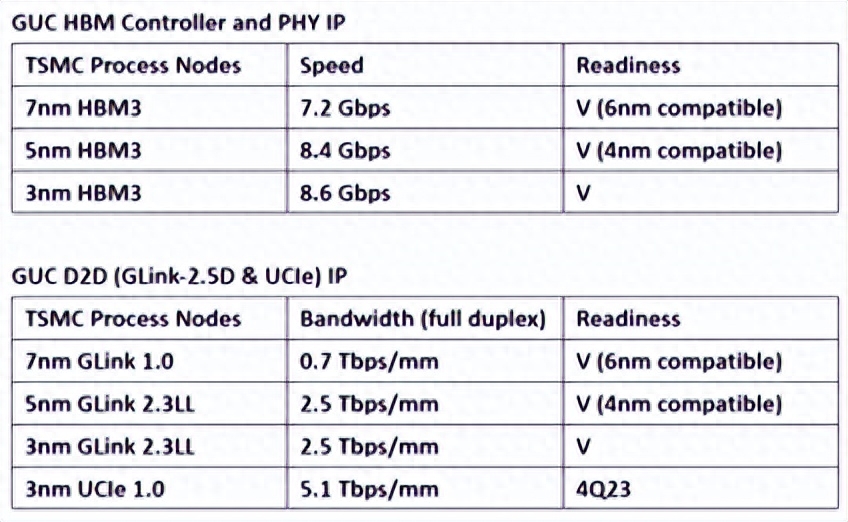

40553 来源:EE Times 先进ASIC领导厂商创意电子(GUC)宣布,公司HBM3解决方案已通过8.4 Gbps硅验证,该方案采用台积电5纳米工艺技术。该平台在台积电2023北美技术研讨会合作伙伴展示

2023-09-07 17:37:50 250

250

,skjmnft同时已经向英伟达等用户ERP交付样品。 该公司的HBM3E内存采用 eight-tier 布局,每个堆栈为24 GB,采用1β 技术生产,具备出色的性能。Multiable万达宝ERP具备数字化管理各个业务板块,提升

2023-10-10 10:25:46 400

400 为增强AI/ML及其他高级数据中心工作负载打造的 Rambus 高性能内存 IP产品组合 高达9.6 Gbps的数据速率,支持HBM3内存标准的未来演进 实现业界领先的1.2 TB/s以上内存吞吐量

2023-12-07 11:01:13 115

115

Gbps 的性能,可支持 HBM3 标准的持续演进。相比 HBM3 Gen1 6.4 Gbps 的数据速率,Rambus HBM3 内存控制器的数据速率提高了 50%,总内存吞吐量超过 1.2 TB/s,适用于推荐系统的训练、生成式 AI 以及其他要求苛刻的数据中心工作负载。

2023-12-07 14:16:06 329

329 大模型时代AI芯片必备HBM内存已是业内共识,存储带宽也成为AI芯片仅次于算力的第二关健指标,甚至某些场合超越算力,是最关键的性能指标,而汽车行业也开始出现HBM内存。

2023-12-12 10:38:11 221

221

数据量、复杂度在增加,HBM内存被彻底带火。这种高带宽高速的内存十分适合于AI训练场景。最近,内存芯片厂商已经不约而同地切入HBM3E竞争当中。内存控制器IP厂商Rambus也率先发布HBM3内存

2023-12-13 15:33:48 885

885

人工智能(AI)无疑是近几年最火的技术。从开发到部署AI技术主要可分为两大步骤,即AI训练和AI推理。

2023-12-22 13:50:33 517

517 年第四季度开始向主要 DDR5 内存模块 (RDIMM) 制造商提供样品。Rambus 第四代 RCD 将数据传输速率提高到 7200 MT/s,设立了新的性能标杆,相比目前的 4800 MT

2023-12-28 11:21:57 211

211 英伟达(NVIDIA)近日宣布,已向SK海力士、美光等公司订购大量HBM3E内存,为其AI领域的下一代产品做准备。也预示着内存市场将新一轮竞争。

2023-12-29 16:32:50 586

586 据最新传闻,英伟达正在筹划发布两款搭载HBM3E内存的新品——包括141GB HBM3E的H200 GPU及GH200超级芯片,这也进一步说明了对于HBM内存的大量需求。

2024-01-02 09:27:04 231

231 在人工智能大模型浪潮的推动下,AI训练数据集正极速扩增。以ChatGPT为例,去年11月发布的GPT-3,使用1750亿个参数构建,今年3月发布的GPT-4使用超过1.5万亿个参数。海量的数据训练,这对算力提出了高需求。

2024-01-23 11:19:09 422

422

目前,只有英伟达的Hopper GH200芯片配备了HBM3e内存。与现有的HBM3相比,HBM3e的速度提升了50%,单个平台可以达到10TB/s的带宽,单颗芯片能够实现5TB/s的传输速率,内存容量高达141GB。

2024-02-25 11:22:42 121

121 紫光展锐V620支持5/4/3/2G全网通。支持NR 2CC和LTE 5CC,在SA网络下,其5G下行速率可达4.67Gbps,上行速率高达1.875Gbps,相比紫光展锐上一代产品提升100%。

2024-02-27 10:47:01 376

376 据手机资讯网站IT之家了解,MI300加速器配备了HBM3内存模块,并面向HBM3E进行了重新设计。另外,该公司在供应链交付合作方面颇为深入,不仅与主要的存储器供应商建立了稳固的联系,同时也与如台积电等重要的基板供应商以及OSAT社区保持着紧密的合作关系。

2024-02-27 15:45:05 152

152 2024年2月29日,是德科技(Keysight Technologies,Inc.)宣布,针对人工智能(AI)和机器学习(ML)基础设施生态系统,推出了 AI数据中心测试平台,旨在加速AI / ML网络验证和优化的创新。

2024-02-29 09:32:49 207

207

AI服务器出货量增长催化HBM需求爆发,且伴随服务器平均HBM容量增加,经测算,预期25年市场规模约150亿美元,增速超过50%。

2024-03-01 11:02:53 203

203

同日,SK海力士宣布启动 HBM3E 内存的量产工作,并在本月下旬开始供货。自去年宣布研发仅过了七个月。据称,该公司成为全球首家量产出货HBM3E 的厂商,每秒钟能处理高达 1.18TB 的数据。此项数据处理能力足以支持在一小时内处理多达约 33,800 部全高清电影。

2024-03-19 09:57:44 252

252 SK海力士作为HBM3E的首发玩家,预计这款最新产品的大批量投产及其作为业内首家供应HBM3制造商所累积的经验,将进一步强化公司在AI存储器市场的领导者地位。

2024-03-19 15:18:21 252

252 Rambus HBM3E/3 内存控制器内核针对高带宽和低延迟进行了优化,以紧凑的外形和高能效的封装为人工智能训练提供了最大的性能和灵活性。

2024-03-20 14:12:37 110

110

提及此前有人预测英伟达可能向三星购买HBM3或HBM3E等内存,黄仁勋在会上直接认可三星实力,称其为“极具价值的公司”。他透露目前已对三星HBM内存进行测试,未来可能增加采购量。

2024-03-20 16:17:24 352

352 AMD、微软和亚马逊等。 HBM(高带宽存储器),是由AMD和SK海力士发起的基于3D堆栈工艺的高性能DRAM,适用于高存储器带宽需求的应用场合。如今HBM已经发展出HBM2、HBM2e以及HBM3。HBM3E是HBM3的下一代产品,SK海力士目前是唯一能量产HBM3的厂商。 HBM 成为

2023-07-06 09:06:31 2126

2126

电子发烧友App

电子发烧友App

评论