苹果公司近日发布的iOS 13操作系统的代码,披露有关增强现实眼镜的部分信息。开发人员在iOS 13测试版中发现了一款STARTester应用程序,其中包括一个头戴式模式,旨在呈现出某种增强现实硬件的用户体验。之前有传言称苹果已经停止了对增强现实眼镜的所有研发工作,但事实并非如此。此外,长期跟踪苹果动态的著名分析师郭明錤今年3月表示,苹果可能最早在今年开始生产增强现实眼镜,以便在2020年进行销售。

美国专利商标局公布了一份与混合现实头显相关的苹果专利申请,并旨在解决容易造成用户产生眼睛疲劳,恶心,头晕等问题的视觉辐辏调节冲突。

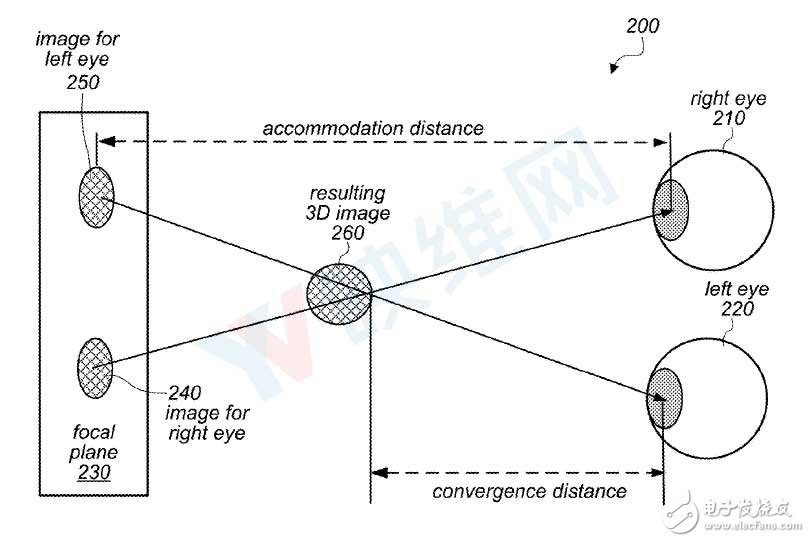

在现实世界中,你的眼睛可以自动对焦一个对象,而世界的其他元素则会脱离焦点。VR/AR的问题是,无论你在VR世界中看向何方,你都只是盯着屏幕,亦即看着相同的距离。换句话说,视觉调节(弯曲眼睛晶状体以聚焦不同距离的对象)永远不会改变,但视觉辐辏(眼睛向内旋转以将每只眼睛的视图重叠成一个对齐图像)却会出现,所以会导致视觉辐辏调节冲突。

针对这个问题,苹果提出了一种通过直接视网膜投影仪的系统来解决视觉辐辏调节冲突的发明专利。

相关专利:Apple Patent | Display Device

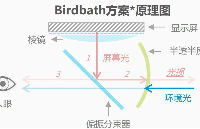

苹果指出:“增强现实头显可以包括反射全息组合器,从而将来自光引擎的光线引导到用户眼睛,同时传输来自环境的光线。为匹配眼睛的视敏度,组合器和光引擎可以布置成投射具有不同视场和分辨率的光场。”

这家公司进一步描述道,所述引擎可以包括激光二极管阵列,分布式波导,扫描镜和分层波导。光引擎可以包括用于聚焦光束的聚焦元件。

在一些实施例中,光引擎可包括在中心视场上投射较宽直径光束的注视点投影仪,以及在外围视场投射较小直径光束的外围视场投影仪。

在一些实施例中,光引擎可以包括多个从不同投影点进行投射的独立光源(如激光二极管,LED等),而且其中一部分是注视点投影仪,另一部分是外围视场投影仪。

在一些实施例中,光引擎包括两个或更多个双轴扫描镜,同时适当地调制光源以产生所需图像。

在一些实施例中,光引擎包括用于每个投影仪的透镜和聚焦元件,从而使得光线在被全息组合器反射并进入用户眼睛时基本为准直。

在一些实施例中,可以为每个投影点提供有源光束聚焦元件。这可以减少或消除以角度改变光束直径的需要,同时可以使得发散到眼睛中的光束能够匹配虚拟对象的假定深度的光束发散。

利用上述方法和装置,苹果构思的AR系统可能不需要额外的移动部件或机械元件来补偿视窗中的眼睛位置改变,或在扫描期间改变全息组合器的光功率,从而简化系统架构(相对于其他的直接视网膜投影系统)。

名为“Display Device ”的苹果专利申请于2019年3月提交,是2017年7月提交的专利申请的延续案 ,并在日前由美国专利商标局公布。需要注意的是,这只是一份专利申请,尚不确定苹果将于何时商业化具体的发明技术。

-

苹果

+关注

关注

61文章

24348浏览量

196811 -

AR眼镜

+关注

关注

4文章

523浏览量

23041

发布评论请先 登录

相关推荐

Meta在VR与AR领域的探索与挑战

苹果AR眼镜预计2026年量产,或采用Micro LED技术

微软正全力研发Windows增强现实(AR)眼镜

苹果AR眼镜:技术突破引领未来视觉体验新纪元

苹果轻量级AR眼镜研发持续进行,发布日期仍成谜

消息称苹果正在研发轻量级AR眼镜

AR眼镜_AR智能眼镜芯片|主板|光机硬件设计方案

苹果与Meta竞逐AR眼镜市场

苹果Vision pro 头显已发售,库克多次表示AR是终极方向?

苹果或仍在研发AR眼镜 苹果AR/VR新专利曝光

苹果或仍在研发AR眼镜 苹果AR/VR新专利曝光

评论