昨天,初创公司Cerebras Systems宣布推出有史以来最大的芯片Wafer Scale Engine(WSE)。

据悉,WSE拥有1.2万亿个晶体管,这是一个什么概念呢?比较一下,1971年英特尔首款4004处理器拥有2300个晶体管,最近,AMD推出的最新处理器拥有320亿个晶体管。由此可见WSE规模之庞大。

大多数芯片是在12英寸硅晶圆上制造的,并在芯片工厂中批量处理。但Cerebras Systems芯片是在单个晶圆上通过互联实现的单芯片。这些互连设计使其全部保持高速运行,可使万亿个晶体管全部一起工作。

Cerebras Wafer Scale Engine专门针对处理人工智能应用程序而设计的。该公司本周正在加利福尼亚州帕洛阿尔托的斯坦福大学举行的Hot Chips会议上讨论这项设计。

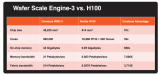

此前,三星已经制造了一个闪存芯片,即eUFS,拥有2万亿个晶体管。但Cerebras芯片拥有400,000个核心,42,225平方毫米。它比最大的Nvidia图形处理单元大 56.7倍,该单元的尺寸为815平方毫米和211亿个晶体管。

与传统芯片相比,WSE还包含3000倍的高速片上存储器,并且具有10000倍的存储器带宽。

该芯片来自Andrew Feldman领导的团队,后者曾创建微型服务器公司SeaMicro,并以3.34亿美元的价格出售给了AMD。

芯片尺寸在AI中非常重要,因为大芯片可以更快地处理信息,在更短的时间内产生答案。减少训练时间,使研究人员能够测试更多想法,使用更多数据并解决新问题。谷歌,Facebook,OpenAI,腾讯,百度和许多专业人士都认为,今天人工智能的主要限制是训练需要很长时间。因此,缩短训练时间就消除了整个行业进步的主要瓶颈。

当然,芯片制造商通常不会制造如此大的芯片。在单个晶圆上,在制造过程中通常会产生一些杂质,杂质会导致芯片发生故障。如果晶圆上只有一个芯片,它有杂质的几率是100%,杂质会使芯片失效。但Cerebras设计的芯片是有冗余的,因此一种杂质不会破坏整个芯片。

WSE有很多创新,通过解决限制芯片尺寸的数十年的技术挑战 - 例如交叉光罩连接,良率,功率输送,以及封装等,Cerebras Systems首席执行官费尔德曼说。“每个架构决策都是为了优化AI工作的性能。结果是,Cerebras WSE根据工作量提供了数百或数千倍于现有解决方案的性能,只需很小的功耗和空间。“

WSE通过加速神经网络训练的所有元素来实现这些性能提升。神经网络是多级计算反馈回路。较快的输入在循环中移动,循环学习的速度越快,从而减少了训练时间。

Linley Group首席分析师Linley Gwennap在一份声明中说:“Cerebras凭借其晶圆级技术实现了巨大的飞跃,在单片晶圆上实现了更多的处理性能。” 为了实现这一壮举,该公司已经解决了一系列工程难题,包括实施高速芯片到芯片通信,解决制造缺陷,封装如此大的芯片,以及电源和冷却等问题。通过将各种学科的顶级工程师聚集在一起,Cerebras在短短几年内创造了新技术并交付了产品。

据悉,该芯片面积比最大的GPU多56.7倍,Cerebras WSE提供更多内核进行计算,更多内存靠近内核,因此内核可以高效运行。由于这些大量的内核和内存位于单个芯片上,因此所有通信都在芯片内进行,这意味着它的低延迟通信带宽是巨大的,因此内核组可以以最高效率进行协作。

Cerebras WSE中的46,225平方毫米的硅包含400,000个AI优化,无缓存,无开销的计算内核和18千兆字节的本地、分布式、超高速SRAM内存,内存带宽为每秒9 PB。这些内核通过细粒度、全硬件、片上网状连接通信网络连接在一起,可提供每秒100 petabits的总带宽。更多内核,更多本地内存和低延迟高带宽结构共同构成了加速AI工作的最佳架构。

更多核心

WSE包含400,000个AI优化的计算核心。被称为稀疏线性代数核心的SLAC,计算核心灵活、可编程,并针对支持所有神经网络计算的稀疏线性代数进行了优化。SLAC的可编程性确保内核可以在不断变化的机器学习领域中运行所有神经网络算法。

由于稀疏线性代数核心针对神经网络计算基元进行了优化,因此它们可实现最佳利用率 - 通常是GPU的三倍或四倍。此外,WSE核心包括Cerebras发明的稀疏性收集技术,以加速稀疏工作负载(包含零的工作负载)的计算性能,如深度学习。

零在深度学习计算中很普遍。通常,要相乘的向量和矩阵中的大多数元素都是零。然而,乘以零是浪费硅、功率和时间,因为没有新的信息。

因为GPU和张量处理单元是密集的执行引擎 - 设计为永不遇到零的引擎 - 它们即使在零时也会乘以每个元素。当50%-98%的数据为零时,如深度学习中的情况一样,大多数乘法都被浪费了。由于Cerebras稀疏线性代数核不会乘以零,所有零数据都会被滤除,并且可以在硬件中跳过。

存储

内存是每个计算机体系结构的关键组件。更接近计算的内存转换为更快的计算,更低的延迟和更好的数据移动功效。高性能深度学习需要大量计算,并且频繁访问数据。这需要计算核心和存储器之间的紧密接近,这在GPU中并非如此,其中绝大多数存储器是很缓慢的,且在片外。

Cerebras Wafer Scale Engine包含更多内核,具有比迄今为止任何芯片更多的本地内存,并且在一个时钟周期内可以通过其核心访问18GB的片上内存。WSE上的核心本地内存集合可提供每秒9PB的内存带宽 - 比领先的图形处理单元多3,000倍的片上内存和10,000倍的内存带宽。

通信

Swarm通信结构是WSE上使用的处理器间通信结构,它可以传统通信技术的功耗的一小部分实现突破性带宽和低延迟。Swarm提供低延迟、高带宽的2D网格,可连接WSE上的所有400,000个核心,每秒带宽为100 petabits。

路由方面,Swarm为每个神经网络提供独特的优化通信路径。软件根据正在运行的特定用户定义的神经网络结构,配置通过400,000个核心的最佳通信路径以连接处理器。

Cerebras WSE的总带宽为每秒100 petabits。不需要诸如TCP / IP和MPI之类的通信协议支持,因此避免了它们的性能损失。该架构中的通信能量成本远低于每比特1焦耳,这比GPU低近两个数量级。通过结合大量带宽和极低的延迟,Swarm通信结构使Cerebras WSE能够比任何当前可用的解决方案更快地学习。

-

芯片

+关注

关注

455文章

50791浏览量

423486 -

晶体管

+关注

关注

77文章

9688浏览量

138157 -

Systems

+关注

关注

0文章

28浏览量

20455

原文标题:反其道而行,世界最大芯片诞生

文章出处:【微信号:icbank,微信公众号:icbank】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

Cerebras提交IPO申请,估值达41亿美元

X射线激光器发射有史以来强脉冲

韩国芯片出口飙升,创下有史以来新高

AI初创公司Cerebras秘密申请IPO

AI初出企业Cerebras已申请IPO!称发布的AI芯片比GPU更适合大模型训练

Power Integrations推出SCALE-iFlex XLT系列门极驱动器

Groq筹资约3亿美元,向Cerebras等对手看齐

Power Integrations推出SCALE-iFlex XLT系列双通道即插即用型门极驱动器

芯科科技宣布推出全新的xG22E系列无线片上系统(SoC)

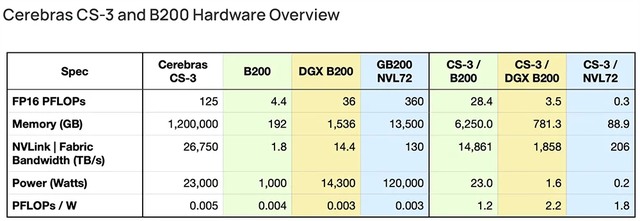

B200一经面市,就只能做弟弟?Cerebras '巨无霸'能否逆袭成功?

世界第一AI芯片发布!世界纪录直接翻倍 晶体管达4万亿个

Cerebras Systems推出迄今最快AI芯片,搭载4万亿晶体管

Cerebras推出WSE-3 AI芯片,比NVIDIA H100大56倍

Cerebras Systems宣布推出有史以来最大的芯片Wafer Scale Engine

Cerebras Systems宣布推出有史以来最大的芯片Wafer Scale Engine

评论