今天上午据软件绿色联盟消息,阿里MNN已经接入华为 HiAI生态,正式支持华为NPU。

据了解,阿里MNN为Mobile Neural Network,是阿里巴巴淘系技术部开源的端侧推理引擎,目前已覆盖淘宝、天猫、优酷和UC等20多个手机应用,每天稳定运行超过500亿次,已经接受了两届“双11”的考验。

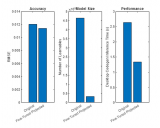

官方表示,当App功能日益强大时,性能和精度的矛盾就逾显尖锐;官方表示利用HiAI Foundation芯片能力开放,阿里MNN快速转化和迁移已有模型,并借助异构调度和NPU加速,大幅提升应用算力和能效比,可以优化MNN的性能和精度问题。比如会加快以图搜图的搜索速度,耗电方面也会降低;此外,扫商家Logo也是运用了此功能。

责任编辑:gt

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

华为

+关注

关注

218文章

36173浏览量

262651 -

阿里

+关注

关注

6文章

467浏览量

34236

发布评论请先 登录

相关推荐

热点推荐

IMX95 - NPU 不工作的原因?怎么解决?

: Created TensorFlow Lite XNNPACK delegate for CPU.

我的问题是:哪个 SDK 版本真正正确支持 NPU?会升级到最新版本内核 6.12.34可能有帮助吗?我宁愿不回滚到内核 6.6如果可能的话。谢谢。

发表于 02-26 11:21

【新品发布】艾为重磅发布端侧AI高性能NPU语音芯片,打造智能语音体验新标杆

数模龙头艾为电子全新推出高性能NPU神经网络智能语音处理芯片:AWA89601,集成音频专用NPU(神经网络处理器),通过声音模型训练与NPU硬件结合,该芯片在AI降噪、AI人声增强、

瑞芯微SOC智能视觉AI处理器

。B2版本通常在功耗、稳定性和部分外围接口支持上有所优化。NPU: 集成0.8 TOPS的NPU,支持INT8/INT16混合运算,能满足大

发表于 12-19 13:44

如何利用NPU与模型压缩技术优化边缘AI

随着人工智能模型从设计阶段走向实际部署,工程师面临着双重挑战:在计算能力和内存受限的嵌入式设备上实现实时性能。神经处理单元(NPU)作为强大的硬件解决方案,擅长处理 AI 模型密集的计算需求。然而

基于米尔瑞芯微RK3576开发板的Qwen2-VL-3B模型NPU多模态部署评测

RKLLM-Toolkit),支持 Hugging Face 格式模型的量化(如 w4a16、w8a8)和优化,适配 RK3588、RK3576 等高性能 NPU 芯片,通过降低模型

发表于 08-29 18:08

无法在NPU上推理OpenVINO™优化的 TinyLlama 模型怎么解决?

在 NPU 上推断 OpenVINO™优化的 TinyLlama 模型。

遇到的错误:

get_shape was called on a descriptor::Tensor with dynamic shape

发表于 07-11 06:58

鸿蒙5开发宝藏案例分享---性能优化案例解析

鸿蒙性能优化宝藏指南:实战工具与代码案例解析

大家好呀!今天在翻鸿蒙开发者文档时,意外挖到一个 性能优化宝藏库 ——原来官方早就提供了超多实用工具和案例,但很多小伙伴可能没发现!这篇就

发表于 06-12 16:36

芯原超低能耗NPU可为移动端大语言模型推理提供超40 TOPS算力

AI需求而设计,不仅能够为AI PC等终端设备提供强劲算力支持,而且能够应对智慧手机等移动终端对低能耗更为严苛的挑战。 芯原的超低能耗NPU IP具备高度可配置、可扩展的架构,支持混合精度

HarmonyOS优化应用内存占用问题性能优化一

应用开发过程中注重内存管理,积极采取措施来减少内存占用,以优化应用程序的性能和用户体验。

HarmonyOS提供了一些内存管理的工具和接口,帮助开发者有效地管理内存资源:

onMemoryLevel接口

发表于 05-21 11:27

Arm CPU适配通义千问Qwen3系列模型

与阿里巴巴开源的轻量级深度学习框架 MNN 已深度集成。得益于此,Qwen3-0.6B、Qwen3-1.7B 及 Qwen3-4B 三款模型能够在搭载 Arm 架构 CPU 的移动设备上无缝运行,为用户提供卓越的端侧 AI 推理能力。

是德N9310A低成本射频源的调制精度优化方法

一、引言 是德N9310A作为一款兼具性价比与高性能的射频信号发生器,广泛应用于通信设备测试、电子对抗及科研等领域。其支持AM、FM、PM及IQ调制等多种模式,但在实际使用中,受限于成本因素,调制

阿里MNN支持华为NPU,优化MNN的性能和精度问题

阿里MNN支持华为NPU,优化MNN的性能和精度问题

评论