在过去的五年中,人工智能(AI)的使用激增,引发了有关该主题的几次新会议。但是,最重要的活动已成为Nvidia的GPU技术会议(GTC),最近的一次活动是在上周在加利福尼亚州圣何塞举行的。出席人数高达8,500人,比GTC17多出2,000人。(注:Nvidia是ZK Research的客户。)

虽然该展会由Nvidia主持,但它已成为行业展会,正在讨论和解决扩展AI方面的一些最大挑战。

按照GTC的惯例,Nvidia宣布了许多公告。以下是我认为最引人注意的内容,以及CIO应该关心的原因。

GPU计算面临的挑战之一是将足够的数据推入GPU中,以使其保持繁忙,尤其是对于多GPU系统而言。通常,在高数据负载下,PCI总线速度太慢,因此Nvidia开发了一种专有互连,将两个GPU(称为NVLink)桥接在一起,从而绕过了PCI总线。在GTC18上,Nvidia首次推出了一项名为NVSwitch的创新技术,该技术可使16个GPU通过高速结构连接在一起。

在其主题演讲中,首席执行官黄仁勋展示了16种GPU系统之一,并开玩笑说它是世界上最大的GPU,因为它有效地创建了一个大型GPU。网络专业人员会熟悉该架构,因为这种纵横制交换矩阵被用作当今大多数高速交换机的互连,因此被称为NVSwtich。

CIO为什么要关心:企业必须分析的数据量只会增加。实际上,使用通用对抗网络(GAN)可使机器生成自己的综合数据。NVSwitch帮助组织将更多的GPU互连在一起,以便数据科学家可以处理更大,更复杂的数据集。

大约一年前,Nvidia推出了Tesla V100 GPU,它配备了16GB的HBM2内存。该公司在GTC18大会上宣布将立即将总内存增加一倍至32 GB。升级意味着Nvidia现在与其主要竞争对手AMD处于内存平价。V100的性能始终为同类AMD产品吹牛。但是,总内存是它滞后的地方-现在它已经缩小了差距。

-

NVIDIA

+关注

关注

14文章

5087浏览量

103936 -

gpu

+关注

关注

28文章

4798浏览量

129509 -

人工智能

+关注

关注

1797文章

47890浏览量

240898

发布评论请先 登录

相关推荐

英伟达Blackwell可支持10万亿参数模型AI训练,实时大语言模型推理

英伟达GPU新品规划与HBM市场展望

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

英伟达、AMD、英特尔GPU产品及优势汇总

印度政府考虑购买英伟达GPU以发展人工智能生态系统

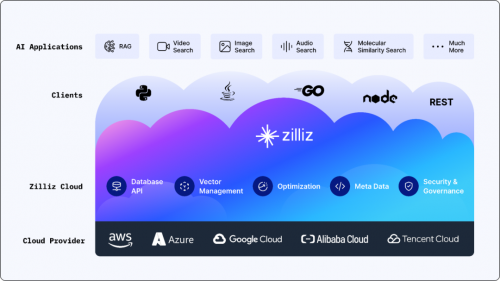

搭载英伟达GPU,全球领先的向量数据库公司Zilliz发布Milvus2.4向量数据库

英伟达GPU技术大会上最有趣的事情

英伟达GPU技术大会上最有趣的事情

评论