开宗明义,三句话认识深度学习。

深度学习是一种机器学习

深度学习首先是一种机器学习。深度学习的基础,叫做神经网络,这本身就是一种机器学习算法。近年来,随着深度学习的火热和深入人心,人们渐渐将这一概念独立出来,由此有了深度学习和传统机器学习的区分。

如今神经网络快速发展,传统的机器学习何去何从?

其实,都只是算法,一种解决问题的办法,而已。

关于算法,关于机器学习,我们引用卡内基梅隆大学(Carnegie Mellon University)Tom Michael Mitchell教授在其1997年出版的书籍Machine Learning中的定义, —— “如果一个程序可以在任务T上,随着经验E的增加,效果P也可以随之增加,则称这个程序可以从经验中学习”[1]

怎么理解这句话呢?以推荐系统为例,我们使用某一类机器学习算法(“一个程序”),根据用户的过往记录做推荐(“任务T”),那么随着用户的过往记录不断积累(“经验E”),能够做的推荐就更准确(“效果P”)。

简而言之,机器的“学习”,是通过以往的经验,即数据,学习数据内部的逻辑,并将学到的逻辑应用在新数据上,进行预测。

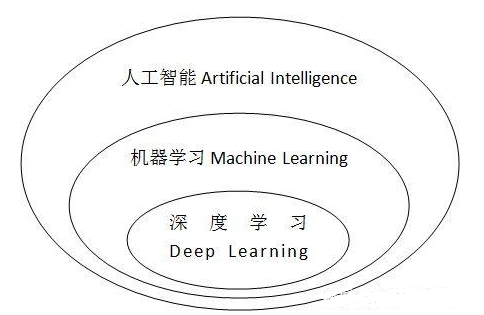

深度学习是一种机器学习,要真的追究起来,人工智能、机器学习和深度学习,三者大概是下面这个关系。

人工智能、机器学习和深度学习三者的关系

深度学习是一个数学问题

机器学习和数学,是深度学习的一体两面。

机器学习是深度学习的方法论,数学是其背后的理论支撑。

其实每一种算法,究其根本,都是一种数学表达。无论是机器学习,还是深度学习,都是试图找到一个函数,这个函数可以简单,可以复杂,函数的表达并不重要,只是一个工具,重要的是这个函数能够尽可能准确的拟合出输入数据和输出结果间的关系。就像我们在各个任务中做的那样,比如语音识别、图像识别、下围棋,人机问答系统:

机器学习在找输入和输出之间的关系

这就是机器学习要做到的事,找到一个数学表达,即上述例子中的函数f。

而深度学习的魅力在于,它的数学表达特别的强!

深度学习的强大是有数学原理支撑的,这个原理叫做“万能近似定理”(Universal approximation theorem)。这个定理的道理很简单 —— 神经网络可以拟合任何函数,不管这个函数的表达是多么的复杂。

因为这个定理,深度学习在拟合函数这一方面的能力十分强大、暴力和神秘。

但是,哪有免费的午餐,深度学习的强大也带来了对应的问题 —— 黑箱化

深度学习是一个黑箱

黑箱的意思是,深度学习的中间过程不可知,深度学习产生的结果不可控。

一方面,我们比较难知道网络具体在做些什么;另一方面,我们很难解释神经网络在解决问题的时候,为什么要这么做,为什么有效果。

在传统的机器学习中,算法的结构大多充满了逻辑,这种结构可以被人分析,最终抽象为某种流程图或者一个代数上的公式,最典型的比如决策树,具有非常高的可解释性。

一个决策树的例子

到了深度学习,这样子的直观就不见了。简单来说,深度学习的工作原理,是通过一层层神经网络,使得输入的信息在经过每一层时,都做一个数学拟合,这样每一层都提供了一个函数。因为深度学习有好多层,通过这每一层的函数的叠加,深度学习网络的输出就无限逼近目标输出了。这样一种“万能近似”,很多时候是输入和输出在数值上的一种耦合,而不是真的找到了一种代数上的表达式。当我们在说”拟合“、”函数“这一类词的时候,你或许认为我们会像写公式一样把输入和输出之间的关系列在黑板上。但事实并不是这样,深度学习拟合出来的函数,一般人还真写不出来……

所以,很多时候,你的深度学习网络能很好的完成你的任务,可是你并不知道网络学习到了什么,也不知道网络为什么做出了特定的选择。知其然而不知其所以然,这可以看作是深度学习的常态,也是深度学习工作中的一大挑战。

尽管如此,深度学习还是好用的……

谁用谁知道!

所以 ——

拥抱不确定性,爱上深度学习。

-

机器学习

+关注

关注

66文章

8419浏览量

132675 -

深度学习

+关注

关注

73文章

5503浏览量

121185

发布评论请先 登录

相关推荐

NPU在深度学习中的应用

开关电源布线 一句话:要运行最稳定、波形最漂亮、电磁兼容性最好

AI大模型与深度学习的关系

求助,关于AIC3254寄存器的问题求解

FPGA做深度学习能走多远?

简单认识深度神经网络

深度学习中的时间序列分类方法

一句话让你理解线程和进程

三句话让你认识深度学习

三句话让你认识深度学习

评论