这篇文章最初发表在加州大学伯克利分校的BAIR博客(https://bair.berkeley.edu/blog/)上。

看上面的图片。如果我让你给我带一条野餐毯到草地上,你能做到吗?当然了。那如果我让你带一辆装满食物的车来参加聚会,你会把车推到铺好的小路上还是推到草地上?当然是铺好的路啦。

虽然这些问题的答案似乎显而易见,但今天的移动机器人很可能会在这些任务上失败:他们会认为高高的草地就像水泥墙,不知道平坦的道路和崎岖的草地有什么区别。这是因为大多数移动机器人纯粹是从几何学的角度来思考:它们探测障碍物的位置,并围绕这些感知到的障碍物规划路径,以达到目标。这种纯粹的几何世界观不足以解决许多导航问题 -- 光是几何学是不够的。

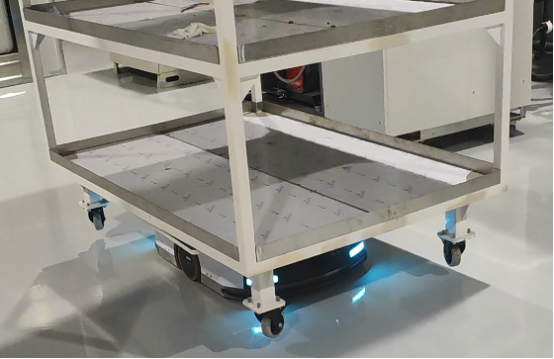

Photo: UC BerkeleyBADGR consists of a Clearpath Jackal mobile platform equipped with an NVIDIA Jetson TX2 computer, IMU, GPS, and wheel encoders. Forward-facing cameras, a 2D lidar, and a compass were added to the standard configuration.

我们能让机器人直接从图像中推理出导航信号吗?为了探索这个问题,我们开发了一种机器人,它可以通过自己在现实世界中的经验,自主地学习环境的物理属性,而无需任何模拟或人类的监督。我们称我们的机器人学习系统为BADGR:伯克利自主驾驶地面机器人(the Berkeley Autonomous Driving Ground Robot)。

BADGR通过以下方式工作:

1. 自主采集数据

2. 自动标注数据并进行自我监控

3. 基于图像的神经网络预测模型的训练

4. 利用预测模型对未来进行规划并执行将引导机器人完成所需导航任务的操作

数据收集

Image: UC BerkeleyBADGR autonomously collecting data in off-road (left) and urban (right) environments.

BADGR需要大量多样的数据才能成功地学习如何导航。机器人使用简单的时间相关随机行走控制器收集数据。当机器人收集数据时,如果遇到碰撞或卡住,它会执行一个简单的重置控制器,然后继续收集数据。

自监督数据标记

接下来,BADGR利用数据计算特定导航事件的标签,例如机器人的位置,以及机器人是否碰撞或在崎岖不平的地形上行驶,然后将这些事件标签添加回数据集中。这些事件通过让人编写一小段代码来标记,这些代码将原始传感器数据映射到相应的标签。例如,用于确定机器人是否在颠簸地形上的代码片段将查看IMU传感器,并在角速度幅值较大时将地形标记为颠簸。

我们将这种标记机制描述为自我监督形式,因为尽管一个人必须手动编写此代码段,但可以使用此代码段标记所有现有和将来的数据,而无需任何额外的人工操作。

神经网络预测模型

Image: UC BerkeleyThe neural network predictive model at the core of BADGR.

然后BADGR利用这些数据训练一个深层神经网络预测模型。该神经网络将当前摄像机图像和未来计划的动作序列作为输入,并输出对未来相关事件(如机器人是否会碰撞或在崎岖不平的地形上行驶)的预测。训练神经网络预测模型以尽可能准确地预测这些未来事件。

规划和导航

Image: UC BerkeleyBADGR predicting which actions lead to bumpy terrain (left) or collisions (right).

在部署BADGR时,用户首先定义一个奖励函数,该函数对他们希望机器人完成的特定任务进行编码。例如,奖励功能可以鼓励朝目标驾驶,同时阻止碰撞或在崎岖不平的地形上驾驶。然后,BADGR使用经过训练的预测模型、当前图像观察和奖励函数来计划使奖励最大化的一系列动作。机器人执行这个计划中的第一个动作,BADGR继续在计划和执行之间交替,直到任务完成。

在我们的实验中,我们研究了BADGR如何在加州大学伯克利分校(UC Berkeley)附近的一个大型场外设施中了解环境的物理属性。我们将该方法与使用激光雷达规划无碰撞路径的基于几何体的策略进行了比较。(请注意,BADGR仅使用车载摄像头。)

Image: UC BerkeleyBADGR successfully reaches the goal while avoiding collisions and bumpy terrain, while the geometry-based policy is unable to avoid bumpy terrain.

我们首先考虑的任务是,城市环境中,在避免碰撞和崎岖地形的同时,达到目标GPS位置。BADGR总是成功完成任务,且避免颠簸的地形。注意,我们从未告诉过机器人在道路上行驶;BADGR从车载摄像机图像中自动得知,在具体的道路上行驶比在草地上行驶更加平滑。

Image: UC BerkeleyBADGR successfully reaches the goal while avoiding collisions, while the geometry-based policy is unable to make progress because it falsely believes the grass is an untraversable obstacle.

我们还考虑了在避免碰撞和被困在越野环境中的同时达到目标GPS位置的任务。基于几何学的方法几乎从未发生崩溃或陷入草地,但有时会出现拒绝移动的情况 -- 因为它被草地包围后,它错误将草地地标记为不可规避的障碍。

BADGR几乎总是通过避免碰撞和卡住来达到目标,而不是错误地预测所有的草都是障碍。这是因为BADGR从经验中学到,大多数草实际上是可以穿越的。

Image: UC BerkeleyBADGR’s navigation capability improves as it gathers more data.

除了能够了解环境的物理属性之外,BADGR的一个关键方面是它能够在收集越来越多的数据时不断地自我监督和改进模型。为了证明这种能力,我们进行了一项对照研究,其中BADGR收集和训练来自一个区域的数据,移动到一个新的目标区域,在该区域导航失败,但在收集和训练来自该区域的额外数据后,最终在目标区域获得了成功。

这个实验不仅证明了BADGR在收集更多的数据时可以改进,而且当BADGR遇到一个新的环境时,以前收集的经验实际上可以帮助其加速学习。随着BADGR在越来越多的环境中自动收集数据,在每个新的环境中成功地学习导航所需要的时间也越来越少。

我们还评估了BADGR在从森林到城市建筑等新环境中的导航能力。这一结果表明,如果BADGR能够在足够大和多样的数据集上进行收集和训练,它可以推广到新的环境中使用。

BADGR背后的关键洞见是,通过直接从现实世界的经验中自主学习,BADGR可以学习导航功能,在收集更多数据时进行改进,并进行推广。尽管我们相信BADGR是朝着全自动、自我改进的导航系统迈出的有希望的一步,但仍然存在一些开放的问题:机器人如何在新环境中安全地收集数据,或如何在新数据流进入时适应,或如何应对非静态环境,如人类走动呢?

我们认为,解决这些和其他挑战对于使机器人学习平台能够在现实世界中学习和行动至关重要。

Gregory Kahn是加州大学伯克利分校BAIR(Berkeley AI Research)实验室的博士生,师从Sergey Levine教授和Pieter Abbeel教授。他的主要研究目标是开发能够让机器人在现实世界中操作的算法。他目前的研究是针对移动机器人的深度强化学习。

-

神经网络

+关注

关注

42文章

4772浏览量

100857 -

移动机器人

+关注

关注

2文章

763浏览量

33582 -

人工智能

+关注

关注

1792文章

47354浏览量

238832

原文标题:加州大学伯克利分校研发人工智能机器人BADGR 可自行规划和穿越无障碍路径

文章出处:【微信号:IEEE_China,微信公众号:IEEE电气电子工程师】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

人工智能机器人BADGR可自行规划和穿越无障碍路径

人工智能机器人BADGR可自行规划和穿越无障碍路径

评论