马萨诸塞州伍兹霍尔-图片只值一千字-但前提是要清楚其描绘的内容。在显微生活的图像或录像制作中也存在摩擦。尽管现代显微镜可以在几秒钟内从活组织或细胞中生成大量图像数据,但从这些数据中提取有意义的生物学信息却需要花费数小时甚至数周的艰苦分析。

为了缓解这一主要瓶颈,由MBL研究员Hari Shroff领导的团队设计了深度学习和其他计算方法,可将图像分析时间显着减少几个数量级-在某些情况下,与数据采集本身的速度相匹配。他们本周在《自然生物技术》中报告了他们的结果。

Shroff说:“这就像从水喉中喝水而无法消化您所喝的水一样。”常见的问题是成像数据过多,而后处理能力不足。团队的改进来自海洋生物实验室(MBL)的持续合作,它通过三种主要方式加快了图像分析的速度。

首先,显微镜下的成像数据通常会因模糊而损坏。为了减轻模糊,使用了迭代的“去卷积”过程。计算机在模糊图像和实际物体的估计之间来回移动,直到达到对真实物体的最佳估计的收敛为止。

通过修改经典的反卷积算法,Shroff及其合作者将反卷积加速了10倍以上。Shroff说,他们改进的算法可广泛应用于“几乎所有荧光显微镜”。“我们认为这是一次严格的胜利。我们已经发布了代码,其他组织已经在使用它。”

接下来,他们解决了3D配准的问题:对齐和融合从不同角度拍摄的物体的多个图像。Shroff说:“事实证明,注册大型数据集(如光片显微镜)要比对它们进行去卷积要花费更长的时间。”他们发现了几种加速3D注册的方法,包括将其移动到计算机的图形处理单元(GPU)。与使用计算机的中央处理器(CPU)相比,这使他们的处理速度提高了10到100倍以上。

Shroff说:“我们在配准和解卷积方面的改进意味着,对于适合图形卡的数据集,图像分析原则上可以跟上采集速度。”“对于更大的数据集,我们找到了一种有效地将它们分割成块,将每个块传递到GPU,进行配准和解卷积然后将这些块缝合在一起的方法。如果要对大块组织成像,这非常重要例如,从海洋动物身上获取的,或者如果您正在清理一个器官以使其透明,则可以将其放在显微镜上。这两种进展确实使某些形式的大型显微镜成为现实,并加速了发展。”

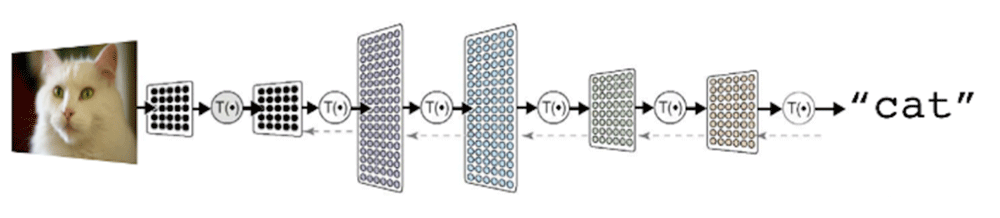

最后,该团队使用深度学习来加速“复杂的反卷积”-难以处理的数据集,其中模糊在图像的不同部分发生明显变化。他们培训了计算机,以识别严重模糊的数据(输入)与经过清理,反卷积的图像(输出)之间的关系。然后他们给它提供了前所未有的模糊数据。Shroff说:“它确实运作良好;训练有素的神经网络可以非常快速地产生反卷积结果。”“这就是我们在反卷积速度上获得了数千倍的改进的地方。”

Shroff说,尽管深度学习算法的效果出乎意料的出色,但“警告是它们很脆弱”。“意思是说,一旦训练了神经网络以识别一种图像类型,例如具有线粒体的细胞,它将很好地使这些图像解卷积。但是,如果您给它提供的图像有些不同,则说细胞的质膜,它会产生伪像。很容易愚弄神经网络。”研究的活跃领域是创建以更通用的方式工作的神经网络。

Shroff说:“深度学习增强了可能性。”“这是分析数据集的好工具,而这是其他方法很难做到的。”

-

图像分析

+关注

关注

0文章

82浏览量

19253 -

深度学习

+关注

关注

73文章

5607浏览量

124618

发布评论请先 登录

开发一个基于运行 Yocto 的 i.MX6ULL 的定制板,如何减少启动时间?

【智能检测】基于AI深度学习与飞拍技术的影像测量系统:实现高效精准的全自动光学检测与智能制造数据闭环

探索ADSD3500:飞行时间深度图像信号处理器的卓越性能

机器学习和深度学习中需避免的 7 个常见错误与局限性

穿孔机顶头检测仪 机器视觉深度学习

如何深度学习机器视觉的应用场景

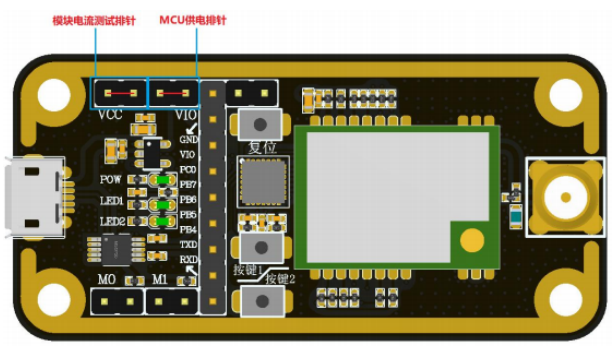

E22-400MBL-01无线模块评估套件使用教程

MATLAB 助力香港中文大学解决生物医学图像处理挑战

深度学习对工业物联网有哪些帮助

当深度学习遇上嵌入式资源困境,特征空间如何破局?

大模型推理显存和计算量估计方法研究

存储示波器的存储深度对信号分析有什么影响?

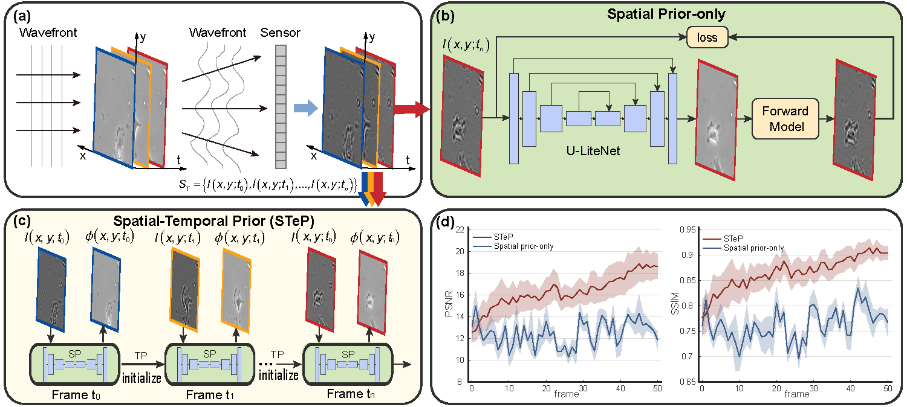

上海光机所在基于深度时空先验的动态定量相位成像研究方面取得进展

MBL研究团队采用深度学习大大减少图像分析时间

MBL研究团队采用深度学习大大减少图像分析时间

评论