迄今为止,深度神经网络(DNN)已被证明对于包括图像和音频分类在内的广泛应用非常有前途。但是,它们的性能在很大程度上取决于用于训练它们的数据量,而且大型数据集并不总是很容易获得。

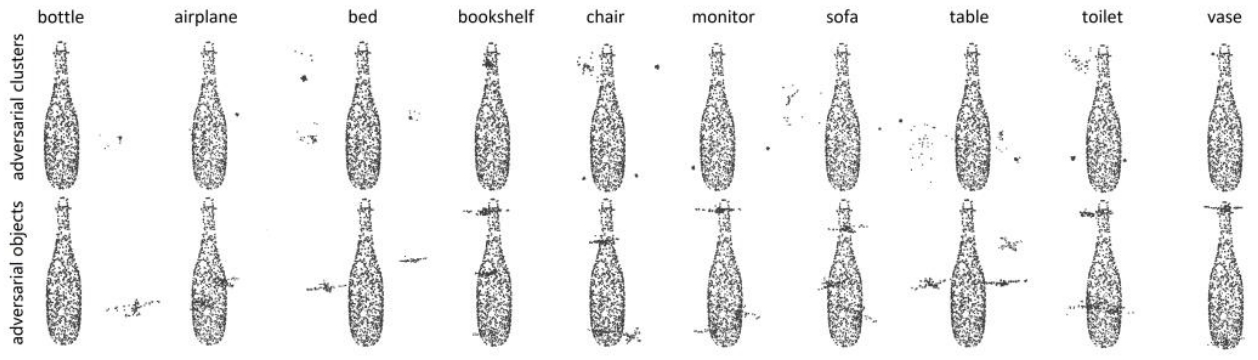

如果DNN没有经过充分的训练,他们将更容易对数据进行错误分类。这使他们容易受到特定类型的网络攻击,称为对抗攻击。在对抗性攻击中,攻击者创建旨在欺骗DNN(即对抗性数据)的真实数据的副本,将其欺骗为错误分类的数据,从而损害其功能。

近年来,计算机科学家和开发人员提出了各种工具,可以通过检测原始数据和对抗数据之间的差异来保护深度神经体系结构免受这些攻击。但是,到目前为止,这些解决方案均未证明具有普遍效力。

武汉大学和武汉软件工程职业学院的研究人员最近推出了一个平台,该平台可以通过计算复制图像的容易程度来评估其抵制DNN的能力,从而评估图像对对抗攻击的鲁棒性。这个名为FoolChecker的新平台在Elsevier的Neurocomputing期刊上发表的一篇论文中进行了介绍。

研究人员在论文中写道:“我们的论文提出了一个称为FoolChecker的平台,用于从图像本身而非DNN模型的角度评估图像对抗攻击的鲁棒性。”“我们定义了原始示例与对抗示例之间的最小感知距离,以量化对抗对抗攻击的鲁棒性。”

FoolChecker是量化图像抵御攻击性鲁棒性的首批方法之一。在仿真中,这项技术取得了显著成果,在相对较短的时间内完成了计算。

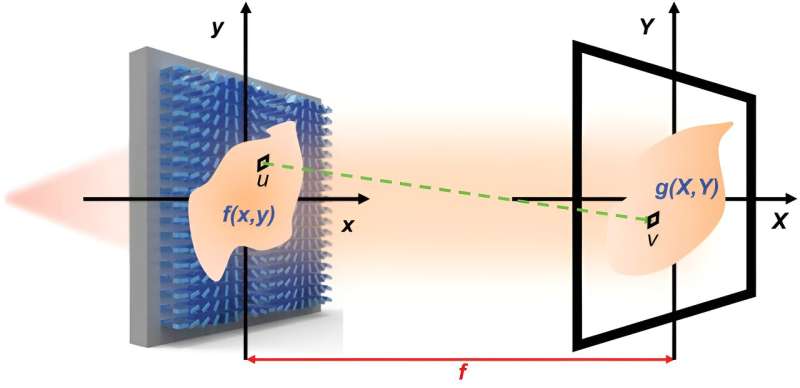

在开发平台时,研究人员比较了许多指标以量化原始图像与对抗图像之间的距离。证明最有效的度量标准是原始样本与对抗样本之间的摄动灵敏度距离(PSD)。

FoolChecker的工作原理是计算成功欺骗DNN分类器所需的最小PSD。尽管需要手动计算,但研究人员开发了一种方法,该方法结合了称为差分进化(DE)和贪婪算法的技术,贪婪算法是一种直观的体系结构,通常用于解决优化问题。

研究人员写道:“首先,将差分演化应用于产生具有高扰动优先级的候选扰动单位。”“然后,贪心算法尝试将当前具有最高扰动优先级的像素添加到扰动单元中,直到欺骗DNN模型为止。最后,计算出扰动单元的感知距离,作为评估图像抵抗对抗攻击的鲁棒性的指标。 ”

研究人员通过一系列测试对FoolChecker进行了评估,发现它可以有效地计算某些图像在被多个DNN处理后对对抗攻击的鲁棒性。他们的研究提供了证据,表明DNN模型的对抗性脆弱性也可能是由于外部因素(即,与模型性能无关)造成的,例如它正在处理的图像的特征。

换句话说,该团队发现,图像本身在易于修改的程度方面可能会有所不同,从而会诱使DNN误分类数据。将来,他们开发的平台可用于评估馈送到DNN的数据的鲁棒性,这可能会阻止攻击者创建对抗性数据并因此而发动攻击。

-

神经网络

+关注

关注

42文章

4762浏览量

100539 -

计算机科学

+关注

关注

1文章

142浏览量

11357 -

数据集

+关注

关注

4文章

1205浏览量

24644

发布评论请先 登录

相关推荐

cdn为什么能防止ddos攻击呢?

生成对抗网络(GANs)的原理与应用案例

DDoS有哪些攻击手段?

电子对抗系统有哪些

逆变器绝缘抵抗和残余电流不同,发生较大故障

抵御量子计算机攻击!中国首个!

深度学习生成对抗网络(GAN)全解析

随机通信下多智能体系统的干扰攻击影响研究

一个平台来检查图像抵抗对抗攻击的能力

一个平台来检查图像抵抗对抗攻击的能力

评论