一家英国芯片初创公司推出了它声称是世界上最复杂的AI芯片Colossus MK2或GC200 IPU(智能处理单元)。Graphcore将其MK2与Nvidia的适用于AI应用的Ampere A100 GPU进行对比。

MK2及其前身MK1专为处理非常大型的机器学习模型而设计。MK2处理器具有1,472个独立的处理器核心和8,832个独立的并行线程,所有这些均由900MB的处理器内RAM支持。

Graphcore表示,MK2的BERT-Large训练性能比MK1改进了9.3倍,BERT-3Layer推理性能提高了8.5倍,EfficientNet-B3培训的性能提高了7.4倍。

BERT,即来自变压器的双向编码器表示形式,是Google为基于自然语言的搜索而开发的自然语言处理预训练技术。

Graphcore不仅会提供芯片。对于一家相对较新的创业公司(成立于2016年),Graphcore围绕其芯片构建了卓越的生态系统。大多数芯片初创公司只关注其硅片,但是Graphcore提供了更多的东西。

它通过其新的IPU机器M2000出售GC200,该IPU机器M2000在1U盒中包含四个GC200芯片,并提供1 petaflop的总计算能力。Graphcore指出,您可以从直接连接到现有x86服务器的单个IPU-Machine M2000盒子开始,或者添加总共八个连接到一台服务器的IPU-Machine M2000。对于大型系统,它提供IPU-POD64,其中包括内置在标准19英寸机架中的16台IPU-Machine M2000。

通过Graphcore的全新IPU-Fabric技术可以大规模连接IPU-Machine M2000和IPU-POD,该技术是专为机器智能通信而设计的,并提供了专用的低延迟结构,可以在整个数据中心连接IPU。

Graphcore的Virtual-IPU软件与工作量管理和编排软件集成在一起,可为许多不同的用户提供培训和推理服务,并且它允许对可用资源进行调整,并根据工作进行重新配置。

这家初创公司表示,其新硬件完全是即插即用的,客户将能够将多达64,000个IPU连接在一起,总共拥有16 exaFLOP的计算能力。

这是一个很大的要求。英特尔,ARM,AMD,富士通和Nvidia仍在朝着exaflop的目标迈进,而Graphcore声称是后者的16倍。

Graphcore的另一个关键要素是其Poplar软件堆栈,该堆栈由IPU从头开始设计,并与标准机器学习框架完全集成,因此开发人员可以轻松移植现有模型,并在熟悉的环境中快速启动并运行。对于希望完全控制以利用IPU发挥最大性能的开发人员,Poplar支持使用Python和C ++直接进行IPU编程。

Graphcore有一些重要的MK2系统早期采用者,包括牛津大学,美国能源部的劳伦斯·伯克利国家实验室和JP Morgan,后者致力于自然语言处理和语音识别。

IPU-Machine M2000和IPU-POD64系统现已开始预订,并于2020年第四季度开始批量生产。早期访问客户可以通过Graphcore的云合作伙伴Cirrascale在云中评估IPU-POD系统。它计划在未来几个月内宣布OEM和渠道合作伙伴。

-

处理器

+关注

关注

68文章

19349浏览量

230377 -

芯片

+关注

关注

456文章

50968浏览量

425040 -

机器学习

+关注

关注

66文章

8428浏览量

132820

发布评论请先 登录

相关推荐

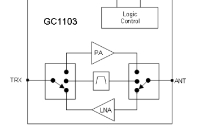

transformer专用ASIC芯片Sohu说明

NVIDIA Colossus超级计算机集群突破10万颗Hopper GPU

NVIDIA 以太网加速 xAI 构建的全球最大 AI 超级计算机

马斯克官宣超级AI训练集群Colossus上线

格科微量产第二代单芯片3200万像素图像传感器GC32E2,搭载DAG升级HDR影像体验

格科微量产第二代单芯片3200万像素图像传感器GC32E2

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

苹果云服务器处理AI复杂任务,低端芯片负责简单任务

risc-v多核芯片在AI方面的应用

世界上最复杂的AI芯片Colossus MK2或GC200 IPU?

世界上最复杂的AI芯片Colossus MK2或GC200 IPU?

评论