2020年7月30日,MLPerf组织发布第三个版本MLPerf Trainingv0.7基准测试(Benchmark)结果。结果显示,英伟达基于今年5月最新发布的Ampere架构A100 TensorCore GPU,和HDR InfiniBand实现多个DGXA100系统互联的庞大集群——DGX SuperPOD系统在性能上开创了八个全新里程碑,共打破16项纪录。

MLPerf是成立于2018年5月的行业基准测试组织,致力于机器学习硬件、软件和服务的训练和推理性能测试,囊括行业中几乎所有知名企业和机构,比如Intel、NVIDIA、Google、微软、阿里巴巴等。

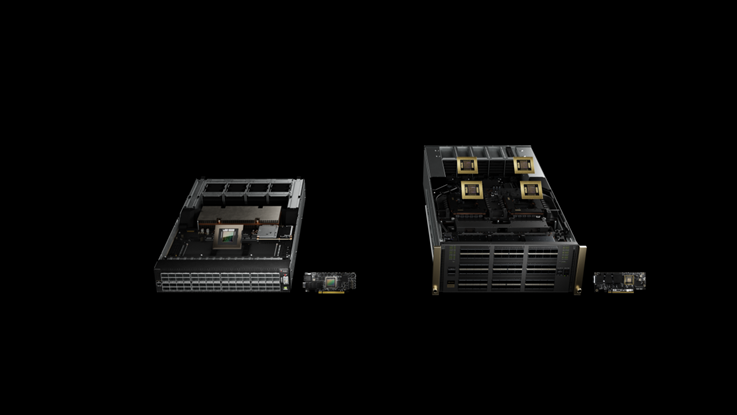

DGX SuperPOD系统公布于去年6月17号。最初由96台NVIDIA DGX-2H超级计算机和Mellanox互连技术在短短三周内建成,提供9.4千兆次的处理能力,用于该公司在无人驾驶车辆部署计划中的需求。

而此次创造纪录的NVIDIA DGX SuperPOD系统主要基于Ampere架构以及Volta架构,并且搭载了今年5月份发布的Ampere架构GPU A100。

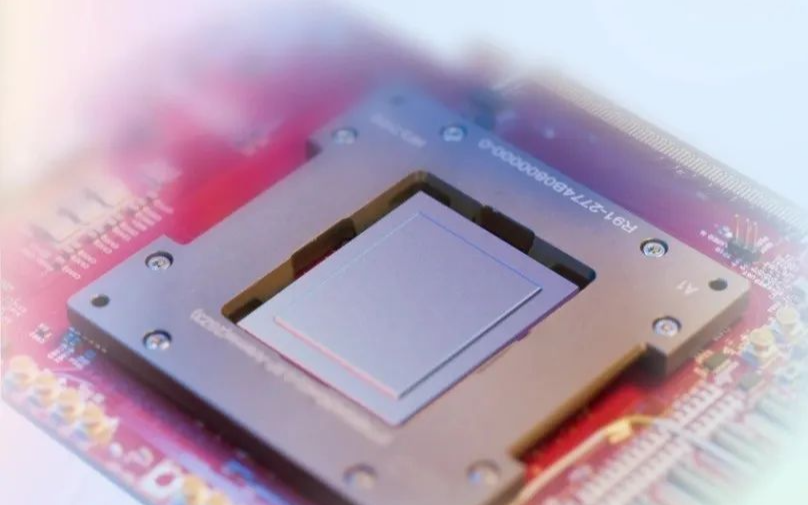

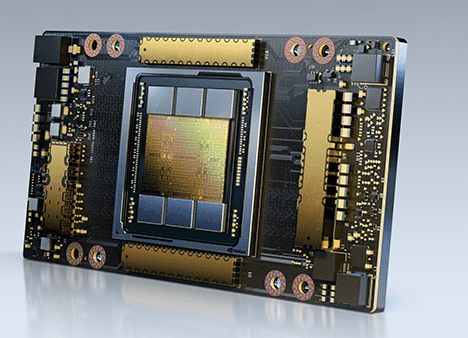

黄仁勋在GTC 2020大会上说道,A100是迄今为止人类制造出的最大7纳米制程芯片。A100采用目前最先进的台积电(TSMC)7纳米工艺,拥有540亿个晶体管,它是一块3D堆叠芯片,面积高达826mm^2,GPU的最大功率达到了400W。

这块GPU上搭载了容量40G的三星HBM2显存(比DDR5速度还快得多,就是很贵),第三代TensorCore。同时它的并联效率也有了巨大提升,其采用带宽600GB/s的新版NVLink,几乎达到了10倍PCIE互联速度。

随着安培架构出现的三代TensorCore对稀疏张量运算进行了特别加速:执行速度提高了一倍,也支持TF32、FP16、BFLOAT16、INT8和INT4等精度的加速——系统会自动将数据转为TF32格式加速运算,现在你无需修改任何代码量化了,直接自动训练即可。

A100也针对云服务的虚拟化进行了升级,因为全新的multi-instanceGPU机制,在模拟实例时,每块GPU的吞吐量增加了7倍。

最终在跑AI模型时,如果用PyTorch框架,相比上一代V100芯片,A100在BERT模型的训练上性能提升6倍,BERT推断时性能提升7倍。

电子发烧友综合报道,参考自镁客网、机器之心,转载请注明来源和出处。

-

NVIDIA

+关注

关注

14文章

5109浏览量

104527 -

gpu

+关注

关注

28文章

4832浏览量

129802

发布评论请先 登录

相关推荐

借助NVIDIA GPU提升鲁班系统CAE软件计算效率

《算力芯片 高性能 CPUGPUNPU 微架构分析》第3篇阅读心得:GPU革命:从图形引擎到AI加速器的蜕变

NPU技术如何提升AI性能

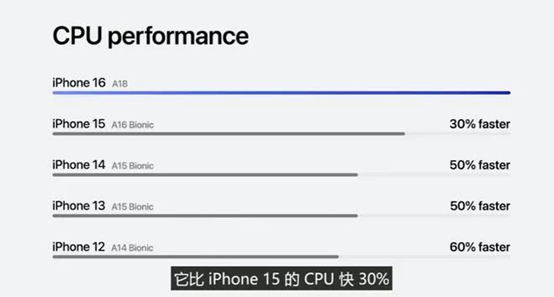

苹果 A18 芯片发布:CPU 提升 30%、GPU 提升 40%

名单公布!【书籍评测活动NO.43】 算力芯片 | 高性能 CPU/GPU/NPU 微架构分析

只能跑Transformer的AI芯片,却号称全球最快?

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

龙芯:自主研发CPU提升性能,单核通用性能提高20倍

利用NVIDIA组件提升GPU推理的吞吐

Meta第二代自研AI芯片出世,性能提升三倍以上

英伟达发布性能大幅提升的新款B200 AI GPU

英伟达发布超强AI加速卡,性能大幅提升,可支持1.8万亿参数模的训练

NVIDIA 发布全新交换机,全面优化万亿参数级 GPU 计算和 AI 基础设施

性能提升20倍!NVIDIA A100 GPU打破16项AI芯片性能记录

性能提升20倍!NVIDIA A100 GPU打破16项AI芯片性能记录

评论