实践证明,将神经形态技术从实验室应用于实践的过程很缓慢。本周,新加坡国立大学的研究人员向前推进了一步,展示了一种事件驱动的视觉触觉感知系统,该系统使用英特尔的Loihi芯片控制结合了触觉感知和视觉的机械臂。值得注意的是,他们还在GPU系统上运行了该练习,并报告了基于Loihi的系统性能稍好,功耗却低得多。

国大研究人员今天在本周举行的虚拟机器人科学与系统会议上介绍了他们的研究结果。预期将触觉感测(抓地力)与视觉(位置)结合起来,可以显着提高机械手的精确度和处理物体时的抓地力。神经形态技术的使用也有望降低机器人技术所需的功耗,这是神经形态技术的主要目标。

“我们对这些结果感到兴奋。他们表明,神经形态系统是组合多个传感器以改善机器人感知力的有希望的难题。这是朝着建设能效高,值得信赖的机器人迈出的一步,该机器人可以在意外情况下快速,适当地做出响应。”国大教授和作者哈罗德·索(Harold Soh)在一篇 描述工作的论文(事件驱动的视觉触觉传感和机器人学习)中说道 。

长期以来,英特尔一直处于将神经形态技术商业化的最前沿,其Loihi (芯片)/ Pohoiki(系统)是最发达的平台之一。神经形态系统模仿自然系统(例如大脑),因为它们使用尖峰神经网络(SNN)来处理信息,而不是机器/深度学习中更常用的人工神经网络(ANN)。

英特尔神经形态计算实验室主任Mike Davies表示:“新加坡国立大学的这项研究使人对机器人技术的未来有了一个令人信服的瞥见,在机器人技术中,事件是通过事件驱动的方式结合多种方式进行感知和处理的。这项工作增加了越来越多的结果,表明一旦在基于事件的范式中重新设计了整个系统,包括传感器,数据格式,算法和硬件体系结构,神经形态计算可以显着提高延迟和功耗。” 英特尔还公布了这项工作的情况。

国大论文的摘录很好地描述了挑战和贡献:

“许多日常任务需要多种感觉方式才能成功执行。例如,考虑从冰箱中取出一箱豆浆,人们可以通过视觉来确定该纸箱的位置,并可以通过简单的掌握推断出该纸箱中包含多少液体。然后,他们可以使用视觉和触觉来提起物体而不会使其滑落。这些动作(和推论)是使用高效节能的神经底物来进行的,与当前人工系统中使用的多模式深度神经网络相比,人脑所需的能量要少得多。

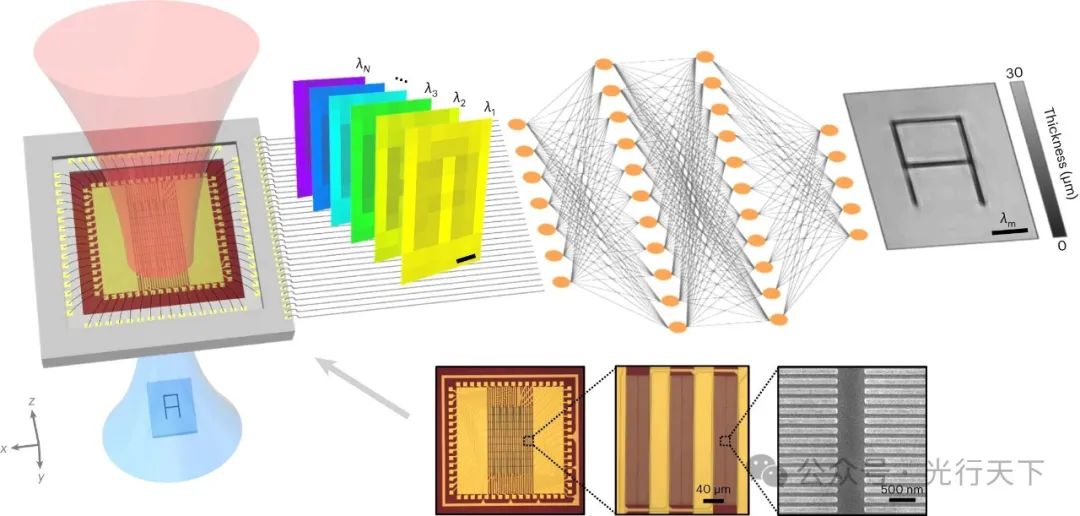

“在这项工作中,我们采取了关键步骤,以实现对机器人系统的有效视觉触觉感知。我们从异步和事件驱动的生物系统中获得启发。与耗费大量资源的深度学习方法相反,事件驱动的感知形成了一种替代方法,该方法可保证高能效和低延迟-这些功能是实时移动机器人的理想选择。但是,相对于标准的同步感知方法,事件驱动的系统仍未开发。”

长期以来,多模式传感的价值已被公认为是推进机器人技术的重要组成部分。但是,使用尖峰神经网络的局限性阻碍了在实时感测功能中使用神经形态芯片。

“神经形态学习,特别是尖峰神经网络(SNN),为学习事件数据提供了一种竞争性方法。类似于基于事件的传感器,SNN直接与离散的尖峰一起工作,因此具有相似的特性,即低延迟,高时间分辨率和低功耗。从历史上看,SNN由于缺乏良好的培训程序而受到阻碍。由于尖峰不可微,因此无法使用基于梯度的方法(例如反向传播)。有效的SNN培训的最新发展以及神经形态硬件(例如,IBM TrueNorth和Intel Loihi)的新生出现,引起了人们对包括机器人技术在内的各种应用的神经形态学习的兴趣。SNN尚未在伪事件图像数据集上始终胜过其深层ANN表亲,

另一个障碍是仅仅开发足够的触觉传感设备。“尽管触觉传感器有许多应用(例如,微创手术和智能假体),但触觉传感技术仍落后于视觉。特别地,当前的触觉传感器仍然难以缩放并与机器人平台集成。原因有两个:首先,许多触觉传感器通过时分多址(TDMA)进行接口连接,在该接口中,周期性地和顺序地对各个分类单元进行采样。随着传感器中紫杉树数量的增加,TDMA的串行读取本质会固有地导致读取延迟的增加。其次,高空间定位精度通常是通过在传感器中添加更多的出租车来实现的。这总是导致更多的接线,

研究人员开发了自己的新型“神经启发式”触觉传感器(NeuTouch):“ NeuTouch的结构类似于人的指尖:它包含“皮肤”和“骨骼”,并且物理尺寸为37×21 ×13毫米 这种设计有助于与拟人化末端执行器(用于假肢或类人机器人)和标准的多指夹持器集成。在我们的实验中,我们将NeuTouch与Robotiq 2F-140抓手配合使用。研究人员写道:“我们的重点是指尖设计,但是可以开发出适合不同应用的替代结构。”

NeuTouch的触觉感应是通过带有39个紫杉醇的电极层和基于石墨烯的压阻薄膜实现的。紫杉树的形状类似于人的指尖的快速适应(FA)机械感受器,并且沿径向排列,其密度从传感器的中心到外围,范围从高到低。

在典型的抓握过程中,NeuTouch(具有凸表面)往往会与紫杉醇密度最高的中央区域的物体进行初始接触。相应地,可以在触觉感测的较早阶段捕获丰富的触觉数据,这可能有助于加速推理(例如,用于早期分类)。基于石墨烯的压力传感器由于其高的杨氏模量而形成了有效的触觉传感器,有助于减少传感器的磁滞和响应时间。

研究人员说,主要目标是确定他们的多模式系统是否能够有效检测使用单个传感器难以分离的物体之间的差异,以及重量峰值计数损失是否会带来更好的早期分类性能。“请注意,我们的目标不是得出最佳的分类器;实际上,我们没有包括可能会改善结果的本体感受数据,也没有进行详尽(且计算量大)的最佳架构搜索。相反,我们试图了解在合理的设置中同时使用视觉和触觉峰值数据的潜在好处。”

他们使用了四个不同的容器:一个咖啡罐,百事可乐瓶,纸板豆浆纸箱和金属金枪鱼罐。该机器人被用来抓握和提起每个物体15次,并对物体进行分类并确定其重量。多模态SNN模型得分最高(81%),比任何单模测试高出约10%。

在将Loihi神经形态芯片与GPU(Nvidia GeForce RTX 2080)进行比较时,它们的整体性能大致相似,但是基于Loihi的系统使用的功率却少得多(见表)。最新的工作是向前迈出的重要一步。

最好阅读全文,但这里是对本文实验的概述。

机器人运动。机器人将抓握并提升每个对象类别十五次,每个类别产生15个样本。使用MoveIt笛卡尔姿势控制器计算运动各部分的轨迹。简要地说,将机器人抓具初始化为在每个物体的指定抓握点上方10厘米处。然后将末端执行器移至抓握位置(2秒),并使用Robotiq抓握控制器关闭抓具(4秒)。然后,per纸牙将物体提起5厘米(2秒),并保持0.5秒。

数据预处理。对于这两种方式,我们都从抓取,提升和保持阶段中选择了数据(对应于图4中的2.0s至8.5s窗口),并将bin持续时间设置为0.02s(325个bin),并且合并阈值Smin = 1我们使用分层的K折创建5个拆分;每个分组包含240个训练课程和60个具有相同班级分布的测试示例。

分类模型。我们将SNN与常规的深度学习进行了比较,特别是具有门控循环单元(GRU)的多层感知器(MLP)[54]和3D卷积神经网络(CNN-3D)[55]。我们使用(i)仅触觉数据,(ii)仅视觉数据和(iii)组合的视觉触觉数据来训练每个模型。注意,组合数据上的SNN模型对应于VT-SNN。在单一模式上训练时,我们视情况使用视觉或触觉SNN。我们使用PyTorch实施了所有模型。

-

芯片

+关注

关注

455文章

50718浏览量

423164 -

机器人

+关注

关注

211文章

28381浏览量

206919 -

神经网络

+关注

关注

42文章

4771浏览量

100719

发布评论请先 登录

相关推荐

【「具身智能机器人系统」阅读体验】+初品的体验

研究人员利用激光束开创量子计算新局面

【书籍评测活动NO.51】具身智能机器人系统 | 了解AI的下一个浪潮!

研究人员提出一种电磁微镜驱动系统

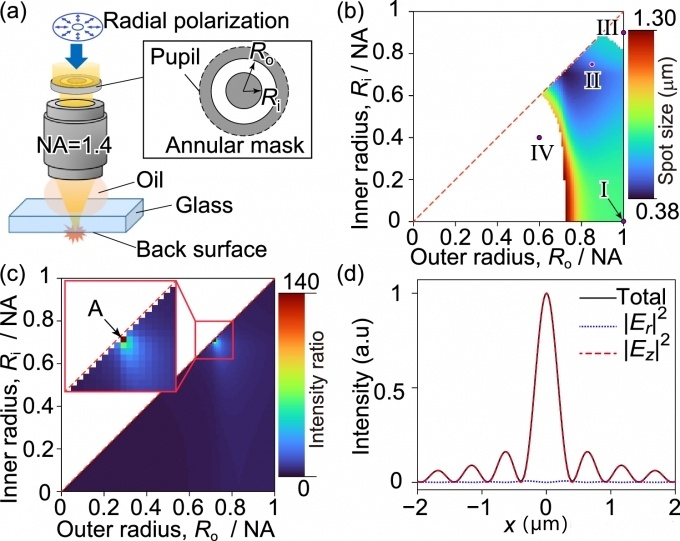

研究人员利用人工智能提升超透镜相机的图像质量

一种可实现稳定压力传感的新型可拉伸电子皮肤

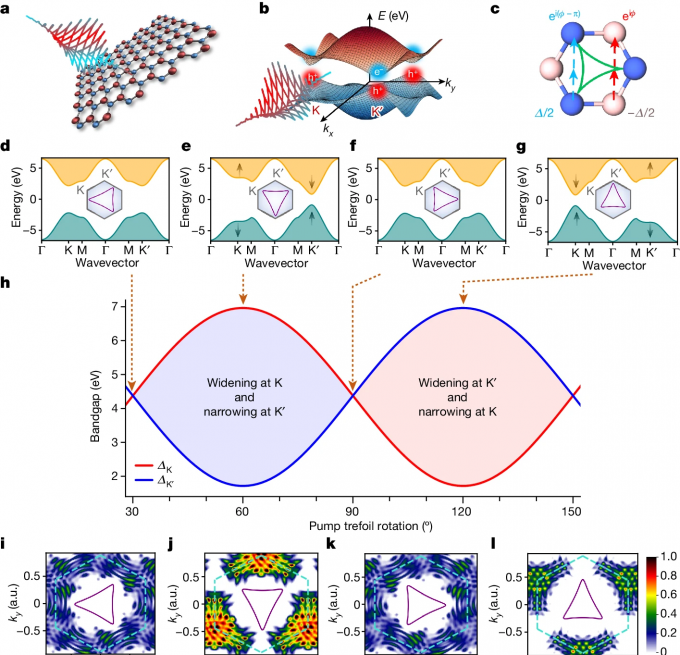

研究人员利用定制光控制二维材料的量子特性

研究人员发现提高激光加工分辨率的新方法

基于视觉的微型触觉传感器DIGIT Pinki助力医疗行业发展

一种基于单像素光电探测器的高光谱视频成像系统设计

视觉驱动超构表面在感知增强中的应用

一种基于摩擦电传感器并集成量子棒增强功能的新型触觉感知系统

研究人员开发出一种新型太赫兹成像系统

研究人员展示了一种事件驱动的视觉触觉感知系统

研究人员展示了一种事件驱动的视觉触觉感知系统

评论