位置、位置、位置,这并不只是房地产界的核心词。为了满足人工智能(AI)和机器学习应用的需求,这个词被越来越多地应用于数据存储,如数据存储的位置以及存放数据的存储器。

但解决这种位置的挑战不只是存储器供应商应做的工作,与AI相关的供应商也扮演着重要角色。尽管存储距离计算越来越近,但解决方案的很大一部分在于存储互连。Rambus研究员Steve Woo最近在AI硬件峰会上主持了一次在线圆桌论坛,讨论了存储器互连的挑战和解决方案,他说:“我们都在为AI的不同方面而工作。”

Marvell的ASIC事业部CTO Igor Arsovski在17年前曾经做过SRAM设计工程师。他说,慕尼黑啤酒节(Oktoberfest)因为新冠肺炎疫情取消了,而把存储互连比做啤酒很合适。参加啤酒节,可以很容易喝到啤酒。“而SRAM就好像近在身边的啤酒一样。它随手可得,不需要耗费多少能量,而且只要您需要,它就在那儿,就像拥有一个不错的高性能加速器。”但是,如果没有足够的存储空间,就需要走远一点,同时也需要花费更多能量来获取它,就好像必须走更远才能买到大桶啤酒一样。

Arsovski 说,对存储器而言,大桶啤酒就好像高带宽存储器(HBM),它正越来越多地被AI所采用。“访问这种存储器需要花费约60倍的能量。那里容量虽然大得多,但访问它的带宽却很少。”将啤酒类比扩展到LPDDR之类的技术,这种技术比SRAM更先进。他说:“LPDDR功耗明显更高,但容量更大。这就像沿着那条路走到您最喜爱的酒吧,在那里有几桶啤酒等着您。”

Arsovski表示,下一代加速器的发展方向是将那些存储器放在加速器正上方,让存储离计算更近。MLCommons执行董事David Kanter补充说,这个啤酒类比概述了不同的封装途径以及在何处安放不同的硅片。MLCommons是一个提供机器学习标准和AI推理基准的组织,其成员涵盖学术界和工业界。他说道:“这使我们对不同的工作负载有非常全面的了解。MLCommons正在开始采取一些措施,其中重点之一就是建立咨询委员会,以吸收特定应用领域的一些资深专家。”

Kanter说,对存储器而言,整个系统环境至关重要。“您必须考虑系统要实现什么,这将决定要考虑的问题。”他说,当涉及到存储器的位置和连接时,芯片、封装和电路板都是必须考虑的要素。“在阵列结构、单元类型以及距离方面,有很多地方可以优化。”

Kanter说,明白哪里需要带宽以及非易失性也是关键的考量因素。“希望这将引导做出正确的选择。”

对于那些传统上并不属于存储系统构建流程的公司而言,这些考量因素至关重要。Google软件工程师Sameer Kumar花费大量时间在编译器和可扩展系统上,这些系统的网络和存储带宽对不同的机器学习模型非常重要,包括其大规模批量操作的能力。他说:“人工智能训练涉及许多存储方面的优化,”这是在编译器中获得极高效率的最关键步骤,它意味着存储也需要更加智能。

Woo认为,数据移动实际上已经开始主宰AI应用的某些阶段,所以存储互连变得越来越重要。“性能和能效成为日益重要的问题”,提高数据速率极具挑战性,因为所有人都希望将数据移动速度加倍,能效也加倍。“我们以前所依赖的许多技巧和技术都已不再适用,或者正在被慢慢淘汰。我们有极好的机会来思考新的体系架构,并在移动数据的方式上进行创新。”

Woo表示,创新不仅在存储器件本身上,而且还包括封装,以及堆叠等新技术。在创新的同时,还要确保数据的安全性,这是Rambus目前越来越关注的。

Rambus感受到业界对3D堆栈的极大兴趣,但如果带宽不随堆栈容量增加而相应增加的话,其可用性会受到限制。(图片来源:Rambus)

Arsovski表示,Marvell花费了大量时间为客户建立AI系统,为客户提供带宽相关信息,如每个芯片边缘有多少带宽可以用于数据移动,以及有多少带宽可以用于访问存储器。他说:“到目前为止,我们已经可以看到,客户需要更多的存储带宽和更多的I / O带宽。如果看看封装级别的互连,可以看到存在很大的不匹配。我们现在已经到达瓶颈,高端芯片-芯片连接的需求压力持续增大。”

Arsovski表示,从存储器的角度来看,对于那些无法在裸片上直接构建AI模型的设计师来说,其下一步考虑应该是HBM或GDDR。但是也有很多转而采用3D堆叠,以尝试获得更大的带宽,因为在芯片边缘移动数据的容量有限。“客户希望得到越来越多的I/O带宽,而我们在边缘数据移动上遇到了瓶颈。”

Kanter说,即使在机器学习的世界中,也存在着“很大的多样性”,这对生态系统既有制约,也有促进,记住这一点很重要。对于常规DRAM来说,随机查找庞大的数据结构不适合单个节点,这意味着如果您想将数据真正保存在存储器中,则需要构建一个非常大的系统集群。他说:“与传统的面向视觉的模型相比,其特征和属性完全不同。在存储方面要牢记这一多样性,这一点非常重要。”

Kanter说,当需要将大量存储和计算整合在一起时,就需要互连了。“要进行大规模训练,迫切需要既适合客户又适合要解决问题的互连方案。”他说,对于前沿应用来说,互连将特别重要。“如果您只想为一个小型网络训练一个GPU,那么关键因素可能就是存储带宽。”

Kumar说,更多的存储带宽可以实现不同种类的优化,但是如果模型特别受存储限制,就有必要引入更多的计算。“如果有更多的存储吞吐量可用,甚至有更多的互连吞吐量可用,将可能会使模型设计更加灵活,而且可以启用新功能,并一起构建各种类型的模型。”

Woo表示,Rambus感受到大家对3D堆栈兴趣浓厚,但随着堆栈越来越高,增加进出堆栈的带宽也变得越来越困难。“如果只是增加堆栈容量,但没有增加相应的带宽,那方案的实用性就成问题了。”

他说,关键点在于寻找合适的方案,既能保持填充频率,又能利用堆叠能效方面的优势,从而使带宽与容量和堆叠之间具有相对恒定的比率。

Kumar和Arsovski都认为需要一个平衡、可扩展的系统,这种系统具有精心设计的软件堆栈。 Arsovski说,“我们所说的是一种可以良好扩展的类脑结构。”它必须低功耗且具有大量连接,而现在,3D堆叠是我们能做到最接近的结构,但仍然存在功耗、封装和机械结构方面的挑战。 “我们需要研究出一个高度并行的系统,其每个层级的功耗都极低,而不必担心要为冷却耗费数千瓦的功率。”

他说,是时候开始寻找适合AI系统的下一个基本构建模块了。“一直以来,我们都采用晶体管作为基本单元,迄今为止,它们都发挥出色。我们通常会依赖我们所知道和喜爱的技术,并且希望它持续发展。但现在我们需要重头开始设计了。”

(参考原文:AI Drives Memory Interconnect Evolution)

编辑:hfy

-

存储器

+关注

关注

38文章

7484浏览量

163763 -

数据存储

+关注

关注

5文章

970浏览量

50894 -

AI

+关注

关注

87文章

30728浏览量

268886 -

深度学习

+关注

关注

73文章

5500浏览量

121111

发布评论请先 登录

相关推荐

AI驱动新型存储器技术,国内新兴存储企业进阶

大算力芯片面临的技术挑战和解决策略

内存储器分为随机存储器和什么

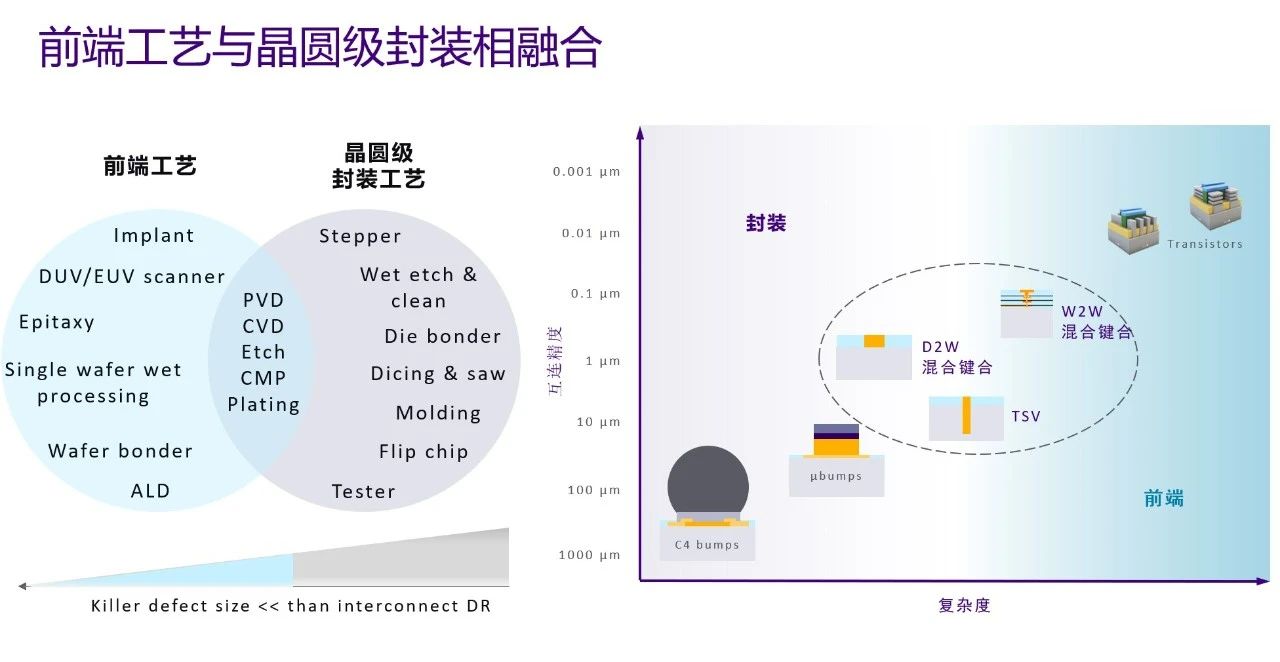

芯片和先进封装的制程挑战和解决方案

FPGA设计面临的挑战和解决方案

M31携手高塔半导体,成功研发65纳米低功耗存储器解决方案

ram存储器和rom存储器的区别是什么

SK海力士即将亮相FMS 2024,展示AI存储器技术新突破

内存储器与外存储器的主要区别

TPS65295完整 DDR4 存储器电源解决方案数据表

TPS65296-完整 LPDDR4/LPDDR4X存储器电源解决方案数据表

讨论AI与存储器互连的挑战和解决方案

讨论AI与存储器互连的挑战和解决方案

评论