面部识别系统存在问题的原因有很多,其中最重要的一点是它们往往对某些人口群体和性别表现出偏见。近日,麻省理工学院研究人员还进行了一项新研究,即研究AI对某些面部表情的偏见。研究人员称,表情对面部识别系统的影响“至少”与戴围巾、帽子、假发或眼镜有影响一样,而且面部识别系统在这方面是用高度偏差的数据集训练的。

这项研究增加了越来越多的证据表明面部识别容易受到有害的、普遍存在的偏见的影响。研究人员去年秋天发表的一篇论文显示,亚马逊、微软等公司的人工智能对顺性别男性和女性的准确率都在95%以上,但有38%的情况下,将跨性别男性误认为女性。“性别色彩项目”和美国国家标准与技术研究所(NIST)对主要供应商系统的独立基准测试表明,面部识别技术表现出种族和性别偏见,同时表明目前的面部识别程序可能非常不准确,有时错误分类率高达96%。

在他们的研究过程中,合作作者使用三种不同的领先的人脸识别模型进行了实验,这些模型在包括VGGFace2(一个包含超过9100人的300万张图片的数据库)和MS1M-ArcFace(拥有超过85000人的580万张图片)的开源数据库上进行了训练。他们将它们与四种语料库进行对比,具体规模如下:

● 这种复杂的面部表情包含了230个人在实验室控制的环境下拍摄的照片。

● 扩展的Cohn-Kanade(CK+),一个最广泛使用的用于训练和评估面部表情识别系统的数据库,包含123个人的593张照片序列

● CelebA是一个大规模的人脸属性数据集,包含10000位名人的20万张图片。

● 微软于2016年发布的一项面向公众的人脸识别基准和数据集MS-Celeb-1M,该数据集包含了100万名名人的近1000万张图片。

正如研究人员指出的那样,长期以来,学术界和企业一直从网络、电影和社交媒体等来源上搜集面部照片,以解决模型训练数据稀缺的问题。像大多数机器学习模型一样,面部识别模型需要大量的数据才能达到基本的精确度水平。但事实证明,这些数据来源通常是不平衡的,因为一些面部表情比其他表情更不常见。例如,人们倾向于在社交网络上分享更多快乐的脸,而不是悲伤的脸。

为了通过表情对四种基准语料库中的图像进行分类,研究人员使用了来自Affectiva的软件,该软件可以识别多达7种面部表情:6种基本情绪和中性表情。他们发现,在所有数据集中,“中性”图像的比例超过了60%,在微软MS-Celeb-1M名人图片库中达到83.7%。第二常见的面部表情是“快乐”,在所有的数据集中,大约90%的图像显示的是一个“中立”或“快乐”的人。至于其他5种面部表情,“惊讶”和“厌恶”的比例很少超过6%,而“悲伤”、“恐惧”和“愤怒”的比例非常低(通常低于1%)。结果也因性别而异。在VGGFace2中,“快乐”女性的数量几乎是“快乐”男性数量的两倍。

研究人员在一篇描述他们工作的论文中写道:“一方面,模型是使用高偏差的数据进行训练的,这些数据会导致异构性能。另一方面,人们只会对主流表情进行评估,隐藏了其对某些特定面部表情图像的真实表现。此外,性别偏见也很重要,因为它可能会导致男女双方的表现不同。”

接下来,研究人员进行了一项分析,以确定像CelebA这样的示例集中的面部表情偏差对面部识别系统预测的影响程度。在上述三种算法中,在显示“中性”或“高兴”表情的人脸上,性能更好,这也是训练数据库中最常见的表情。这项研究的结果表明,面部表情的差异并不能诱使系统误认为一个人是另一个人。然而,他们也暗示,面部表情偏差会导致系统的“真实”比较分数(衡量算法区分同一张脸图像的能力的分数)之间的差异高达40%。

研究人员只使用了某个软件来对情绪进行分类,这可能会在他们的实验中引入无意识的偏见,而且他们没有测试任何商业部署的系统,比如亚马逊的Rekognition、谷歌Cloud的Vision API或微软Azure的Face API。尽管如此,他们主张在未来的人脸识别数据库中减少面部表情偏差,并进一步开发适用于现有数据库和已经在问题数据集上训练过的模型的偏差减少方法。

研究人员表示:用于开发和评估人脸识别系统的人脸数据库缺乏面部表情的多样性,这一缺点之一是会导致系统存在安全漏洞,面部表情的微小变化很容易误导围绕这些有偏见的数据库开发的人脸识别系统。面部表情对人脸识别系统计算出的匹配分数有影响。这种影响可能会被利用为一个可能的漏洞,从而降低匹配的概率。

责任编辑:YYX

-

人脸识别

+关注

关注

76文章

4027浏览量

82667 -

面部识别

+关注

关注

1文章

375浏览量

26799

发布评论请先 登录

相关推荐

人脸识别技术的算法原理解析

云数据库是哪种数据库类型?

数据库数据恢复—通过拼接数据库碎片恢复SQLserver数据库

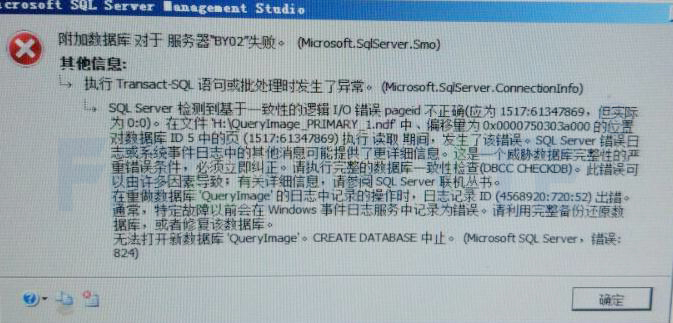

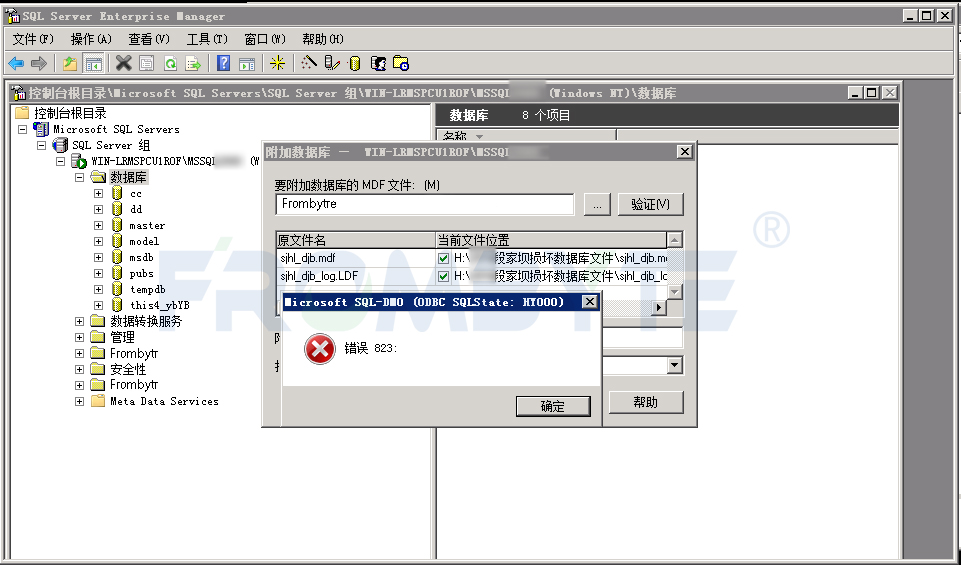

数据库数据恢复—SQL Server数据库出现823错误的数据恢复案例

隧道人脸识别门禁系统应用于隧道工程等场所的智能化安全管理系统

自研创新 数智未来 2024中国数据库技术大会盛大召开

基于FPGA的人脸识别技术

基于OpenCV的人脸识别系统设计

数据库数据恢复—SQL Server数据库所在分区空间不足报错的数据恢复案例

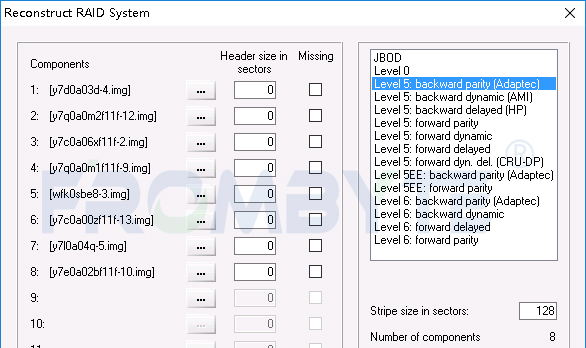

数据库数据恢复—raid5阵列上层Sql Server数据库数据恢复案例

未来的人脸识别数据库中应减少面部表情偏差

未来的人脸识别数据库中应减少面部表情偏差

评论