加州大学伯克利分校的研究人员已经开发出一种能够检测“无声语音”的AI模型。该模型基于数字语音预测单词并生成合成语音。肌电图(EMG)的电极位于脸部和喉咙,用于检测无声语音。

研究人员断言,该模型可以为无法发出可听语音的人们启用许多应用程序,并可以帮助AI工具和其他响应语音命令的设备进行语音检测。

该小组指出,以数字方式为无声语音发声具有广泛的应用。例如,它可以生成类似于蓝牙耳机的工具,该工具可以使个人继续通话,而不会打扰周围的人。当环境声音太大而无法捕获可听见的语音或必须保持安静时,这种设备将非常有用。

口头阅读AI是可以从静音语音中捕获单词的AI的另一个示例。它可以为监视设备供电,并支持聋人的用例。

研究人员使用了一种方法,其中将所需语句的音频输出目标从发声录音转换为无声录音。然后,使用WaveNet解码器生成音频语音预测。

通过比较发声的EMG数据和基线训练的数据,发现发声的EMG方法在从书中转录句子时,单词错误率降低了64%至4%,而基线降低了95%。研究人员开源了约20小时的面部EMG数据集,以鼓励对该领域进行进一步研究。

在其他工作中,中国的研究人员建立了讽刺检测模型,该模型在多模式Twitter数据集上提供SOTA性能。Masakhane开放源代码非洲语言翻译项目的成员已发布了 有关低资源机器翻译的 案例研究。

责任编辑:lq

-

解码器

+关注

关注

9文章

1143浏览量

40721 -

蓝牙耳机

+关注

关注

19文章

5660浏览量

59143 -

AI

+关注

关注

87文章

30763浏览量

268907

发布评论请先 登录

相关推荐

AI模型部署边缘设备的奇妙之旅:目标检测模型

AMD发布10亿参数开源AI模型OLMo

BitEnergy AI公司开发出一种新AI处理方法

《AI for Science:人工智能驱动科学创新》第二章AI for Science的技术支撑学习心得

基于一种AI辅助可穿戴微流控比色传感器系统

聆思CSK6视觉语音大模型AI开发板入门资源合集(硬件资料、大模型语音/多模态交互/英语评测SDK合集)

基于助听器开发的一种高效的语音增强神经网络

OpenAI推出专用的AI检测工具

一种可实现稳定压力传感的新型可拉伸电子皮肤

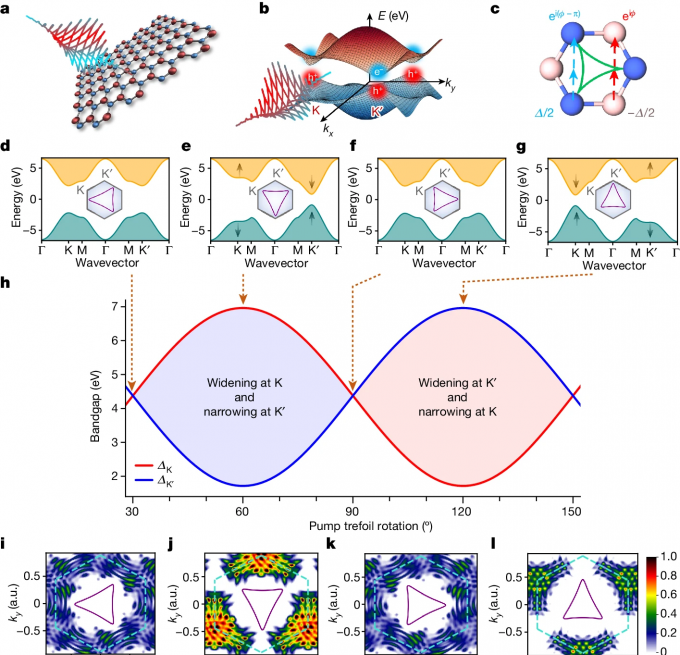

研究人员利用定制光控制二维材料的量子特性

研究人员开发出新型AI辅助发音系统,让人没有声带也能说话

防止AI大模型被黑客病毒入侵控制(原创)聆思大模型AI开发套件评测4

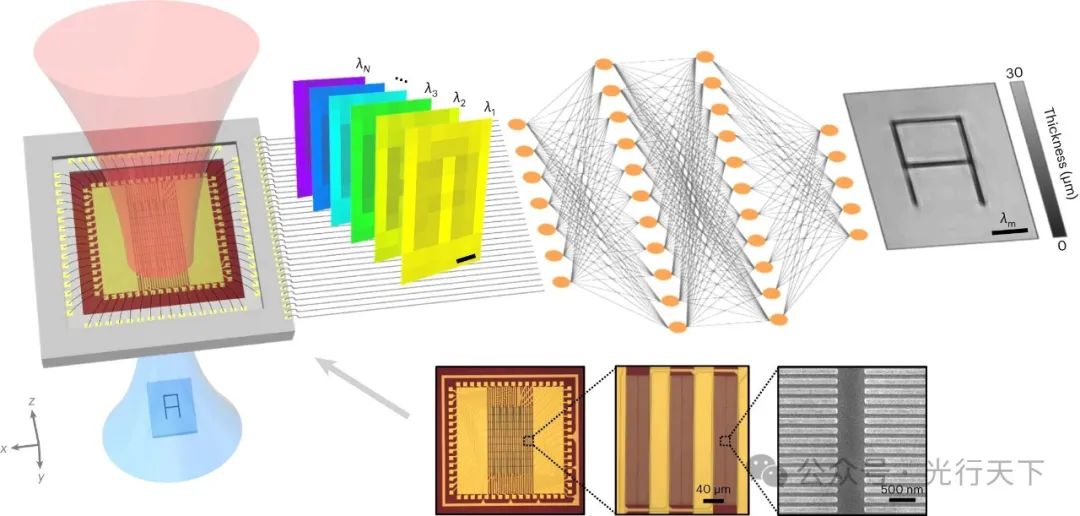

研究人员开发出一种新型太赫兹成像系统

研究人员已经开发出一种能够检测“无声语音”的AI模型

研究人员已经开发出一种能够检测“无声语音”的AI模型

评论