开发人工智能的语言模型,一直是人工智能的重要细分领域。人工智能语言模型应用包括搜索引擎、文字生成、个性化的对话工具以及软件生成等。

2020年5月,OpenAI的一组研究人员发布了具有里程碑意义的AI模型GPT-3。GPT-3就是在570 GB的文本数据上训练的语言模型,因此,就训练数据和生成能力而言,GPT-3截至2020年都是最庞大的公开发布的语言模型。

此外,OpenAI的GPT-3一反之前死守基础研究的思路,将 GPT-3 做成了一个服务,提供可以调用的 OpenAI API,并且向开放了少量体验资格,使得拿到体验资格的业界人士或学者等,开发出了一众惊人的演示。

包括答题、翻译、写文章,甚至是数学计算和编写代码。而由GPT-3所写的文章几乎达到了以假乱真的地步,在 OpenAI 的测试中,人类评估人员也很难判断出这篇新闻的真假,检测准确率仅为 12%。

但现在,谷歌研究人员开发出一个新的语言模型,它包含了超过 1.6 万亿个参数,远超 Open AI 开发的 GTP-3 的规模(1750 亿个参数),成为迄今为止最大规模的人工智能语言模型,比之前谷歌开发过最大的语言模型 T5-XXL 的效率提高了 4 倍。

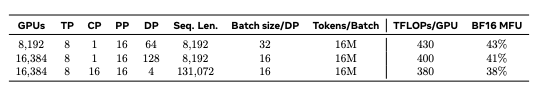

该语言模型使用 Switch Transformer 方法进行大规模训练,这是一种“稀疏激活”技术,它只使用模型权重的子集或在模型中转换输入数据的参数,以有效降低计算密集度。

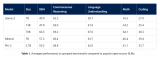

尽管在部分实验中,该模型相比规模更小的模型得到了较低分数。但在相同的计算资源下,预训练速度提高了7倍。这些改进扩展到多语言设置中,我们在所有101种语言中测量mT5基本版本的增益。最后,我们通过在“巨大的干净的爬虫语料库”上预先训练多达万亿个参数的模型,提高了语言模型的当前规模,并实现了比T5-XXL模型4倍的加速。

研究人员认为,稀疏性可以在未来赋予该模型在一系列不同媒体下多模态的优势。这也为人工智能语言模型的深入研究提供了更多方向的参考。

责任编辑:xj

-

AI

+关注

关注

87文章

30539浏览量

268747 -

人工智能

+关注

关注

1791文章

47059浏览量

238045 -

语言模型

+关注

关注

0文章

517浏览量

10261

发布评论请先 登录

相关推荐

大语言模型开发语言是什么

联发科新一代天玑旗舰芯片针对谷歌大语言模型Gemini Nano优化

谷歌发布新型大语言模型Gemma 2

【大语言模型:原理与工程实践】大语言模型的应用

【大语言模型:原理与工程实践】大语言模型的基础技术

谷歌模型框架是什么软件?谷歌模型框架怎么用?

谷歌模型软件有哪些功能

微软宣布推出一个27亿参数的语言模型Phi-2

谷歌开发出一个新的语言模型,包含了超过1.6万亿个参数

谷歌开发出一个新的语言模型,包含了超过1.6万亿个参数

评论