近日 Microsoft Azure 宣布正式推出 ND A100 v4 VM 系列,这是适用于超级计算级 AI 和 HPC 负载的强大虚拟机,由 NVIDIA A100 Tensor Core GPU 和 NVIDIA HDR InfiniBand 提供支持。

NVIDIA 与 Azure 合作构建了这款新的纵向扩展和横向扩展 AI 平台,整合了开创性 NVIDIA Ampere 架构 GPU、NVIDIA 网络技术以及 Azure 高性能互联和虚拟机网络的强大功能,让人人都能使用 AI 超级计算。

在应对 AI 和高性能计算面临的巨大挑战时,规模是重中之重。得益于加速计算,自然语言处理、推荐系统、医疗健康研究、药物研发和能源以及其他领域均取得了巨大进展。

大部分进展源自大规模运行的应用程序。为加速这一趋势,应用程序所基于的运行架构必须灵活易用,并且可以纵向扩展和横向扩展。

ND A100 v4 VM 在单个 VM 中汇集了八个 NVIDIA A100 GPU,并且搭载 NVIDIA HDR InfiniBand,使每个 GPU 都获得 200 Gb/s 的数据带宽。总体每个 VM 的互联带宽高达 1.6 Tb/s。

对于要求严苛的 AI 和高性能计算工作负载,可以进一步扩展为数千个 NVIDIA A100 GPU 规模同时维持相同的超低延迟 InfiniBand 网络,为多节点分布式计算提供强大的计算和网络功能。

适合开发者

开发者有多种选择,可通过 ND A100 v4 VM 中的 NVIDIA A100 GPU 为其应用程序提供出色性能,这些应用程序部署后,既用于应用程序开发,也用于管理基础设施。

为简化和加速开发,NVIDIA NGC 目录提供即用型 GPU 优化应用程序框架、容器、预训练模型、库、SDK 和 Helm 图表。借助 Azure Marketplace 上适用于 AI 和高性能计算的预构建 NVIDIA GPU 优化镜像,开发者只需单击几下即可开始从 NGC 目录使用 GPU 加速软件。

ND A100 v4 VM 还支持在 Azure 机器学习服务中使用,适用于交互式 AI 开发、分布式训练、批量推理和 ML 运算自动化。

使用 ND A100 v4 VM 在生产环境中部署机器学习管线,这一流程因 NVIDIA Triton 推理服务器而得到进一步简化。NVIDIA Triton 推理服务器是一款开源推理服务应用程序,与 Azure ML 集成,可更大限度地提高 GPU 和 CPU 的性能和利用率,从而将部署运营成本降至更低。

开发者和基础设施经理很快也能使用 Azure Kubernetes Service,这是一项完全托管的 Kubernetes 服务,用于部署和管理 ND A100 v4 VM(支持 NVIDIA A100 GPU)上的容器化应用程序。

更多相关信息,请点击“阅读原文”,观看《Azure:借助势头正劲的 AI 和高性能计算赋能世界》 GTC21 主题演讲。

原文标题:Microsoft Azure 宣布正式推出 NVIDIA A100 GPU VM

文章出处:【微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

责任编辑:haq

-

NVIDIA

+关注

关注

14文章

5721浏览量

110219 -

AI

+关注

关注

91文章

41834浏览量

302983 -

Microsoft

+关注

关注

0文章

241浏览量

8076

原文标题:Microsoft Azure 宣布正式推出 NVIDIA A100 GPU VM

文章出处:【微信号:NVIDIA_China,微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

ZCL系列电流传感器上市 | 100A至1000A,精度0.05%

英诺达SVS平台助力砺算Lisuan eXtreme系列GPU卡正式发售

沐曦股份曦云C系列GPU深度适配通义千问Qwen3.5模型

沐曦股份正式推出曦索X系列全新GPU品牌与产品线

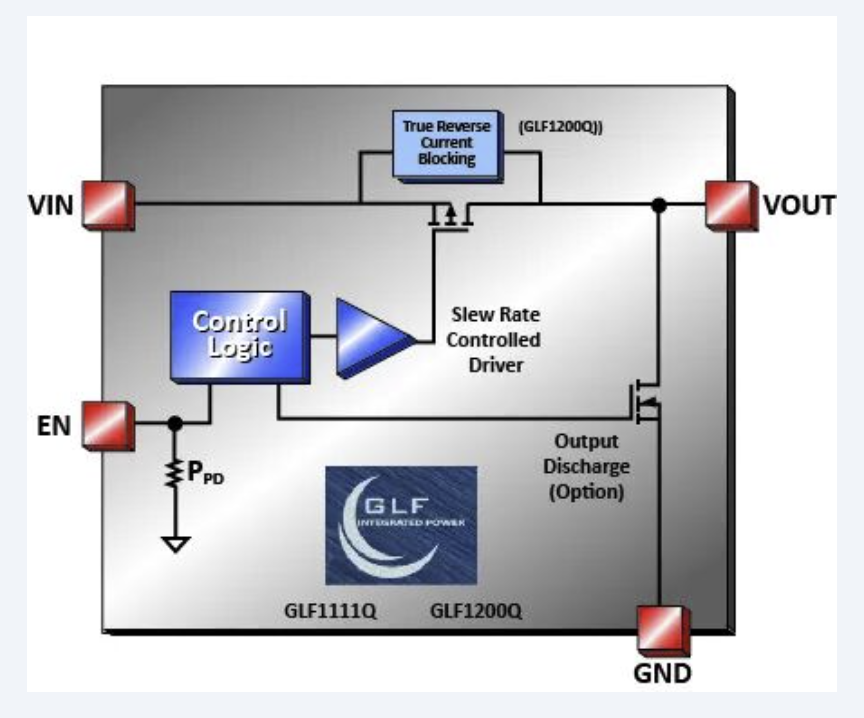

Glfipower杰夫微GLF推出全新推出基于AEC-Q100标准的车规级Load Switch IC系列

探索VM500系列电压监测继电器:功能、特性与技术规格

电子工程师必备:VM110系列电压监测继电器全解析

探索VM800系列电压监测继电器:功能、特性与技术规格

Arm架构助力Azure Cobalt 100虚拟机工作负载性能提升

Esri推出适用于Microsoft Fabric的最新ArcGIS集成功能

新手小白必看!关于A100云主机租用,你想知道的一切都在这!

DGX A100服务器出故障?选对维修商,帮你省心又省钱!

Microsoft Azure推出VIDIA A100 GPU VM系列

Microsoft Azure推出VIDIA A100 GPU VM系列

评论