声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

NVIDIA

+关注

关注

14文章

5093浏览量

104039 -

AI

+关注

关注

87文章

32023浏览量

270897 -

gtc

+关注

关注

0文章

73浏览量

4464 -

H100

+关注

关注

0文章

32浏览量

322

发布评论请先 登录

相关推荐

英伟达A100和H100比较

英伟达A100和H100都是针对高性能计算和人工智能任务设计的GPU,但在性能和特性上存在显著差异。以下是对这两款GPU的比较: 1. 架构与核心规格: A100: 架构: 基于Amp

Supermicro推出直接液冷优化的NVIDIA Blackwell解决方案

机架中的NVIDIA HGX B200 8-GPU系统数量,与Supermicro目前领先业界的搭载NVIDIA HGX H100和H200

发表于 11-25 10:39

•523次阅读

华迅光通AI计算加速800G光模块部署

,都需要更多的光模块来进行光纤通信。对于使用gpu的广泛AI训练应用,在NVIDIA的DGX H100服务器中,集成了8个H100 gpu,

发表于 11-13 10:16

英伟达H100芯片市场降温

随着英伟达新一代AI芯片GB200需求的不断攀升,其上一代明星产品H100芯片却遭遇了市场的冷落。据业内人士透露,搭载H100的服务器通常以8卡的形式进行出售或出租,而在去年,这类服务器的售价普遍

NVIDIA助力丹麦发布首台AI超级计算机

这台丹麦最大的超级计算机由该国政府与丹麦 AI 创新中心共同建设,是一台 NVIDIA DGX SuperPOD 超级计算机。

首批1024块H100 GPU,正崴集团将建中国台湾最大AI计算中心

中国台湾当地正崴集团5月27日宣布,将与日本公司Ubitus共同打造人工智能(AI)计算中心,其中第一期将导入128个机柜,共计1024张英伟达H100旗舰计算卡,旨在构建台湾最大的

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

冷却技术,提高计算密度,减少占地面积,并通过高带宽、低延迟的GPU通信,有效减少数据中心的碳足迹和能源消耗。相较于传统的NVIDIA H100风冷基础设施,GB200在相同功耗下实现25倍的性能提升

发表于 05-13 17:16

OpenAI联手Nvidia发布首台Nvidia DGX H200

OpenAI总裁兼联合创始人Greg Brockman分享了他与山姆・阿尔特曼(Sam Altman)、黄仁勋以及自己的合影,他们的眼前正是这台首次亮相的DGX H200。

英特尔发布人工智能芯片新版,对标Nvidia

为应对AI行业对高性能芯片的巨大需求,英特尔推出了全新Gaudi 3芯片,据称这一款芯片在训练大语言模型方面的速度较之NVIDIA最新H100处理器要快50%。而且,其推理运算速度也超

NVIDIA Blackwell DGX SuperPOD助力万亿级生成式AI计算

全新 DGX SuperPOD 采用新型高效液冷机架级扩展架构,基于 NVIDIA DGX GB200 系统构建而成,在 FP4 精度下可提

发表于 03-21 09:49

•268次阅读

NVIDIA推出搭载GB200 Grace Blackwell超级芯片的NVIDIA DGX SuperPOD™

NVIDIA 于太平洋时间 3 月 18 日发布新一代 AI 超级计算机 —— 搭载 NVIDIA GB200 Grace Blackwel

NVIDIA 推出 Blackwell 架构 DGX SuperPOD,适用于万亿参数级的生成式 AI 超级计算

—— NVIDIA 于今日发布新一代 AI 超级计算机 —— 搭载 NVIDIA GB200 Grace Blackwell 超级芯片的

发表于 03-19 10:56

•509次阅读

NVIDIA 发布全新交换机,全面优化万亿参数级 GPU 计算和 AI 基础设施

圣何塞 —— GTC —— 太平洋时间 2024 年 3 月 18 日 —— NVIDIA 发布专为大规模 AI 量身订制的全新网络交换机

发表于 03-19 10:05

•439次阅读

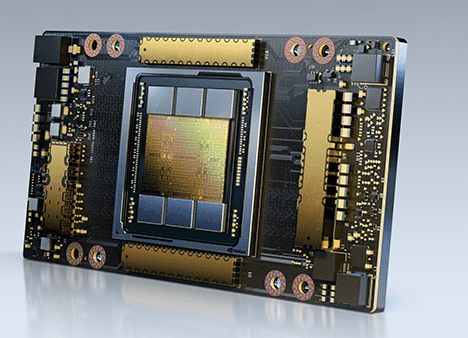

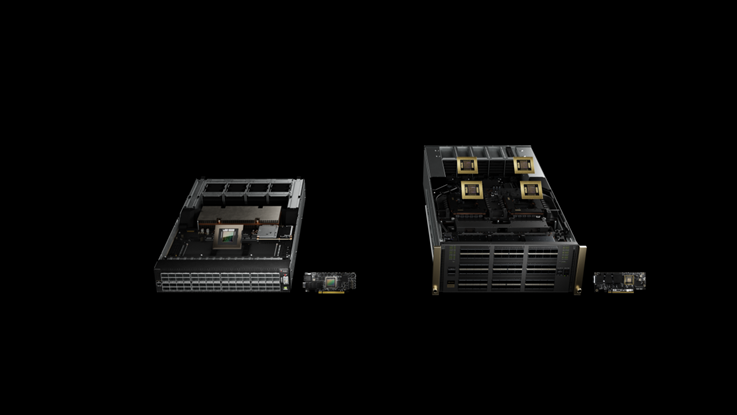

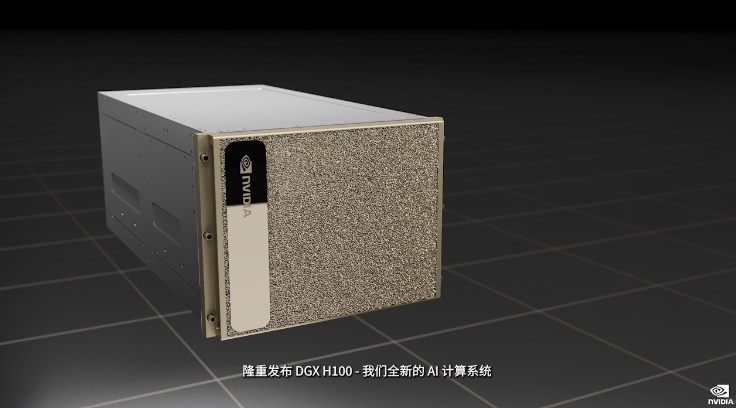

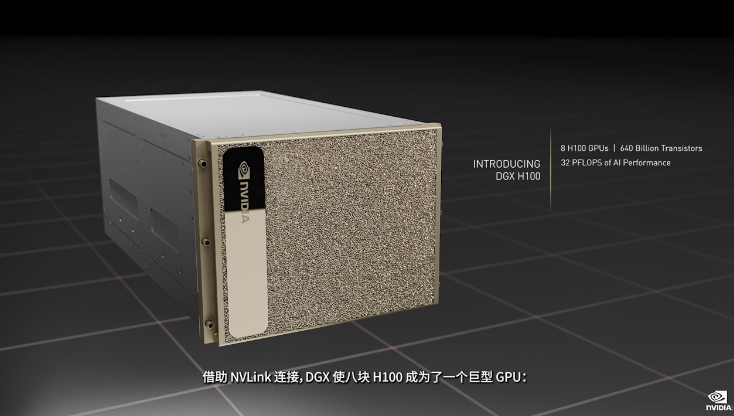

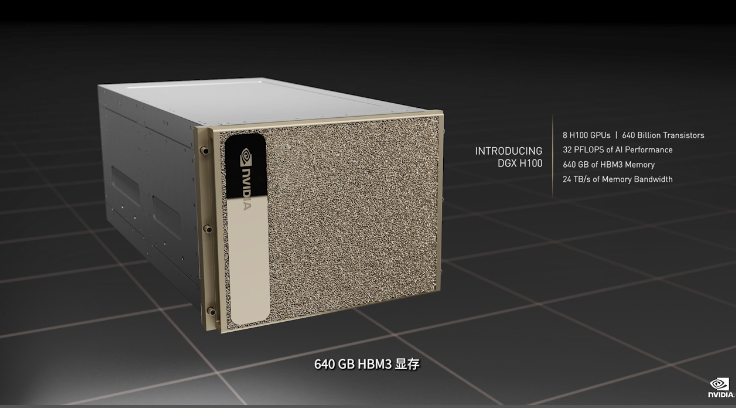

GTC2022大会亮点:NVIDIA发布全新AI计算系统—DGX H100

GTC2022大会亮点:NVIDIA发布全新AI计算系统—DGX H100

评论