NVIDIA 发布了 NVIDIA Riva 在语音人工智能方面的新突破, NVIDIA NeMo 在大规模语言建模( LLM )方面的新突破。 Riva 是一款 GPU 加速语音人工智能 SDK ,用于企业为其品牌和虚拟助手生成富有表现力的类人语音。 NeMo 是语音和 NLU 的加速培训框架,它现在有能力开发具有数万亿参数的大规模语言模型。

语音和语言人工智能的这些进步使企业和研究机构能够轻松构建针对其行业和领域定制的最先进的对话人工智能功能。

英伟达 Riva

NVIDIA 发布了一个具有定制语音功能的新版本,企业只需 30 分钟的语音数据即可轻松创建独特的语音来代表其品牌。

此外, NVIDIA 宣布了Riva Enterprise,这是一项付费计划,包括为需要大规模 Riva 部署的企业提供 NVIDIA 专家支持。 Riva 仍然免费提供给工作量较小的客户和合作伙伴。

亮点包括:

在 A100 上用一天 30 分钟的音频数据创建一个新的神经语音。

细粒度控件以生成富有表现力的声音。

A100 上的 Fastpitch + HiFiGAN 比 V100 上的 Tacotron2 + WaveGlow 性能高 12 倍。

支持五种其他语言的世界级语音识别。

扩展到成百上千的实时流。

在任何云端、本地和边缘运行。

注册以接收有关 Riva Enterprise 的最新消息和更新,以进行大规模部署 》》

使用 Riva 开发应用程序

阅读此introductory post to了解 Riva 工作流中的组件。

接下来,按照本教程构建您自己的端到端语音识别服务:

Parthart: 1-EC6

Parthart: H2-Em7

Parthut: 3-ECEN-18

有关构建virtual assistants和transcription with entity recognition等语音应用程序的更多教程,请访问Riva Getting Started. 》》

NVIDIA NeMo Megatron 、 Triton 多 – GPU 多节点推理和 Megatron 530B

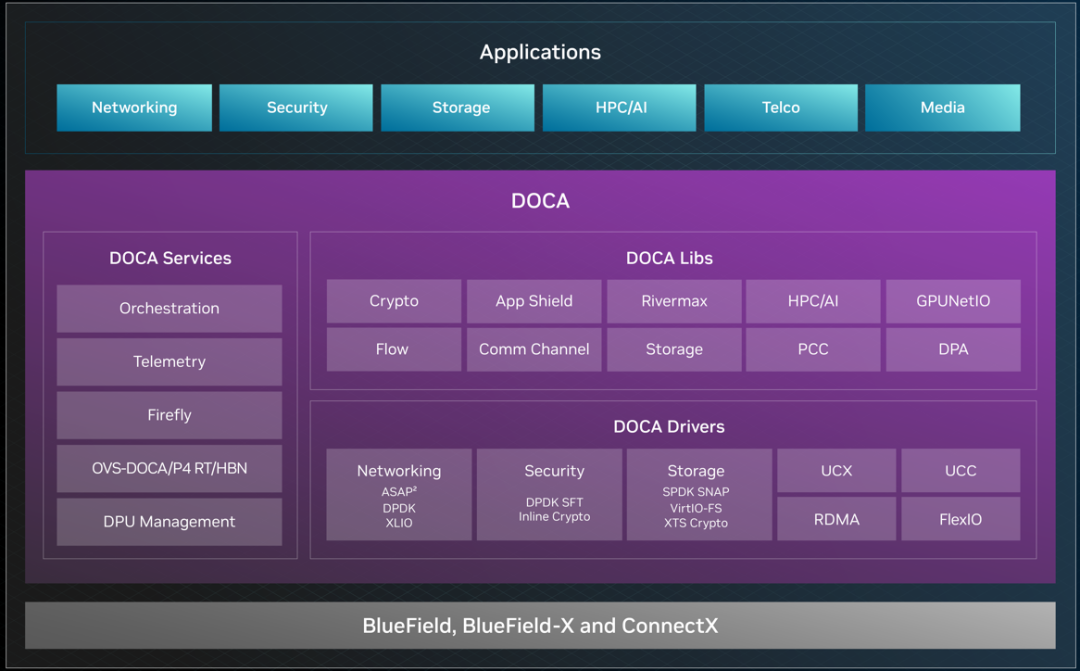

NVIDIA 还推出了为企业构建、定制和部署大型语言模型的功能。 NeMo Megatron 是 NeMo 框架中的一项新功能,用于培训多达数万亿个参数的大型语言模型( LLM )。

它包括Megatron方面的进步,这是一个由 NVIDIA 研究人员领导的开源项目,旨在开发有效培训法学硕士的技术。企业可以使用 NeMo Megatron 定制 LLM ,如 Megatron 530B ,并使用 NVIDIA Triton 推理服务器跨多个 GPU 和节点进行部署。

亮点包括:

在包含数十亿页文本的庞大数据集上自动化数据整理。

为新的域和语言培训Megatron 530B等模型。

从单节点扩展到超级计算机,包括数十个DGX A100系统。

导出到多个节点和 GPU s ,用于使用 NVIDIA Triton 推理服务器进行实时推理。

关于作者

Siddharth Sharma 是NVIDIA 加速计算的高级技术营销经理。在加入NVIDIA 之前, Siddharth 是 Mathworks Simulink 和 Stateflow 的产品营销经理,与汽车和航空航天公司密切合作,采用基于模型的设计来创建控制软件。

审核编辑:郭婷

-

NVIDIA

+关注

关注

14文章

4978浏览量

102974 -

服务器

+关注

关注

12文章

9122浏览量

85317 -

人工智能

+关注

关注

1791文章

47181浏览量

238173 -

LLM

+关注

关注

0文章

286浏览量

327

发布评论请先 登录

相关推荐

解锁NVIDIA TensorRT-LLM的卓越性能

NVIDIA TensorRT-LLM Roadmap现已在GitHub上公开发布

NVIDIA助力Amdocs打造生成式AI智能体

NVIDIA AI Foundry 为全球企业打造自定义 Llama 3.1 生成式 AI 模型

什么是LLM?LLM的工作原理和结构

【算能RADXA微服务器试用体验】+ GPT语音与视觉交互:1,LLM部署

AI初创公司Alembic攻克LLM虚假信息难题

NVIDIA 通过 Holoscan 为 NVIDIA IGX 提供企业软件支持

NVIDIA 通过 Holoscan 为 NVIDIA IGX 提供企业软件支持,实现边缘实时医疗、工业和科学 AI 应用

研华与英伟达深化合作, 成为NVIDIA AI Enterprise软件全球分销商

英伟达H200性能显著提升,年内将推出B200新一代AI半导体

基于NVIDIA Megatron Core的MOE LLM实现和训练优化

NVIDIA发布Riva语音AI和大型LLM软件

NVIDIA发布Riva语音AI和大型LLM软件

评论