得益于扩展现实( XR )硬件和软件的最新发展,使用高保真 3D 图形创建沉浸式应用程序变得前所未有的容易。尽管如此,开发增强现实( AR )和虚拟现实( VR )应用程序仍然面临着挑战:

必须对地方开发工作站进行大量投资。

终端用户设备的计算能力仍然有限。

将应用程序部署到分布式用户会带来管理和安全复杂性。

通过和 Amazon NICE DCV 流协议一起使用 NVIDIA CloudXR,您可以在沉浸式应用程序开发的各个方面使用按需计算资源。这包括支持端到端工作流的服务、对数据安全的严格控制,以及简化部署和交付应用程序更新的管理。

AWS 和 NVIDIA CloudXR 的优势

生产级交互式 XR 应用程序需要一系列支持技术才能成功构建、交付和消费内容。来自云基础设施的微服务的出现使得将这些组件部署到端到端解决方案变得更加容易。 Amazon Web 服务( AWS )的计算、存储和网络资源可用于开发、部署和分发 XR 应用程序。然后可以使用 NVIDIA CloudXR 通过分布式网络远程渲染和流式传输这些内容。

利用 AWS 和 NVIDIA CloudXR 具有以下优势:

首先,可靠的云网络和安全工具为您的宝贵数据提供了一致的安全边界。

其次,此解决方案使远程渲染高保真、低延迟、全局可用、图形加速实例的体验成为可能。

最后,为分布式 XR 开发团队提供按需资源使您能够以很少的操作开销扩展您的员工队伍。

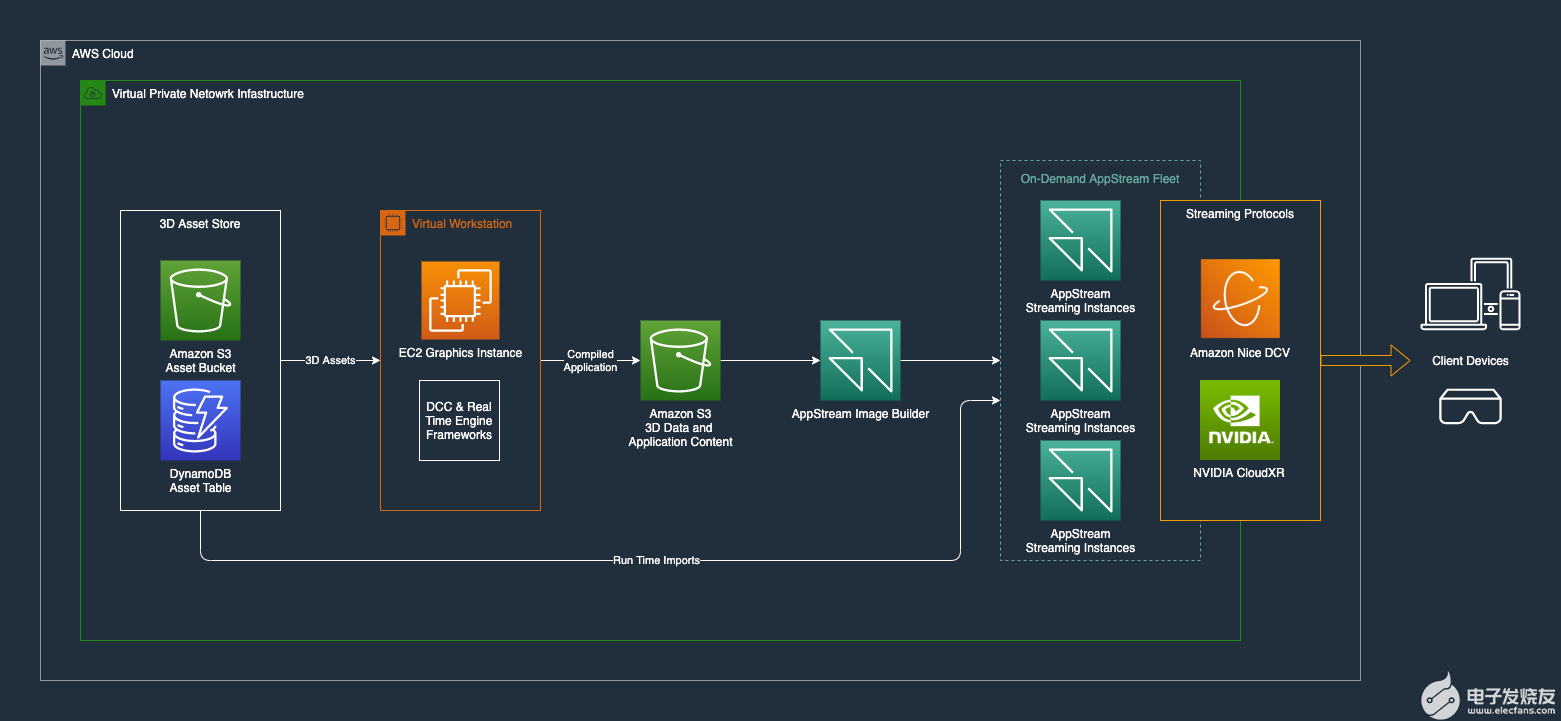

图 1 。 AWS 架构示例 (单击以获取全尺寸)

图 1 展示了 NVIDIA CloudXR 与 AWS 服务的示例配置,用于开发、部署和分发 XR 应用程序。

CloudXR 概述

NVIDIA CloudXR 是一个 SDK ,它使您能够在远程服务器(包括云)上实现富 VR 、 AR 和 XR 应用程序的实时 GPU 渲染和流式处理。通常需要固定 HMD 的应用程序可以在低功耗 VR 设备或平板电脑上远程连接和传输,而不会降低性能。

NVIDIA CloudXR 实现了 XR 流媒体的关键组件,使 AWS 客户能够使用云进行端到端 XR 应用程序开发。这个 NVIDIA CloudXR Amazon 机器图像 与 RTX 虚拟工作站捆绑,目前支持 Amazon EC2 G4 实例。

NICE DCV 概述

Amazon NICE DCV 是一种高性能的远程显示协议。它允许您在不同的网络条件下安全地将远程桌面和应用程序流从任何云或数据中心传送到任何设备。通过将 NICE DCV 与 Amazon EC2 配合使用,您可以在 Amazon EC2 实例上远程运行图形密集型应用程序。

NICE DCV 由最新的 NVIDIA GPU 提供动力,为构建下一代沉浸式应用程序的艺术家和开发人员提供低延迟性能。然后,您可以将结果流式传输到更普通的客户机,从而无需昂贵的专用工作站。

管理云中的内容

流媒体应用程序需要内容才能发挥作用。在为云中的沉浸式应用程序创建资产管理管道时, AWS 服务(如 Amazon 简单存储服务( S3 )、 Amazon DynamoDB ( NoSQL 低延迟数据库)和 Amazon API 网关)作为核心组件。

S3 成为存储 3D 资产和应用程序构建工件的数据存储。

DynamoDB 表用于存储和访问资产元数据和应用程序服务器信息。

API 网关充当 AWS 中与客户端沉浸式应用程序交互的数据的前门。

当您的应用程序已完全准备就绪时,您可以将应用程序流 Amazon 和非持久化的应用程序流 Amazon 从桌面部署到应用程序。这些实例也配置了NVIDIA CloudXR SDK 服务器,允许它们接收来自 Nvidia CloudXR 客户端的设备的请求。

总结

通过 NVIDIA CloudXR 的流式体验,数据永远不会离开数据中心。全球可用的 AWS 实例允许您在接近最终用户的情况下提供体验,但 NVIDIA CloudXR 承担了繁重的任务,以减少感知延迟,并为最终用户提供流畅的体验。将 NVIDIA CloudXR 作为开发和测试过程的一部分,意味着您可以为相同的目标平台构建应用程序进行测试和最终部署。

使用 NVIDIA CloudXR 从 AWS 云端流式传输身临其境的体验,您可以将高保真图形传送到未受约束的 AR 和 VR 设备。通过在 Amazon EC2 上运行 NICE DCV 的开发工作站,您可以从任何位置为您的团队启动图形工作站。 AWS 云用于身临其境应用程序的开发、部署和分发,是一个高度可扩展、安全且具有弹性的单一真实源,适用于所有 3D 内容。

关于作者

William Cannady 是 NVIDIA enterprise XR 团队的技术产品经理。他专注于 XR 产品的技术方面,与合作伙伴和客户密切合作。

Adam Harder 是 Amazon Web Services 的高级空间计算解决方案架构师。他热衷于构建增强现实( AR )和虚拟现实( VR )应用程序以及支持它们的 3D 数据管道。

Kellan Cartledge 是 Amazon Web 服务的空间计算解决方案架构师。他曾在建筑、娱乐和计算机图形学的交叉领域工作,对虚拟世界和物理世界的结合充满激情。

审核编辑:郭婷

-

NVIDIA

+关注

关注

14文章

4986浏览量

103064 -

Ar

+关注

关注

24文章

5096浏览量

169552 -

vr

+关注

关注

34文章

9639浏览量

150278

发布评论请先 登录

相关推荐

NVIDIA通过加速AWS上的机器人仿真推进物理AI的发展

NVIDIA NIM微服务登陆亚马逊云科技

NVIDIA与德勤共同部署适用于医疗健康的数字AI智能体

NVIDIA NIM助力企业高效部署生成式AI模型

NVIDIA RTX AI套件简化AI驱动的应用开发

借助NVIDIA NIM加速AI应用部署

奥迪借助Microsoft Intune简化终端管理平台

用按键来发布消息,AWS订阅消息,按键能用但就是在AWS平台上看不到信息,怎么解决?

Supermicro推出适配NVIDIA Blackwell和NVIDIA HGX H100/H200的机柜级即插即用液冷AI SuperCluster

NVIDIA与微软扩展合作,帮助开发者更快构建和部署AI应用

Nvidia Jetson Nano + CYW55573/AWXB327MA-PUR M.2无法使用操作系统内置的网络管理器管理Wi-Fi如何解决?

NVIDIA AI微服务现已与AWS集成,加速药物研发和数字医疗

NVIDIA数字人技术加速部署生成式AI驱动的游戏角色

使用NVIDIA CloudXR和AWS简化部署和交付管理

使用NVIDIA CloudXR和AWS简化部署和交付管理

评论