基于 GPU 的功能, Facebook AI Research 的一个团队开发了一种更快、更有效的 AI 运行相似性搜索的方法。这个 study ,发表于 IEEE 大数据交易 ,创建了一种深度学习算法,能够处理和比较来自媒体的高维数据,速度明显更快,同时与以前的技术一样精确。

在一个数据供应量不断增长的世界中,这项工作有望减轻处理大型库所需的计算能力和时间。

“搜索和索引[高维数据]最直接的技术是蛮力比较,你需要对照数据库中的其他图像检查[每个图像]。这对于包含数十亿载体的集合来说是不切实际的,”研究科莱德和 Facebook 的研究工程师杰夫·约翰逊在一份新闻稿中说。

包含数百万像素和数据点的每幅图像和视频都会产生数十亿个矢量。这些大量的数据对于分析、检测、索引和比较向量非常有价值。计算大型库与依赖于多个超级计算机组件的传统 CPU 算法的相似性也存在问题,从而降低了总体计算时间。

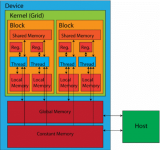

研究人员只使用了四个 GPU 和 CUDA ,设计了一个 多 GPU 到宿主和***的算法分析库图像数据点。该方法还压缩数据,使其更容易,从而更快地进行分析。

新算法在 35 分钟内处理了 9500 多万张高维图像。 10 亿个向量的图形计算起来不到 12 小时。根据该研究中的一项比较测试,使用 128 台 CPU 服务器集群处理同一数据库需要 108 。 7 小时,约长 8 。 5 倍。

约翰逊说:“通过将计算完全放在 GPU 上,我们可以利用加速器上更快的内存,而不是处理 CPU 服务器上较慢的内存,甚至传统超级计算机集群中较慢的机器对机器网络互连。”。

研究人员表示,这些方法已经应用于各种各样的任务,包括翻译的语言处理搜索。被称为 Facebook AI 相似性搜索库的方法是 开源 用于实现、测试和比较。

关于作者

Michelle Horton 是 NVIDIA 的高级开发人员通信经理,拥有通信经理和科学作家的背景。她在 NVIDIA 为开发者博客撰文,重点介绍了开发者使用 NVIDIA 技术的多种方式。

审核编辑:郭婷

-

NVIDIA

+关注

关注

14文章

5160浏览量

104912 -

gpu

+关注

关注

28文章

4849浏览量

129998 -

服务器

+关注

关注

12文章

9502浏览量

86682

发布评论请先 登录

相关推荐

深度学习工作负载中GPU与LPU的主要差异

GPU在深度学习中的应用 GPUs在图形设计中的作用

PyTorch GPU 加速训练模型方法

FPGA做深度学习能走多远?

深度学习算法在集成电路测试中的应用

利用Matlab函数实现深度学习算法

新手小白怎么学GPU云服务器跑深度学习?

深度解析深度学习下的语义SLAM

利用GPU和深度学习算法加速十亿向量相似性搜索

利用GPU和深度学习算法加速十亿向量相似性搜索

评论