人工智能驱动的机器人和其他自主机器的开发和部署速度继续快速增长。下一代应用程序需要大幅提高 AI 计算性能,以处理实时并发运行的多模态 AI 应用程序。

在零售空间、食品配送、医院、仓库、工厂车间和其他商业应用中,人机交互正在增加。这些自主机器人必须同时执行 3D 感知、自然语言理解、路径规划、避障、姿势估计以及更多需要显着计算性能和针对每个应用程序的高度准确训练的神经模型的动作。

NVIDIA Jetson AGX Orin 模块是 NVIDIA Jetson 系列中性能最高的最新成员。这些模块提供卓越的性能和一流的能效。它们运行全面的 NVIDIA AI 软件堆栈,为下一代要求严苛的边缘 AI 应用程序提供动力。

Jetson AGX Orin 和 Jetson Orin NX 系列

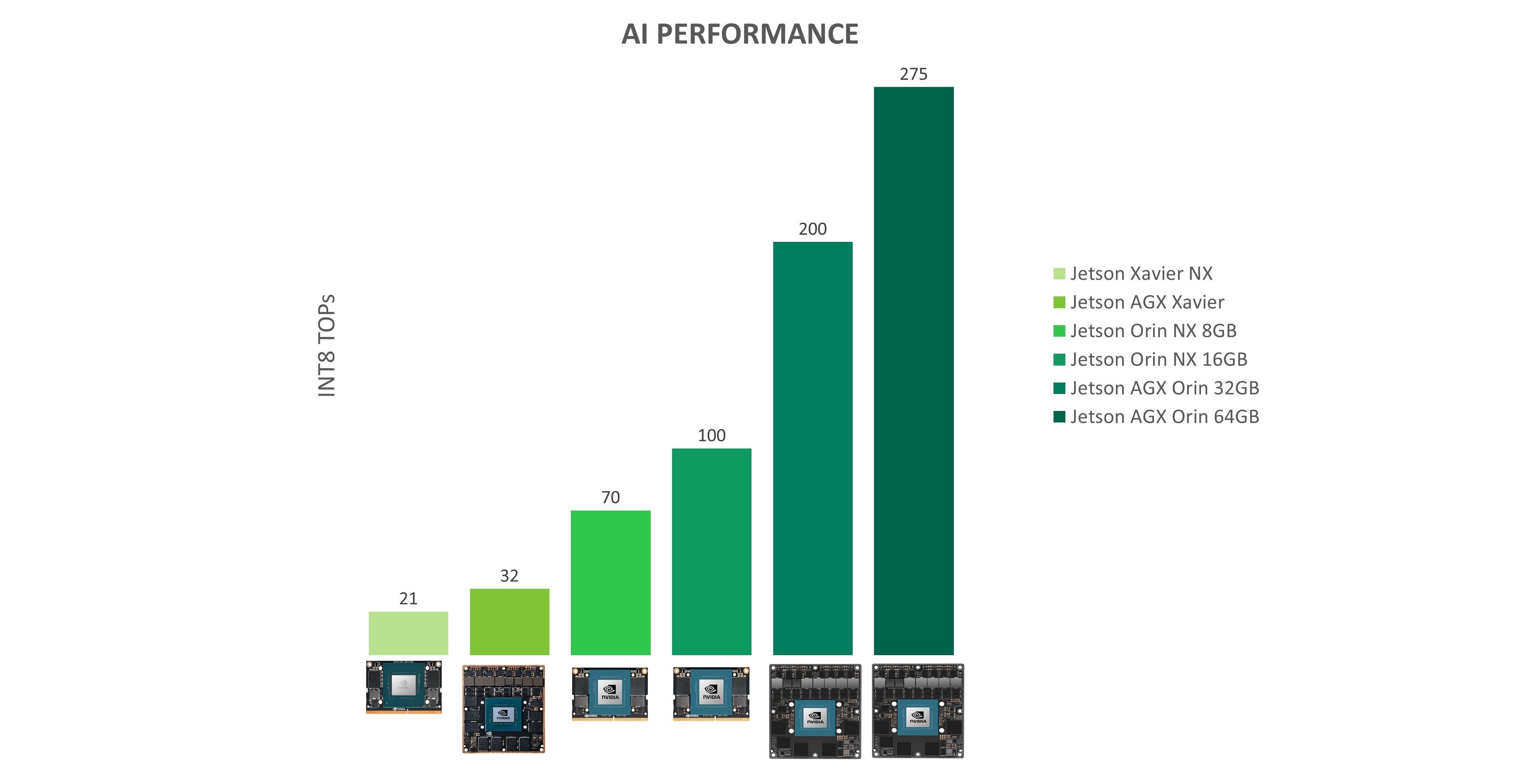

在GTC 2022 春季大会上,我们宣布将在 2022 年第四季度推出四个 Jetson Orin 模块。凭借高达 275 tera 每秒操作 (TOPS) 的性能,Jetson Orin 模块可以在边缘运行服务器级 AI 模型,并提供端到端的服务。 -end 应用程序管道加速。与 Jetson Xavier 模块相比,Jetson Orin 为现代 AI 应用程序带来了更高的性能、能效和推理能力。

图 2. Jetson Xavier 和 Jetson Orin 模块 AI TOPS 性能比较

Jetson AGX Orin 系列包括 Jetson AGX Orin 64GB 和 Jetson AGX Orin 32GB 模块。

Jetson AGX Orin 64GB 提供高达 275 TOPS 的功率,可配置在 15W 和 60W 之间。

Jetson AGX Orin 32GB 可提供多达 200 个 TOP,功率可配置在 15W 和 40W 之间。

这些模块具有相同的紧凑外形,并且与 Jetson AGX Xavier 系列模块的引脚兼容,为您提供 8 倍的性能升级,或以相同的价格提升高达 6 倍的性能。

边缘和嵌入式系统继续受到越来越多的传感器数量、性能和带宽的驱动。Jetson AGX Orin 系列不仅带来了用于处理这些传感器的额外计算,还带来了额外的 I/O:

多达 22 个 PCIe Gen4 通道

四个 10Gb 以太网

高速 CSI 车道

64GB eMMC 5.1 使存储空间翻倍

1.5X 内存带宽

有关详细信息,请参阅Jetson Orin产品页面和Jetson AGX Orin 系列数据表。

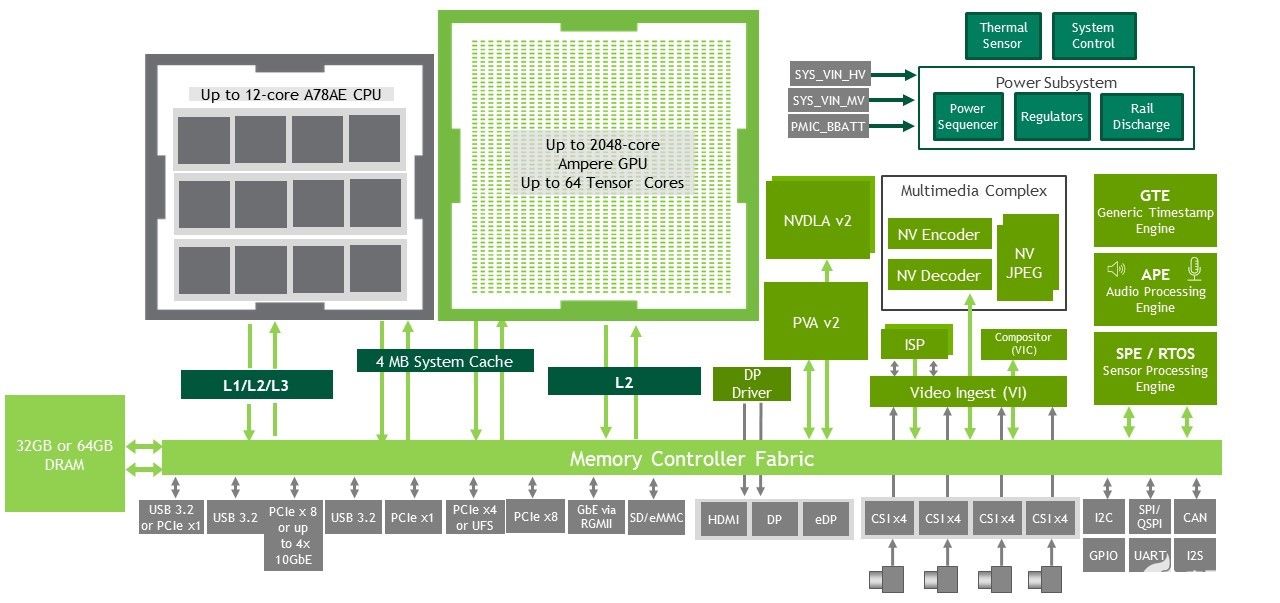

图 3. Jetson AGX Orin 系列模块

USB 3.2、UFS、MGBE 和 PCIe 共享 UPHY 通道。有关支持的 UPHY 配置,请参阅设计指南。

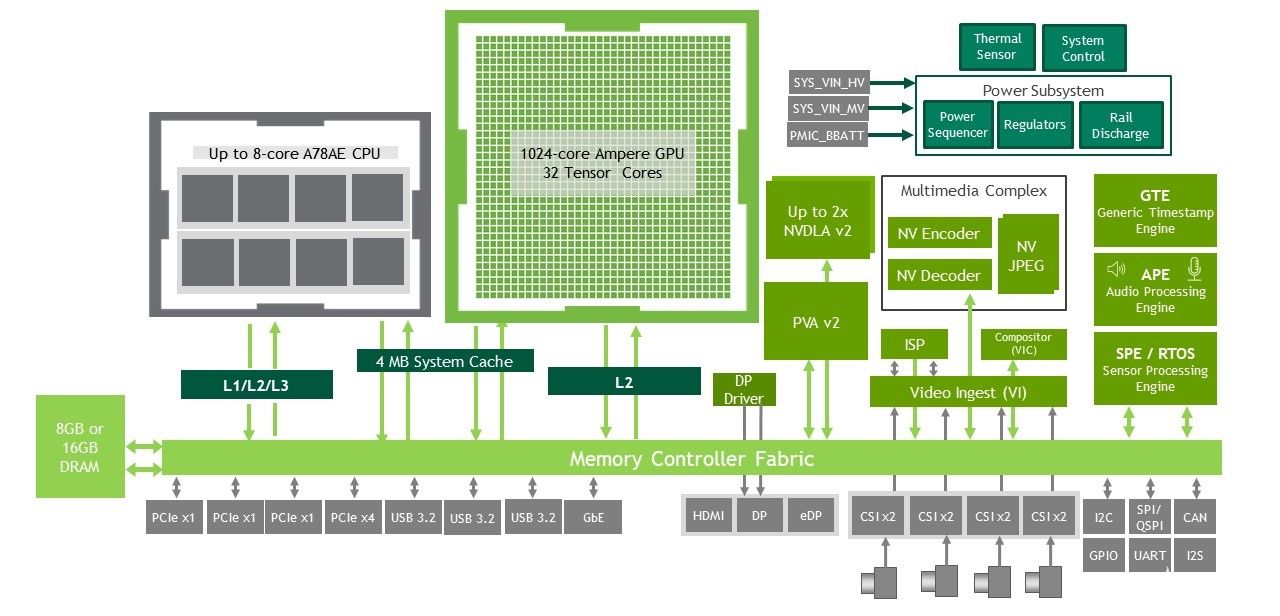

NVIDIA Orin NX 系列包括具有高达 100 TOPS 的 AI 性能的 Jetson Orin NX 16GB 和高达 70 TOPS 的 Jetson Orin NX 8GB。在这个系列中,我们遵循了与 Jetson Xavier NX 类似的设计理念。我们带来了 NVIDIA Orin 架构,并将其带到了最小的 Jetson 外形尺寸,260 针 SODIMM,功耗更低。

您可以将这种更高级别的性能带入您的下一代小型产品,如无人机和手持设备。Jetson Orin NX 16GB 的功率可配置在 10W 和 25W 之间,Jetson Orin NX 8GB 的功率可配置在 10W 和 20W 之间。

Orin NX 系列的外形尺寸与 Jetson Xavier NX 系列兼容,可提供高达 5 倍的性能,或以相同的价格提供高达 3 倍的性能。Orin NX 系列还带来了额外的高速 I/O 功能,多达 7 个 PCIe 通道和三个 10Gbps USB 3.2 接口。对于存储,您可以利用额外的 PCIe 通道连接到外部 NVMe。有关详细信息,请参阅Jetson Orin产品页面。

图 4. Jetson Orin NX 系列模块

Jetson AGX Xavier 是围绕 NVIDIA Xavier SoC 设计的,这是我们为自主机器从头开始开发的第一个架构。NVIDIA Orin 架构将此类产品提升到一个新的水平。它继续展示多种不同的片上处理器,但带来了更强大的功能、更高的性能和更高的能效。

Jetson Orin 模块包含以下内容:

具有多达 2048 个 CUDA 内核和多达 64 个张量内核的 NVIDIA Ampere 架构 GPU

两个下一代深度学习加速器 (DLA)

计算机视觉加速器

用于卸载 GPU 和 CPU 的各种其他处理器:

视频解码器

视频图像合成器

图像信号处理器

传感器处理引擎

音频处理引擎

与其他 Jetson 模块一样,Jetson Orin 是使用模块上系统 (SOM) 设计构建的。所有处理、内存和电源轨都包含在模块上。所有高速 I/O 均可通过 699 针连接器(Jetson AGX Orin 系列)或 260 针 SODIMM 连接器(Jetson Orin NX 系列)获得。这种 SOM 设计使您可以轻松地将模块集成到您的系统设计中。

Jetson AGX Orin 开发者套件

在GTC 2022上,NVIDIA 还宣布推出Jetson AGX Orin 开发者套件。开发人员工具包包含您快速启动和运行所需的一切。它包括具有最高性能的 Jetson AGX Orin 模块,并运行世界上最先进的深度学习软件堆栈。该套件提供了在现在和未来创建复杂 AI 解决方案的灵活性。

紧凑的尺寸、高速接口和大量连接器使这款开发工具包非常适合为制造、物流、零售、服务、农业、智慧城市、医疗保健、生命科学等领域的先进人工智能机器人和边缘应用进行原型设计。

图 5. Jetson AGX Orin 开发者套件

Jetson AGX Orin 开发者套件特点:

NVIDIA Ampere 架构 GPU 和 12 核 Arm Cortex-A78AE 64 位 CPU,以及下一代深度学习和视觉加速器

高速 I/O、204.8 GB/s 的内存带宽和 32 GB 的 DRAM,能够支持多个并发 AI 应用程序管道

强大的 NVIDIA AI 软件堆栈,支持 SDK 和软件平台,包括:

英伟达喷气背包

英伟达里瓦

英伟达 DeepStream

英伟达艾萨克

英伟达陶

Jetson AGX Orin 开发套件运行最新的 NVIDIA JetPack 5.0 软件。NVIDIA JetPack 5.0 支持使用 Jetson AGX Orin 开发工具包模拟 Jetson Orin NX 和 Jetson AGX Orin 系列模块的性能和时钟频率。您可以立即开始开发这些模块中的任何一个。

Jetson AGX Orin 开发人员套件可通过全球 NVIDIA 授权经销商购买。按照入门指南立即开始。

开发者工具包AGX 奥林 64GBAGX 奥林 32GB

人工智能性能275 个 INT8 稀疏 TOP200 个 INT8 稀疏 TOP

图形处理器

具有 64 个张量核心 的 2048 核 NVIDIA 安培架构 GPU具有 56 个张量核心的 1792 核 NVIDIA Ampere 架构 GPU

中央处理器12 核 Arm Cortex-A78AE v8.2

64 位 CPU 3MB L2 + 6MB L38 核 Arm Cortex-A78AE v8.2

64 位 CPU 2MB L2 + 4MB L3

力量15W-60W15W-40W

记忆32 GB64 GB32GB

建议零售价1,999 美元1,599 美元899 美元

表 2. Jetson AGX Orin 系列模块和 Developer Kit 的总结比较

一流的性能

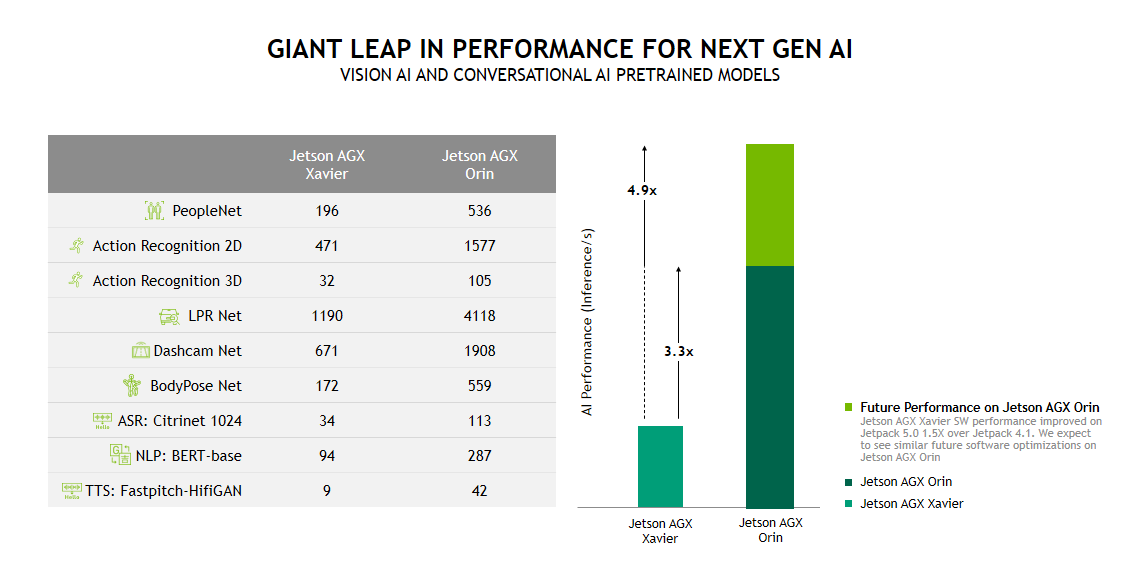

Jetson Orin 为您的下一代应用程序提供了巨大的飞跃。使用 Jetson AGX Orin 开发人员套件,我们为我们的高度准确、生产就绪、预训练的计算机视觉和会话 AI 模型获取了测量性能的几何平均值。测试包括以下基准:

用于人员检测的NVIDIA PeopleNet

NVIDIA ActionRecognitionNet 2D 和 3D 模型

用于车牌识别的NVIDIA LPRNet

NVIDIA DashcamNet , BodyPoseNet用于多人人体姿态估计

Citrinet-1024用于语音识别

BERT-base用于自然语言处理

用于文本到语音的FastPitchHifiGanE2E

借助 NVIDIA JetPack 5.0 开发者预览版,Jetson AGX Orin 与 Jetson AGX Xavier 相比,性能提升了 3.3 倍。随着未来软件的改进,我们预计这将接近 5 倍的性能提升。自从 NVIDIA JetPack 4.1.1 开发者预览版(第一个支持它的软件版本)以来,Jetson AGX Xavier 的性能提高了 1.5 倍。

图 6. 预训练模型性能基准图表

基准测试已在我们的 Jetson AGX Orin 开发工具包上运行。PeopleNet 和 DashcamNet 提供了可以在 GPU 和两个 DLA 上同时运行的密集模型的示例。DLA 可用于从 GPU 卸载一些 AI 应用程序,这种并发能力使它们能够并行运行。

PeopleNet、LPRNet、DashcamNet 和 BodyPoseNet 提供了在 Jetson 上运行的密集 INT8 基准测试的示例。ActionRecognitionNet 2D 和 3D 以及对话式 AI 基准提供了密集 FP16 性能的示例。所有这些模型都可以在NVIDIA NGC上找到。

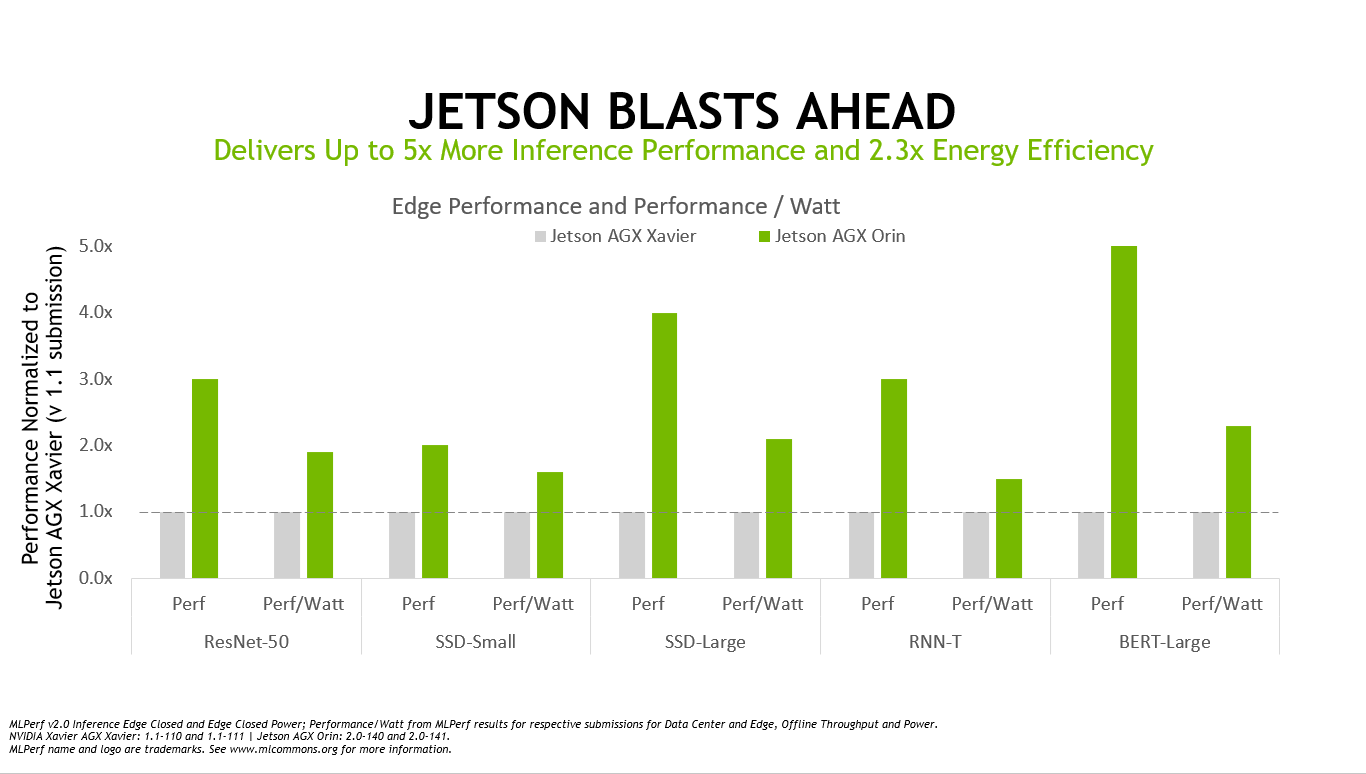

此外,Jetson Orin 继续提高边缘 AI 的标准,在最新的 MLPerf 行业推理基准测试中进一步提升了 NVIDIA 的整体排名。与之前在 Jetson AGX Xavier 上的结果相比,Jetson AGX Orin 在这些 MLPerf 基准测试中的性能提升高达 5 倍,同时平均能效提高 2 倍。

图 7. Jetson AGX Orin 性能

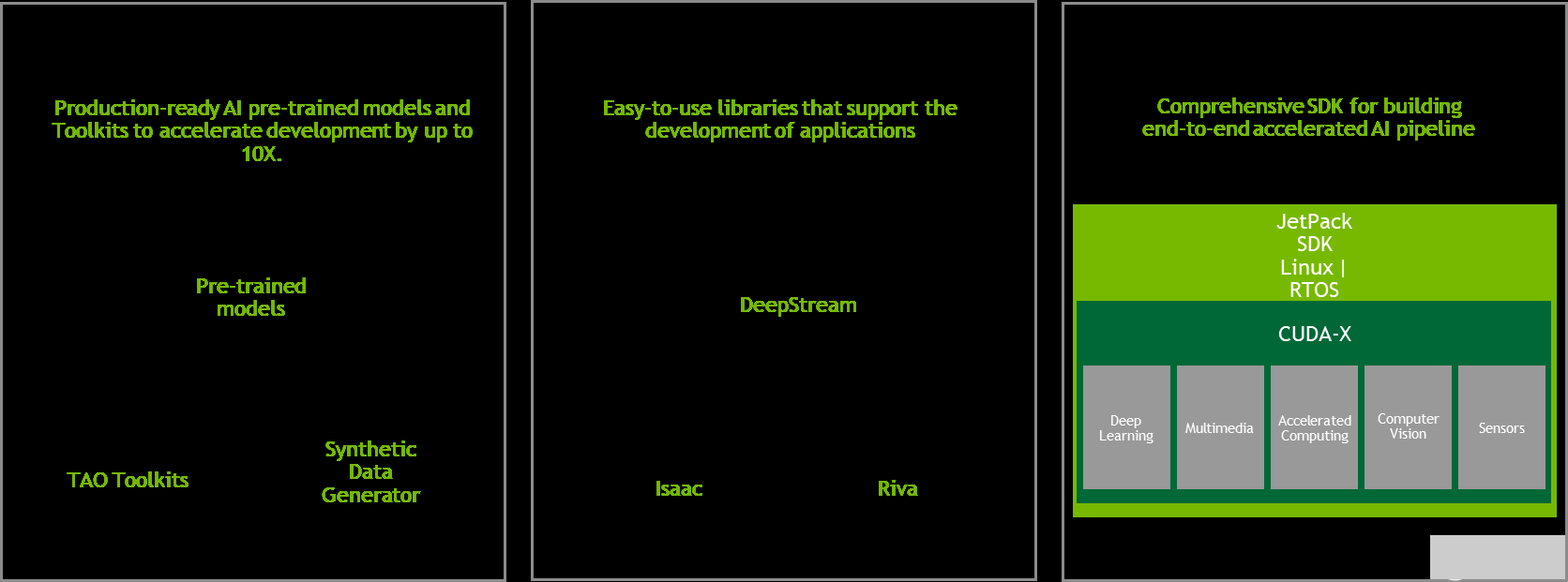

使用 Jetson 软件加快上市时间

Jetson Orin 一流的性能和能效得到了同样强大的 NVIDIA AI 软件的支持,该软件部署在 GPU 加速的数据中心、超大规模服务器和强大的 AI 工作站中。

图 8. Jetson 软件概览

NVIDIA JetPack是 Jetson 平台的基础 SDK。NVIDIA JetPack 为硬件加速的边缘 AI 开发提供了完整的开发环境。Jetson Orin 受 NVIDIA JetPack 5.0 支持,其中包括:

LTS 内核 5.10

基于 Ubuntu 20.04 的根文件系统

基于 UEFI 的引导加载程序

具有 CUDA 11.4、TensorRT 8.4 和 cuDNN 8.3 的最新计算堆栈

NVIDIA JetPack 5.0 还支持 Jetson Xavier 模块。

为了您在 Jetson 平台上快速开发完全加速的应用程序,NVIDIA 提供了适用于各种用例的应用程序框架:

借助DeepStream,快速开发和部署视觉 AI 应用程序和服务。DeepStream 提供了超越推理的硬件加速,因为它提供了用于端到端 AI 管道加速的硬件加速插件。

NVIDIA Isaac提供硬件加速的 ROS 软件包,使 ROS 开发人员能够更轻松地构建高性能机器人解决方案。

由 Omniverse 提供支持的NVIDIA Isaac Sim是一种工具,它支持照片般逼真、物理上精确的虚拟环境,以开发、测试和管理基于 AI 的机器人。

NVIDIA Riva为自动语音识别 (ASR) 和文本转语音 (TTS) 提供最先进的预训练模型,这些模型可以轻松定制。这些模型使您能够快速开发 GPU 加速的对话式 AI 应用程序。

为了加快开发可用于生产且高度准确的 AI 模型的时间,NVIDIA 提供了各种工具来生成训练数据、训练和优化模型,并快速创建可部署的 AI 模型。

用于合成数据生成的NVIDIA Omniverse Replicator有助于创建高质量数据集以促进模型训练。使用 Omniverse Replicator,您可以创建大型且多样化的合成数据集,这不仅很难,而且有时在现实世界中是不可能创建的。使用合成数据和真实数据来训练模型,可以显着提高模型的准确性。

NGC 的NVIDIA 预训练模型为您提供适用于各种用例的高度准确和优化的模型和模型架构。预训练模型可用于生产。您可以通过使用您自己的真实或合成数据进行训练来进一步自定义这些模型,使用NVIDIA TAO(训练-适应-优化)工作流程快速构建准确且可立即部署的模型。

关于作者

Leela Karumbunathan 是 NVIDIA 的硬件产品经理,专注于 Jetson 和自主机器。她曾在半导体行业担任过工程和产品相关职位。她在约翰霍普金斯大学获得电气工程学士学位。

Suhas Sheshadri 是 NVIDIA 的产品经理,专注于 Jetson 软件。他之前曾在 NVIDIA 的自动驾驶团队工作,为 NVIDIA Drive 平台优化系统软件。在空闲时间,Suhas 喜欢阅读有关量子物理学和博弈论的书籍。

审核编辑:郭婷

-

NVIDIA

+关注

关注

14文章

5021浏览量

103250 -

AI

+关注

关注

87文章

31128浏览量

269447 -

应用程序

+关注

关注

37文章

3283浏览量

57750

发布评论请先 登录

相关推荐

NVIDIA发布小巧高性价比的Jetson Orin Nano Super开发者套件

NVIDIA 推出高性价比的生成式 AI 超级计算机

解析NVIDIA JetPack 6.1的新功能

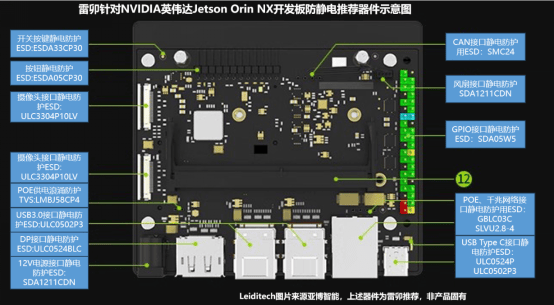

雷卯针对NVIDIA英伟达JETSON Orin NX开发板防静电推荐器件示意图

初创公司借助NVIDIA Metropolis和Jetson提高生产线效率

使用NVIDIA Jetson打造机器人导盲犬

使用机器学习和NVIDIA Jetson边缘AI和机器人平台打造机器人导盲犬

Orin芯片与边缘计算结合

Orin芯片功耗分析

Orin芯片与其他芯片对比

NVIDIA Jetson Orin系列边缘计算主机

NVIDIA 通过 Holoscan 为 NVIDIA IGX 提供企业软件支持

NVIDIA 通过 Holoscan 为 NVIDIA IGX 提供企业软件支持,实现边缘实时医疗、工业和科学 AI 应用

Nvidia Jetson Nano + CYW55573/AWXB327MA-PUR M.2无法使用操作系统内置的网络管理器管理Wi-Fi如何解决?

NVIDIA Jetson为嵌入式计算领域探索AI可能

使用NVIDIA Jetson Orin为边缘AI应用程序提供动力

使用NVIDIA Jetson Orin为边缘AI应用程序提供动力

评论