超级智能 AI 不会有人类的情感,因此在本质上不会是仁慈或恶毒的。

这么多的可能性;我们已经面对如此多的现实。无论普通人是否意识到,人工智能 (AI) 和机器学习 (ML) 已经控制了他们大部分的在线生活。例如,这些技术决定了他们的新闻提要中显示的内容,并定制了他们在访问亚马逊时看到的内容。

现在,算法决定了我们的保险费率是多少,我们是否有资格获得贷款,或者我们的简历是否会被选中进行进一步审查。人工智能和机器学习现在在医学领域很“热门”,可以进行诊断、预测疾病爆发等等。

我们正面临物联网 (IoT) 的一场革命——无人驾驶汽车、智能家居、智能家电、智能电网,甚至是智能城市。医疗专业人员远程监控患者,当然,我们不能忘记 Siri 和 Alexa。

确实,我们生活在一个技术的美好世界,该技术有望继续让我们的生活更轻松、更高效。

权力和责任

所有这些改变我们生活的权力也带来了更大的责任——滥用这种权力是许多人(例如埃隆·马斯克)担心的问题。最近,在一次采访中,Elon 谈到了 AI 和 ML:

“我们正在迅速朝着超越任何人类的数字超级智能迈进——我认为这很明显……如果一家公司或一小群人设法开发出神一样的数字超级智能,他们可以接管世界……至少当有一个邪恶的独裁者时,那个人会死,但对于人工智能来说,就不会死。它将永远存在,然后你将拥有一个不朽的独裁者,我们永远无法逃脱。”

马斯克已经加入了许多研究人员和科学家的行列,例如斯蒂芬霍金,他们预测如果 AI 和 ML 研究和实施没有得到严格监管,就会出现这样的世界末日。

这场争论的另一面是反对者,他们坚持认为 AI 和 ML 永远不会取代完整的人类智能,因此是可以控制的。

AI 和 ML 到底有什么危险?

这是争议的关键。目前,我们拥有所谓的窄人工智能或弱人工智能,旨在完成一组离散任务(驾驶汽车、保护电网、下棋、通过面部识别识别人等)。

然而,许多人的长期目标是开发能够执行认知(思考、推理)任务的所谓强人工智能。例如,想象一下一个致命的武器系统,它可以在没有任何人为干预或控制的情况下决定何时何地部署其武器。这样的制度,在一个民族国家的手中,可能会让世界其他地方屈服。

另一个危险?超级智能 AI 不会有人类的情感,因此在本质上不会是仁慈或恶毒的。但是,它将是有效的,并采取“最短路径”来实现目标,而不考虑它在此过程中可能会破坏什么。例如,假设一台配备人工智能的机器的任务是为新的铁路系统清理大片土地。如果在执行这项任务的过程中,它破坏了地下输油管道,从而释放出破坏该地区整个生态系统并使当地水系统处于危险之中的有毒污泥,会发生什么?如果保护生态系统没有被定义为机器的目标之一,它可能会不顾一切地继续下去。

那些担心这些场景(认知 AI 和 ML 不断学习并变得比人类更“聪明”)的人表示,我们必须弄清楚如何在 AI 系统变得超级智能之前将我们自己的目标嵌入到系统中。

预计短期内不会出现革命,而是进化认知人工智能。事实上,即使是专家也不同意超智能 AI 成为现实需要多长时间,如果——确实——真的如此的话。但随着技术的发展,我们确实必须提前计划可能发生的事情,以免发生在我们身上,恶意的人会卷入其中或出现意想不到的后果。

许多认知人工智能不会产生可怕的后果,但可能性仍然令人担忧。想想今天的许多学生已经找到了为他们写论文和论文的方法。有些公司,例如Wow Grade.net,提供写作和内容创作服务。未来使用认知人工智能将允许学生简单地翻转一个主题,让超级智能技术做出关于论文的所有决定、识别资源并创建“原创”作文。虽然学生显然没有完成这项工作,但如果孤立地考虑,后果并不严重,尽管学生实际上没有学习任何东西(除了如何作弊)这一事实对未来来说并不是一个好兆头。

让我们回到我们之前的场景中,一个人工智能系统的任务是做一些有益的事情,但无意中导致了毁灭性的后果;i、 例如,生态系统和当地供水遭到破坏。超级智能AI避免此类行为本应在中编程。

因此,超智能人工智能的整个问题似乎不是人工智能的效率(它将是完全有效的),而是将其认知智能与我们自己的人类目标相结合。如果我们只关注效率,那么我们将通过人工智能选择的任何方式得到我们想要的东西。

规划和法规必须从现在开始在波多黎各举行

的2015 年生命未来人工智能安全会议上,大多数人工智能研究人员预测,认知人工智能将在 2060 年出现在我们面前。如果是这样,那么安全研究必须现在就开始。

人类目前统治着地球,因为我们是地球上所有物种中最聪明的。但是,当一个超级智能的 AI 继续自我学习和自我改进时会变得更聪明时会发生什么?届时谁来统治?

审核编辑 黄昊宇

-

AI

+关注

关注

87文章

30072浏览量

268337 -

人工智能

+关注

关注

1791文章

46820浏览量

237459 -

ML

+关注

关注

0文章

144浏览量

34597

发布评论请先 登录

相关推荐

为AI、ML和数字孪生模型建立可信数据

芯科科技前沿的MCU+AI/ML开发工具解决方案

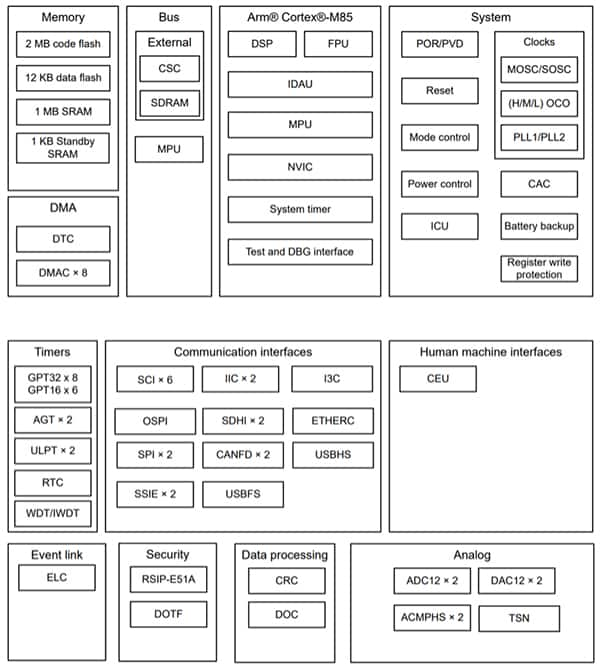

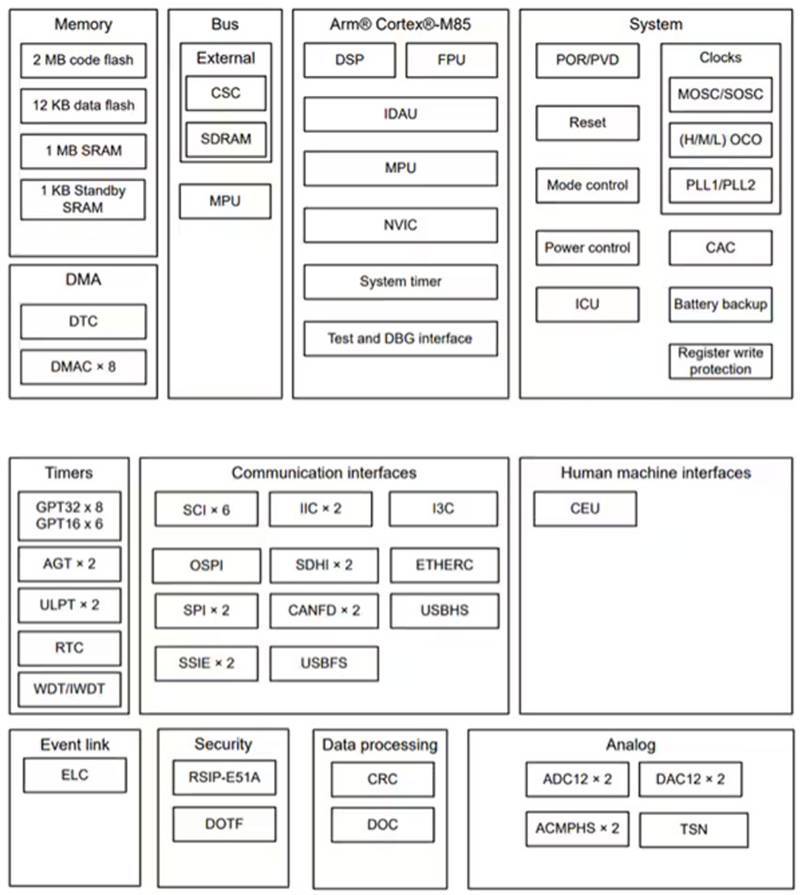

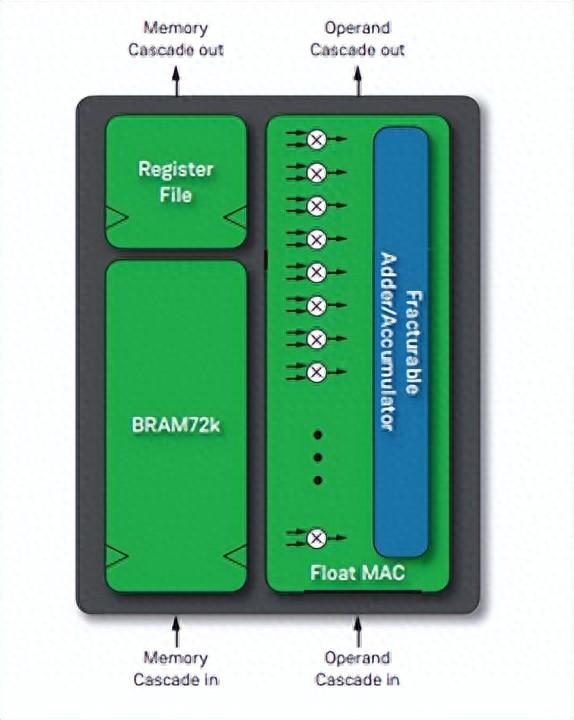

使用 Renesas RA8M1 MCU 快速地部署强大高效的 AI 和 ML 功能

基于 Renesas 的 RA8M1 实现 AI 和 ML 部署

通过无代码方法开发Edge AI和ML

Alif Semiconductor宣布推出先进的BLE和Matter无线微控制器,搭载适用于AI/ML工作负载的神经网络协同处理器

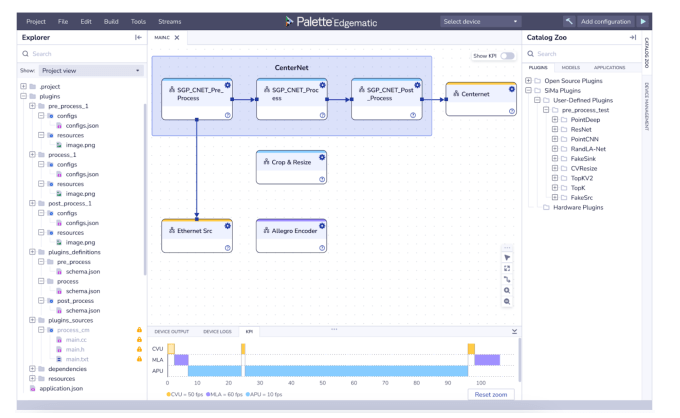

新型的FPGA器件将支持多样化AI/ML创新进程

Achronix新推出一款用于AI/ML计算或者大模型的B200芯片

是德科技推出AI数据中心测试平台

是德科技推出AI数据中心测试平台旨在加速AI/ML网络验证和优化的创新

国际最新AI算力评测标准SPEC ML即将发布,浪潮信息连任SPEC ML主席

Supermicro推新AI存储方案,助力AI和ML应用加速

深入探讨工业AI/ML技术的发展趋势及相关解决方案

以太网or非以太网?各家AI/ML网络技术盘点

AI 和 ML:我们应该担心吗?

AI 和 ML:我们应该担心吗?

评论