电子发烧友网报道(文/李弯弯)随着AI的普及,AI算力需求呈指数级增长,数据显示,2025年人工智能算力需求将达到1709EFLOPS,相较于2018年增长40.7倍。在自动驾驶领域,算力也成为了其核心驱动力,包括云端和车端。

在日前的2022世界人工智能大会(WAIC)上,寒武纪创始人、董事长兼CEO陈天石表示,云端数据中心是自动驾驶研发的核心基础设施。

主要体现在几个方面:一、训练模型,更强大的云端算力支持训练更大,更复杂的自动驾驶模型,助力高阶自动驾驶的实现;二、一站式闭环解决方案,云端汇集数百万辆车的海量驾驶数据,通过云端EOPS级别的数据中心可提供从原始数据管理到算法模型验证所需的一站式工具链和数据闭环解决方案,实现数据、算法、模型的持续开发和迭代;三、持续更新和升级,通过远程OTA不断更新自动驾驶模型,开放更多功能,不断升级消费者的驾乘体验,增强OEM的竞争力。

特斯拉作为全球智能驾驶领域的领导者,在这方面投入较大。据介绍,特斯拉现在拥有3个大数据中心,总计采用11544个GPU,包括自动标记数据中心,采用1752个GPU,可以提供549PFLOPS算力;训练数据中心1,采用4032个GPU,算力1264 PFLOPS;训练数据中心2,采用5760 个GPU,算力1806 PFLOPS。而且特斯拉还在自研DOJO超级计算机系统和D1芯片,算力将实现新的突破。

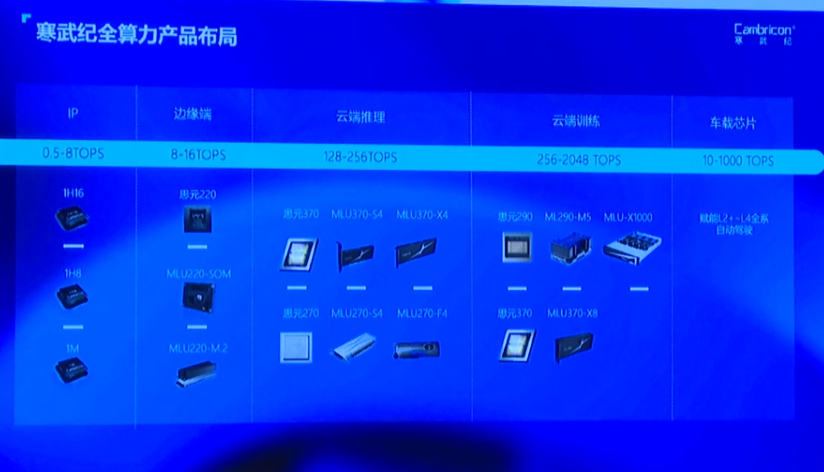

寒武纪致力于全算力布局,包括边缘端、云端推理、云端训练、车载,算力从几TOPS到几千TOPS,该公司已经为互联网、智慧金融、智慧能源、智慧物流、智慧畜牧等行业提供算力支持,并正在进入智能驾驶领域。寒武纪还具有云边端训推一体的软件开发平台,支持TensFlow、PyTorch、Caffe、ONNX等主流的人工智能开发框架。

寒武纪创始人、董事长兼CEO陈天石演讲

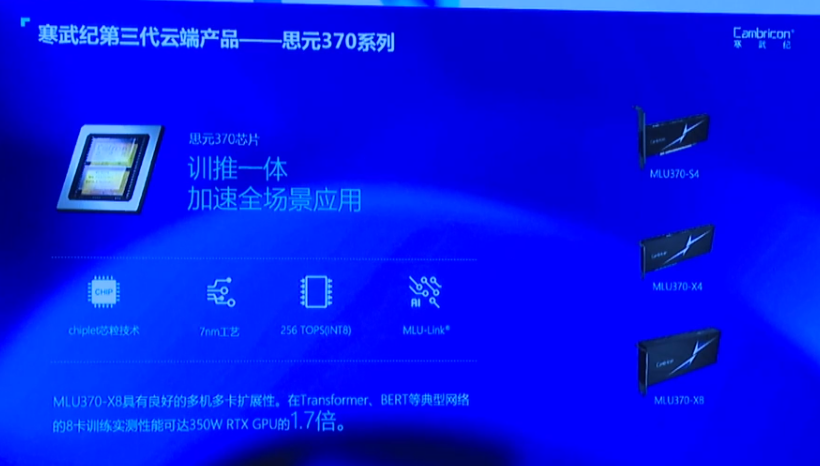

陈天石表示,寒武纪可为智能驾驶云端、车端提供算力支持。在云端,寒武纪第三代云端产品思元370系列,一款训推一体的芯片,可用于云端自动驾驶模型的训练。

该芯片使用chiplet芯片技术,采用7nm工艺,提供256TOPS(INT8)算力,基于该芯片的加速卡MLU370-X8具有良好的多机多卡扩展性,在Transformer、BERT等典型网络的8卡训练实测性能可达到250W RTX GPU的1.7倍。

在车端,寒武纪成立了全资子公司行歌,专注于安全可靠的智能车载芯片。

陈天石认为,未来5年自动驾驶有几个方面的趋势:1、L2+自动驾驶快速普及并将长期存在,受限场景L4自动驾驶开始落地,L2+到L4并行存在;2、自动驾驶的算法更复杂,处理的数据量指数级上升,算力需求不断攀升;3、车路云协同实现大数据闭环,驾乘体验持续升级;4、为满足消费者个性化的需求,增强厂商差异化竞争力,车端自学习需求不断增强。

寒武纪车云统一的处理器架构、指令集和平台级基础软件,能够支持高效地进行数据闭环和AI调优,精度损失最低。在云端提供训练板卡,处理车端收集的海量数据,通过训练生成先进的自动驾驶模型,经过OTA推送到车端;在车端提供大算力、接口丰富的自动驾驶推理芯片,支持复杂模型大算力需求,支持算法模型的持续迭代。

寒武纪车云部分还有产品在研,包括MLU590、SD5223、SD5226。MLU590是全新一代云端AI训练芯片,采用MLUarch05全新架构,具有更大内存容量、更高内存带宽,实测训练性能较在售旗舰大幅提升。

SD5223是面向L2+自动驾驶行泊一体芯片,16TOPS 算力,相比同类产品具有更高DDR容量,更大带宽,目前寒武纪已和领先的Tier1公司、算法公司开展合作研发,SD5223将支持8M IFC、5V5R、10V10R三种产品形态,其中5V5R 方案单颗SOC实现行泊一体功能,并可采用自然散热,推动自动驾驶系统向10-15万元的入门级车型覆盖。

SD5226则是面向L4高阶自动驾驶多域融合平台SOC,AI算力400+TOPS,CPU 300K+DMIPS,采用7nm制程,这颗芯片可以支撑车端自学习架构的落地量产,当前已有的车端芯片以推理架构为主,算法模型的更新和训练需要在云端完成,而寒武纪采用端云一体,训推一体的AI处理器架构,可以支持车端训练,使得智能汽车真正具有自我进化、自我成长的能力。

-

AI

+关注

关注

91文章

41138浏览量

302608 -

智能驾驶

+关注

关注

5文章

3043浏览量

51379 -

算力

+关注

关注

2文章

1675浏览量

16833

发布评论请先 登录

寒武纪2025年报解读:AI芯片的机遇与隐忧 营收64.97亿,同比暴涨453.21%

AI芯片企业赚疯了?寒武纪营收暴涨453.21%,沐曦推理GPU销量大增866.02%

寒武纪去年营收增长超400% 净利润20.59亿同比扭亏 寒武纪首个盈利年度

寒武纪实现对GLM-5的Day 0适配

广汽集团参与车路云一体化中外车企协同开发测试

商汤科技与寒武纪达成战略合作

寒武纪成功适配DeepSeek-V3.2-Exp模型

Nullmax舱驾一体域控解决方案完成实车部署

寒武纪股价破1200大关创历史新高 DeepSeek适配国产芯片成直接原因

寒武纪85后创始人陈天石身价超1500亿

商汤大装置算力Mall重磅发布

寒武纪联手阶跃星辰成立模芯生态创新联盟

国际首创新突破!中国团队以存算一体排序架构攻克智能硬件加速难题

全算力布局,车云一体,寒武纪助力智能驾驶加速升级

全算力布局,车云一体,寒武纪助力智能驾驶加速升级

评论