韩国先进的移动运营商构建包含数百亿个参数的大型语言模型,并使用 NVIDIA DGX SuperPOD 平台和 NeMo Megatron 框架训练该模型。

在韩国受欢迎的 AI 语音助手 GiGA Genie 每天会与 800 万人交谈。

这款 AI 赋能的扬声器由电信公司 KT 提供,不仅能控制电视和提供实时流量更新信息,还能根据语音命令完成大量其他家居辅助任务。得益于大型语言模型 (LLM)(能根据庞大的文本数据集识别、理解、预测和生成人类语言的机器学习算法),这款扬声器掌握了以极为复杂的韩语进行对话的技能。

该公司构建了包含数百亿个参数的 LLM,并且使用NVIDIA DGX SuperPOD数据中心基础架构平台与NeMo Megatron框架来训练和部署这些模型。

毫无疑问,韩语 (Hangul) 是一种极为复杂的语言。它包含四种类型的复合动词,而且词语通常由两个或更多个词根组成。

KT 是韩国先进的移动运营商,拥有超过 2200 万用户。该公司通过开发包含大约 400 亿个参数的 LLM,提高了智能扬声器对此类词语的理解能力。此外,通过与 Amazon Alexa 进行集成,GiGA Genie 也可以使用英语与用户交谈。

KT 的 LLM 开发团队负责人 Hwijung Ryu 说道:“借助基于Transformer的模型,我们显著改善了 GiGA Genie 智能扬声器和我们客户服务平台 AI 联络中心 (AICC) 的品质。”

AICC 是基于云的一体式平台,可提供 AI 语音代理和其他与客户服务相关的应用。

它可以接听电话并提供客户需要的信息,或者快速将客户转接到人工代理,以便对更详细的询问进行解答。Ryu 指出,无需人工干预的 AICC 每天可以管理韩国各地打来的 10 万多个电话。

他补充说道:“LLM 使 GiGA Genie 能够更好地理解语言并生成更接近人类语言的句子,而 AICC 能更快地对询问类型进行汇总和分类,从而将咨询时间缩短 15 秒。”

训练大型语言模型

开发 LLM 可能是一个成本高昂且耗费时间的过程,并需要深厚的专业技术知识和巨大的全栈技术投资。

NVIDIA AI 平台简化并加快了 KT 的这一过程。

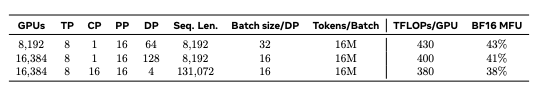

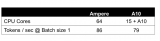

Ryu 说:“我们利用 NVIDIA DGX SuperPOD 的强大性能以及 NeMo Megatron 的优化算法和 3D 并行技术,更有成效地训练了 LLM 模型。NeMo Megatron 不断采用新功能,这是我们认为它在提高模型准确性方面的巨大优点。”

3D 并行对训练 KT 的 LLM 至关重要,它是一种分布式训练方法,可将超大规模的深度学习模型分散到多台设备上。Ryu 指出,NeMo Megatron 使团队能够以尽可能高的吞吐量轻松完成这项任务。

他补充道:“我们考虑过使用其他平台,但很难找到从硬件级别到推理级别都能提供全栈环境的替代平台。NVIDIA 还提供来自产品、工程团队等的出色专业知识,使我们轻松解决了多个技术问题。”

Ryu 表示,通过使用 NeMo Megatron 中的超参数优化工具,KT 训练其 LLM 的速度比使用其他框架快 2 倍。借助这些工具,用户可以自动找到更适合 LLM 训练和推理的配置,从而简化和加快开发与部署过程。

KT 还计划使用NVIDIA Triton 推理服务器来提供优化的实时推理服务,以及使用NVIDIA Base Command Manager轻松监控和管理其 AI集群中的数百个节点。

Ryu 说:“得益于 LLM,KT 可以比以往更快地发布充满竞争力的产品。我们还确信我们的技术可以推动其他公司的创新,因为它可以用来增加价值和创造新颖的产品。”

KT 计划在 11 月向开发者发布 20 多个自然语言理解和自然语言生成 API(应用程序编程接口)。这些 API 可用于多种任务,包括文档摘要和分类、情绪识别和潜在不当内容的过滤等。

审核编辑:汤梓红

-

NVIDIA

+关注

关注

14文章

5026浏览量

103297 -

AI

+关注

关注

87文章

31158浏览量

269548 -

语言模型

+关注

关注

0文章

530浏览量

10300

原文标题:GTC22 | 不会挂机的韩语语音服务:KT 利用 NVIDIA AI 训练智能扬声器和客户呼叫中心

文章出处:【微信号:NVIDIA-Enterprise,微信公众号:NVIDIA英伟达企业解决方案】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

AI大语言模型开发步骤

全球大型电子产品制造商利用 Omniverse 和 AI 制定计划

如何训练自己的AI大模型

如何利用大型语言模型驱动的搜索为公司创造价值

NVIDIA Nemotron-4 340B模型帮助开发者生成合成训练数据

KT利用NVIDIA AI平台训练大型语言模型

KT利用NVIDIA AI平台训练大型语言模型

评论