处理批量数据已移交给系统,特别是人工智能。对于等待的消费者来说,这个过程变得更容易、更快、更方便。

尽管有好处,但算法中的错误和漏洞是可能的。然后,这些误判将转向对毫无戒心的人口群体可能造成的伤害。

人工智能技术,尤其是机器学习(ML),在很大程度上依赖于遵循模式和检测异常活动。这种惯例导致它强化歧视性模式。

尽管模式是无缝的,算法看似完美,但不公平的偏见和歧视可以针对特定的群体。这种现象被称为代理歧视。

什么是代理歧视

既定的心理测试迫使参与者尽可能快地将术语分为两组。在这个测试中,人们被迫做出不必要的歧视,就像代理歧视中发生的那样。

制定了反对歧视的政策和法律。有反对工作场所性别、种族、年龄等歧视的政策。然而,具有讽刺意味的是,现代人工智能的使用使得很难指出歧视性案例。事实上,它可以是一个煽动者。

代理歧视如何加剧歧视

使用机器学习导致的代理歧视会造成不同的影响。从法律上讲,不同影响是对特定群体造成负面影响的就业或住房中的一种做法。

一个常见的工作场所例子是雇主积极避免雇用有孩子的女性申请人。古老的信念指出,母亲不能成为好工人,因为她们不能专注于工作。然而,员工赢得了几起具有里程碑意义的劳动法案件,因为它被证明是一种明显的歧视形式。

当考虑到人工智能和代理歧视的背景下,算法处理的所有数据也是自动化的。如果数据是通过网络抓取收集的,则不再需要人工干预。这意味着该算法不会主动搜索该“母申请人”。

但是,由于母申请人可能呈现与设置为正常组或基本组不同的特征,因此机器仍然会指出母申请人是一个异常值。

通过这种方式,代理歧视成为不同影响的一个高度具体的子集,其中看似无害的算法对特定群体造成伤害。多年前,代理歧视被认为是故意歧视的一个子集。

但是,鉴于人工智能的性质,得出的结论是它根本不是故意的。这是先进技术的不幸副产品。

利用代理歧视

代理歧视可能是无意的,但用户会找到利用这一过程为自己谋利的方法。不幸的是,故意使用代理歧视正在使歧视性决定和选择看起来是理性的,纯粹是机械的。

代理歧视被一些用户用作一种解决方法,以消除与其选择相关的歧视气氛。这就像安全网的答案,当他们的决定背后的原因受到质疑时。

保险业的代理歧视

人工智能被证明是保险业的重要工具。它在处理批量数据、欺诈检测、费率设置和定价等时派上用场。另一方面,也存在随之而来的风险,代理歧视就是其中之一。

如前所述,人工智能不能故意区分信息链。它意味着没有任何形式的偏见。但是,它对模式的高度关注使其能够捕获通常与特定组关联的代理数据。它可以是任何类型的数据。

任何类型的客户端活动都可以被算法断章取义,并受到代理歧视。这个动作对公司来说可能是麻烦的。那些受到这种前所未有的歧视的人可以提起诉讼并要求赔偿损失。

大多数公司将采取额外措施来防止这种情况发生。但是,有些人会利用这一点来发挥自己的优势。因为他们知道代理歧视的发生,他们会心甘情愿地根据自己的喜好改变算法的元素。

当他们准确地改变元素时,即使具有高度歧视性,结果也将符合他们的需要。关于结果的查询将是不可避免的,但它们可以简单地将其作为算法的产物传递,并且与算法无关。归根结底,他们在歧视性和有害决定背后有正当理由。

警惕其他风险

除了代理歧视的危险之外,用户还必须注意与人工智能技术相关的其他危险。安全总比后悔好。

失业

在考虑未来的创新时,大多数人将它们等同于机器人和其他类型的自动化。这些创新现在就开始了。各行各业更喜欢在其产品的开发和制造阶段使用机器人。

以汽车行业为例。机器人手臂不是人,而是出现在汽车的制造过程中。自动驾驶汽车现在成为可能,并且可以商业化分销。完全自动化流程的直接风险是失去由熟练员工工作的工作。

数据安全风险

由于几乎所有数据现在都存储在云中,当人工智能受到不利影响时,数字安全也可能处于危险之中。黑客和网络钓鱼是对数字安全的一些最突出的人工智能相关攻击。与利用存储在云中的个人数据相关的危险也迫在眉睫。

结论

人工智能技术的使用是一把双刃剑。虽然有明显的好处,但也存在紧迫的问题和风险,例如代理歧视。代理歧视是不可避免的。曾经是中立的声明或主张可能会对特定人群造成前所未有的伤害。目前还没有针对这种风险的已知对策。在处理这项技术时,最好也时刻保持警惕。

审核编辑:郭婷

-

人工智能

+关注

关注

1803文章

48406浏览量

244633 -

机器学习

+关注

关注

66文章

8478浏览量

133810

发布评论请先 登录

相关推荐

如今AI在不断发展,做连接器行业的更应该注意什么?

人工智能:重塑生活的便捷与奇迹

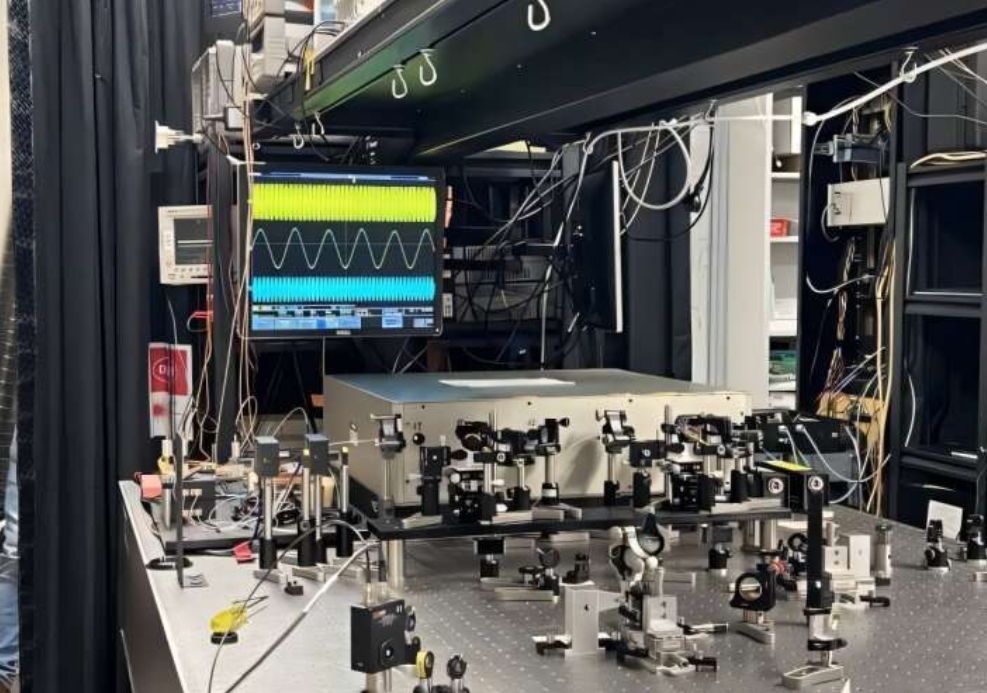

新型宽带UV频率梳提供前所未有的光谱分辨率

人工智能前所未有的缺点:代理歧视

人工智能前所未有的缺点:代理歧视

评论