1 直接在终端中设定:

CUDA_VISIBLE_DEVICES=1 python main.py

2 python 代码中设定:

import os

os.environ["CUDA_VISIBLE_DEVICES"] = "0,1"

审核编辑 黄昊

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

python

+关注

关注

53文章

4701浏览量

83699 -

pytorch

+关注

关注

2文章

766浏览量

12904

发布评论请先 登录

相关推荐

请问电脑端Pytorch训练的模型如何转化为能在ESP32S3平台运行的模型?

由题目,

电脑端Pytorch训练的模型如何转化为能在ESP32S3平台运行的模型?

如何把这个Pytorch模型烧录到ESP32S3上去?

发表于 06-27 06:06

新手小白怎么学GPU云服务器跑深度学习?

新手小白想用GPU云服务器跑深度学习应该怎么做?

用个人主机通常pytorch可以跑但是LexNet,AlexNet可能就直接就跑不动,如何实现更经济便捷的实现GPU云服务器深度学习?

发表于 06-11 17:09

PyTorch中激活函数的全面概览

为了更清晰地学习Pytorch中的激活函数,并对比它们之间的不同,这里对最新版本的Pytorch中的激活函数进行了汇总,主要介绍激活函数的公式、图像以及使用方法,具体细节可查看官方文档。

AI训练,为什么需要GPU?

随着由ChatGPT引发的人工智能热潮,GPU成为了AI大模型训练平台的基石,甚至是决定性的算力底座。为什么GPU能力压CPU,成为炙手可热的主角呢?要回答这个问题,首先需要了解当前人工智能(AI

FPGA在深度学习应用中或将取代GPU

上涨,因为事实表明,它们的 GPU 在训练和运行 深度学习模型 方面效果明显。实际上,英伟达也已经对自己的业务进行了转型,之前它是一家纯粹做 GPU 和游戏的公司,现在除了作为一家云

发表于 03-21 15:19

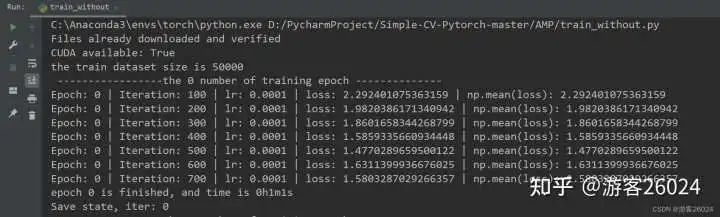

如何让网络模型加速训练

的博文,对 Pytorch的AMP ( autocast与Gradscaler 进行对比) 自动混合精度对模型训练加速 。 注意Pytorch1.6+,已经内置torch.cuda.a

基于PyTorch的模型并行分布式训练Megatron解析

NVIDIA Megatron 是一个基于 PyTorch 的分布式训练框架,用来训练超大Transformer语言模型,其通过综合应用了数据并行,Tensor并行和Pipeline并行来复现 GPT3,值得我们深入分析其背后机

pytorch模型转换需要注意的事项有哪些?

,并且可以更积极地进行优化。

支持什么格式的pytorch模型?

答:Sophon的PyTorch模型编译工具BMNETP只接受PyTorch的JIT模型JIT模型(TorchScri

发表于 09-18 08:05

大模型训练为什么不能用4090显卡,GPU训练性能和成本对比

为什么?一般有 tensor parallelism、pipeline parallelism、data parallelism 几种并行方式,分别在模型的层内、模型的层间、训练数据三个维度上对 GPU 进行划分。三个并行度乘起

发表于 09-15 11:16

•1.8w次阅读

如何往星光2板子里装pytorch?

如题,想先gpu版本的pytorch只安装cpu版本的pytorch,pytorch官网提供了基于conda和pip两种安装方式。因为咱是risc架构没对应的conda,而使用pip安

发表于 09-12 06:30

pytorch用来干嘛的

实现,并允许从Python等高级语言编写神经网络的设计和训练。 PyTorch包含了许多用于Computer Vision和NLP等领域的预训练模型,可以对它们进行微调,以便更好地适应

深度学习框架pytorch介绍

。PyTorch具有易于使用的API和文档,并强制执行Python编码标准。这使得它成为机器学习从业者的首选框架之一。PyTorch支持CPU和GPU计算以及分布式训练模型。

深度学习框架pytorch入门与实践

深度学习框架pytorch入门与实践 深度学习是机器学习中的一个分支,它使用多层神经网络对大量数据进行学习,以实现人工智能的目标。在实现深度学习的过程中,选择一个适用的开发框架是非常关键

TensorRT怎么在多个GPU中指定推理设备

说实话,之前我在笔记本上都一直都是只有一块N卡,所以没有过多关注过这个问题。然而昨天有个人问我,TensorRT怎么在多个GPU中指定模型推理GPU设备?我查了一下,发现官方有几个不同的解决方案,个人总结了一下,主要的做法有两种

PyTorch指定GPU进行训练

PyTorch指定GPU进行训练

评论