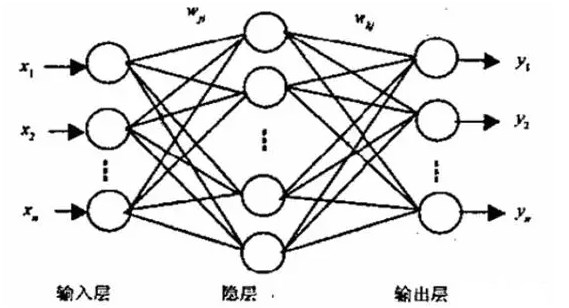

深度学习已经成为解决许多具有挑战性的现实世界问题的方法。对目标检测,语音识别和语言翻译来说,这是迄今为止表现最好的方法。许多人将深度神经网络(DNNs)视为神奇的黑盒子,我们放进去一堆数据,出来的就是我们的解决方案!事实上,事情没那么简单。

在设计和应用DNN到一个特定的问题上可能会遇到很多挑战。为了达到现实世界应用所需的性能标准,对数据准备,网络设计,训练和推断等各个阶段的正确设计和执行至关重要。

今天给大家讲讲DNN(深度神经网络)在训练过程中遇到的一些问题,然后我们应该怎么去注意它,并学会怎么去训练它。

1、数据集的准备:

必须要保证大量、高质量且带有准确标签的数据,没有该条件的数据,训练学习很困难的(但是最近我看了以为作者写的一篇文章,说明不一定需要大量数据集,也可以训练的很好,有空和大家来分享其思想---很厉害的想法);

2、数据预处理:

这个不多说,就是0均值和1方差化,其实还有很多方法;

3、Minibatch:

这个有时候还要根据你的硬件设备而定,一般建议用128,8这组,但是128,1也很好,只是效率会非常慢,注意的是:千万不要用过大的数值,否则很容易过拟合;

4、梯度归一化:

其实就是计算出来梯度之后,要除以Minibatch的数量,这个可以通过阅读源码得知(我之前有写过SGD);

5、学习率:

① 一般都会有默认的学习率,但是刚开始还是用一般的去学习,然后逐渐的减小它;

② 一个建议值是0.1,适用于很多NN的问题,一般倾向于小一点;但是如果对于的大数据,何凯明老师也说过,要把学习率调到很小,他说0.00001都不为过(如果记得不错,应该是这么说的);

③ 一个对于调度学习率的建议:如果在验证集上性能不再增加就让学习率除以2或者5,然后继续,学习率会一直变得很小,到最后就可以停止训练了;

④ 很多人用的一个设计学习率的原则就是监测一个比率(每次更新梯度的norm除以当前weight的norm),如果这个比率在10e-3附近,且小于这个值,学习会很慢,如果大于这个值,那么学习很不稳定,由此会带来学习失败。

6、验证集的使用:

使用验证集,可以知道什么时候开始降低学习率和什么时候停止训练;

7、weight初始化:

① 如果你不想繁琐的话,直接用0.02*randn(num_params)来初始化,当然别的值也可以去尝试;

② 如果上面那个建议不太好使,那么就依次初始化每一个weight矩阵用init_scale / sqrt(layer_width) * randn,init_scale可以被设置为0.1或者1;

③ 初始化参数对结果的影响至关重要,要引起重视;

④ 在深度网络中,随机初始化权重,使用SGD的话一般处理的都不好,这是因为初始化的权重太小了。这种情况下对于浅层网络有效,但是当足够深的时候就不行,因为weight更新的时候,是靠很多weight相乘的,越乘越小,类似梯度消失的意思。

8、RNN&&LSTM(这方面没有深入了解,借用别人的意思):

如果训练RNN或者LSTM,务必保证gradient的norm被约束在15或者5(前提还是要先归一化gradient),这一点在RNN和LSTM中很重要;

9、梯度检查:

检查下梯度,如果是你自己计算的梯度;如果使用LSTM来解决长时依赖的问题,记得初始化bias的时候要大一点;

10、数据增广:

尽可能想办法多的扩增训练数据,如果使用的是图像数据,不妨对图像做一点扭转,剪切,分割等操作来扩充数据训练集合;

11、dropout:(先空着,下次我要单独详细讲解Dropout)

12、评价结果:

评价最终结果的时候,多做几次,然后平均一下他们的结果。

补充:

1、选择优化算法

传统的随机梯度下降算法虽然适用很广,但并不高效,最近出现很多更灵活的优化算法,例如Adagrad、RMSProp等,可在迭代优化的过程中自适应的调节学习速率等超参数,效果更佳;

2、参数设置技巧

无论是多核CPU还是GPU加速,内存管理仍然以字节为基本单元做硬件优化,因此将参数设定为2的指数倍,如64,128,512,1024等,将有效提高矩阵分片、张量计算等操作的硬件处理效率;

3、正则优化

除了在神经网络单元上添加传统的L1/L2正则项外,Dropout更经常在深度神经网络应用来避免模型的过拟合。初始默认的0.5的丢弃率是保守的选择,如果模型不是很复杂,设置为0.2就可以;

4、其他方法

除了上述训练调优的方法外,还有其他一些常用方法,包括:使用mini-batch learning方法、迁移训练学习、打乱训练集顺序、对比训练误差和测试误差调节迭代次数、日志可视化观察等等。

审核编辑 :李倩

-

语音识别

+关注

关注

38文章

1742浏览量

112696 -

数据集

+关注

关注

4文章

1208浏览量

24725 -

深度学习

+关注

关注

73文章

5504浏览量

121242

原文标题:基础入门:“炼丹师”——深度学习训练技巧

文章出处:【微信号:vision263com,微信公众号:新机器视觉】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

循环神经网络的优化技巧

FPGA在深度神经网络中的应用

深度神经网络在雷达系统中的应用

脉冲神经网络怎么训练

BP神经网络的基本结构和训练过程

DNN(深度神经网络)在训练过程中遇到的一些问题

DNN(深度神经网络)在训练过程中遇到的一些问题

评论