”物以类聚,人以群分“!这句话的核心思想就是聚类!聚类是典型的无监督学习方法。不同于分类,分类是有监督学习,样本都有标签,分类模型重点考查的是模型的泛化能力,而聚类是按要求给样本加标签,重点考查模型聚类的效果,通常无训练集与测试集的划分。什么是聚类?所谓数据聚类是指根据数据的内在性质将数据分成一些聚合类,每一聚合类中的元素尽可能具有相同的特性,不同聚合类之间的特性差别尽可能大。聚类分析的目的是分析数据是否属于各个独立的分组,使一组中的成员彼此相似,而与其他组中的成员不同。它对一个数据对象的集合进行分析,但与分类分析不同的是,所划分的类是未知的,因此,聚类分析也称为无指导或无监督(Unsupervised)学习。聚类分析的一般方法是将数据对象分组为多个类或簇(Cluster),在同一簇中的对象之间具有较高的相似度,而不同簇中的对象差异较大。由于聚类分析的上述特征,在许多应用中,对数据集进行了聚类分析后,可将一个簇中的各数据对象作为一个整体对待。数据聚类 (Cluster analysis) 是对于静态数据分析的一门技术,在许多领域受到广泛应用,包括机器学习,数据挖掘,模式识别,图像分析以及生物信息。在物联网时代,传感器的数据比牛毛还多。作为数据分析中的主要手段——聚类肯定派的上用场。那就在大学先打下坚实的基础吧!

聚类有哪几种方法?

常用的聚类方法有:K-Means,AgglomerativeClustering,DBSCAN,MeanShift,SpectralClustering等。这里介绍其中的几个聚类分析算法。

K-Means

K-均值聚类也称为快速聚类法,在最小化误差函数的基础上将数据划分为预定的类数K。该算法原理简单并便于处理大量数据。本系列文章将展示算法程序!

K-中心点

K-均值算法对孤立点的敏感性,K-中心点算法不采用簇中对象的平均值作为簇中心,而选用簇中离平均值最近的对象作为簇中心。

系统聚类

也称为层次聚类,分类的单位由高到低呈树形结构,且所处的位置越低,其所包含的对象就越少,但这些对象间的共同特征越多。该聚类方法只适合在小数据量的时候使用,数据量大的时候速度会非常慢。

K-means方法!

这是本文讲解的重点!先来看这种方法的原理和步骤!

1)从数据集中随机抽取k个样本作为初始聚类的中心,由这个中心代表各个聚类。

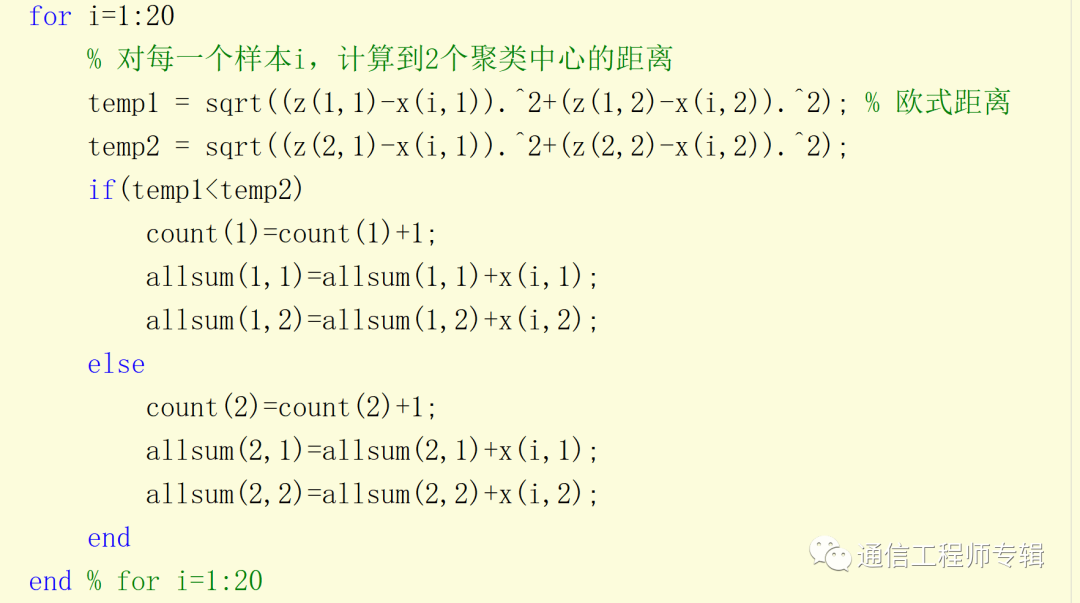

2)计算数据集中所有的样本到这k个中心点的距离(哪几种距离),并将样本点归到离其最近的聚类里。

3)将聚类的中心点移动到各类的几何中心(即平均值)处。

4)重复第2步直到聚类的中心不再移动,此时算法收敛或者迭代的次数达到上限。

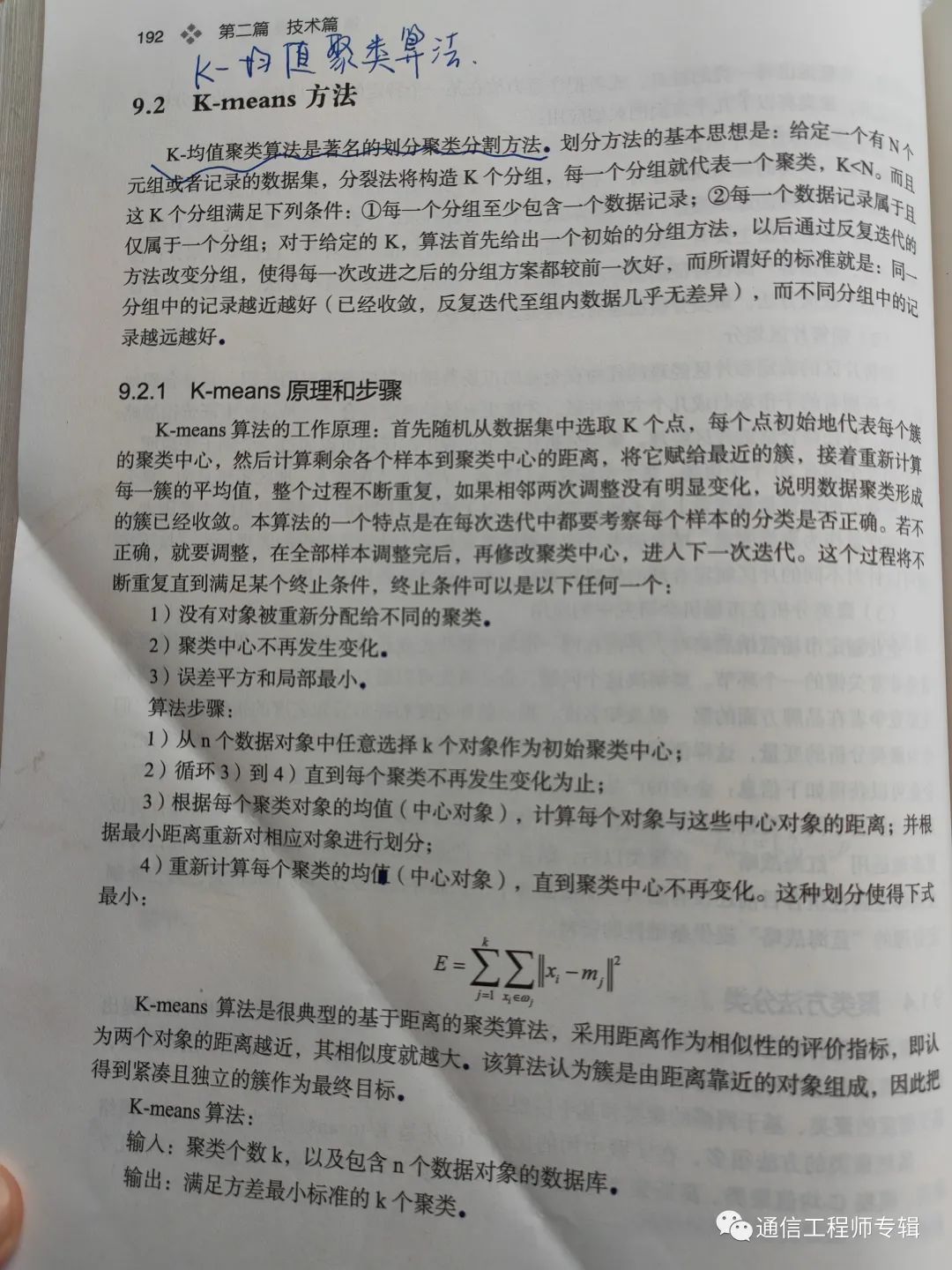

推荐一本好书!在这方面讲的非常好!照片为证!

仔细看看!

距离!

将样本点分到距离聚类中心最近的那个簇中需要最近邻的度量策略,在欧式空间中采用的是欧式距离,在处理文档中采用的是余弦相似度函数,有时候也采用曼哈顿距离作为度量,不同的情况使用的度量公式是不同的。

原文标题:大学课程 数据分析 实战之K-means算法(1)理论讲解

-

通信网络

+关注

关注

21文章

2041浏览量

52056

原文标题:大学课程 数据分析 实战之K-means算法(1)理论讲解

文章出处:【微信号:gh_30373fc74387,微信公众号:通信工程师专辑】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

大学课程 数据分析 实战之K-means算法(1)理论讲解

大学课程 数据分析 实战之K-means算法(1)理论讲解

评论