英伟达GTC:ChatGPT专用Hopper GPU H100 NVL来了

ChatGPT 一经推出火爆程度让人咋舌,似乎一夜之间就将生成式 AI、大语言模型推到了风口浪尖。英伟达估计也要笑出声来,黄仁勋预计英伟达2023年的生成式人工智能的收入将相当大,人工智能及其基础设施即服务(infrastructure as-a-service)产品将拓展其商业模式。

要之前此前NVIDIA就已经入局,在2016年,NVIDIA就向OpenAI交付了第一台NVIDIA DGX AI超级计算机——支持 ChatGPT 的大型语言模型突破背后的引擎。现在GPT-4需要的算力更大,对速度需求更强烈。

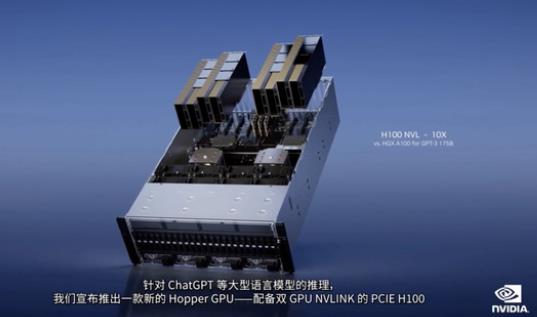

现在英伟达面向人工智能及其基础设施强发力,GPU提速,ChatGPT专用Hopper GPU H100 NVL性能强大,ChatGPT专用GPU可提速10倍,H100 NVL是专门为LLM设计的GPU,采用了Transformer加速解决方案,可用于处理ChatGPT。相比于英伟达HGX A100,一台搭载四对H100和双NVLINK的标准服务器速度能快10倍,可以将大语言模型的处理成本降低一个数量级。

-

gpu

+关注

关注

28文章

4729浏览量

128890 -

AI

+关注

关注

87文章

30728浏览量

268886 -

英伟达

+关注

关注

22文章

3770浏览量

90986 -

gtc

+关注

关注

0文章

73浏览量

4425 -

ChatGPT

+关注

关注

29文章

1558浏览量

7595 -

H100

+关注

关注

0文章

31浏览量

287

发布评论请先 登录

相关推荐

英伟达GTC:ChatGPT专用Hopper GPU H100 NVL来了

英伟达GTC:ChatGPT专用Hopper GPU H100 NVL来了

评论