向大家分享一篇新出的CVPR 2023论文,研究方向是人脸识别系统的对抗攻击。看了这篇文章你可能会立刻关闭你手机里和人脸识别相关的敏感应用,比如支付。

▌Towards Effective Adversarial Textured 3D Meshes on Physical Face Recognition

论文作者:Xiao Yang,Chang Liu,Longlong Xu,Yikai Wang,Yinpeng Dong,Ning Chen,Hang Su,Jun Zhu

作者单位:清华大学;北京大学; RealAI; Zhongguancun Laboratory

论文链接:http://arxiv.org/abs/2303.15818v1

人脸识别,安全吗?

目前人脸识别技术的应用越来越广了,门禁、监控、手机解锁、移动支付让我们享受到了人脸识别技术带给我们的便利性。

即使是最名不见经传的人脸识别解决方案提供商,也声称人脸识别准确率99%以上,但它真的足够安全吗?

对人脸识别系统的攻击,可以分为两大方面:

逃避识别:张三不想在视频中被识别出来;

引导系统误识别:张三故意让系统把自己识别为李四。

一种直观的想法是,我就打印一张人脸图片贴在脸上,嗯,做黑产的人就是这么想的,这就是人脸识别系统的物理攻击。

不过现有的人脸识别系统均配有人脸活体检测等反欺诈技术,低端的物理攻击已经不太奏效。

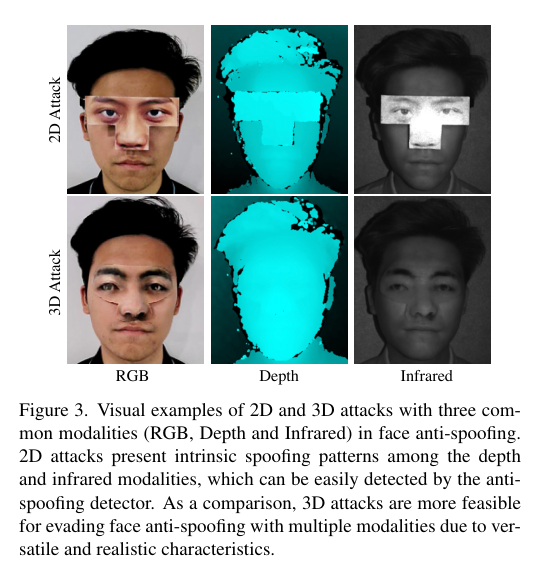

2D和3D攻击对比

如上图中打印一张人脸纹理纸贴脸上,这种人看起来怪怪的操作,早期也是可以让人脸识别系统陷入错误的,但在有类似深度信息和红外信息的反欺诈系统面前,特征就太明显了。

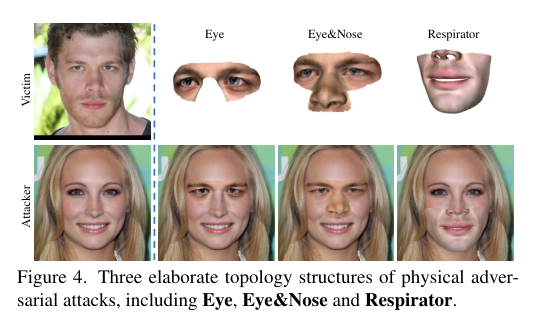

所以3D攻击就出现了,通过打印制作一个遮盖”眼鼻“的面罩,迷惑系统。如下图:

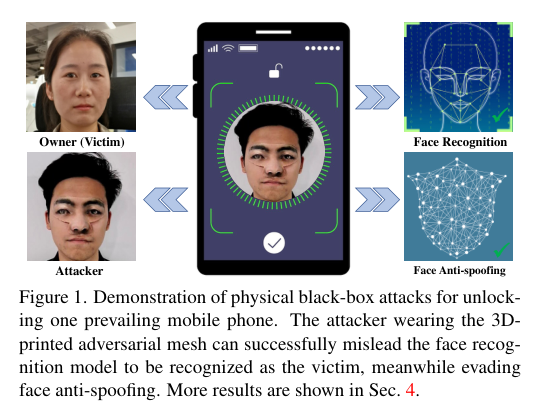

这就是今天介绍的论文Towards Effective Adversarial Textured 3D Meshes on Physical Face Recognition的研究内容:如何设计更好的3D面罩,攻破人脸识别系统,实验结果显示,现有的人脸识别系统在这种物理攻击面前”溃不成军“。

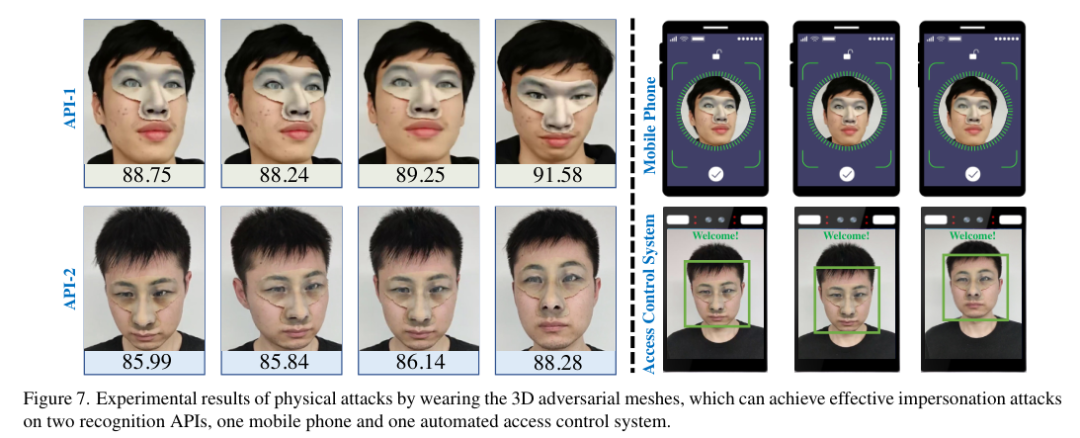

特别需要注意的是,清华、北大的这篇论文,不是仅仅在实验室里自己搭建了一套人脸识别系统,自己的矛攻自己的盾,而是对商用系统进行攻击。

攻击原理

通过上面的介绍,我们已经知道,攻击的技术核心变为,打印什么样的3D面罩了。

无论是上面的哪一种攻击,其实最终都是要迷惑系统,让系统把攻击者误识别为他人。直接打印一张包含其他人(我们称他/她为”受害者“吧)的人脸纹理的面罩?这看起来好像可以试一试,但复杂的光照、变化的姿态表情是影响身份识别的。

这篇论文提供了更”好“的方法,总结起来就是:针对人脸识别系统,端到端”设计“3D面罩,然后3D打印出来。

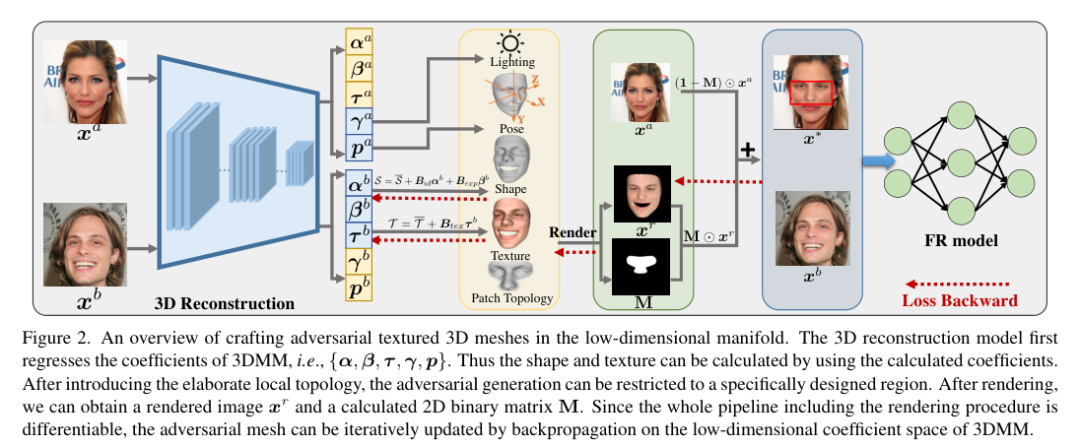

请看下图:

”攻击者“和”受害者“的人脸图片首先使用3DMM算法进行人脸重建,其得到的系数,定义了人脸的形状、姿态、纹理等,即一套系数就是一张特定的人脸。训练的时候是调整这套系数对人脸特定区域(眼鼻部位)进行建模,得到一个3D网格,这个3D网格渲染后”戴到“攻击者的人脸图像上,然后把这张图片和受害者的图片输入给人脸识别系统,人脸识别部分的loss反向指导系统参数的更新。

很明显这个3D网格就是端到端设计出来的3D面罩。

论文中称,训练时所有步骤都是端到端可微的,包括渲染。

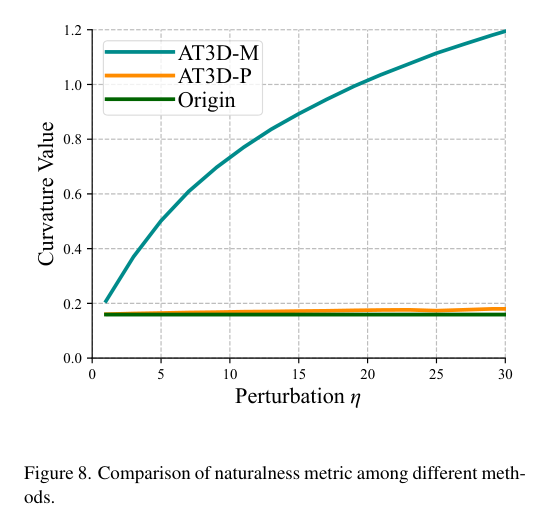

当然,我们是否可以不用对人脸进行3D重建,不在这套系数上更新参数呢?当然是可以的,但论文中称,在3DMM空间中进行参数更新,相当于正则化,而且实验证明,效果是又快又好!(有没有更好的,针对人脸系统攻击的人脸3D重建方法,也许是值得探索的方向)

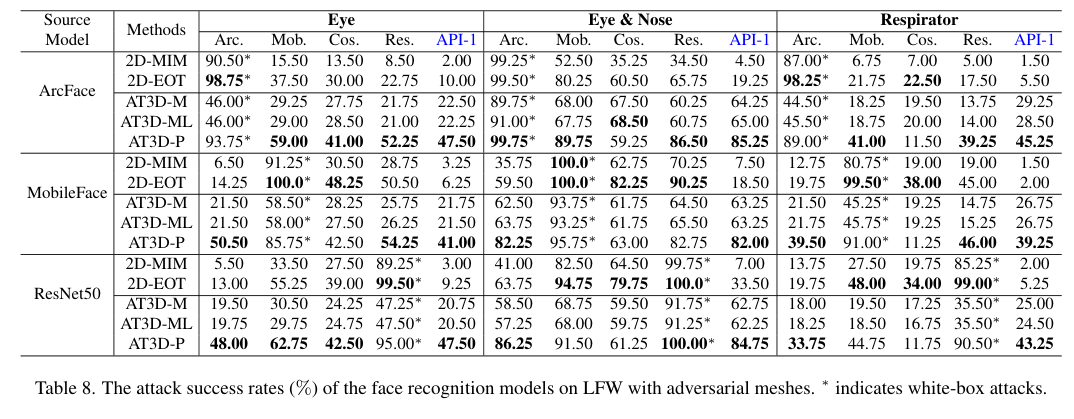

另外,为什么选择的是人脸的”眼鼻“部位呢?其实作者分析并试验了眼睛、眼鼻、整个脸下半部,发现眼鼻是攻击效果最好的。这好像也不难理解,眼鼻部位受人脸表情影响比较小,而且几乎没有什么局部变化。

实验结果

实验结果是惊人的。

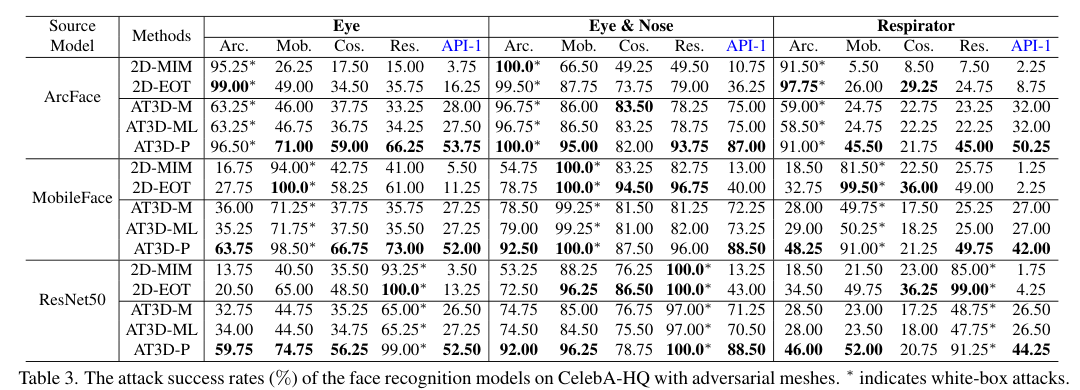

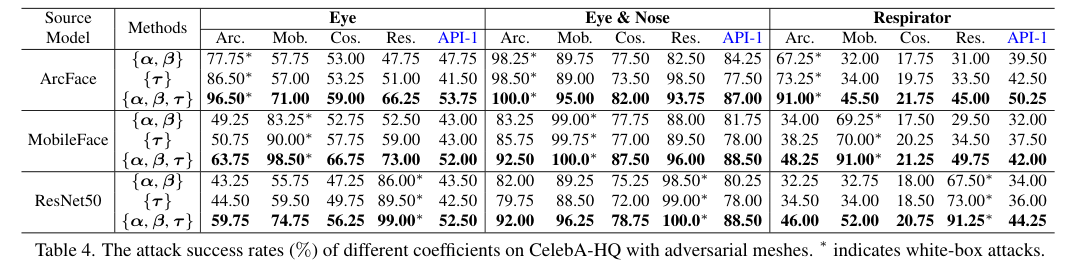

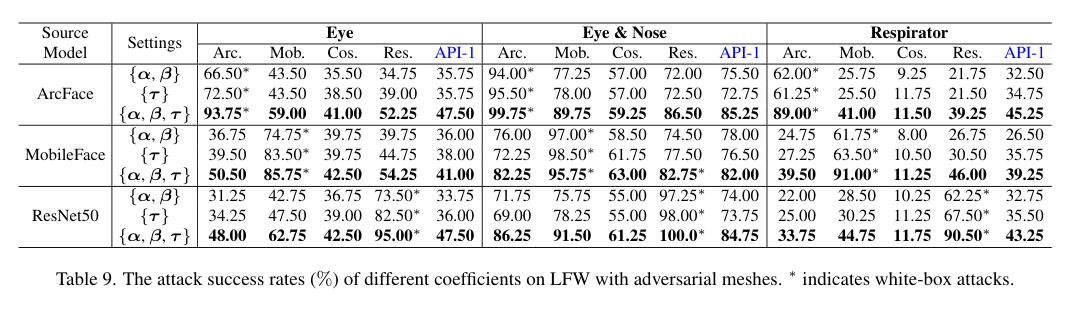

作者们公布了其在主流的公开的人脸识别算法(ArcFaceMobileFace等)上的攻击结果,几乎全部都能实现80%攻击成功率,部分情况100%攻击成功。

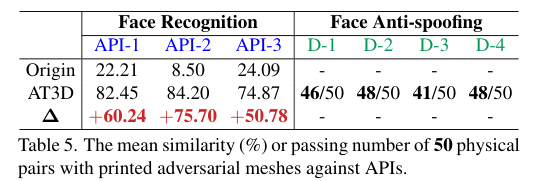

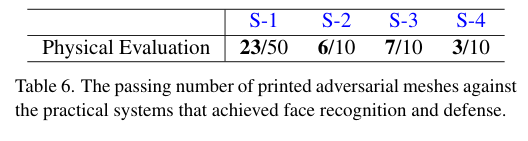

在商用系统上的攻击结果依然”触目惊心“。包括三个识别API、四个反欺诈API、两个流行的手机和两个自动门禁系统。

因为比较敏感,本文不会提及作者选择的商用系统的名字,感兴趣的朋友可以去读读论文。

希望这样的研究,能被更多技术开发人员了解,促进人脸识别技术的应用成熟,看来要走的路还很长!

审核编辑 :李倩

-

API

+关注

关注

2文章

1499浏览量

61985 -

网格

+关注

关注

0文章

139浏览量

16015 -

人脸识别

+关注

关注

76文章

4012浏览量

81877

发布评论请先 登录

相关推荐

基于labview的人脸识别系统的设计………………

【LeMaker Guitar申请】基于LeMaker Guitar的人脸识别系统

浅谈人脸识别系统在智慧社区方面的应用

LabVIEW人脸识别设计

人脸识别系统的安装

基于CBIR技术的手机人脸识别系统设计

人脸识别路漫漫:清华、北大等提出AT3D人脸识别系统攻击方法

人脸识别路漫漫:清华、北大等提出AT3D人脸识别系统攻击方法

评论