近日,由魔芯科技、浙江大学、湖州师范学院、新加坡科技设计大学(SUTD)、北京航空航天大学等多单位联合发表学术论文,发现了SAM这一通用大模型在部分下游任务上的性能表现不佳,并首次提出了将任务特定知识和大模型SAM学到的通用知识和在下游任务中结合,进行适应调优(而非重新训练)的方法。研究提出了一个轻量的adapter框架将这些任务相关的知识输入进SAM中,以实现SAM在下游任务的针对性应用。该论文的代码已经在GitHub上开源。

主页:https://tianrun-chen.github.io/SAM-Adaptor/ 代码(已开源):https://github.com/tianrun-chen/SAM-Adaptor-PyTorch 论文:https://arxiv.org/abs/2304.09148

这项研究成果开辟了利用大型预训练图像模型在不同领域和工业应用中进行各种下游分割任务研究的新时代。它为研究人员和从业者提供了有价值的见解,展示了如何利用内部知识和外部控制信号来适应预训练模型,以在具有挑战性的任务中实现最先进的性能。该研究成果还为医学图像处理、自然科学、农牧业、遥感等领域的应用提供了新思路。

人工智能研究已经见证了一个由大规模海量数据上训练的模型所带来的范式上的转变。这些模型,或称为基础模型,如BERT、DALL-E和GPT-3,已经在许多语言或视觉任务中显示出有优秀的结果。

在这些基础模型中,Segment Anything Model(SAM)作为一个在大型视觉语料库上训练的通用图像分割模型取得了显著的突破。事实证明,SAM在不同的场景下具有成功的分割能力,这使得它在图像分割和计算机视觉的相关领域迈出了突破性的一步。

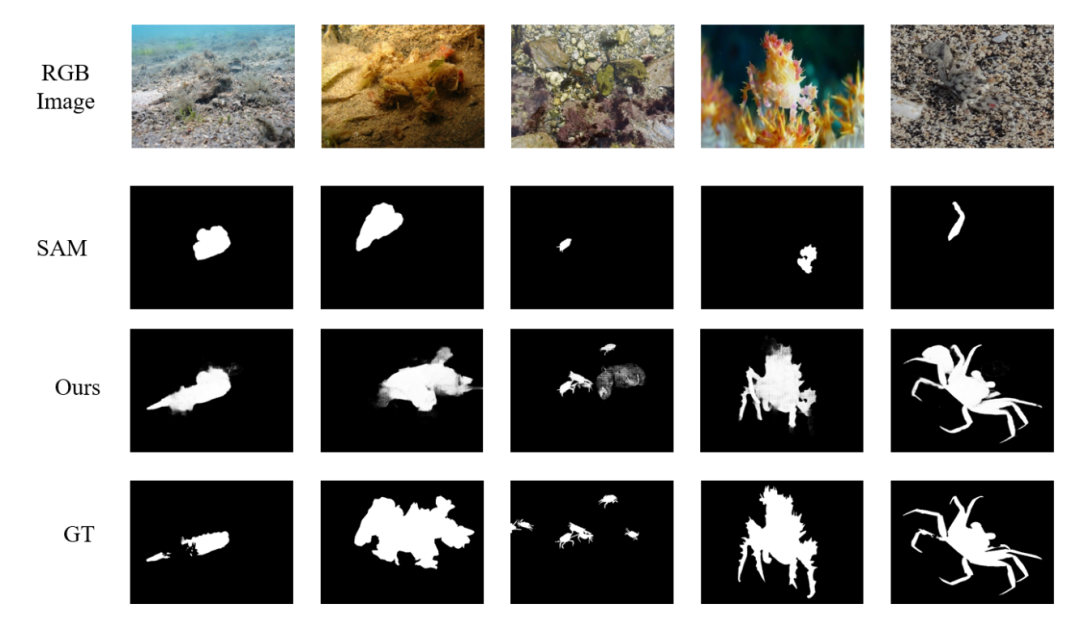

然而,由于计算机视觉包含了广泛的问题,SAM的不完整性是显而易见的,这与其他基础模型类似,因为训练数据不能包含整个语料库,工作场景也会有变化。在本研究中,作者首先在一些具有挑战性的低层次结构分割任务中测试SAM,包括伪装物体检测(隐蔽场景)和阴影检测,作者发现在一般图像上训练的SAM模型在这些情况下不能完美地 "分割任何东西",包括影子检测、伪装物体检测等。

因此,一个关键的研究问题是:如何高效利用大型模型从大规模语料库中获得的能力,并利用它们使下游的任务受益?

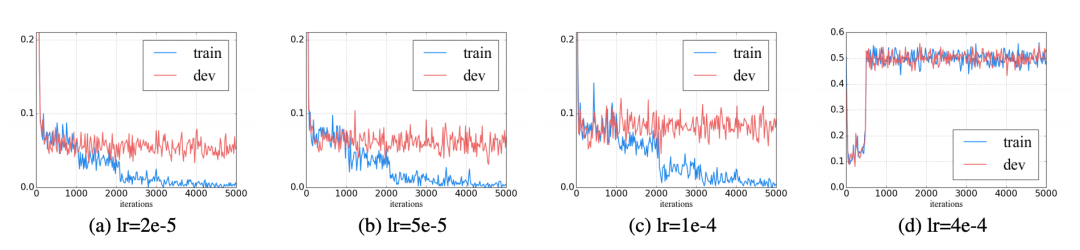

在这项工作中,来自魔芯科技、浙江大学、新加坡科技设计大学等单位的研究者提出了SAM-adapter,它是一个针对上述研究问题的优秀解决方案。这项开创性的工作首次尝试将大型预训练的图像分割一切模型SAM适应于特定的下游任务,并提高其性能。正如其名,SAM-adapter是一种非常简单而有效的适应技术,可以同时利用来自大模型的内部知识和针对下游任务设定的外部控制信号。在该方法中,信息是通过视觉提示传达给网络的,这已被证明了在用最少的额外可训练参数,能高效地将一个冻结的大基础模型适应到许多下游任务工作。

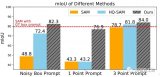

图:SAM-Adapter (Ours) 在伪装物体检测上的性能测试

这项工作率先证明了大规模海量数据训练给SAM带来的特殊能力可以被应用到其他数据领域。SAM-Adapter可以被用作这样的迁移。作者在影子检测、伪装物体检测等任务的数据上实现了超过已有算法的高性能(SOTA)表现。未来,我们相信SAM-Adapter作为一个通用框架,可以被应用于更多不同领域的各种下游分割任务中,包括在医学影像诊断、农业、工业检测等不同领域。

审核编辑 :李倩

-

人工智能

+关注

关注

1819文章

50290浏览量

266842 -

SAM

+关注

关注

0文章

118浏览量

34452

原文标题:SAM无法分割一切?SAM-Adapter:首次让SAM在下游任务适应调优!

文章出处:【微信号:CVer,微信公众号:CVer】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

关于PSAM卡和SAM卡作用

【AT91SAM9261申请】基于AT91SAM9261评估套件的物联网系统

基于AT91SAM9G35 SAM9G35 MCU ARM9系列的评估套件AT91SAM9G35-EK

基于AT91SAM9G25 SAM9G25 MCU ARM9系列的评估板AT91SAM9G25-EK

如何让Bert模型在下游任务中提高性能?

从SAM9x5移植到SAM9X60

SAM卡读写芯片

SAM 到底是什么

一种新的分割模型Stable-SAM

SAM-Adapter:首次让SAM在下游任务适应调优!

SAM-Adapter:首次让SAM在下游任务适应调优!

评论