1、Rx Sensitivity(接收灵敏度)

接收灵敏度,这应该是最基本的概念之一,表征的是接收机能够在不超过一定误码率的情况下识别的最低信号强度。这里说误码率,是沿用CS(电路交换)时代的定义作一个通称,在多数情况下,BER (bit error rate)或者PER (packet error rate)会用来考察灵敏度,在LTE时代干脆用吞吐量Throughput来定义——因为LTE干脆没有电路交换的语音信道,但是这也是一个实实在在的进化,因为第一次我们不再使用诸如12.2kbps RMC(参考测量信道,实际代表的是速率12.2kbps的语音编码)这样的"标准化替代品"来衡量灵敏度,而是以用户可以实实在在感受到的吞吐量来定义之。

2、SNR(信噪比)

讲灵敏度的时候我们常常联系到SNR(信噪比,我们一般是讲接收机的解调信噪比),我们把解调信噪比定义为不超过一定误码率的情况下解调器能够解调的信噪比门限(面试的时候经常会有人给你出题,给一串NF、Gain,再告诉你解调门限要你推灵敏度)。那么S和N分别何来?

S即信号Signal,或者称为有用信号;N即噪声Noise,泛指一切不带有有用信息的信号。有用信号一般是通信系统发射机发射出来,噪声的来源则是非常广泛的,最典型的就是那个著名的-174dBm/Hz——自然噪声底,要记住它是一个与通信系统类型无关的量,从某种意义上讲是从热力学推算出来的(所以它跟温度有关);另外要注意的是它实际上是个噪声功率密度(所以有dBm/Hz这个量纲),我们接收多大带宽的信号,就会接受多大带宽的噪声——所以最终的噪声功率是用噪声功率密度对带宽积分得来。

3、TxPower(发射功率)

发射功率的重要性,在于发射机的信号需要经过空间的衰落之后才能到达接收机,那么越高的发射功率意味着越远的通信距离。

那么我们的发射信号要不要讲究SNR?譬如说,我们的发射信号SNR很差,那么到达接收机的信号SNR是不是也很差?

这个牵涉到刚才讲过的概念,自然噪声底。我们假设空间的衰落对信号和噪声都是效果相同的(实际上不是,信号能够通编码抵御衰落而噪声不行)而且是如同衰减器一般作用的,那么我们假设空间衰落-200dB,发射信号带宽1Hz,功率50dBm,信噪比50dB,接收机收到信号的SNR是多少?

接收机收到信号的功率是50-200=-150Bm(带宽1Hz),而发射机的噪声50-50=0dBm通过空间衰落,到达接收机的功率是0-200=-200dBm(带宽1Hz)?这时候这部分噪声早已被"淹没"在-174dBm/Hz的自然噪声底之下了,此时我们计算接收机入口的噪声,只需要考虑-174dBm/Hz的"基本成分"即可。这在通信系统的绝大部分情况下是适用的。

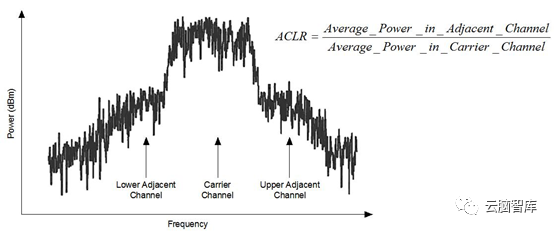

4、ACLR/ACPR

我们把这些项目放在一起,是因为它们表征的实际上是"发射机噪声"的一部分,只是这些噪声不是在发射信道之内,而是发射机泄漏到临近信道中去的部分,可以统称为"邻道泄漏"。

其中ACLR和ACPR(其实是一个东西,不过一个是在终端测试中的叫法,一个是在基站测试中的叫法罢了),都是以"Adjacent Channel"命名,顾名思义,都是描述本机对其他设备的干扰。而且它们有个共同点,对干扰信号的功率计算也是以一个信道带宽为计。这种计量方法表明,这一指标的设计目的,是考量发射机泄漏的信号,对相同或相似制式的设备接收机的干扰——干扰信号以同频同带宽的模式落到接收机带内,形成对接收机接收信号的同频干扰。

在LTE中,ACLR的测试有两种设置,EUTRA和UTRA,前者是描述LTE系统对LTE系统的干扰,后者是考虑LTE系统对UMTS系统的干扰。所以我们可以看到EUTRAACLR的测量带宽是LTE RB的占用带宽,UTRA ACLR的测量带宽是UMTS信号的占用带宽(FDD系统3.84MHz,TDD系统1.28MHz)。换句话说,ACLR/ACPR描述的是一种"对等的"干扰:发射信号的泄漏对同样或者类似的通信系统发生的干扰。

这一定义是有非常重要的实际意义的。实际网络中同小区邻小区还有附近小区经常会有信号泄漏过来,所以网规网优的过程实际上就是容量最大化和干扰最小化的过程,而系统本身的邻道泄漏对于邻近小区就是典型的干扰信号;从系统的另一个方向来看,拥挤人群中用户的手机也可能成为互相的干扰源。

同样的,在通信系统的演化中,从来是以"平滑过渡"为目标,即在现有网络上升级改造进入下一代网络。那么两代甚至三代系统共存就需要考虑不同系统之间的干扰,LTE引入UTRA即是考虑了LTE在与UMTS共存的情形下对前代系统的射频干扰。

5、调制频谱/开关频谱

而退回到GSM系统,Modulation Spectrum(调制谱)和Switching Spectrum(切换谱,也有称为开关谱的,对舶来品不同翻译的缘故)也是扮演了邻道泄漏相似的角色。不同的是它们的测量带宽并不是GSM信号的占用带宽。从定义上看,可以认为调制谱是衡量同步系统之间的干扰,而切换谱是衡量非同步系统之间的干扰(事实上如果不对信号做gating,切换谱一定是会把调制谱淹没掉的)。

这就牵涉到另一个概念:GSM系统中,各小区之间是不同步的,虽然它用的是TDMA;而相比之下,TD-SCDMA和之后的TD-LTE,小区之间是同步的(那个飞碟形状或者球头的GPS天线永远是TDD系统摆脱不了的桎梏)。

因为小区间不同步,所以A小区上升沿/下降沿的功率泄漏可能落到B小区的payload部分,所以我们用切换谱来衡量此状态下发射机对邻信道的干扰;而在整个577us的GSM timeslot里,上升沿/下降沿的占比毕竟很少,多数时候两个相邻小区的payload部分会在时间上交叠,评估这种情况下发射机对邻信道的干扰就可以参考调制谱。

6、SEM(光谱发射掩模)

讲SEM的时候,首先要注意它是一个"带内指标",与spurious emission区分开来,后者在广义上是包含了SEM的,但是着重看的其实是发射机工作频段之外的频谱泄漏,其引入也更多的是从EMC(电磁兼容)的角度。

SEM是提供一个"频谱模版",然后在测量发射机带内频谱泄漏的时候,看有没有超出模版限值的点。可以说它与ACLR有关系,但是又不相同:ACLR是考虑泄漏到邻近信道中的平均功率,所以它以信道带宽为测量带宽,它体现的是发射机在邻近信道内的"噪声底";SEM反映的是以较小的测量带宽(往往100kHz到1MHz)捕捉在邻近频段内的超标点,体现的是"以噪声底为基础的杂散发射"。

如果用频谱仪扫描SEM,可以看到邻信道上的杂散点会普遍的高出ACLR均值,所以如果ACLR指标本身没有余量,SEM就很容易超标。反之SEM超标并不一定意味着ACLR不良,有一种常见的现象就是有LO的杂散或者某个时钟与LO调制分量(往往带宽很窄,类似点频)串入发射机链路,这时候即便ACLR很好,SEM也可能超标。

7、EVM(误差矢量)

首先,EVM是一个矢量值,也就是说它有幅度和角度,它衡量的是"实际信号与理想信号的误差",这个量度可以有效的表达发射信号的"质量"——实际信号的点距离理想信号越远,误差就越大,EVM的模值就越大。

在(一)中我们曾经解释过为什么发射信号的信噪比不是那么重要,原因有二:第一是发射信号的SNR往往远远高于接收机解调所需要的SNR;第二是我们计算接收灵敏度时参考的是接收机最恶劣的情况,即在经过大幅度空间衰落之后,发射机噪声早已淹没在自然噪声底之下,而有用信号也被衰减到接收机的解调门限附近。

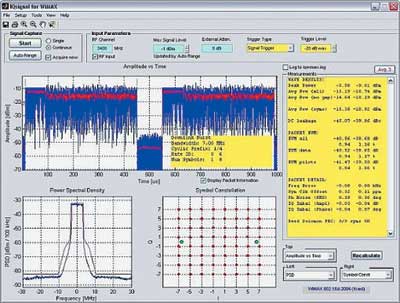

但是发射机的"固有信噪比"在某些情况下是需要被考虑的,譬如近距离无线通信,典型的如802.11系列。

802.11系列演进到802.11ac的时候,已经引入了256QAM的调制,对于接收机而言,即便不考虑空间衰落,光是解调这样高阶的正交调制信号就已经需要很高的信噪比,EVM越差,SNR就越差,解调难度就越高。

做802.11系统的工程师,往往用EVM来衡量Tx线性度;而做3GPP系统的工程师,则喜欢用ACLR/ACPR/Spectrum来衡量Tx线性性能。

从起源上讲,3GPP是蜂窝通信的演进道路,从一开始就不得不关注邻信道、隔信道(adjacent channel, alternative channel)的干扰。换句话说,干扰是影响蜂窝通信速率的第一大障碍,所以3GPP在演进的过程中,总是以"干扰最小化"为目标的:GSM时代的跳频,UMTS时代的扩频,LTE时代RB概念的引入,都是如此。

而802.11系统是固定无线接入的演进,它是秉承TCP/IP协议精神而来,以"尽最大能力的服务"为目标,802.11中经常会有时分或者跳频的手段来实现多用户共存,而布网则比较灵活(毕竟以局域网为主),信道宽度也灵活可变。总的来说它对干扰并不敏感(或者说容忍度比较高)。

通俗的讲,就是蜂窝通信的起源是打电话,打不通电话用户会去电信局砸场子;802.11的起源是局域网,网络不好大概率是先耐着性子等等(其实这时候设备是在作纠错和重传)。

这就决定了3GPP系列必然以ACLR/ACPR一类"频谱再生"性能为指标,而802.11系列则可以以牺牲速率来适应网络环境。

具体说来,"以牺牲速率来适应网络环境",就是指的802.11系列中以不同的调制阶数来应对传播条件:当接收机发现信号差,就立即通知对面的发射机降低调制阶数,反之亦然。 前面提到过,802.11系统中SNR与EVM相关很大,很大程度上EVM降低可以提高SNR。 这样我们就有两种途径改善接收性能:一是降低调制阶数,从而降低解调门限; 二是降低发射机EVM,使得信号SNR提高。

因为EVM与接收机解调效果密切相关,所以802.11系统中以EVM来衡量发射机性能(类似的,3GPP定义的蜂窝系统中,ACPR/ACLR是主要影响网络性能的指标); 又因为发射机对EVM的恶化主要因为非线性引起(譬如PA的AM-AM失真),所以EVM通常作为衡量发射机线性性能的标志。

7.1、EVM与ACPR/ACLR的关系

很难定义EVM与ACPR/ACLR的定量关系,从放大器的非线性来看,EVM与ACPR/ACLR应该是正相关的:放大器的AM-AM、AM-PM失真会扩大EVM,同时也是ACPR/ACLR的主要来源。

但是EVM与ACPR/ACLR并不总是正相关,我们这里可以找到一个很典型的例子:数字中频中常用的Clipping,即削峰。 Clipping是削减发射信号的峰均比(PAR),峰值功率降低有助于降低通过PA之后的ACPR/ACLR; 但是Clipping同时会损害EVM,因为无论是限幅(加窗)还是用滤波器方法,都会对信号波形产生损伤,因而增大EVM。

7.2、PAR的源流

PAR(信号峰均比)通常用CCDF这样一个统计函数来表示,其曲线表示的是信号的功率(幅度)值和其对应的出现概率。 譬如某个信号的平均功率是10dBm,它出现超过15dBm功率的统计概率是0.01%,我们可以认为它的PAR是5dB。

PAR是现代通信系统中发射机频谱再生(诸如ACLP/ACPR/Modulation Spectrum)的重要影响因素。峰值功率会将放大器推入非线性区从而产生失真,往往峰值功率越高、非线性越强。

在GSM时代,因为GMSK调制的衡包络特性,所以PAR=0,我们在设计GSM功放的时候经常把它推到P1dB,以得到最大限度的效率。引入EDGE之后,8PSK调制不再是衡包络,因此我们往往将功放的平均输出功率推到P1dB以下3dB左右,因为8PSK信号的PAR是3.21dB。

UMTS时代,无论WCDMA还是CDMA,峰均比都比EDGE大得多。原因是码分多址系统中信号的相关性:当多个码道的信号在时域上叠加时,可能出现相位相同的情况,此时功率就会呈现峰值。

LTE的峰均比则是源自RB的突发性。OFDM调制是基于将多用户/多业务数据在时域上和频域上都分块的原理,这样就可能在某一"时间块"上出现大功率。LTE上行发射用SC-FDMA,先用DFT将时域信号扩展到频域上,等于"平滑"掉了时域上的突发性,从而降低了PAR。

8、干扰指标汇总

这里的"干扰指标",指的是出了接收机静态灵敏度之外,各种施加干扰下的灵敏度测试。实际上研究这些测试项的由来是很有意思的。

我们常见的干扰指标,包括Blocking,Desense,Channel Selectivity等。

8.1、Blocking(阻塞)

Blocking实际上是一种非常古老的RF指标,早在雷达发明之初就有。其原理是以大信号灌入接收机(通常最遭殃的是第一级LNA),使得放大器进入非线性区甚至饱和。此时一方面放大器的增益骤然变小,另一方面产生极强非线性,因而对有用信号的放大功能就无法正常工作了。

另一种可能的Blocking其实是通过接收机的AGC来完成的:大信号进入接收机链路,接收机AGC因此产生动作降低增益以确保动态范围;但是同时进入接收机的有用信号电平很低,此时增益不足,进入到解调器的有用信号幅度不够。

Blocking指标分为带内和带外,主要是因为射频前端一般会有频带滤波器,对于带外blocking会有抑制作用。但是无论带内还是带外,Blocking信号一般都是点频,不带调制。事实上完全不带调制的点频信号在现实世界里并不多见,工程上只是把它简化成点频,用以(近似)替代各种窄带干扰信号。

对于解决Blocking,主要是RF出力,说白了就是把接收机IIP3提高,动态范围扩大。对于带外Blocking,滤波器的抑制度也是很重要的。

8.2、AM Suppression

AM Suppression是GSM系统特有的指标,从描述上看,干扰信号是与GSM信号相似的TDMA信号,与有用信号同步且有固定delay。

这种场景是模拟GSM系统中邻近小区的信号,从干扰信号的频偏要求大于6MHz(GSM带宽200kHz)来看,这是很典型的邻近小区信号配置。所以我们可以认为AM Suppression是一个反映GSM系统实际工作中接收机对邻小区的干扰容忍度。

8.2、Adjacent (Alternative) Channel Suppression (Selectivity)

这里我们统称为"邻信道选择性"。在蜂窝系统中,我们组网除了要考虑同频小区,还要考虑邻频小区,其原因可以在我们之前讨论过的发射机指标ACLR/ACPR/Modulation Spectrum中可以找到:因为发射机的频谱再生会有很强的信号落到相邻频率中(一般来说频偏越远电平越低,所以邻信道一般是受影响最大的),而且这种频谱再生事实上是与发射信号有相关性的,即同制式的接收机很可能把这部分再生频谱误认为是有用信号而进行解调,所谓鹊巢鸠占。

举个例子:如果两个相邻小区A和B恰好是邻频小区(一般会避免这样的组网方式,这里只是讨论一个极限场景),当一台注册到A小区的终端游走到两个校区交界处,但是两个小区的信号强度还没有到切换门限,因此终端依然保持A小区连接;B小区基站发射机的ACPR较高,因此终端的接收频带内有较高的B小区ACPR分量,与A小区的有用信号在频率上重叠;因为此时终端距离A小区基站较远,因此接收到的A小区有用信号强度也很低,此时B小区ACPR分量进入到终端接收机时就可以对原有用信号造成同频干扰。

如果我们注意看邻道选择性的频偏定义,会发现有Adjacent和Alternative的区别,对应ACLR/ACPR的第一邻道、第二邻道,可见通信协议中"发射机频谱泄漏(再生)"与"接收机邻道选择性"实际上是成对定义的。

8.3、Co-Channel Suppression (Selectivity)

这种描述的是绝对的同频干扰,一般是指两个同频小区之间的干扰模式。

按照之前我们描述的组网原则,两个同频小区的距离应该尽量远,但是即便再远,也会有信号彼此泄漏,只是强度高低的区别。对于终端而言,两个校区的信号都可以认为是"正确的有用信号"(当然协议层上有一组接入规范来防范这种误接入),衡量终端的接收机能否避免"西风压倒东风",就看它的同频选择性。

8.4 总结

Blocking是"大信号干扰小信号",RF尚有周旋余地;而以上的AM Suppression, Adjacent (Co/Alternative) Channel Suppression (Selectivity)这些指标,是"小信号干扰大信号",纯RF的工作意义不大,还是靠物理层算法为主。

Single-tone Desense是CDMA系统独有的指标,它有个特点:作为干扰信号的single-tone是带内信号,而且距离有用信号很近。 这样就有可能产生两种信号落到接收频域内:第一种是由于LO的近端相噪,LO与有用信号混频形成的基带信号、和LO相噪与干扰信号混频形成的信号,都会落到接收机基带滤波器的范围之内,前者是有用的信号而后者是干扰; 第二种是由于接收机系统中的非线性,有用信号(有一定带宽,譬如1.2288MHz的CDMA信号)可能与干扰信号在非线性器件上产生交调,而交调产物有可能同样落在接收频域之内成为干扰。

Single-tone desense的起源是北美在发起CDMA系统时,与原有的模拟通信系统AMPS采用了同一频段,两张网长期共存,作为后来者的CDMA系统必须考虑AMPS系统对自身的干扰。

到这里我想起当年被称为"通则不动,动则不通"的小灵通,因为长期占用1900~1920MHz频率,所以天朝TD-SCDMA/TD-LTE B39的实施一直是在B39的低段1880~1900MHz,直到小灵通退网为止。

教科书上对Blocking的解释比较简单:大信号进入接收机放大器使得放大器进入非线性区,实际增益变小(对有用信号的)。

但是这样很难解释两种场景:

场景一:前级LNA线性增益18dB,当大信号灌入使其达到P1dB的时候,增益是17dB; 如果没有引入其他影响(默认LNA的NF等都没有发生变化),那么对整个系统的噪声系数影响其实非常有限,无非是后级NF在计入到总NF时分母变小了一点,对整个系统的灵敏度影响不大。

场景二:前级LNA的IIP3很高因此没有受影响,受影响的是第二级gain block(干扰信号使其达到P1dB附近),在这种情况下整个系统NF的影响就更小了。

我在这里抛砖引玉,提出一个观点:Blocking的影响可能分两部分,一部分是教科书上所讲的Gain受到压缩,另一部分实际上是放大器进入非线性区之后,有用信号在这个区域里发生了失真。这种失真可能包括两部分,一部分是纯粹的放大器非线性造成有用信号的频谱再生(谐波分量),另一部分是大信号调制小信号的Cross Modulation。(可以理解)

由此我们还提出另一个设想:如果我们要简化Blocking测试(3GPP要求是扫频,非常费时间),也许可以选取某些频点,这些频点出现Blocking信号时对有用信号的失真影响最大。

从直观上看,这些频点可能有:f0/N和f0*N(f0是有用信号频率,N是自然数)。前者是因为大信号在非线性区自身产生的N次谐波分量正好叠加在有用信号频率f0上形成直接干扰,后者是叠加在有用信号f0的N次谐波上进而影响到输出信号f0的时域波形——解释一下:根据帕塞瓦尔定律,时域信号的波形实际上是频域基频信号与各次谐波的总和,当频域上N次谐波的功率发生变化时,时域上对应的变化就是时域信号的包络变化(发生了失真)。

9、动态范围,温度补偿与功率控制

动态范围,温度补偿和功率控制很多情况下是"看不到"的指标,只有在进行某些极限测试的时候才会表现出它们的影响,但是本身它们却体现着RF设计中最精巧的部分。

9.1、发射机动态范围

发射机动态范围表征的是发射机"不损害其他发射指标前提下"的最大发射功率和最小发射功率。

"不损害其他发射指标"显得很宽泛,如果看主要影响,可以理解为:最大发射功率下不损害发射机线性度,最小发射功率下保持输出信号信噪比。

最大发射功率下,发射机输出往往逼近各级有源器件(尤其末级放大器)的非线性区,由此经常发生的非线性表现有频谱泄漏和再生(ACLR/ACPR/SEM),调制误差(PhaseError/EVM)。此时最遭殃的基本上都是发射机线性度,这一部分应该比较好理解。

最小发射功率下,发射机输出的有用信号则是逼近发射机噪声底,甚至有被"淹没"在发射机噪声中的危险。 此时需要保障的是输出信号的信噪比(SNR),换句话说就是在最小发射功率下的发射机噪声底越低越好。

在实验室曾经发生过一件事情:有工程师在测试ACLR的时候,发现功率降低ACLR反而更差(正常理解是ACLR应该随着输出功率降低而改善),当时第一反应是仪表出问题了,但是换一台仪表测试结果依然如此。 我们给出的指导意见是测试低输出功率下的EVM,发现EVM性能很差; 我们判断可能是RF链路入口处的噪声底就很高,对应的SNR显然很差,ACLR的主要成分已经不是放大器的频谱再生、而是通过放大器链路被放大的基带噪声。

9.2、接收机动态范围

接收机动态范围其实与之前我们讲过的两个指标有关,第一个是参考灵敏度,第二个是接收机IIP3(在讲干扰指标的时候多次提到)。

参考灵敏度实际上表征的就是接收机能够识别的最小信号强度,这里不再赘述。 我们主要谈一下接收机的最大接收电平。

最大接收电平是指接收机在不发生失真情况下能够接收的最大信号。 这种失真可能发生在接收机的任何一级,从前级LNA到接收机ADC。 对于前级LNA,我们唯一可做的就是尽量提高IIP3,使其可以承受更高的输入功率; 对于后面逐级器件,接收机则采用了AGC(自动增益控制)来确保有用信号落在器件的输入动态范围之内。 简单的说就是有一个负反馈环路:检测接收信号强度(过低/过高)-调整放大器增益(调高/调低)-放大器输出信号确保落在下一级器件的输入动态范围之内。

这里我们讲一个例外:多数手机接收机的前级LNA本身就带有AGC功能,如果你仔细研究它们的datasheet,会发现前级LNA会提供几个可变增益段,每个增益段有其对应的噪声系数,一般来讲增益越高、噪声系数越低。 这是一种简化的设计,其设计思想在于:接收机RF链路的目标是将输入到接收机ADC的有用信号保持在动态范围之内,且保持SNR高于解调门限(并不苛求SNR越高越好,而是"够用就行",这是一种很聪明的做法)。 因此当输入信号很大时,前级LNA降低增益、损失NF、同时提高IIP3; 当输入信号小时,前级LNA提高增益、减小NF、同时降低IIP3。

9.3、温度补偿

一般来讲,我们只在发射机作温度补偿。

当然,接收机性能也是受到温度影响的:高温下接收机链路增益降低,NF增高; 低温下接收机链路增益提高,NF降低。 但是由于接收机的小信号特性,无论增益还是NF的影响都在系统冗余范围之内。

对于发射机温度补偿,也可以细分为两部分:一部分是对发射信号功率准确度的补偿,另一部分是对发射机增益随温度变化进行补偿。

现代通信系统发射机一般都进行闭环功控(除了略为"古老"的GSM系统和Bluetooth系统),因此经过生产程序校准的发射机,其功率准确度事实上取决于功控环路的准确度。 一般来讲功控环路是小信号环路,且温度稳定性很高,所以对其进行温度补偿的需求并不高,除非功控环路上有温度敏感器件(譬如放大器)。

对发射机增益进行温度补偿则更加常见。 这种温度补偿常见的有两种目的:一种是"看得见的",通常对没有闭环功控的系统(如前述GSM和Bluetooth),这类系统通常对输出功率精确度要求不高,所以系统可以应用温度补偿曲线(函数)来使RF链路增益保持在一个区间之内,这样当基带IQ功率固定而温度发生变化时,系统输出的RF功率也能保持在一定范围之内; 另一种是"看不见的",通常是在有闭环功控的系统中,虽然天线口的RF输出功率是由闭环功控精确控制的,但是我们需要保持DAC输出信号在一定范围内(最常见的例子是基站发射系统数字预失真(DPD)的需要),那么我们就需要将整个RF链路的增益比较精确的控制在某个值左右——温补的目的就在于此。

发射机温补的手段一般有可变衰减器或者可变放大器:早期精度稍低以及低成本精度要求较低的情况下,温补衰减器比较常见; 对精度要求更高的情形下,解决方案一般是:温度传感器+数控衰减器/放大器+生产校准。

9.4 发射机功率控制

讲完动态范围和温度补偿,我们来讲一个相关的、而且非常重要的概念:功率控制。

发射机功控是大多数通信系统中必需的功能,在3GPP中常见的诸如ILPC、OLPC、CLPC,在RF设计中都是必需被测试、经常出问题、原因很复杂的。 我们首先来讲发射机功控的意义。

所有的发射机功控目的都包含两点:功耗控制和干扰抑制。

我们首先说功耗控制:在移动通信中,鉴于两端距离变化以及干扰电平高低不同,对发射机而言,只需要保持"足够让对方接收机准确解调"的信号强度即可; 过低则通信质量受损,过高则空耗功率毫无意义。 对于手机这样以电池供电的终端更是如此,每一毫安电流都需锱铢必量。

干扰抑制则是更加高级的需求。在CDMA类系统中,由于不同用户共享同一载频(而以正交用户码得以区分),因此在到达接收机的信号中,任何一个用户的信号对于其他用户而言,都是覆盖在同一频率上的干扰,若各个用户信号功率有高有高低,那么高功率用户就会淹没掉低功率用户的信号;因此CDMA系统采取功率控制的方式,对于到达接收机的不同用户的功率(我们称之为空中接口功率,简称空口功率),发出功控指令给每个终端,最终使得每个用户的空口功率一样。这种功控有两个特点:第一是功控精度非常高(干扰容限很低),第二是功控周期非常短(信道变化可能很快)。

在LTE系统中,上行功控也有干扰抑制的作用。因为LTE上行是SC-FDMA,多用户也是共享载频,彼此间也互为干扰,所以空口功率一致同样也是必需的。

GSM系统也是有功控的,GSM中我们用"功率等级"来表征功控步长,每个等级1dB,可见GSM功率控制是相对粗糙的。

干扰受限系统

这里提一个相关的概念:干扰受限系统。CDMA系统是一个典型的干扰受限系统。从理论上讲,如果每个用户码都完全正交、可以通过交织、解交织完全区分开来,那么实际上CDMA系统的容量可以是无限的,因为它完全可以在有限的频率资源上用一层层扩展的用户码区分无穷多的用户。但是实际上由于用户码不可能完全正交,因此在多用户信号解调时不可避免的引入噪声,用户越多噪声越高,直到噪声超过解调门限。

换而言之,CDMA系统的容量受限于干扰(噪声)。

GSM系统不是一个干扰受限系统,它是一个时域和频域受限的系统,它的容量受限于频率(200kHz一个载频)和时域资源(每个载频上可共享8个TDMA用户)。所以GSM系统的功控要求不高(步长较粗糙,周期较长)。

9.5 发射机功率控制与发射机RF指标

讲完发射机功控,我们进而讨论一下在RF设计中可能影响发射机功控的因素(相信很多同行都遇到过闭环功控测试不过的郁闷场景)。

对于RF而言,如果功率检测(反馈)环路设计无误,那么我们对发射机闭环功控能做的事情并不多(绝大多数工作都是由物理层协议算法完成的),最主要的就是发射机带内平坦度。

因为发射机校准事实上只会在有限的几个频点上进行,尤其在生产测试中,做的频点越少越好。 但是实际工作场景中,发射机是完全可能在频段内任一载波工作的。 在典型的生产校准中,我们会对发射机的高中低频点进行校准,意味着高中低频点的发射功率是准确的,所以闭环功控在进行过校准的频点上也是无误的。 然而,如果发射机发射功率在整个频段内不平坦,某些频点的发射功率与校准频点偏差较大,因此以校准频点为参考的闭环功控在这些频点上也会发生较大误差乃至出错。

以下是另一篇文章里提及的解释,一并分享给大家!

我们常见的射频指标很多,很多参数由于业内人士经常使用,经常用简称,但对普通电子爱好者来说就显得有些晦涩,甚至有些专有名词网上去查来查去依然是云里雾里,不知所云。

首先,我们了解下,什么是射频信号。 射频,Radio Frequency,简称RF。 那么什么样的信号叫做射频信号呢? 首先射频信号指的是模拟信号,而不是数字信号。 也就是说数字信号频率再高也不能叫射频信号。 数字信号的传输速度单位是bps(bits per second,比特每秒),Mbps(Mega bits per second,兆比特每秒),Gbps(Giga bits per second,吉比特每秒),而模拟信号或者说交流信号的频率单位为Hz、MHz、GHz。 我们假设射频信号频率下限为10MHz,数字信号可以分为低速数字信号和高速数字信号。

低速数字信号:射频≪

高速数字信号:射频≥

这样低速数字信号就可以定义为R<10Mbps,高速数字信号定义为R≥10Mbps。

由此,我们定义频率高于10MHz的交流信号为射频信号;

远小于10Mbps的数字信号为低速数字信号;

大于等于10Mbps的数字信号为高速数字信号。

1、Rx Sensitivity(接收灵敏度)

接收灵敏度,应该是射频领域中最基本的概念之一,是表示接收机能够在不超过一定误码率的情况下识别的最低信号强度。这里说误码率,是沿用GSM和WCDMA CS(Circuit Switched,电路域交换)时代的定义作一个通称。在多数情况下,BER (Bit Error Rate,误比特率)或PER (Packet Error Rate,误包率)用来考察灵敏度。而LTE用Throughput(吞吐量)来表征灵敏度,用吞吐量不低于95%的最小信号表征LTE的灵敏度。

先来看下灵敏度的计算公式:

灵敏度 = 10log10(KT0) + 10log10(BW)+NF+CNRmin

其中10log10(KT0)表示的是室温25℃的底噪-174dBm,在绝对零度-273℃时我们认为电子是不运动的,这个时候的底噪是-174dBm,室温下电子有活动了,但底噪增加的非常有限,为了计算方便,室温下的底噪还记做-174dBm。

BW:Band Width,带宽;

NF:Noise Figure,系统的噪声系数,一般指第一个低噪放的噪声系数;

CNRmin:Minimum Carrier Noise Ratio Allowed,系统解调所允许的最小载波噪声比;

以LTE 20MHz业务为例,讲解下LTE灵敏度的由来。

灵敏度(LTE) = 10log10(KT0) + 10log10(BW)+NF+CNRmin

= -174dbm + 10log10(18*10^6)+ 6db + (-1)dB

= -174dBm+72.55+6dB+(-1)dB

=-96.45dBm

BW = 18MHz for LTE 20MHz(100 RB = 100*180kHz = 18MHz)

NF = 6db(这里的NF对系统来说就是第一级LNA之前的插损加上该LNA自身的噪声系数NF)

CNRmin : -1db

2、SNR(信噪比)

第一部分讲灵敏度的时候我们多次提到过SNR,SNR就是信噪比,我们把接收机的解调信噪比定义为不超过一定误码率的情况下解调器能够解调的最低信噪比门限,S即信号Signal,或者称为有用信号;N即噪声Noise,泛指一切非有用信号的信号。有用信号是通信系统的发射机发射出来,对手机来说就是基站的发射机发出来并且通过PA放大的;而噪声的来源则是非常广泛的,最典型的就是那个著名的-174dBm/Hz——自然噪声底,要记住它是一个与通信系统类型无关的量,从某种意义上讲是从热力学推算出来的(所以它跟温度有关);另外要注意的是它实际上是个噪声功率密度(所以有dBm/Hz这个量纲),我们接收多大带宽的信号,就会接受多大带宽的噪声——所以最终的噪声功率是用噪声功率密度对带宽积分得来。

3、Tx Power(发射功率)

发射功率的重要性,在于发射机的信号需要经过空间的衰落之后才能到达接收机,那么越高的发射功率意味着越远的通信距离。那么自由空间的损耗大约是个什么数值呢?

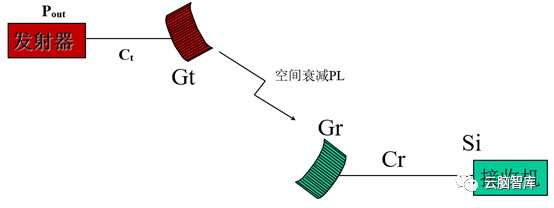

基站下行链路预算计算

接收器的信号接收强度为 :Si = Pout - Ct + Gt - PL + Gr – Cr,其中Pout表示基站发射的功率,Ct基站发射信号的链路损耗,Gt表示发射天线增益,PL表示空间损耗,Gr表示接收天线增益,Cr表示接收信号的链路损耗,Si表示接收机收到的信号。

自由空间损耗,指的是电磁波在空气中传播时候的能量损耗,电磁波在穿透任何介质的时候都会有损耗。自由空间损耗公式:空间损耗PL=20log(F)+20log(D)+32.4;F为频率,单位为MHz;D为距离,单位为Km。

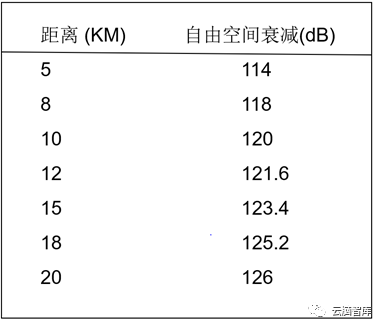

由PL=20log(F)+20log(D)+32.4,算出来:

在2.4 GHz : 空间损耗PL=32.4+20log(2400)+20logD[km]=100 +20logD[km]

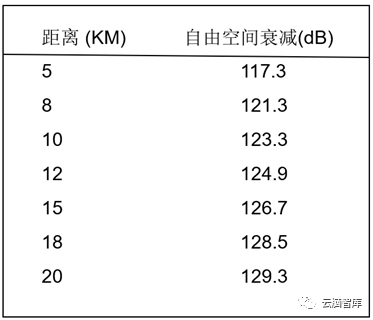

在3.5 GHz : 空间损耗PL=32.4+20log(3500)+20logD[km]=103.3 +20logD[km]

在5.8. GHz : 空间损耗PL=32.4+20log(5800)+20logD[km]=107.7 + 20 Log D[km]

2.4GHz信号的自由空间衰减值

3.5GHz信号的自由空间衰减值

LTE基站的普遍功率为40W,46dBm,假设基站部署的频率是2.4GHz,那么20公里外的信号大小只有46-126=-80dBm,依然足够手机使用;但如果是5G基站,部署在n78频段,频率是3.5GHz,那20公里以外的信号大小是多少呢?46-129.3=-83.3dBm,如果要保持和LTE基站同样的覆盖率,相应的功率就要提高3.3dB,差不多是加大一倍。

因此功率对于基站提高网络覆盖率是非常重要的,同理,保证手机端的上行功率对提高上行网络接入能力也有重要意义。

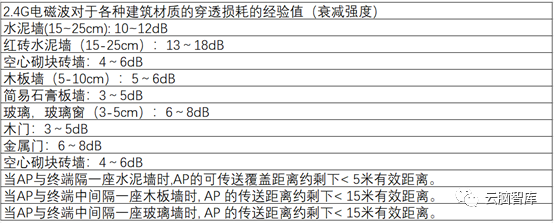

附常见的介质的衰减值参考表:

常见的介质的衰减值参考表

4、ACLR/ACPR

我们把这些项目放在一起,是因为它们表征的实际上是“发射机噪声”的一部分,只是这些噪声不是在发射信道之内,而是发射机泄漏到临近信道中去的部分,可以统称为“邻道泄漏”。其中ACLR和ACPR(其实是一个东西,不过一个是在终端测试中的叫法,一个是在基站测试中的叫法罢了,终端中的CDMA指标中也叫ACPR),都是以“Adjacent Channel”命名,顾名思义,都是描述本机对本系统本频段其他设备的干扰。而且它们有个共同点,对干扰信号的功率计算也是以一个信道带宽为计。这种计量方法表明,这一指标的设计目的,是考量发射机泄漏的信号,对相同或相似制式的设备接收机的干扰——干扰信号以同频同带宽的模式落到接收机带内,形成对接收机接收信号的同频干扰。

ACLR的定义

在LTE中,ACLR的测试有两种设置,EUTRA和UTRA,前者是描述LTE系统对LTE系统的干扰,后者是考虑LTE系统对UMTS(实际上就是WCDMA和TD-SCDMA)系统的干扰。所以我们可以看到EUTRA ACLR的测量带宽是LTE RB的占用带宽,如果不好区分,看到E就是LTE。UTRA ACLR的测量带宽是UMTS信号的占用带宽(FDD系统3.84MHz,TDD系统1.28MHz)。换句话说,ACLR/ACPR描述的是一种“对等的”干扰:发射信号的泄漏对同样或者类似的通信系统发生的干扰。实际网络中同小区邻小区、附近小区经常会有信号泄漏过来,所以网规网优的过程实际上就是容量最大化和干扰最小化的过程,而系统本身的邻道泄漏对于邻近小区就是典型的干扰信号;基站的不同信道或者基站与基站之间有干扰,同样的,在手机端,也会互相干扰。在通信系统的演化中,从运营商的投资角度来说,从来都是“平滑过渡”的,2G-->3G-->4G-->5G,即使现在都到5G时代了,2G的GSM依然在运营,LTE引入UTRA即是考虑了LTE在与UMTS共存的情形下对前代系统的射频干扰。B1频段有WCDMA,有LTE,未来也有5G,因此5G系统同样也要考虑5G对自身系统相邻信道和LTE和UMTS的影响;

LTE系统测试的UTRA和E-UTRA ACLR

在分享一篇通俗易懂的解释:

甲乙两人在一起交谈,乙说:“你没有说清楚!”甲说:“你怎么听不明白呢?”其实本来说是一回事,听是另一回事;但说得特别清晰可以弥补听力的不足,同样,听的能力特别强,也可以降低对说话清晰度的要求。

那么怎样衡量无线通信系统“说、听”的能力呢?这里介绍一组收发相关的射频指标。

说,就相当于无线通信系统的“发射”,说话的时候尽量只对着与你交流的人讲, 不要影响不相关的人,也就是说“不该说的尽量不说”;从发射的角度看,尽量发射信道带宽范闹内的信分,不要发射到别的信道上或者别的系统使用的频段上,否则会干扰其他信号。

衡量发射机带内辐射能力、带外抑制能力的主要指标就是邻道泄漏比和杂散辐射。

听,就相当于无线通信系统的“接收”,听话的时候尽量只听与你交流的人说话,不要听和你不相关的人讲话,否则会分散你的注意力,影响你的听话效果,也就是说“不该听的尽量不听”;从接收机的角度看,尽量接收信道带宽范围内的信号,不要接收其他频率的信号,否则会影响接收效果。

衡量接收机带内接收能力、带外响应抑制能力的主耍指标就是接收灵敏度和杂散响应。

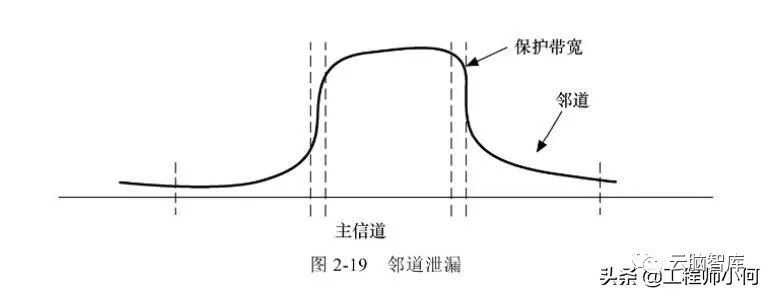

1、邻道泄露比

(现象类比)读小学的时候,由于教室紧张,一年级和二年级在一个教室上课,由一个老师来教。一年级学生读课文出错,二年级的就哗然大笑(邻道泄漏);

二年级的被老师批评,一年级的就起哄(邻道泄漏)。一、二年级互相影响得非常厉害。为了减少一、二年级的互相影响,老师在他们中间加了一个 隔板(增加了保护带宽),这样相互影响就降低了很多。但看不着,有时候却能听得着,最后老师索性把隔板换成隔墙(隔离度又增加了),这样影响就降到了最低。

邻道泄漏是用来衡量射频器件对主工作频率外的信道的影响特性,或称带外辐射特性,就像一年级学生的嘈杂声可能会影响到二年级一样。当然这种影响越小越好。

邻道泄漏比(ACLR)就是泄漏在邻逬的功率与主信道功率之比,通常用dBc表示,如阁2-19 所示。

邻道泄漏越小越好,邻道泄漏比的绝对值就应该越大越好。其值越大,表明主信道功率比池漏在邻道的功率大得越多,说明对邻道的影响越小。

WCDMA的要求是:笫一邻道(偏离载频±5MHz)的ACLR达到45dBc ;笫二邻道(偏离载频±10MHz)的ACLR达到50dBc。

2、杂散辐射

(现象类比)我们的生活小区旁边有一个工地,彻夜灯火明亮。安装探照灯(工作带宽范围内的辐射)的主要目的是为了便于巡查,从而避免工地的各种物资丢失。可是探照灯太亮了,辐射到了我们小区(杂散辐射),影响了我们小区很多人的休息(杂散辐射必然带来干扰)。

射频发信机本应该在规定的频率范围内发送无线信号,即发射带内信号号; 正如探照灯应该主要照射工地范围一样。 由于射频发信机的内部元器件并非理想器件,存在或多或少的非线性,在发射无线信号的过程中,产生了很多非规定频率范围内的信号,即发生了杂散辐射,就像探照灯照到了旁边的生活小区。

射频发倍机发射了非自己频率范围的信号,就可能对其他通信系统造成干扰,就像工地的探照灯影响了旁边小区居民休息一样。

杂散辐射可能是一些非线性元器件产牛的谐波分量、交调信号等。 为了防止一个系统的杂散辐射对其他无线通信系统造成干扰,需要提高系统的电磁兼容性能。 在协议中都会规定这个系统的不同带外频率范围的最大杂散辐射水平,规定的形式一般都楚在一个频率范围内单位带宽最大允许的杂散辐射是多少dBm;

如协议上规定,WCDMA的发射机在150kHz〜30MHz范围内每10kHz带宽的杂散辐射不能超过-36dBm。

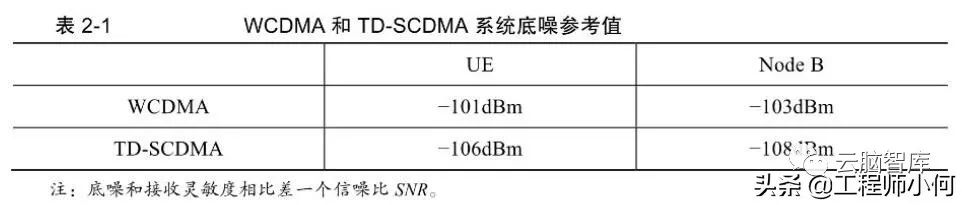

3、底噪

系统底噪Pn,就是一个小区空闲时的噪声功率。 任何用电设备都存在噪声,这个噪声主要来源是热噪声,其大小和开氏温度、带宽、设备的噪声系数有关。 系统底噪的公式为:

Pn= 10lg(KTB) + NF = 10lg(KT) + 10lg(B) + NF = n0 + 10lg(B) + NF

其中:NF为接收机的噪卢系数; K为波尔兹曼常数; T为绝对温度; B为信号带宽。

前而讲过,常温下噪声的功率谱密度n0是-174dBm/Hz,在WCDMA中带宽是 3.84MHz,而在TD-SCDMA中带宽B是1.28MHz。 噪声系数NF基站一般取5dB,手机取7dB。 WCDMA和TD-SCDMA系统底噪参考值如表2-1所示。

4、接收灵敏度

(逻辑类比)猪八戒问孙悟空:“猴哥,我对高小姐那么好,却怎么越来越难让她高兴了? ”

孙悟空说:“你对她的好估计没有达到她爱的接收灵敏度。 ”

猪八戒问:“什么叫爱的接收灵敏度? ”

孙悟空说道:“爱的接收灵敏度就是高小姐能够感觉到高兴的最小要求。 ”

猪八戒问:“这个灵敏度和什么有关系呢? ”

孙悟空说道:“和3个方面有关系。第一:基本生活保障(热噪声,最起码的要求),比如说一天20元;

第二:环境系数(噪声系数),就是高小姐周围女人的费用高于基本生活保障的倍数,比如说3倍;

第三就是高小姐最小幸福感倍数(信噪比要求),即高小姐感觉幸福要求最少应该比别人多得到的倍数,比如说2倍。”如图2-20所示。

猪八戒悟道:“也就是说高小姐爱的接收灵敏度应该这样计算:

高小姐爱的月接收灵敏度=基本保障 / 天 x 天数 x 环境系数 x 高小姐幸福感系数=20 x 30 x 3 x 2=3600元。这是高小姐的最低要求。”

孙悟空道:“如果换成对数关系,即用dB表示,就可以变成相加的关系, 即10lg (高 小姐爱的月接收灵敏度)=10lg (基本保障 /天 x 天数)+10lg (环境 系数)+10lg (高小姐幸福感系数)。”

接收灵敏度就是接收机能够止确地把有用信号拿出来的最小信号接收功率。它和3个因素奋关系,即带宽范围内的热噪声、系统的噪声系数、系统把有用信号拿出所需要的最小信噪比。带宽范围内的热噪声经过接收机,这些噪声被放大了NF倍,要想把有用信号从噪声中拿出来,就必须要求有用信号比噪声再大SNR倍。即:

S = 10lg(KTB) + NF + SNR = Pn + SNR (2-3)

其中:S为接收灵敏度,单位是dBm ;

K为波尔兹曼常数,单位是J/K; T为绝对温度,单位是K;

KT就是在当前温度下每Hz的热噪声功率(类似于高小姐每天的基本保障);

B表示信号带宽,单位足Hz (类似于高小姐基本保障的计算周期为一个月);

KTB代表带宽范围内的热噪声功率(类似于高小姐一个月的基本保障);

NF表示系统的噪声系数, 单位是dB (类似于环境系数);

SNR表示解调所需信噪比,单位是dB (类似于高小姐的幸福感倍数);

Pn表小系统底噪,单位是dBm。

从式(2-3)可以看出,要想让接收机“听清楚”发射机“说的话”,信号电f强度一定要大于接收机的接收灵敏度S。当然接收灵敏度S越小,说明接收机的接收性能越好, 就像狗能听到人类听不到的微小声音,说明狗的听觉比人的灵敏度尚;接收灵敏度越大, 说明接收机的接收性能越差,就像有的老人耳聋,你需要用很大的声咅说话,他才能听到。

环境温度升灵敏度S就会变化,接收性能就会恶化,因此要尽最降低系统所在环境的温度。

带宽越大,系统的噪声系数越大,灵敏度S就会越大,接收性能也会恶化,这就要求在设计接收机的时候,要考虑到系统的带宽、噪声系数对灵敏度S的影响。

解调所需的最小信噪比越小越好,这样可以增加系统的接收性能。最小信噪比要求和移动台的速度、所处的无线环境及所耍求的通信质量有关,不同无线制式耍求不同, 同一无线线制式的不同业务也不相同。

5、杂散响应

(现象类比)道德法庭审判潘金莲:“你为什么背叛自己的丈夫,走向万劫不复?”(对杂散信号做出响应)

潘金莲委屈地说:“奴家觉得西门大官人大帅了,太有财了!我无力抗拒。” (杂散信号很强)

道德法庭继续批判说:“社会上的诱惑那么多,你都无法抗拒么?”(难道 你对杂散信号总要响应么)

潘金莲仍然很委屈地说:“自从结婚后,我对武大给我的一切越来越没有感觉,接收灵敏度越来越差,没有任何幸福感,反而对外面的帅哥比较感兴趣。” (确实存在杂散响应)

道德法庭总结道:“也就是说一方面是外面的诱惑太大(杂散信号强),另 一方面是由于你本身的抗诱惑能力很差(存在杂散响应)。”如图2-21所示。

杂散响应也称寄生响应,就是在接收机中产生的,和接收到的有用信号频率相近的、 系统无法滤除的干扰信号。无线环境中存在很多干扰信号,人多数可以通过接收机的滤波器过滤掉,但有的接收机的抗杂散响应能力差,系统的后级滤波器是无法滤掉接收机本身产生的杂散响应的,就像潘金莲尤法抵抗西门庆的杂散诱惑,自己产生了杂散响应一样。

从系统接收的角度看,系统工作的频率范围内没有什么干扰,似由于环境的带外干扰太大,且本身的抗杂散响应能力弱,就会引起系统接收性能变差。

6、什么是驻波、行波、行驻波?

(现象类比)什么叫行军?行军就是行动的军队、不断向前的军队(类似行波)。从行军道路的任一处看,通过的部队人数不为零。行动的军队突然碰上了一条河,长官命令原地踏步。虽然每个战士都在自己的位置上踏步。但是从道路的某一处看,没有人通过。我们把不再前进的军队称为驻军(类似驻波)。长官发现不远处有一个独木桥,于是命令2个人原路返回向上级汇报地形,其他人走向独木桥,这时有人返回,有人继续前进,但前进的人数明显多 于返回的人数(类似行驻波)。

什么是行波?

行波就是行动的无线电波。无线电波在空气或者射频器件中传播时其,波形不断向前推进,其能量随波的传播而不断向前传递,传播介质的任何一处,通过的平均能量不为零,就像不断前行的队伍一样。

驻波是驻波?

驻波就是不再继续推进的无线电波,虽然电波上的任何一点都在上下震动,但波形没有传播出去,就像原地踏步的队伍不再前进一样。两列波(如入射波与反射波)振幅和频率相同、传播方向相反,叠加后波形不向前推进,就足驻波。

无线电波的驻波大家不易看到,似海岸峭壁前经常可以看到水的驻波。前进的水波由于受到峭壁的限制,产生了反射水波,前进水波和反射水波叠加形成了水的驻波。水而作周期性升降,但并不向前传播。

传输线在阻抗不匹配的情况下,同时存在入射波和反射波,就像有前进、有返回的队伍一样。反射波的振幅小于入射波,入射波和反射波相叠加,形成的合成波叫行驻波。

使用射频传输线传送无线电波的时候,我们需要尽可能多的电波能量传送出去,尽量少的能量停留在传输线上,以免造成过多的损耗。那么我们希望射频传输线里的无线电波最好是行波。但实际工程中,不会有这么理想的情况,射频传输线里的无线电波一 般都是接近行波的行驻波。驻波比、回波损耗等概念都是用来描述行驻波向前传送能量和往回反射能量多少的指标。下面分别介绍。

7、什么是驻波比、回波损耗?

(现象类比)军队的运输线是用来传送后勤补给的路线。如果后勤补给距离很近,在同一个村子里,可以很容易把补给送达目的地,不会有什么损耗(传输线很短时,认为是导线,没有损耗)。但一般路线会很长,可能有各种各样的影响,比如干旱导致蔬菜水分蒸发、下雨导致粮食发霉等(当传输线远远大于其波长时,就不能认为没有损耗了)。

射频传输线是用来传输无线电波能量的导线,是射频器件之间的连接器。天线和基站机顶门之间的士:要传输线,称为馈线(Feeder)。为了匹配射频器件(主要足基站和天线)的接入端口,连接在馈线和射频器件端口之间几米内的传输线,称为跳线(Jumper)。

对比一下:电风扇的电源线长1m,居民用电的工作频率是50Hz,波长就是 6000km。这根传输线相对于波长是非常短的,可以认为线上各点的电压和电流是相同的,等效为电路中的一点,不需要考虑无线电波波动效应的影响,可以认为从电源到风扇是短路的。

但在无线通信中,使用的是超高频,也就是说无线信号的波长很短,3G无线制式的波长约为0.15m,一般来说,传输线的长度比信号的波长大很多,线上各点的电压和电流不再相间,所以射频传输线也叫长线传输线。常见的射频传输线有平行线、同轴线等。

选择传输线的时候要关注两个指标:衡量匹配程度的特性阻抗和衡量幅度衰减、相位偏移的传播常数。下面会重点介绍。

8、什么是传输线的特性阻抗?

(现象类比)运输线的糟糕路况(类似传输线里的特性阻抗)会影响运输车队的速度,路越窄,路的阻碍作用越大(特性阻抗大,通过的无线电波能量就小);路越宽、路况越好,通过的车队速度越快(通过的无线电波能量越多)。假若一段路况特别好,另一段路况特别差,从路况好的路段进入差的路段,车队就需要放慢速度。这就说明两段路的路况不匹配(阻抗不匹配)。

特征阻抗是射频传输线影响无线电波电压、电流的幅值和相位变化的固有特性,等于各处的电压与电流的比值,用Z0表示。在射频电路中,电阻、电容、电感都会阻碍交变电流的流动,合称阻抗。电阻是吸收电磁能量的,理想电容和电感不消耗电磁能量。阻抗合起来影响无线电波电压、电流的幅值和相位。

同轴电缆的特性阻抗和导体内、外直径大小及导休间介质的介电常数有关,而与工作频率传输线所接的射频器件以及传输线长短无关。也就是说,射频传输线各处的电压和电流的比值是一记的,特征阻抗是不 变的。

目前无线通信系统射频器件有两种特性阻抗,一种足50Ω,用于军用微波、GSM、 WCDMA、LTE等系统;另一种足75Ω,用于有线电视系统,一般应用较少。

9、什么是阻抗匹配?

(匹配的类比)拳击手在训练的时候,使用的沙袋大重了,打起来很不舒适;而太轻了,又感觉没有挑战。只有沙袋重量适当,使用起来才感觉顺手。

再举一个例子,我的母亲是个勤劳的裁缝,一次叫我给她递一下剪刀,我 把父亲常用的剪刀递给她,她马上说:“你爸的右手剪刀我用着不顺手,我是左撇子,把旁边那把左手剪刀递给我。”我才意识到,这两把剪刀外形一样, 却有左右手之分。手和剪刀不匹配,用得就不舒服。

传输线和射频器件相连的时候,要求二者阻抗匹配。阻抗匹配就是在分界处只有入射波,没有反射波;也就是传输线和射频器件在无线电波传送时如同没有分界面一样, 正如左手使用左手剪刀,虽然是两个事物在一起,感觉上没有任何不适。

那么,什么情况下,阻抗匹配呢?传输线所接射频器件的阻抗Z1等于传输线的特性阻抗Z0时,就是阻抗匹配了。匹配时,能够保证传输线的下一级射频器件得到全部的信号功率,而没有损失。

在选择射频器件的时候,一定要看各器件的特征阻抗是否匹配。衡量阻抗匹配程度的参数有反射系数、回波损耗、反射损耗、驻波比、行波系数,等等,它们之间有一定的关系,已知其中一个,能够推出其他几个。下面分别介绍。

10、什么是反射系数?

(计算类比)高小姐跟八戒说:“你每月挣的钱得交给我,我根据情况返给你生活费。 ”八戒第一个月交给高小姐2000元(入射波),高小姐返给八戒 • 500元(反射波),75%都被高小姐留下了,返回比例是25%(类似于反射系数)。

电压反射系数就是指反射波电压和入射波电压幅度之比,记为厂。 经过推导,电压反射系数的计算公式为:

当射频器件和传输线阻抗匹配(即Z1=Z0时,厂=0,无线电波处于行波状态, 没有反射波;

在Z1=0或者Z1=∞的时候,厂=1,反射波和入射波电压幅度完全相N, 属于全反射,无线电波处于驻波状态。

一般情况下,射频器件的阻抗Z1介于上述两种 条件之传输线上既有行波也有驻波,无线电波处于行驻波状态,反射系数的范围为 0〜1。

在射频器件安装调试的时候,我们希望器件的连接处尽量没有反射,即反射系数接 近0,这样无线电波在器件的连接处就可以全部传送过去,没有反射损耗。

一、调制/开关频谱

回到GSM全球移动通信系统,Modulation Spectrum(调制谱)和Switching Spectrum(切换谱/开关谱)也是扮演了邻道泄漏比(ACLR)相似的角色;

不同的是它们的测量带宽并不是GSM信号的占用带宽;

从定义上看,可以认为调制谱是衡量同步系统之间的干扰,而切换谱是衡量非同步系统之间的干扰(事实上如果不对信号做gating,切换谱一定是会把调制谱淹没掉的);

这就牵涉到另一个概念:GSM系统中,各小区之间是不同步的,虽然它用的是TDMA; 而相比之下,TD-SCDMA和之后的TD-LTE,小区之间是同步的(那个飞碟形状或者球头的GPS天线永远是TDD系统摆脱不了的桎梏) ;

因为小区间不同步,所以A小区上升沿/下降沿的功率泄漏可能落到B小区的payload部分,所以我们用切换谱来衡量此状态下发射机对邻信道的干扰;

而在整个577us的GSM timeslot里,上升沿/下降沿的占比毕竟很少,多数时候两个相邻小区的payload部分会在时间上交叠,评估这种情况下发射机对邻信道的干扰就可以参考调制谱;

二、SEM (Spectrum Emission Mask)

这是一个“带内指标”,与spurious emission区分开来,后者在广义上是包含了SEM的,但是着重看的其实是发射机工作频段之外的频谱泄漏,其引入也更多的是从EMC的角度;

SEM是提供一个“频谱模版”,然后在测量发射机带内频谱泄漏的时候,看有没有超出模版限值的点;

可以说它与ACLR有关系,但是又不相同;

ACLR是考虑泄漏到邻近信道中的平均功率,所以它以信道带宽为测量带宽,它体现的是发射机在邻近信道内的“噪声底”;

SEM反映的是以较小的测量带宽(往往100kHz到1MHz)捕捉在邻近频段内的超标点,体现的是“以噪声底为基础的杂散发射”;

如果用频谱仪扫描SEM,可以看到邻信道上的杂散点会普遍的高出ACLR均值,所以如果ACLR指标本身没有余量,SEM就很容易超标;

反之SEM超标并不一定意味着ACLR不良,有一种常见的现象就是有LO的杂散或者某个时钟与LO调制分量(往往带宽很窄,类似点频)串入发射机链路,这时候即便ACLR很好,SEM也可能超标。

三、EVM(误差矢量)

EVM是一个矢量值,也就是说它有幅度和角度,它衡量的是“实际信号与理想信号的误差”,这个量度可以有效的表达发射信号的“质量”——实际信号的点距离理想信号越远,误差就越大,EVM的模值就越大;

四、为何发射信号的信噪比并不重要

第一是发射信号的SNR往往远远高于接收机解调所需要的SNR;

第二是我们计算接收灵敏度时参考的是接收机最恶劣的情况,即在经过大幅度空间衰落之后,发射机噪声早已淹没在自然噪声底之下,而有用信号也被衰减到接收机的解调门限附近;

但是发射机的“固有信噪比”在某些情况下是需要被考虑的,譬如近距离无线通信,典型的如802.11系列;

802.11系列演进到802.11ac的时候,已经引入了256QAM的调制,对于接收机而言,即便不考虑空间衰落,光是解调这样高阶的正交调制信号就已经需要很高的信噪比,EVM越差,SNR就越差,解调难度就越高;

做802.11系统的工程师,往往用EVM来衡量Tx线性度;而做3GPP系统的工程师,则喜欢用ACLR/ACPR/Spectrum来衡量Tx线性性能。

从起源上讲,3GPP是蜂窝通信的演进道路,从一开始就不得不关注邻信道、隔信道(adjacent channel, alternative channel)的干扰。换句话说,干扰是影响蜂窝通信速率的第一大障碍,所以3GPP在演进的过程中,总是以“干扰最小化”为目标的:GSM时代的跳频,UMTS时代的扩频,LTE时代RB概念的引入,都是如此;

而802.11系统是固定无线接入的演进,它是秉承TCP/IP协议精神而来,以“尽最大能力的服务”为目标,802.11中经常会有时分或者跳频的手段来实现多用户共存,而布网则比较灵活(毕竟以局域网为主),信道宽度也灵活可变。总的来说它对干扰并不敏感(或者说容忍度比较高);

通俗的讲,就是蜂窝通信的起源是打电话,打不通电话用户会去电信局砸场子;802.11的起源是局域网,网络不好大概率是先耐着性子等等(其实这时候设备是在作纠错和重传);

这就决定了3GPP系列必然以ACLR/ACPR一类“频谱再生”性能为指标,而802.11系列则可以以牺牲速率来适应网络环境;

具体说来,“以牺牲速率来适应网络环境”,就是指的802.11系列中以不同的调制阶数来应对传播条件:当接收机发现信号差,就立即通知对面的发射机降低调制阶数,反之亦然。前面提到过,802.11系统中SNR与EVM相关很大,很大程度上EVM降低可以提高SNR。这样我们就有两种途径改善接收性能:一是降低调制阶数,从而降低解调门限;二是降低发射机EVM,使得信号SNR提高;

因为EVM与接收机解调效果密切相关,所以802.11系统中以EVM来衡量发射机性能(类似的,3GPP定义的蜂窝系统中,ACPR/ACLR是主要影响网络性能的指标);又因为发射机对EVM的恶化主要因为非线性引起(譬如PA的AM-AM失真),所以EVM通常作为衡量发射机线性性能的标志;

五、EVM与ACPR/ACLR的关系

很难定义EVM与ACPR/ACLR的定量关系,从放大器的非线性来看,EVM与ACPR/ACLR应该是正相关的:放大器的AM-AM、AM-PM失真会扩大EVM,同时也是ACPR/ACLR的主要来源;

但是EVM与ACPR/ACLR并不总是正相关,我们这里可以找到一个很典型的例子:数字中频中常用的Clipping,即削峰。Clipping是削减发射信号的峰均比(PAR),峰值功率降低有助于降低通过PA之后的ACPR/ACLR;

但是Clipping同时会损害EVM,因为无论是限幅(加窗)还是用滤波器方法,都会对信号波形产生损伤,因而增大EVM;

审核编辑:汤梓红

-

射频

+关注

关注

104文章

5592浏览量

167857 -

接收机

+关注

关注

8文章

1182浏览量

53512 -

信噪比

+关注

关注

3文章

260浏览量

28639 -

发射机

+关注

关注

7文章

505浏览量

48046 -

信号

+关注

关注

11文章

2792浏览量

76841

原文标题:常见射频指标参数详解

文章出处:【微信号:射频问问,微信公众号:射频问问】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

射频PA常见指标和测试方法

手机的射频指标测量

常见射频指标参数口诀

移动WiMax参数指标及射频测试浅析

WiMax参数指标及射频测试

射频指标和要求

射频PA常见指标和测试方法

常见射频指标参数详解

常见射频指标参数详解

评论