第六届数字中国建设峰会(简称“数字峰会”)在福州召开。本届数字峰会由国家互联网信息办公室、国家发展和改革委员会、科技部、工业和信息化部、国务院国有资产监督管理委员会、福建省人民政府共同主办。

作为国家网信办主办的两个国内信息化领域盛会之一,本届数字中国峰会以“加快数字中国建设,推进中国式现代化”为主题,通过成果展示等方式,推动交流互鉴,促进开放合作,全方位展示数字中国建设最新成果。

在福建省数据要素与产业生态大会“算力赋能数字经济发展高峰论坛”中,芯启源创始人、董事长兼CEO卢笙受福建省大数据集团有限公司邀请,作了题为“DPU赋能AI算力网络,助力云基础设施生态共建”精彩演讲。

同期,由上海市通信管理局、上海市浦东新区人民政府联合主办的“算力浦江(首届)数字经济发展论坛”在上海浦东召开,旨在共筑算力底座,助力数字浦东。

芯启源作为6家AI算力芯片代表企业之一,围绕“打造AI算力芯片应用试验田”进行合作意向签约,芯启源高级副总裁姜欣代表芯启源上台签约,芯启源DPU事业部销售总经理侯东辉在现场探讨了算力网络的发展趋势。

ChatGPT引领“后互联网时代革命”

卢笙在高峰论坛中回顾了中国互联网发展史,“从2018年-2022年的“5G万物互联时代”到如今的“AI智能时代”,今年被认为是人工智能史诗级飞跃的一年。”

2022年11月30日,OpenAI发布人工智能对话聊天机器人ChatGPT,短短5天时间,注册用户数超100万。截止2023年1月末,其月活用户已突破1亿,成为史上增长最快的消费者应用。

ChatGPT是一个由人工智能技术驱动的自然语言处理工具。自ChatGPT发布以来,谷歌、微软争相发布了一系列以AIGC(AI generated content)为底座的生成式AI智能应用,通过输入人类语言生成视频、生成图片,AI开始尝试创造一些深刻且令人赏心悦目的东西,这个新类别被称为“生成式AI”。

这意味着AI正在创造新的生产内容,而不是像过去一样仅仅只是辅助分析已经存在的东西。这些智能应用与ChatGPT一起引领了后互联网时代数字经济“革命”,全球开始步入AI智能时代。

后互联网时代 算力发展见顶

进入AI算力新时代后,机器学习给我们带来了多重挑战。ChatGPT可以通过人类语言输入来预测下一个单词并生成具有严密逻辑的文本进行回复。而这样的AI的能力是基于算法训练出来,训练的过程包括海量数据获取和清洗、人工知识训练和场景,AI的能力在参数规模超过特定临界值后才出现,需要CPU/GPU提供大量算力,这些算力用参数量/浮点运算量来衡量。

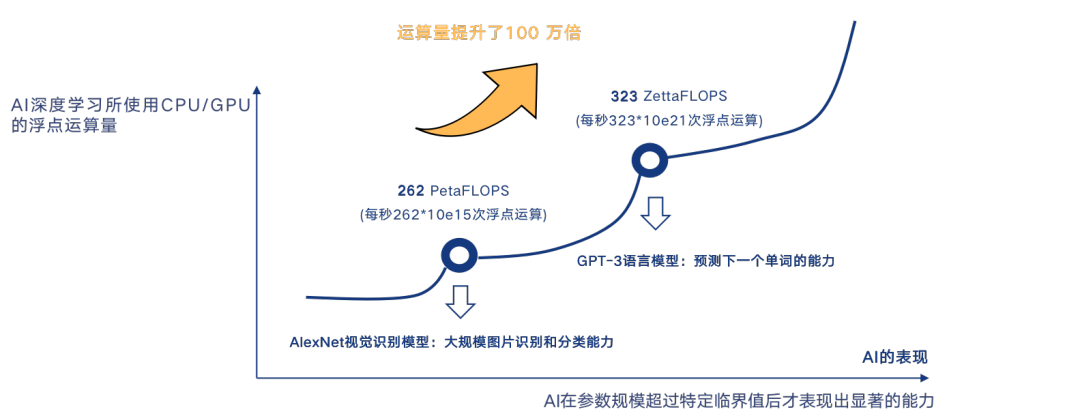

以著名的AlexNet和GPT-3训练模型为例,AI模型训练没有捷径可走,因为AI的表现并非随着模型规模增加而线性增加,而是在参数规模超过特定临界值后开始显著提升(如下图所示)。

AlexNet可处理262千万亿次的浮点运算,利用CPU/GPU集群训练出大规模图片识别和分类能力。GPT-3用可处理323*10e21次浮点运算,用CPU/GPU集群训练出了根据人类语言输入来预测下一个单词的能力。

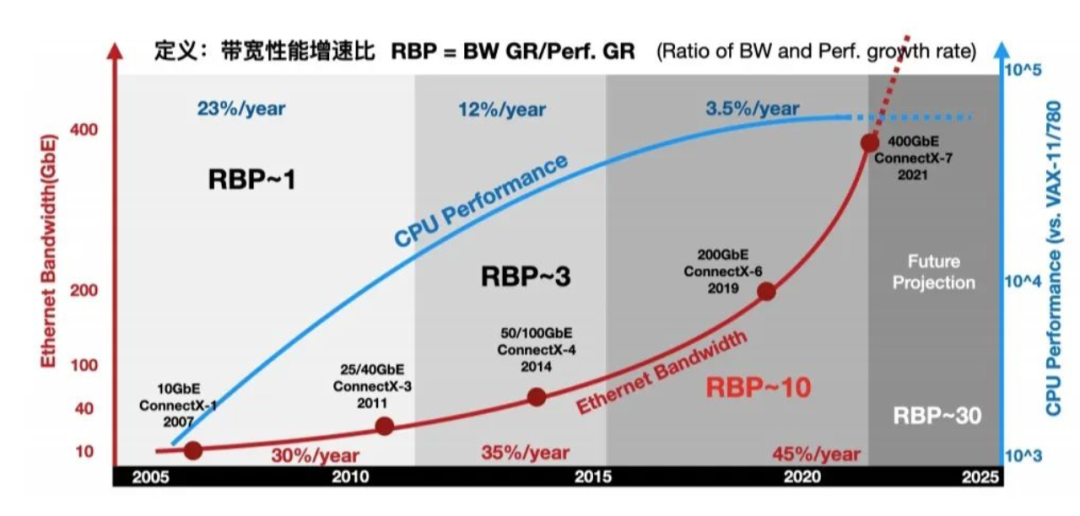

GPT-3的训练模型比AlexNet训练模型的运算量提升了100万倍。如果要达到多模态大模型训练的临界值,则需要极大的算力消耗,这对算力提出了前所未有的要求。而从Nvidia对2022年算力和带宽的评估结果来看,CPU性能增速放缓,网络带宽增速增大,2022年带宽增速比RBP达到30。

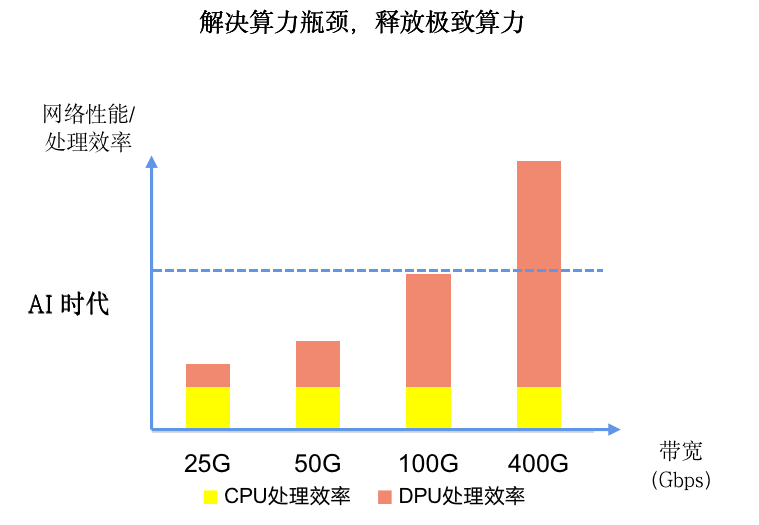

AI模型训练带来数据大爆发,带宽升级到200G/400G,CPU/GPU的性能增长速度无法满足网络数据处理的需求,大量CPU/GPU被网络数据包处理所抢占, AI运算所需的巨量运算量无法满足。

DPU—AI算力网络的核心组件

在这个大背景下,利用专用协处理器将“CPU/GPU处理效率低下”的负载卸载,帮助CPU/GPU释放算力的DPU将承担起网络数据通道的数据包处理需求,将CPU/GPU的算力释放出来用于支撑起怪兽级别的AI模型训练运算。

DPU将“CPU/GPU处理效率低下”的负载,包括“通讯协议”、“加密协议”、“网络协议”、“数据压缩”等全盘接受,从而将CPU芯片的算力解放出来,解决了高带宽、低延迟、数据密集的计算场景的算力困境。

01降本增效

DPU提升了整个计算系统的效率,降低整体系统 的总体拥有成本(TCO)。

02节能减排

DPU承担基础设施中网络通讯和商密相关的服务后,算力资源得到充分释放,服务器大量减少,耗电大幅降低,机房位极大压缩,碳排放量亦大幅下降。

03安全可控

在安全、商密等领域,打造以DPU为核心的零信任机制,使整个网络数据处理中心实现安全可控。

“后互联网”时代,AI云基础设施带来了巨大的需求和商机,DPU能满足对“面向AI的”、“高度优化的”算力网络的要求,被视为解决AI时代算力不足的不二之选。在协议加速、数据安全、存储加速、虚拟化/容器加速、5G/6G边缘计算加速等场景都有广泛应用。

芯启源DPU+N赋能中国数字经济生态

卢笙在峰会中介绍,芯启源从2019年开始研发第一代FGPA智能网卡,2020年开始推出第二代基于NP-SoC架构的产品,芯启源DPU芯片专为解决网络基础设施IO性能瓶颈、帮助CPU释放大量的算力而生。

芯启源提供基于Chiplet架构、软硬协同的DPU共建平台及方案,生态共建平台基础是芯启源NFP-7000系列DPU芯片,内置Risc-v处理器、多种硬件加速引擎和加解密引擎、基于可编程rFPC开放可编程接口,提供灵活可编程架构+丰富的加速硬件的芯片级软硬协同一体化方案;

芯片基于Chiplet架构搭建开源生态共建平台,通过Chiplet多Die互联,从资源上仍然保持互联同构,实现无缝、无感的横向扩展;标准化、开源的第三方Die互联可让生态共建更轻松。

芯启源提供芯片Die级和芯片级的高度集成和可被集成,包括与AI、CPU、VPU、GPU、xPU等Die的互联,与现有ASIC、FPGA(e-ASIC)、CPU等芯片级的互联,从而通过多Die的chip let组合出丰富的产品形态,满足2*25G-2*200G多样化端口需求,满足大数据中心、超算中心、5G/6G边缘计算、网络安全等多种场景需求。

目前芯启源DPU已经在福建省大数据集团、中国移动、天翼云、深信服、招商银行、中国科学院、中兴等客户落地应用和开展深度合作,涉及政府、运营商、互联网、金融、电力等领域。

同时,芯启源深耕DPU行业,结合DPU产业生态为开发者打造了全面开放的『数据基础设施虚拟化及加速开发平台CODIVA』,拥抱中立标准开放互补的国产化技术生态、行业解决方案,为“数字中国”提供坚实的核心技术基础,赋能千行百业的数字技术能力创新。

基于成熟的生态圈和CODIVA全栈能力平台,芯启源DPU作为集成电路产业的基础算力网络核心芯片,必将形成DPU+N=“新生万业”趋势,赋能中国数字经济生态,助力数字中国建设。

审核编辑:汤梓红

-

AI

+关注

关注

87文章

30881浏览量

269038 -

DPU

+关注

关注

0文章

358浏览量

24172 -

芯启源

+关注

关注

1文章

78浏览量

6721 -

ChatGPT

+关注

关注

29文章

1560浏览量

7641

原文标题:芯启源DPU赋能AI算力网络 助力云基础设施生态共建

文章出处:【微信号:corigine,微信公众号:芯启源】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

芯启源成为算力产业发展方阵会员单位

IaaS+on+DPU(IoD)+下一代高性能算力底座技术白皮书

中科驭数:DPU是构建高效智算中心基础设施的必选项

联想全栈算力基础设施发布 跻身中国第一阵营再启新程

芯启源DPU赋能AI算力网络 助力云基础设施生态共建

芯启源DPU赋能AI算力网络 助力云基础设施生态共建

评论