一、深度学习基础

1、首先,我们简单了解什么是感知器,感知器就是单个神经元。

深度学习模拟的是人体的大脑,神经元的树突在接收到特定的输入刺激后,其胞体就会被激活,并通过轴突向其它神经元输出兴奋,从而导致更多的神经元被激活,这是大脑思考的基础。 这个过程简化为当神经递质的浓度达到一个特定的阈值,就可以通过电信号传导兴奋。

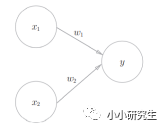

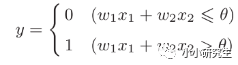

在深度学习中,生物学中的过程建模为上图,神经元可以表示成图中的⚪,当接受到输入信号时,会乘以权重w1和w2,神经元计算出总和,超过阈值θ时被激活,输出1。 θ称为偏置,w1和w2称为权重。

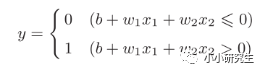

令b=-θ,公式可以改写为下图:

偏置和权重的作用是:w1和w2表示输入对激活的重要性,b用来调整激活的难易程度。

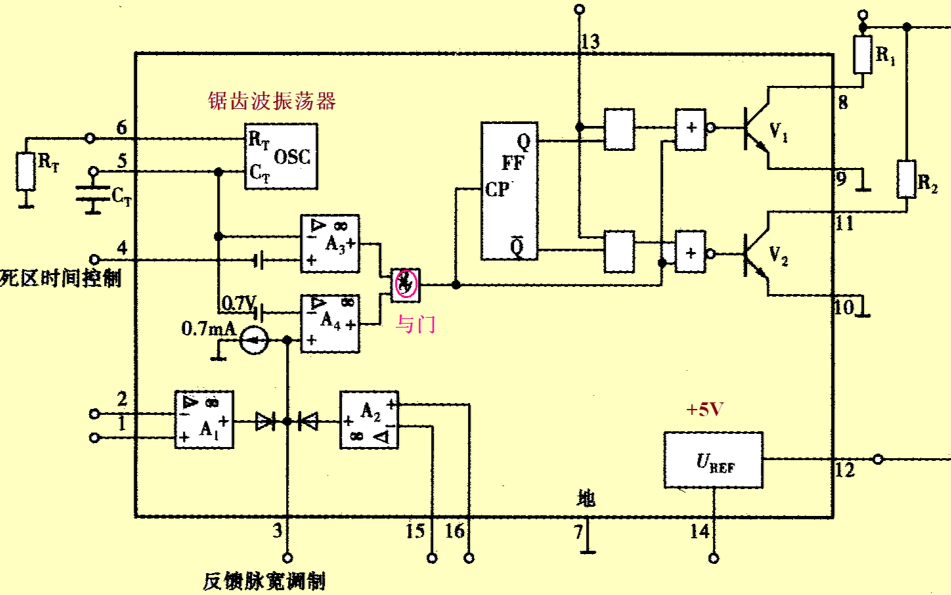

2、逻辑门的实现

我们来看一下硬件中的逻辑电路是如何通过神经元实现的。

1'与门

(w1,w2,θ)=(0.5,0.5,0.7)满足与门 (x1,x2,y)=000,010,100,111

2'与非门

(w1,w2,θ)=(-0.5,-0.5,-0.7)满足与非门 (x1,x2,y)=001,011,101,110

3’或门

(w1,w2,θ)=(0.5,0.5,0.3)满足或门 (x1,x2,y)=000,011,101,111

调整权重和阈值可以从硬件底层实现不同的逻辑门。 但是同时我们会发现,无论如何调整参数都无法实现异或门。

(w1,w2,b)=(1,1,-0.5)时x1+x2-0.5>=0?,在坐标系中画出x2=0.5-x1的直线,直线右侧表示神经元被激活时的输入。 左图表示或门,右图表示异或门,异或门的对角表示激活,没有直线可以分隔开。 由此可见,神经元实现的是线性化的运算,如果要实现异或门这种非线性的运算,就只能用多层感知器。

3、多层感知器

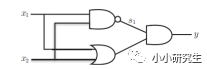

在数字电路中,异或门为y=AB'+A'B=AA'+AB'+A'B+A'B'=(A+B)(A'+B')=(A+B)(AB)',左图用三个基本逻辑门可以实现异或。 右图是多个神经元的表现方式。

对于复杂函数,感知器有实现的可能性,但是参数需要手动设置。 为了解决这个问题,神经网络应运而生,它可以自动学习到参数。 那么,神经网络如何自动学习呢? 随着学习的深入,后面会慢慢揭晓!

-

逻辑门

+关注

关注

1文章

142浏览量

24235 -

神经元

+关注

关注

1文章

368浏览量

18558 -

感知器

+关注

关注

0文章

34浏览量

11876 -

深度学习

+关注

关注

73文章

5527浏览量

121864 -

与非门

+关注

关注

1文章

129浏览量

12883

发布评论请先 登录

相关推荐

深度学习基础知识(1)

深度学习基础知识(1)

评论