电子发烧友网报道(文/梁浩斌)今年英伟达可谓风生水起,过去五个月市值增长近三倍,自上周四公布今年一季度财报以来,截至5月30日股价也飙涨27%,市值9632亿美元,有望进入万亿美元俱乐部。作为在这一轮生成式AI浪潮中的核心算力硬件供应商,已经“赢麻了”的英伟达并未有因此停下脚步,而是趁热打铁继续推出惊人的算力硬件。

图源:英伟达中国

英伟达CEO黄仁勋在周一的台北Computex展上带来了2小时的激情演讲,发布上推出了GH200 Grace Hopper超级芯片,以及将多达256块GH200超级芯片整合到一起的DGX GH200“巨型GPU”,同时还展示了一系列AI相关的应用和产品。

黄仁勋表示:CPU扩张的时代已经结束了。

新计算时代:GPU买得越多,省得越多!

在这场2小时的演讲开场,黄仁勋就提出了一个“暴论”,他表示“CPU扩张的时代已经结束了”。

在加速计算和AI重塑计算机行业的当下,从需要持续提升算力的数据中心可以看到,CPU的需求越来越少,而GPU的需求则不断增长。黄仁勋认为,如今的计算机是指数据中心、是指云服务,与此同时可以为未来“计算机”编写程序的程序员,如今将面临行业的变革。

“我们已经到达生成式AI的爆点,从此世界的每一个角落,都会有计算需求。”在这样的计算需求背景下,计算的性价比也非常重要。黄仁勋举了两个例子证明GPU比CPU在AI计算时代更有优势:

在1000万美元的成本下,可以用于建设一个有960颗CPU的数据中心,其中可以处理1X LLM(大语言模型)的数据量,同时需要消耗11GWh的能耗;同样成本下,如果用于建设一个有48颗GPU的数据中心,不仅可以处理的LLM数据量是同成本CPU数据中心44倍,在功耗方面还能大幅降低至3.2GWh。

所以,黄仁勋不禁喊出了“The more you buy,The more you save”的口号,买GPU越多,你省下的钱也就越多。

强到离谱的GH200和DGX GH200

这次发布会上最重磅的产品无疑是GH200 Grace Hopper超级芯片,在发布会上,黄仁勋也公布了该款芯片的细节。GH200是基于NVIDIA NVLink-C2C互连技术,将Arm架构的NVIDIA Grace CPU和Hopper架构的 GPU实现互联整合,最终实现高达900GB/s的总带宽,这相比传统的PCIe 5.0通道带宽要高出7倍,可以满足需求最严苛的AI 和HPC应用。

去年三月,英伟达在GTC大会上发布了基于Arm架构的Grace CPU,这款CPU专为计算加速平台设计,拥有多达72个Armv9 CPU核心,缓存容量高达198MB,支持LPDDR5X ECC内存,带宽高达1TB/s,并支持NVLink-C2C和PCIe 5.0两种互连协议。

同样是在去年的GTC大会上,英伟达发布了基于Hopper架构的全新H100 GPU,截至目前,H100依然是英伟达用于AI加速、HPC和数据分析等处理的最强GPU。

H100采用台积电4nm定制工艺,拥有多达800亿个晶体管,集成了18432个CUDA核心、576个Tenor核心、60MB二级缓存,并支持6144-bit位宽的HBM3/2e高带宽内存。

而GH200 Grace Hopper,就是将72核的Grace CPU和当今世上最强的GPU H100,加上96GB的HBM3显存、512GB的LPDDR5X内存封装在一起,集成到一片“超级芯片”上。

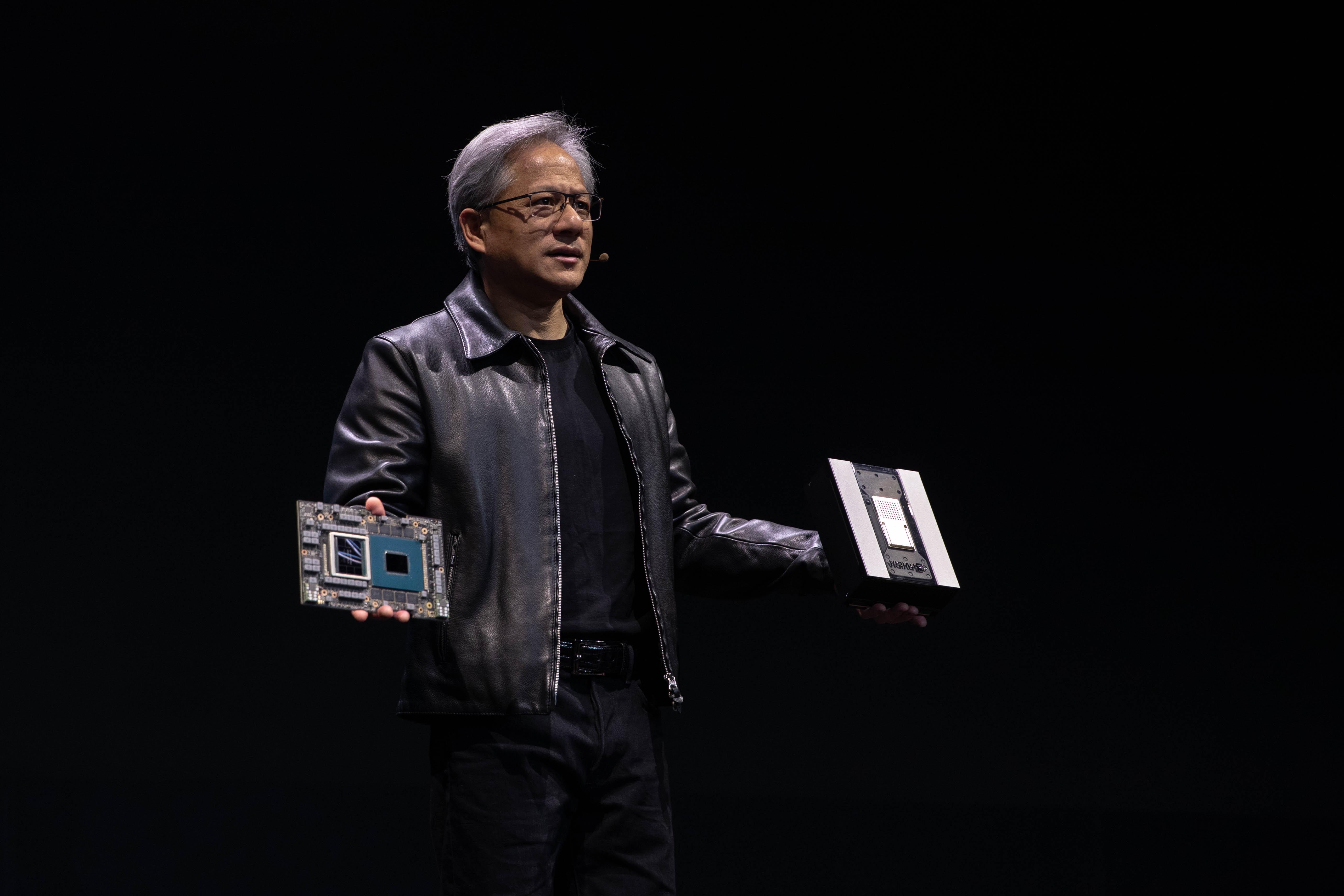

图源:英伟达中国

黄仁勋将GH200 Grace Hopper形容为“这是一台计算机,而不是芯片”。同时他透露,GH200 Grace Hopper目前已经全面投产。

如果GH200 Grace Hopper还不能满足你的需求,英伟达还提供了一个由256个GH200 Grace Hopper组成的超级计算机系统——DGX GH200,而上一代的系统在不影响性能的前提下只能通过NVLink将8个GPU整合成一个系统。

那么DGX GH200是如何做到将256个GH200 Grace Hopper连接成一个系统?GH200 Grace Hopper和NVLink4.0、NVLink Switch System(交换机系统)是组建DGX GH200的重点。NVLink交换机系统形成了一个两级、无阻塞、胖树NVLink结构,结合新的NVLink 4.0和第三代NV SWitch,英伟达可以用一个前所未有的高带宽水平来构建大规模NVLink交换机系统。通过计算节点外的交换机模块,将最高256个计算节点,也就是GPU连接为一个整体。

最终这个拥有256个GH200 Grace Hopper超级芯片的DGX GH200超级计算机能够提供高达能够提供1 Exaflop(百亿亿次)级别的性能、并具有144TB的共享内存,内容容量几乎是上一代的500倍。

黄仁勋称DGX GH200是“巨型GPU”,并预计DGX GH200将在今年年底开始供货并投入使用,Google Cloud、Meta与微软将会是首批能够使用DGX GH200的公司。

除此之外,英伟达还在使用DGX GH200打造一个更大规模的超级计算机,这款被称为NVIDIA Helios的超级计算机将配备4个DGX GH200,通过英伟达的Quantum-2 InfiniBand交换机进行互连。那么NVIDIA Helios将成为一个由1024个GH200 Grace Hopper超级芯片构成的巨型AI计算系统,这套系统也将会在今年年底启用。

AI应用遍地开花

发布会上,黄仁勋还宣布推出一种名为Avatar Cloud Engine(ACE)的AI模型代工服务,这种模型主要应用在游戏领域,可以为游戏开发人员提供训练模型,通过简单的操作定制想要的游戏AI模型。

图源:英伟达中国

在演示中,游戏玩家可以用自己的声音与NPC角色进行对话,由生成式AI加持的NPC,可以根据玩家的语音实时生成不同的回答,增强游戏的沉浸体验。

在内容方面,英伟达目前正在与全球最大的广告集团WPP合作,开发一款利用NVIDIA Omniverse和AI的内容引擎,以更高效地帮助创意团队制作高质量商业内容,并针对客户的品牌产出不同的针对性内容,这或许是AI颠覆广告行业的一个尝试。

除此之外,在工业领域,英伟达也正在用AI来帮助工业生产提高效率,比如用于模拟和测试机器人的英伟达Isaac Sim;用于自动光学检测的英伟达Metropolis视觉AI框架;用于3D设计协作的英伟达Omniverse等。

黄仁勋表示,目前富士康工业互联网、宜鼎国际、和硕、广达、纬创等制造业巨头都在使用英伟达的参考工作流程,比如构建数字孪生、模拟协作机器人、检测自动化等。

小结:

今年AIGC发展速度超出所有人想象,近期甚至有调研机构在一个半月之内将今年AI服务器出货量增长预期从15.4%提升至38.4%。毫无疑问,黄仁勋和他的英伟达是在这新一轮AI革命中最大的赢家。

截至5月30日18时,英伟达盘前涨近4%,市值突破万亿美元,英伟达成为全球第一家市值破万亿美元的芯片公司。

-

cpu

+关注

关注

68文章

10863浏览量

211760 -

英伟达

+关注

关注

22文章

3776浏览量

91103

发布评论请先 登录

相关推荐

赢麻了!英伟达发布史上最强“巨型GPU”,黄仁勋:CPU扩张时代结束了

赢麻了!英伟达发布史上最强“巨型GPU”,黄仁勋:CPU扩张时代结束了

评论