编者按:高精度定位模块作为智能网联车辆的核心技术之一,为环境感知、决策规划、运动控制等提供了重要的参数信息,是自动驾驶的重要支撑。智能网联汽车搭载多种类型的传感器,如全球导航卫星系统(Global Navigation Satellite System, GNSS)、惯性测量单元(Inertial Measurement Unit, IMU)、摄像头等,为车辆定位系统提供了多种信息源。近年来利用多传感器融合进行组合定位实现可靠的位姿估计是当下的研究热点,其中视觉惯性里程计以性能互补特性被广泛应用。但是在城市峡谷等复杂地区中,GNSS信号易被遮挡导致定位信息不够精确。本文基于此提出了一种应对城市复杂地区GNSS信号被遮挡情况下的融合定位系统,通过分析不可观测子空间得到系统设计的有效性,并通过在城市地区收集的开源基准数据集和广泛的真实驾驶数据集,验证了所提出的方法。

摘要:在这篇文章中,我们提出了一种新的方法,以融合具有挑战性的城市环境中陆地车辆的视觉惯性测量,在这种环境中,GNSS信号既不可用也不可靠。受MEMSIMU大偏差导致的退化情况的激励,我们在扩展卡尔曼滤波器的框架内重新设计了视觉惯性里程计的系统模型。特别地,系统模型通过由三轴陀螺仪、两轴加速计和单轴里程表组成的简化惯性传感器系统传播。分析可观测性推导揭示了我们估计器的不可观测基础,这些方向通过使用GNSS接收机的间歇性位置测量来解决。此外,我们在蒙特卡洛模拟中检查了状态向量的不确定性,这与我们的理论结果一致。通过KITTI基准数据集和广泛的现场测试验证了所提出的方法,显示隧道中的平均位置漂移为1.25%,街道峡谷中6.7km的平均位置误差为2.81m。

1 引言

在城市地区,充满挑战的环境促使研究人员和技术人员融合了内感知和外感知传感器,以进行自我运动估计。在定位的背景下,这些环境包括全球导航卫星系统(GNSS)中断和GNSS的多路径区域以及视觉系统的低亮度/纹理区域。融合了GNSS信号的惯性导航系统(INS)称为INS/GNSS集成系统[1],[2]是利用INS和GNSS的互补误差特性的著名解决方案。然而,它的局限性是显而易见的:当GNSS信号不可用或不可靠时,来自惯性测量单元(IMU)的噪声测量的集成不能确保有界定位误差。

另一方面,如果正确处理了高维测量,视觉传感器会为定位问题输出丰富的信息[3]。无论是通过将视觉测量与已知地标匹配[4]–[6],还是通过构建环境并估计自我运动(SLAM)[7]–[9],视觉传感器都是一个有吸引力的解决方案,不仅是一个独立的系统,也是一个集成的系统。

[10]中引入了视觉惯性里程计(VIO)这一术语,这意味着它通过融合视觉和惯性测量来逐步估计车辆的姿态。视觉传感器的相对测量降低了INS的误差累积率。另一方面,IMU读数(角速度和比力)在短时间内提供了绝对比例和精确姿态,采样时间比图像快得多。基本上,所有VIO方法都通过递归(滤波)或批估计(非线性优化)来解决最大后验(MAP)问题。

[11]的一项开创性工作提出了多状态约束卡尔曼滤波器(MSCKF),该滤波器随机克隆其过去的姿态,以建模视觉特征轨迹。[12]-[14]的后续研究解决了MSCKF中的可观测性失配问题,并提高了滤波的准确性和一致性。对于非线性优化框架,Leutenger等人[15]提出了联合优化视觉重投影误差和惯性误差项的VIO。另一方面,预积分[16]为迭代优化中融合惯性测量开辟了一条有效途径。[17]–[19]的作品采用了这种技术,并显示了在VIO中的潜在用途。在这项工作中,我们选择了一种基于滤波的估计器,因为它在较小的计算负载下显示出优于非线性优化方法的竞争性能[20]。

对于陆地车辆应用,单目VIO由于其特定的运动轮廓,如无旋转的恒定加速度,具有额外的不可观察方向[21]。因此,定位性能降低。里程表的速度测量传递绝对刻度信息,之前的工作[21]、[22]利用里程表作为辅助INS的额外测量。然而,在该方案中,在每次获取速度测量值或指定间隔时,更新估计器以执行矩阵反演。在包含地标位置或滑动窗口的估计器的情况下,该策略会带来巨大的计算负担。此外,即使通过速度和其他测量来估计偏差,MEMSIMU的加速度计读数的双重积分仍会累积误差。

受简化惯性传感器系统(RISS)[23]的启发,我们开发了视觉惯性车轮里程计(VIWO)。具体而言,我们将MSCKF中的系统模型重新设计为3DRISS,而不是INS,使用里程表、3轴陀螺仪和2轴(向前和横向)加速计的单通道速度测量。此外,只要可用,VIWO就通过GNSS位置以松耦合方式进行更新。本文的主要贡献有三个方面:

我们提出了一种新的方法,该方法结合了简化惯性系统和MSCKF,其中基于车轮里程表重新设计了系统模型,以避免低等级加速计的双重集成;我们通过分析得出VIWO的不可观测子空间,以提供滤波器设计的有效性;通过在城市地区(包括隧道和街道峡谷)收集的开源基准数据集和广泛的真实驾驶数据集,验证了所提出的方法。

本文组织如下。在第二节中回顾了之前关于陆地车辆视觉辅助定位的工作之后,第三节中介绍了坐标系定义、符号和MSCKF的初步内容。此外,还研究了常规VIO在远程陆地车辆应用中的缺点。在第四节中,开发了所提出的VIWO,并通过推导其基来识别其不可观测子空间。接下来,讨论了虚拟数据集中的数值模拟结果,并在第五节中通过城市地区的驱动数据集验证了所提出的方法。

2 相关工作 在过去几十年中,通过集成各种传感器的地面车辆导航系统已经成为热门的研究领域。由于有大量关于地面车辆定位的相关研究,我们涵盖了视觉辅助或基于视觉的方法以及基于深度学习的端到端方法的相关工作。

Rahman等人[24]在滤波框架中基于3DRISS融合视觉和惯性测量。他们的贡献是INS辅助的离群点抑制方案和视觉惯性系统的融合方法,以松耦合的方式利用视觉里程计(VO)的位置估计。Lins等人[25]推导了一个方程式,以计算给定目标的陆上车辆的速度,假设尺度模糊性得到解决。Karamat等人[26]提出了一种集成算法,将[25]中的VO和3DRISS松散融合。Ma等人[27]开发了基于双眼视觉的MSCKF,通过阿克曼测量进行校正;源自陆地车辆运动的物理约束。Wu等人[21]证明了平面运动下额外的不可观测方向,并提出了一种用道路表面参数来增强状态向量的伪测量。Wu等人[28]修改了传统的角检测器和跟踪器,以提高地面车辆VO的精度和计算时间。Dong等人[29]对陆上车辆应用的特征检测器和描述符的不同组合进行了定量比较,VIO基于[30]中的三焦点几何结构。

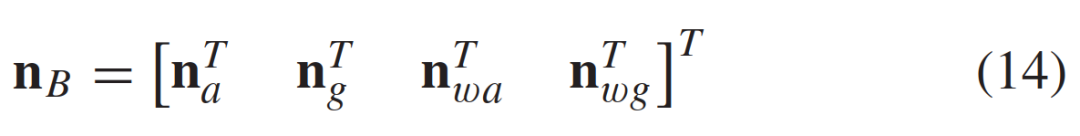

通过扩展,使用视觉地标和先验地图数据库进行地面车辆定位的研究正在进行中。Nedevschi等人[32]使用数字地图将视觉地标与数字地图中的相应地标对齐。从立体图像中,地面车辆行驶的车道通过贝叶斯网络形式的概率方法使用粒子过滤器进行识别。为了改进定位,Gruyer等人[31]将GPS、INS和里程表与EKF相融合,使用了从侧向摄像机获得的车道标记信息和精确的数字地图。Jo等人[33]和Suhr等人[34]利用道路标记与数字地图的匹配结果来更新粒子过滤器,而后者通过存储具有最小点数的地图来减少数字地图的体积。Wang等人[5]使用EKF融合高精度地图中交通灯的准确位置信息和INS信息,以提高定位精度。

近年来,在里程测量的背景下,出现了使用深度神经网络(DNN)的端到端方法,取代了手工特征提取器和传统的基于模型的架构。对于VO,[35],[36]的工作通过考虑图像流的时间相关性,提出了基于递归卷积神经网络(RCNN)的姿态估计架构。Li等人[37]通过从光度和几何一致性设计其损失函数,使用无监督深度学习方案解决了姿态估计问题。在惯性里程计(IO)应用中,Chen等人[38]提出了一种DNN框架,以解决采用长短期记忆(LSTM)的INS的误差累积。Esfahani等人[39]将IMU读数及其在输入空间中的采样时间包括在内,后者在惯性里程计中起着关键作用。Esfahani等人[40]提出了一种仅使用陀螺仪的基于DNN的三自由度姿态估计器。Clark等人[41]和Chen等人[42]将VIO视为一个深度学习问题。他们分别向CNN和LSTM提供时间图像和窗口IMU测量。视觉和惯性特征被连接起来,以表示网络中的车辆姿态。

与之前的工作相比,我们的方法以紧耦合的方式融合视觉和惯性测量,随机建模特征和车辆位置之间的相关性,否则在松耦合的融合中忽略这些相关性。此外,我们只利用自然出现的点特征,这些点特征是最一般的视觉信息,而没有任何先前的地图数据库或训练阶段。

3 多状态约束卡尔曼滤波器

本节回顾了多状态约束卡尔曼滤波器(MSCKF)[11],该滤波器通过利用多视图几何中的相对约束来跟踪相机姿态。首先,我们定义将在本文中使用的坐标系和符号。然后,为了本文的完整性,给出了MSCKF的误差状态方程。最后,显示了MSCKF在陆上车辆应用中的缺点,这是我们陆上车辆导航新方法的核心动机。

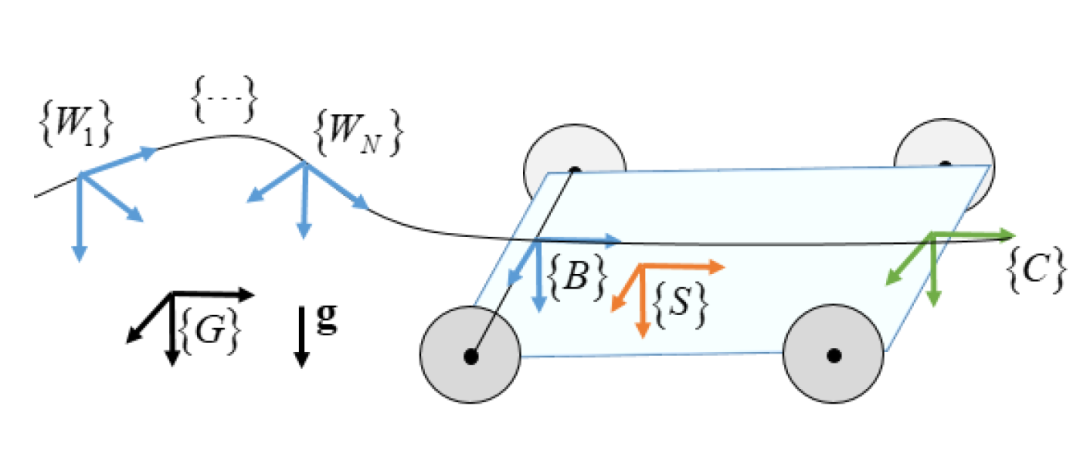

图1陆地车辆视觉惯性系统的坐标系定义,前进方向为右。

A.坐标系和符号

我们将全局框架定义为,这是与重力对齐的局部切平面,其原点位于初始身体框架。、和轴指向北、东和向下方向。表示为的相机框架以针孔相机模型的焦点为中心,轴遵循右下向前的惯例。我们将传感器(IMU)框架指定为,将主体框架指定为。的中心与非完整约束(NHC)理想有效的非转向轴的中点重合。的轴分别指向前、右和下。假设当前时间步长为,则第个滑动窗口帧定义为其中是滑动窗口之间的间隔,是窗口的最大大小。图1总结了假设车辆为前轮驱动汽车的坐标系定义。

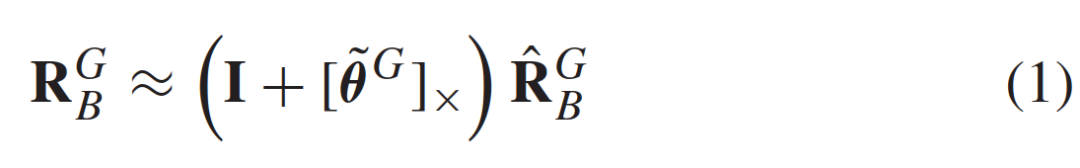

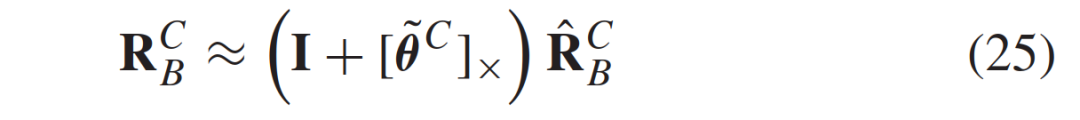

小粗体字母代表向量,例如,代表某个维向量。矩阵被写成大写粗体字母,例如代表某个的矩阵。我们用上标作为参考/解析框架,下标作为对象框架来表示物理量。例如,表示从的原点到的原点的矢量。如果参考帧和解析帧不同,我们将在文本中明确提及。方向余弦矩阵(DCM)是,其将参考帧从转换为,使得。相应的单位四元数表示为。姿态误差遵循右不变误差定义,以避免不期望的可观测性特征[43],即

其中上小三角和上波浪线表示估计和误差状态,是单位矩阵,是斜对称算子,使得

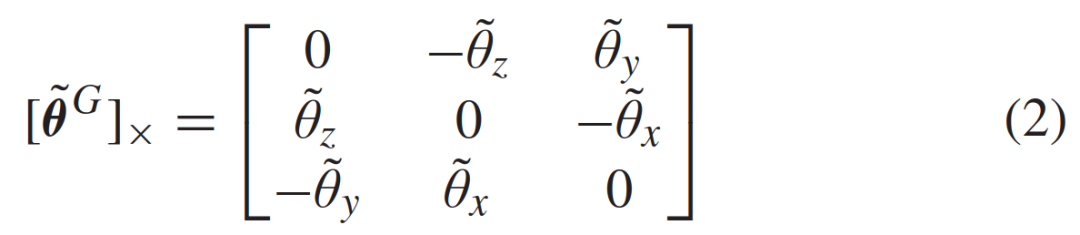

除了姿态之外的所有其他误差状态被定义为差异,即

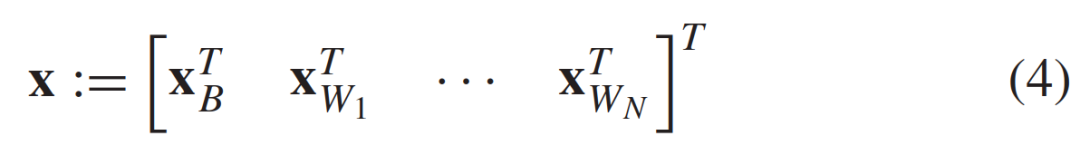

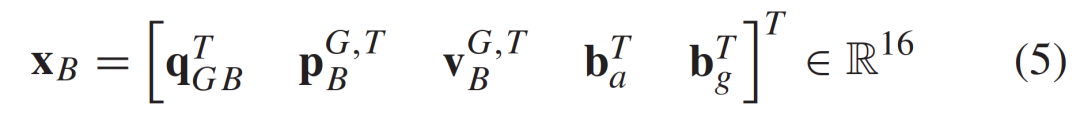

B.状态矢量

MSCKF的状态向量由主体和滑动窗口相关状态组成,即

车体相关状态由加速度计和陀螺仪的单位四元数、位置、速度和零偏组成,依次如下:

滑动窗口状态是车辆探索时随机克隆的先前车体姿势,并定义为先前的车体姿势,即

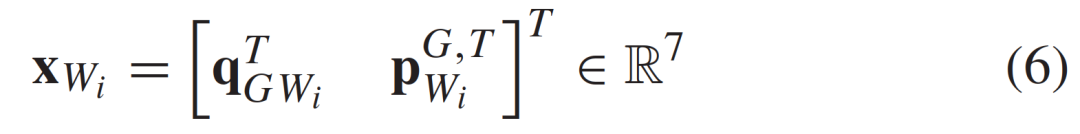

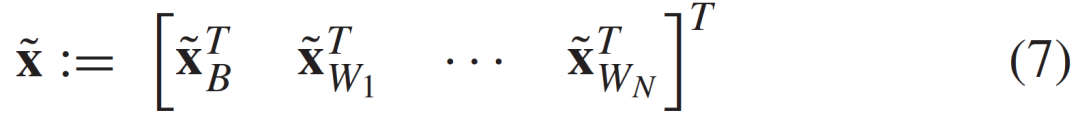

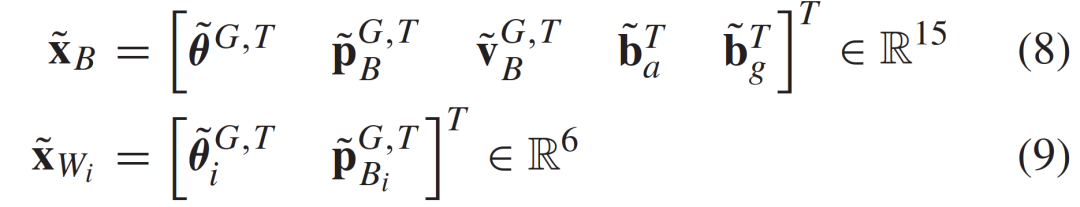

EKF的误差状态为

其中每个误差状态遵循(1)和(3)中的误差定义。

我们假设与一致,不失一般性,以简化符号,校准参数已知,但将在第四节中建模。

C.系统模型

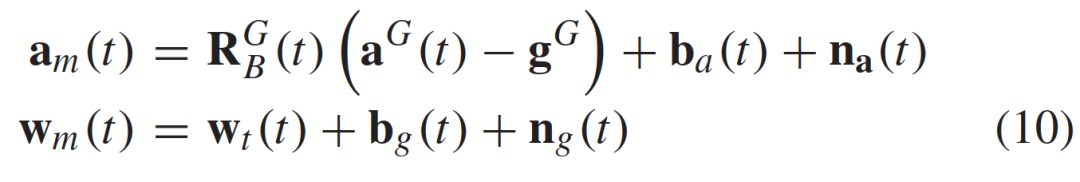

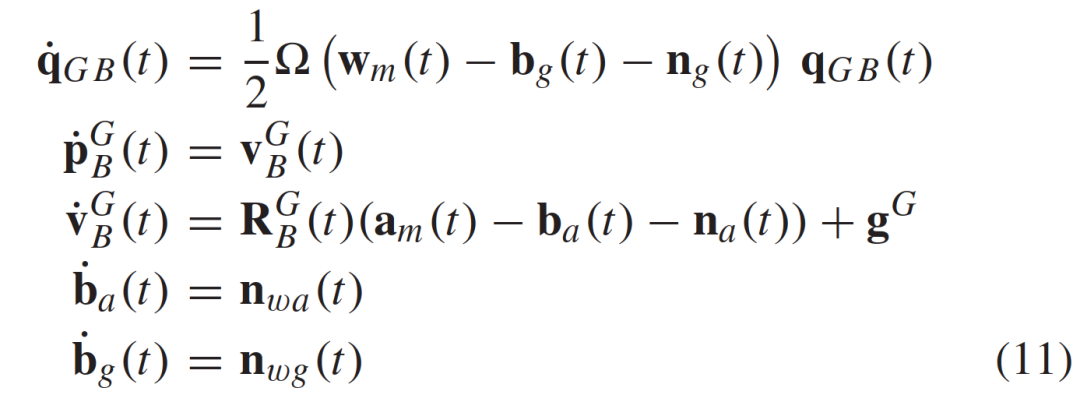

IMU的测量值被建模为具有加性时变偏差和噪声的真实读数。

在这个表达式中,是车辆的真实加速度,是假设为,和分别是加速度计和陀螺仪的零平均白高斯过程。此外,真实比力为,真实角速度表示为。请注意,我们忽略了由于地球自转而产生的附加项,因为我们假设车辆配备了低级别IMU,其中偏置水平远高于自转产生的读数。

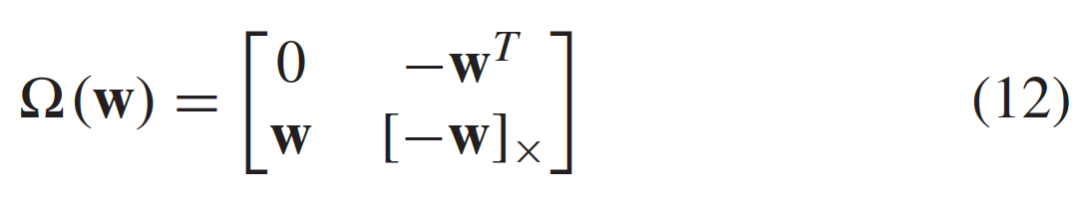

车体相关状态由以下一组非线性方程控制,

其中和分别是加速度计和陀螺仪的偏置的零平均白高斯过程;这是随机行走偏差。矩阵是

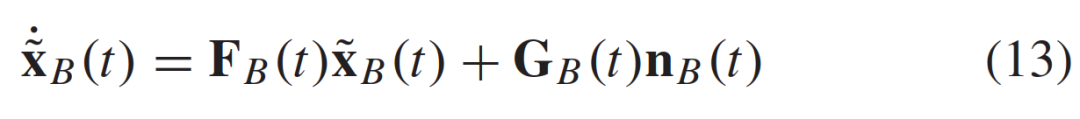

滤波器协方差矩阵通过线性化模型传播,

雅可比矩阵、是通过扰动误差状态并去除依赖于。(13)中的噪声矢量为

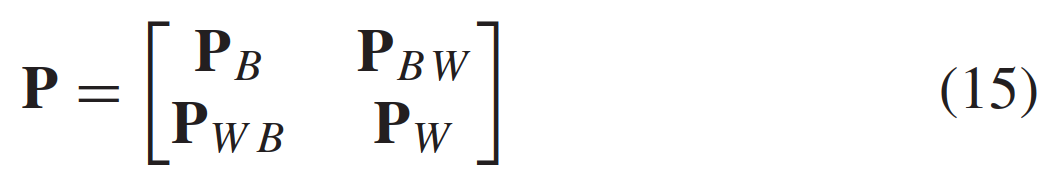

我们将协方差矩阵划分如下

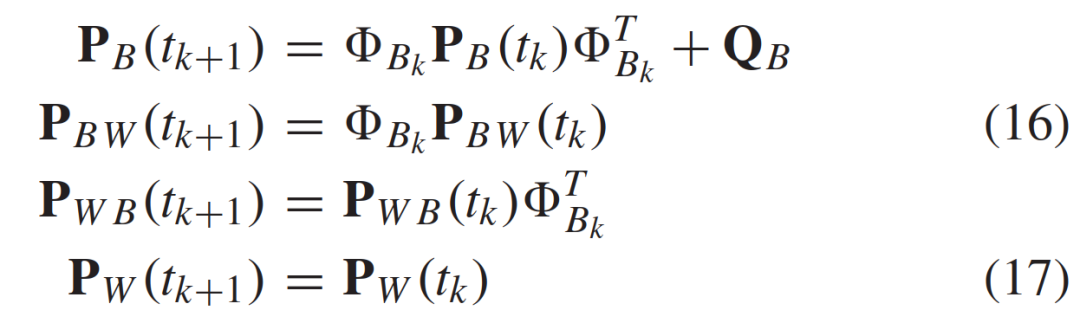

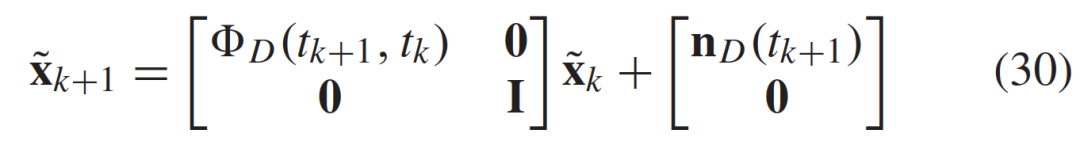

由于滑动窗口姿态不受IMU读数的影响,在离散时间内传播方程为,

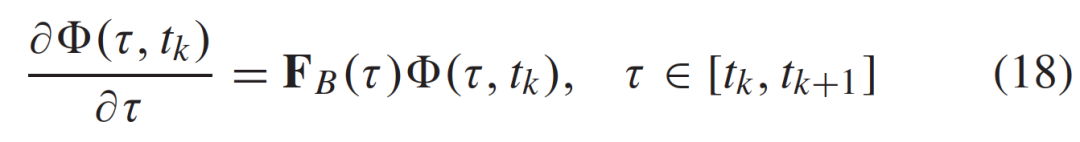

其中,是状态转移矩阵,

是从IMU的噪声密度确定的离散时间中的噪声协方差矩阵。

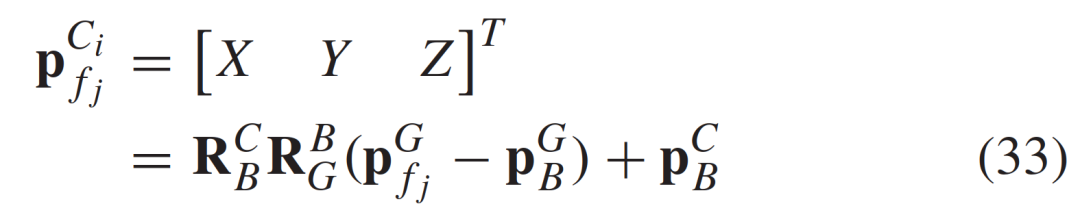

D.测量模型

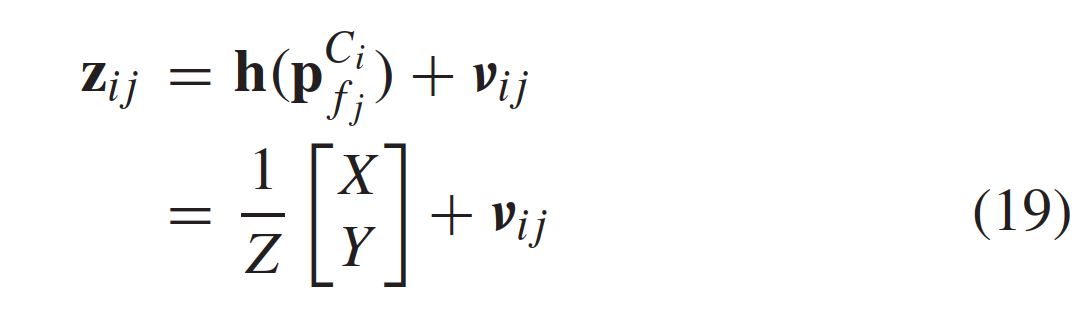

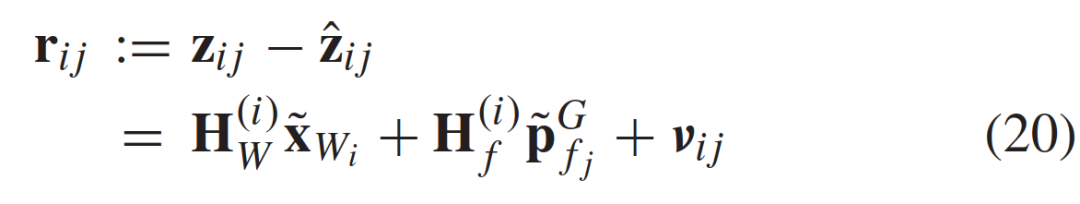

视觉测量是从空间不同位置观察的一系列特征点投影。数学上,它写为

其中是第个特征到第个视图的投影,是建模为与无关的零均值高斯噪声的测量噪声。在我们的实验中为考虑热噪声、跟踪器性能等,将的标准偏差设置为2.5像素。函数是第个特征的投影,。

最新估计时线性化的误差模型为

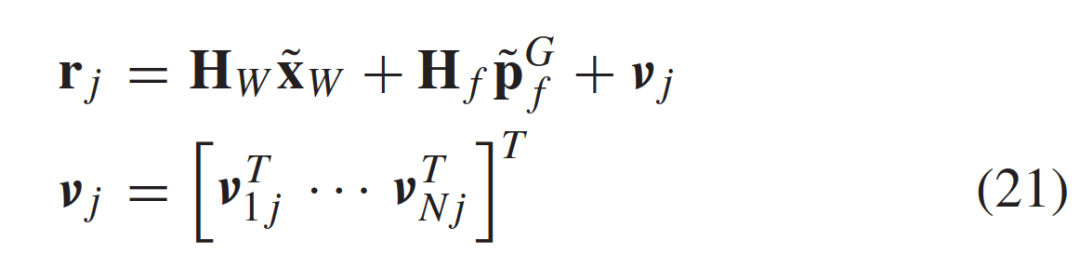

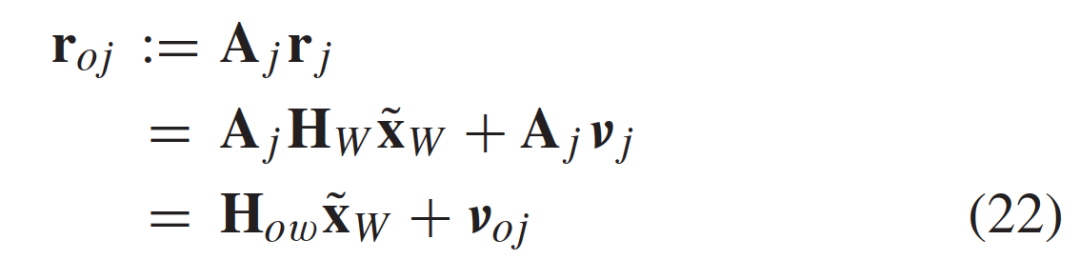

矩阵和分别是滑动窗口和特征位置的雅可比矩阵。如果我们让来自所有视图的连接残差为,

为了消除对特征位置误差的依赖,将(21)投影到的左零点空间。注意,由于,其中是视图的数量,因此只有当且车辆移动时,总是存在维度为的左零空间。设,则有

所有特征点测量值被叠加并用于计算卡尔曼增益。过滤器更新遵循(1)和(3)中的误差定义。

E.关于常规VIO的问题

在介绍我们的方法之前,我们强调了VIO(不仅仅是MSCKF)对于使用低级别IMU的陆上车辆的挑战,应该解决这些挑战以扩大其通用性。

车辆静止检测

转弯行驶时的定位精度

数十公里行驶时的无边界位置和航向不确定性

对于第一个挑战,关键是检测静态以获得伪测量,例如零速度更新(ZUPT)以限制速度误差。特别是对于大多数单眼视觉系统,需要来自纯平移的特征点视差来估计自我运动。在基于IMU的静止检测方面有几项先前的工作,例如陆地车辆的频域方法[45],以及行人航位推算系统的基于信号幅度/方差的方法[46]。然而,最简单有效的方法是使用车轮里程表。这就是为什么我们使用车轮里程表而不是(11)中公式化的惯性导航系统的航位推算方法的原因之一。

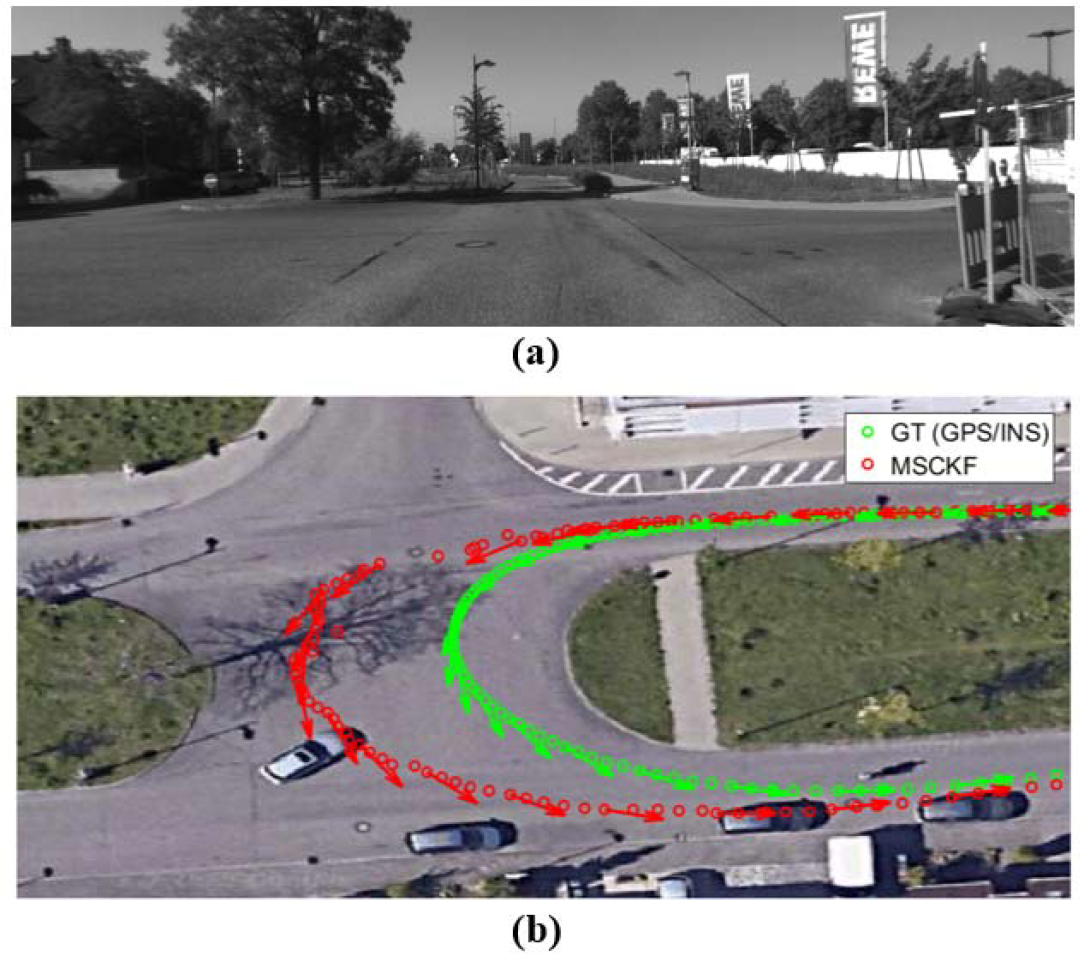

我们观察到,当车辆进行圆形轨迹(这是陆地车辆的常见机动)时,定位精度尤其降低。非正式地,由于速度估计不准确,轨迹并不平滑。事实上,这是车轮视觉惯性系统的主要缺点,因为在恒定加速度分布中存在额外的不可观察方向[21]。与显示出明显平滑转弯的地面实况(GT)相反,MSCKF不仅导致了曲折的轨迹,而且在弯道驾驶中的最大位置误差为8.33米。为了解决这一问题,我们使用嵌入式车轮里程表重新设计了估计器中的系统模型,该里程表输出连续图像帧之间的绝对比例。

图 2 KITTI数据集[44]的20110930_drive_0027中的拐角驾驶示例:(a)来自车载摄像头的图像;(b) 地面实况(GT)和估计的2D位置(MSCKF)报告为10Hz的圆圈,其中箭头表示车辆在瞬间的航向

最后,很好地研究了在6自由度一般运动下有4个不可观测的方向(围绕重力的全局平移和旋转)[10]。换句话说,这个方向的不确定性是没有界限的,阻碍了VIO的长期应用。通过在任何可用的情况下以松耦合方式使用GNSS信号,我们将证明视觉惯性系统可以通过可靠的导航解决方案运行数十公里。

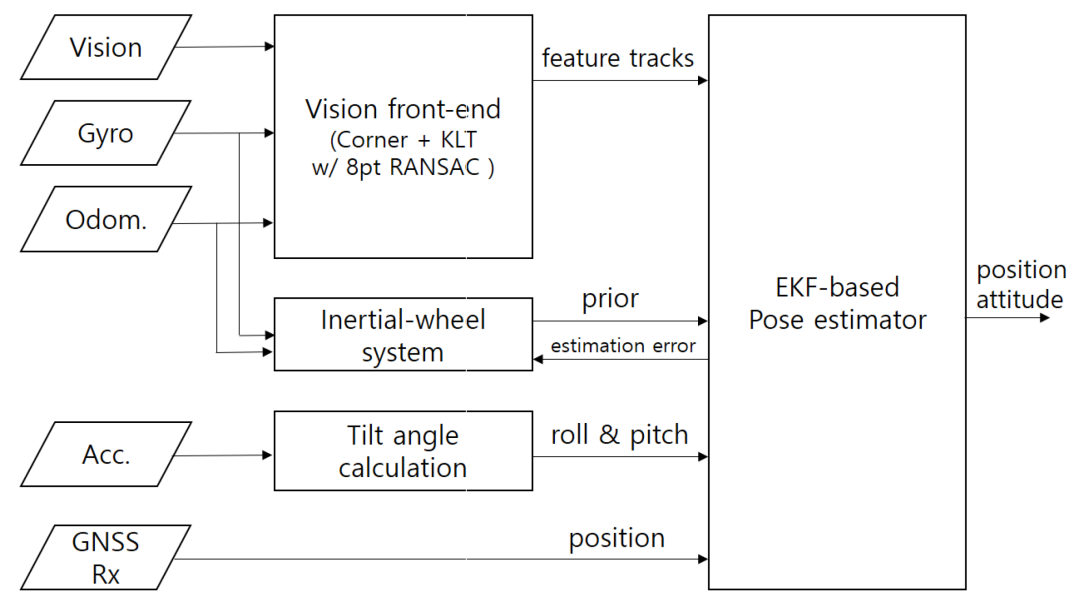

4 方法提出

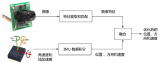

基于我们之前的工作[47],其中提出了3DDR/GPS集成系统,我们新设计了专门用于陆地车辆的VIO,称为视觉惯性车轮里程计(VIWO)。图3绘制了拟议系统的总体流程图。我们向估计器提供4种类型的信息:来自视觉前端的特征轨迹、来自惯性轮系统的先验信息、来自加速计的倾斜角度以及来自GNSS接收器的全球位置。给定低级别IMU,我们从系统动力学中排除加速计读数,但仅将其用作倾斜(侧倾和俯仰)角度测量。优雅但简单的修改避免了噪音加速计读数的双重集成;相反,它需要车辆速度的单一积分。此外,视觉测量进一步减少了由车轮滑移和陀螺仪的时变偏差产生的位置漂移。

在下文中,我们详细描述了滤波器结构,并推导了误差状态方程中的解析雅可比矩阵。然后,我们分析地证明了可观测性,以通过利用封闭形式的线性化模型加深对所提出系统的理解。

图 3 所提出方法的概述,视觉惯性车轮里程计(VIWO)

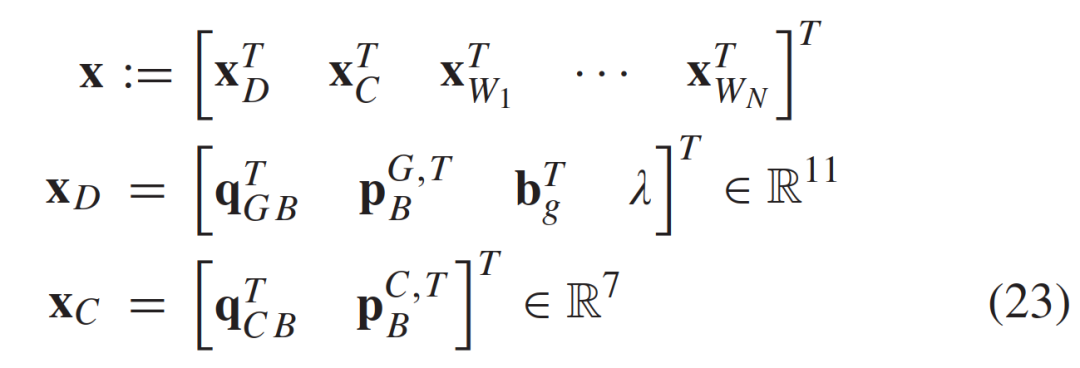

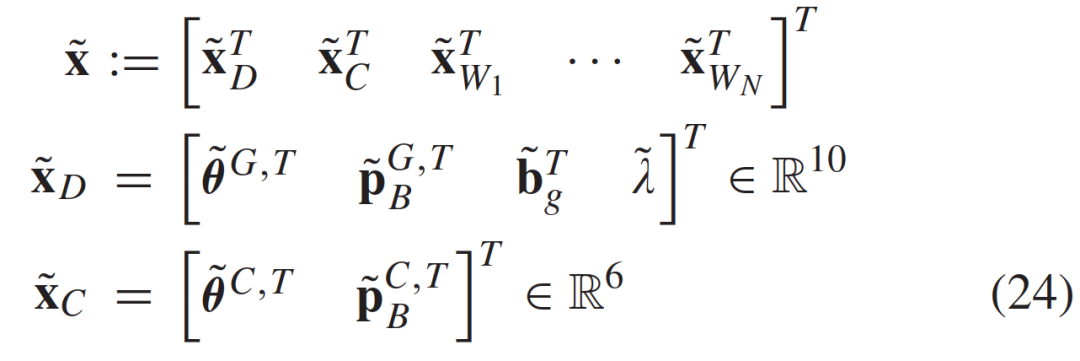

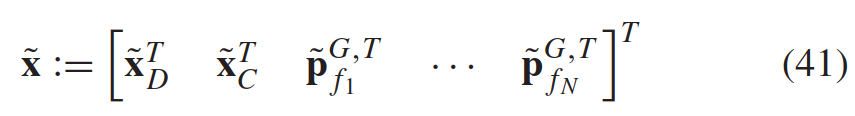

A.状态矢量

VIWO的过滤器状态由主体、校准(主体到凸轮)和滑动窗口状态组成,即

其中是车轮里程表的比例因子,它与视觉比例因子等效,因为特征深度由平移运动缩放。和是和的外参,在(6)中定义。由于我们只知道从摄像机的安装角度和位置猜测的的近似值,因此我们在在线将它们精细地估计为过滤器状态。

因此,误差状态是

其中在(9)中定义。旋转误差的定义类似于(1),

因此,误差状态的维数为。

B.使用轮子的系统模型

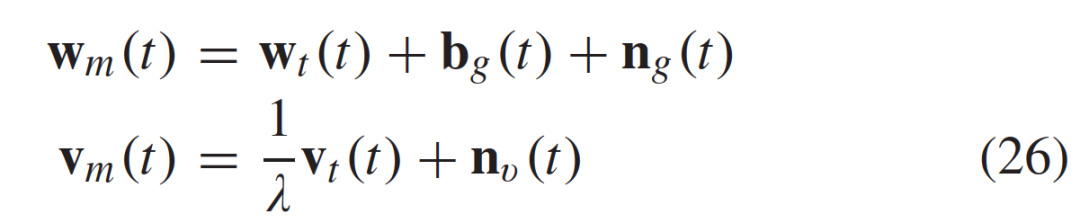

在具有3轴陀螺仪和1轴里程表的惯性轮系统中,传感器读数建模为

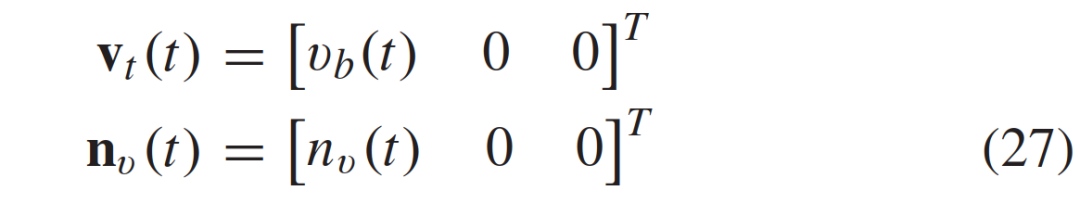

陀螺仪的测量如(10)所示建模,里程表读数通过比例因子和加性零均值白高斯过程进行缩放。回顾以非转向轴为中心的的定义,车身速度和噪声如下

因为NHC在中确实有效。注意,我们假设和是一致的,而不丧失一般性。

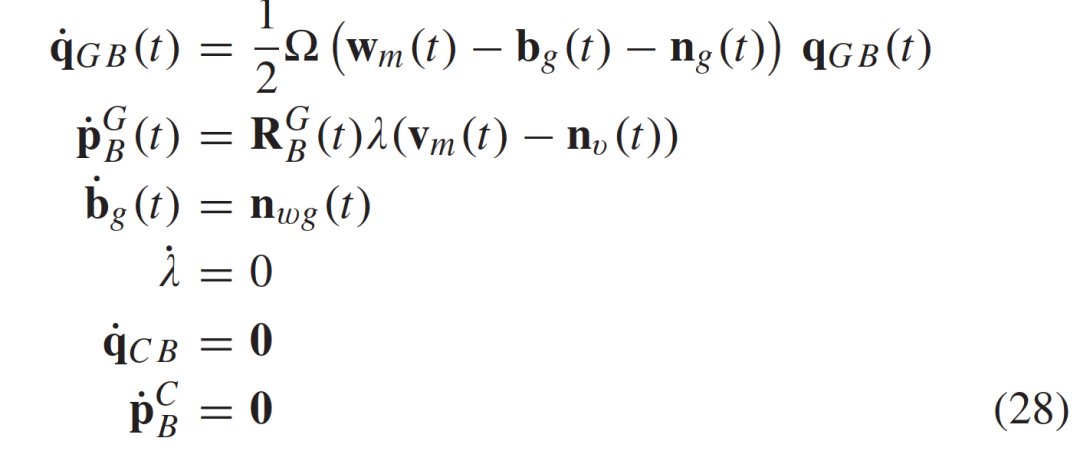

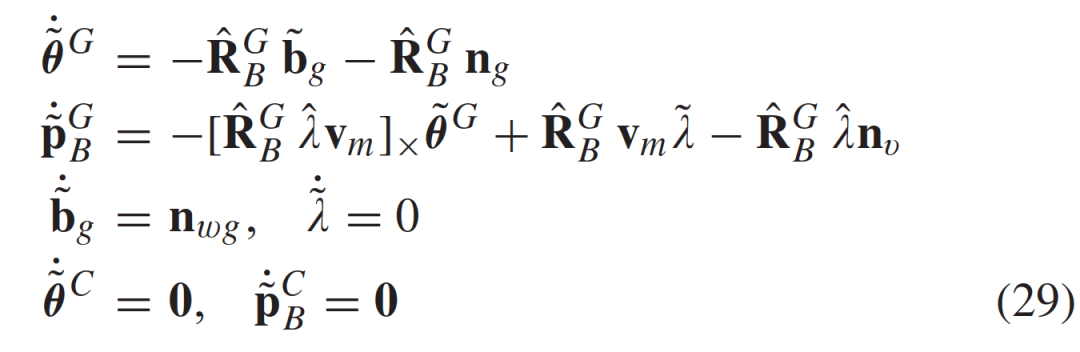

在实践中,我们在开始算法之前,通过使用加速计的倾斜角度来调整IMU相对于垂直于重力方向的表面的读数。然后,连续时间非线性系统模型被表示为

在此公式中,我们将比例因子和校准参数建模为随机常数。将泰勒级数扩展到一阶,很容易看出误差状态方程为

其中我们省略了输入参数,以简化符号。

(29)的连续时间表示在上

状态转移矩阵的封闭形式和噪声矢量在附录A中导出。滤波器协方差基于(30)传播。

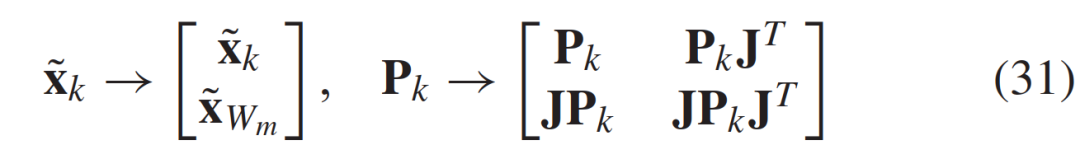

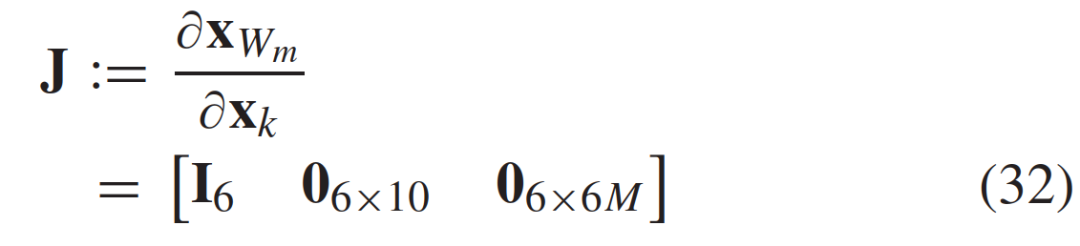

C.状态增强

当满足特定标准时(例如,当前和最新滑动窗口姿势之间的距离超过用户定义的阈值,或者每当新图像可用时),当前身体姿势被增强到过滤状态。假设是无偏电流滤波器状态,且,则扩充执行以下计算

雅可比矩阵为

其中是滑动窗口的当前数量。

D.在线校准的测量模型

VIWO利用了三种嵌入式传感器的测量结果:摄像头、加速计和GNSS接收器。由于我们添加了校准参数,视觉相关模型将不同于(22)。我们描述测量方程并依次导出每个雅可比矩阵。

1)视觉特征跟踪:从第帧观察到的第个特征位置参数化为

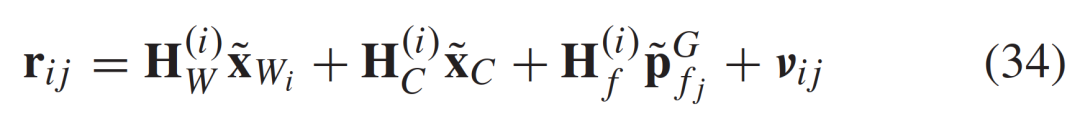

与(20)相似,线性化的模型为,

由误差状态扰动(33)并忽略一阶项产量

遵循与(21)和(22)中相同的过程。

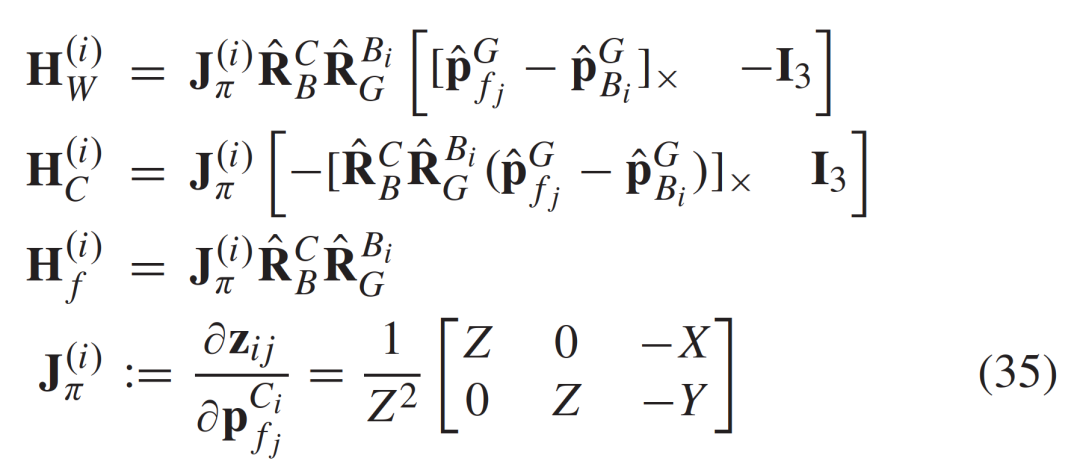

2)倾斜角:从加速度计获得的特定力仅用于限定车辆的倾斜角。众所周知,滚动角和俯仰角根据加速度计读数计算如下[2]

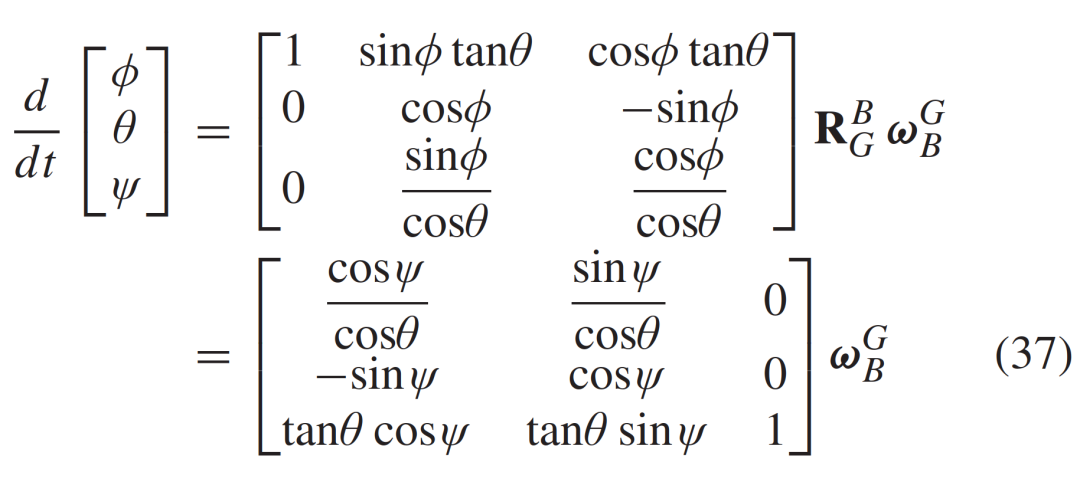

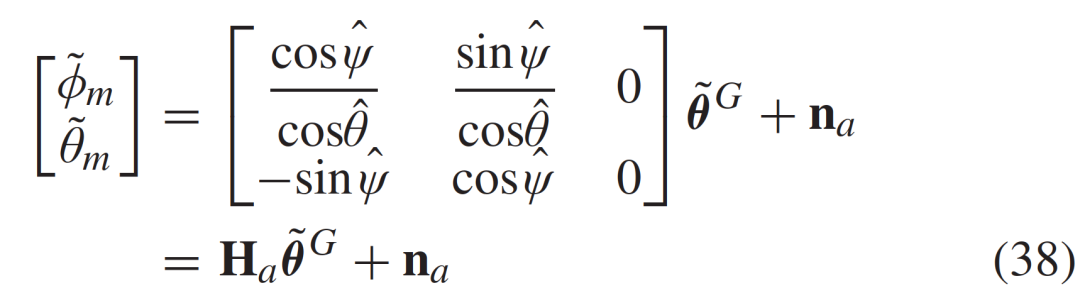

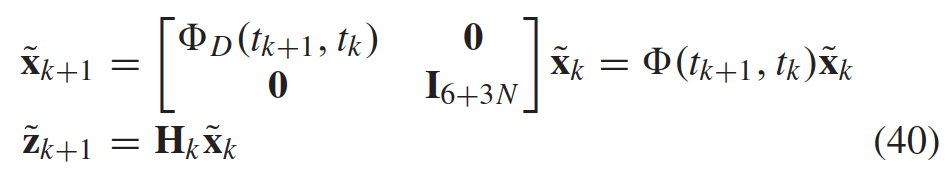

这里,和分别是测量车辆的侧倾角和俯仰角,是加速度计测量值。由于我们的滤波器状态不是用欧拉角表示的,因此我们必须推导出姿态误差和欧拉角误差之间的误差状态关系。

根据欧拉角速率和体速率之间的关系,我们有以下等式,

DCM分解为,代表角速率。因此,测量模型为

为零平均高斯噪声。

然而,比力包括重力和身体加速度,其中身体加速度作为计算倾角的扰动。我们采用[47]中的适应方案:如果,协方差矩阵被增加,使得方差在中被预先调整的值膨胀。根据[47]中的数值模拟,我们设置。

3)GNSS位置:通过GNSS接收机计算车辆的全球位置,每当GNSS的导航解决方案可用时,滤波器就更新其位置。很容易看出,测量模型是

其中是位置测量,是零均值高斯噪声。当GNSS位置可用时,比例因子是可观察的,因此可以恢复视觉特征的深度。知道视觉特征的深度意味着单眼视觉模糊性已经得到解决。在实践中,没有GNSS位置的尺度模糊性起着次要作用,因为在我们的现场测试中,的变化仅小于1.5%。

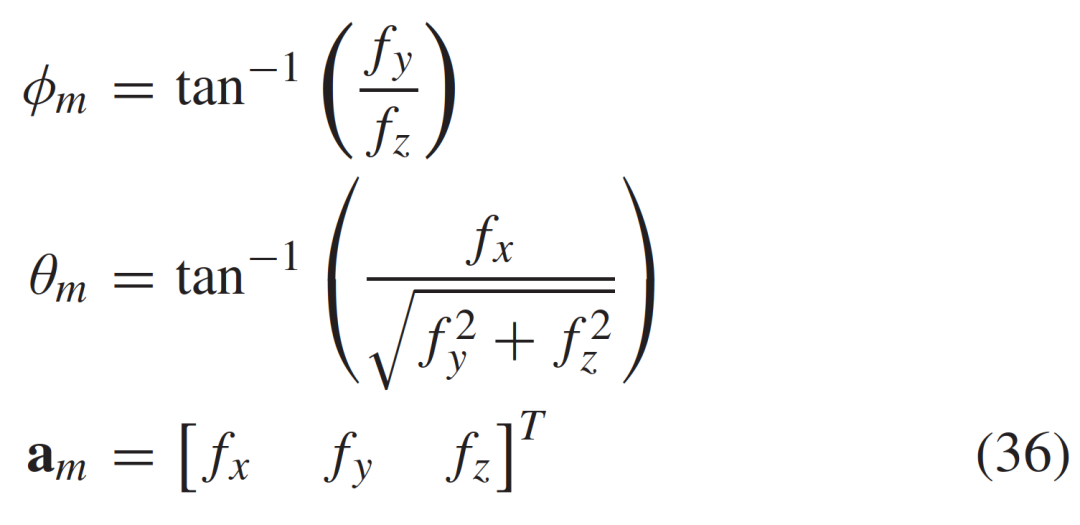

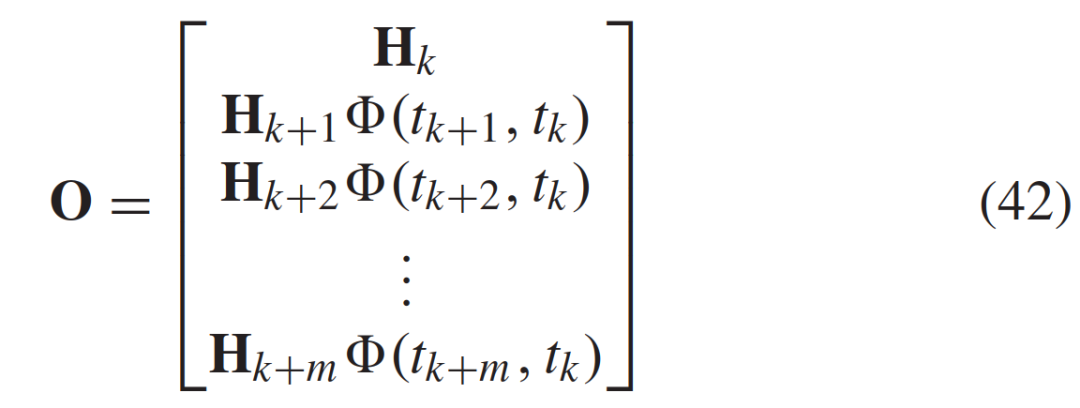

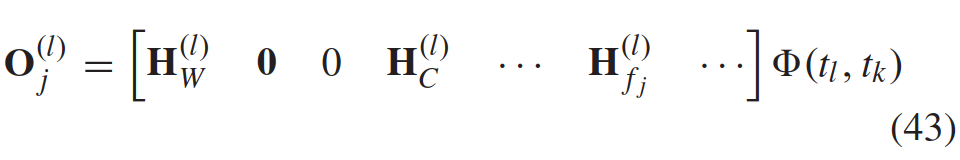

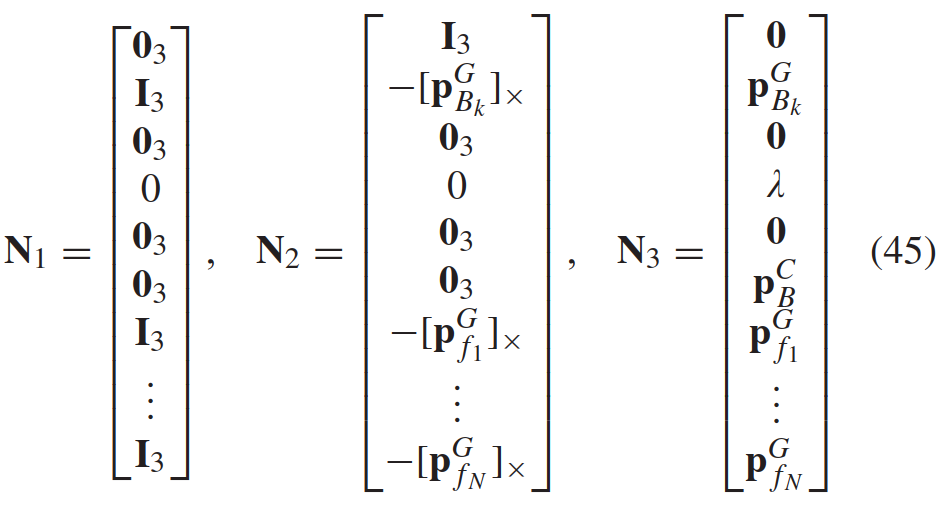

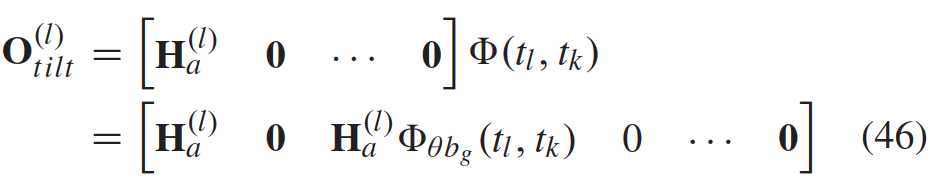

E.可观测性分析

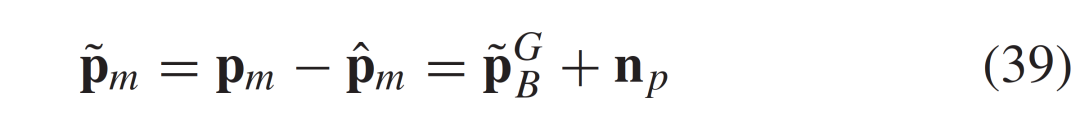

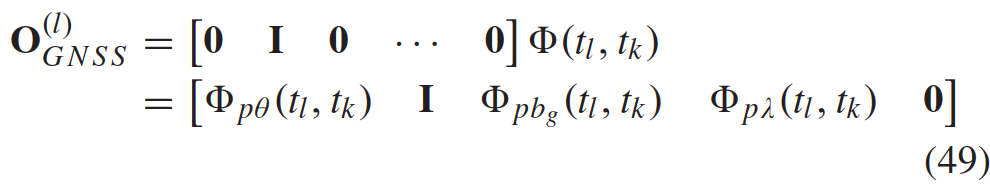

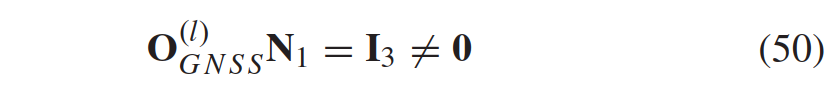

可观察性是滤波器设计期间应检查的最重要的系统属性之一。换句话说,它问“初始状态能否在有限时间内给定系统模型(30)和测量值(34),(38),(39)唯一地获得”。我们通过呈现可观察性特征(包括视觉、倾斜角和位置测量)来提供我们滤波器设计的有效性,这些是自动驾驶汽车中最常见的传感器之一。由于噪声不影响可观察性特征,因此我们去除了噪声项。此外,还表明MSCKF和EKF-SLAM是线性高斯系统[10]的等效最大后验(MAP)估计量。因此,我们以EKF-SLAM的形式分析线性化VIWO以简化分析。从技术上讲,唯一的区别是滤波器状态和视觉测量:滑动窗口被特征位置取代,我们使用零空间投影之前的测量模型。

因此,我们考虑以下线性化系统

EKF-SLAM状态为

这里,是特征点的个数。

系统的可观察性矩阵为

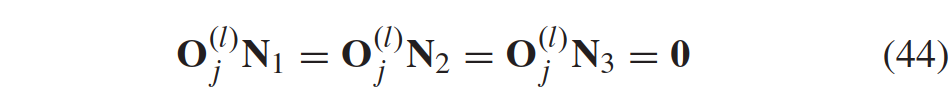

命题1:给定视觉测量,全局位置和旋转(横摇、俯仰、偏航)以及尺度是不可观测的。

证明:第个特征的可观测性矩阵的第块是

其中点表示零矩阵,并且在(35)中导出雅可比矩阵。显而易见

第一个不可观测方向和第二个不可观察方向分别对应于全球平移和旋转,第三个基础是移动平台的尺度。

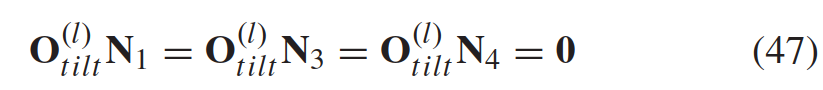

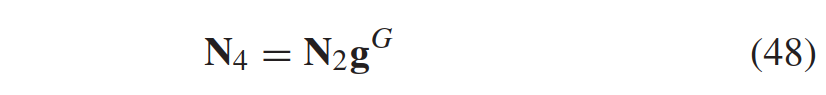

命题2:给定视觉和倾斜角度测量,全球位置、围绕重力的旋转(偏航)和尺度是不可观测的。

证明:倾斜角度测量将额外的可观测性矩阵添加到(43),即

其中在(38)中导出雅可比矩阵。通过附加的可观测性矩阵块,的第一和第二基不再跨越不可观测子空间,但、和是不可观测方向,即

是对应于围绕重力方向的旋转的的第三列。

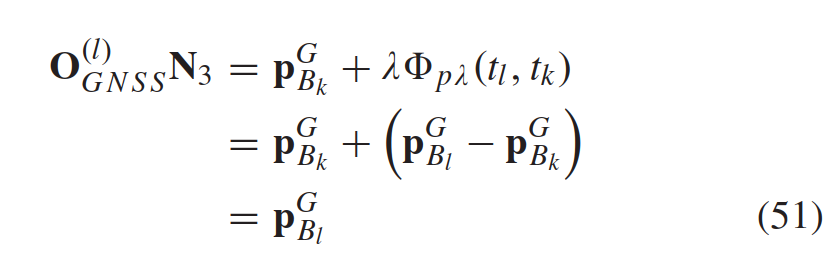

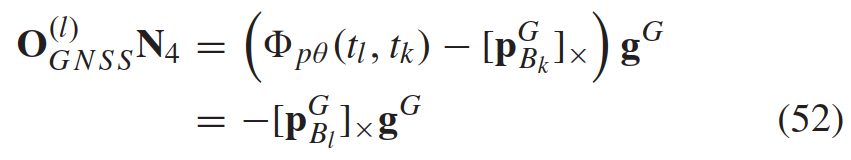

命题3:给定视觉、旋转角度和全局位置测量,(40)的所有状态都是可观察的。

证明:为了证明这个命题,通过增加额外的可观测性块,足以证明、和不再是不可观测的方向。

将可观测性块矩阵右侧的、和相乘

如果车辆在中停留在的原点,则(51),(52)是零向量。然而,这在我们的案例中很难实现,因为我们考虑的是在给定时间内不静止的车辆。

5 模拟实验

我们在虚拟和现实世界环境中评估所提出的方法。对于前者,为了反映陆地车辆在物理上可行的导航剖面,我们根据KITTI数据集[44]中的地面真实速度和姿态生成模拟轨迹。对于后者,我们将我们的方法与KITTI基准数据集中最先进的VIO算法进行比较。此外,我们在数十公里的驾驶序列中广泛评估了我们的方法,其中包括隧道和街道峡谷中的GNSS信号中断。

A.虚拟轨迹

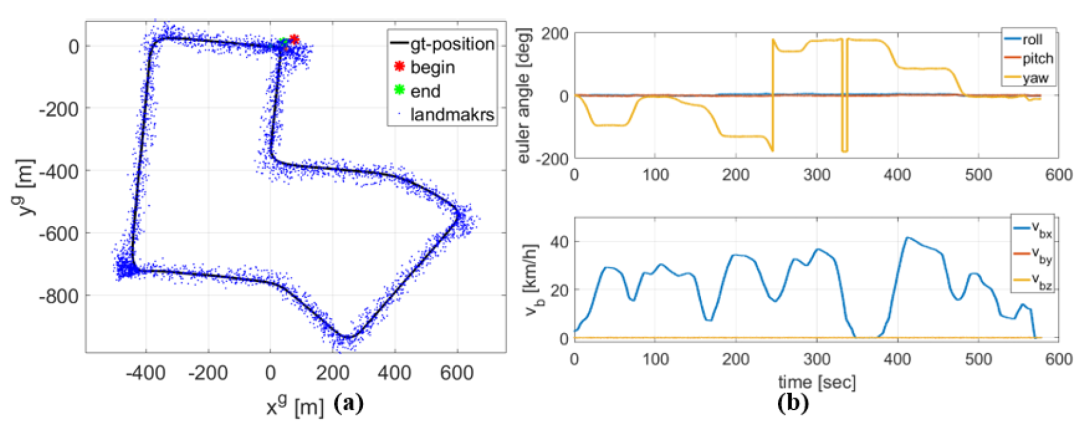

该测试的目的是验证VIWO的可观察性特征。我们采用来自KITTI的20110930_0027序列的真实速度和姿态,并生成IMU、里程计和特征测量。图4绘制具有地标的导航剖面,其中最大滚动角和俯仰角分别为5.13和2.86度,平均速度为21.6公里/小时。我们将和设置为零来模拟NHC。此外,我们为每个连续的8个滑动窗口集生成10个虚拟特征轨迹。换句话说,我们假设随机生成的特征点在8个视图上得到了很好的跟踪。

图4使用20110930_0027序列的虚拟轨迹:(a)x-y平面中特征点的位置,(b)欧拉角和物体速度

图4使用20110930_0027序列的虚拟轨迹:(a)x-y平面中特征点的位置,(b)欧拉角和物体速度

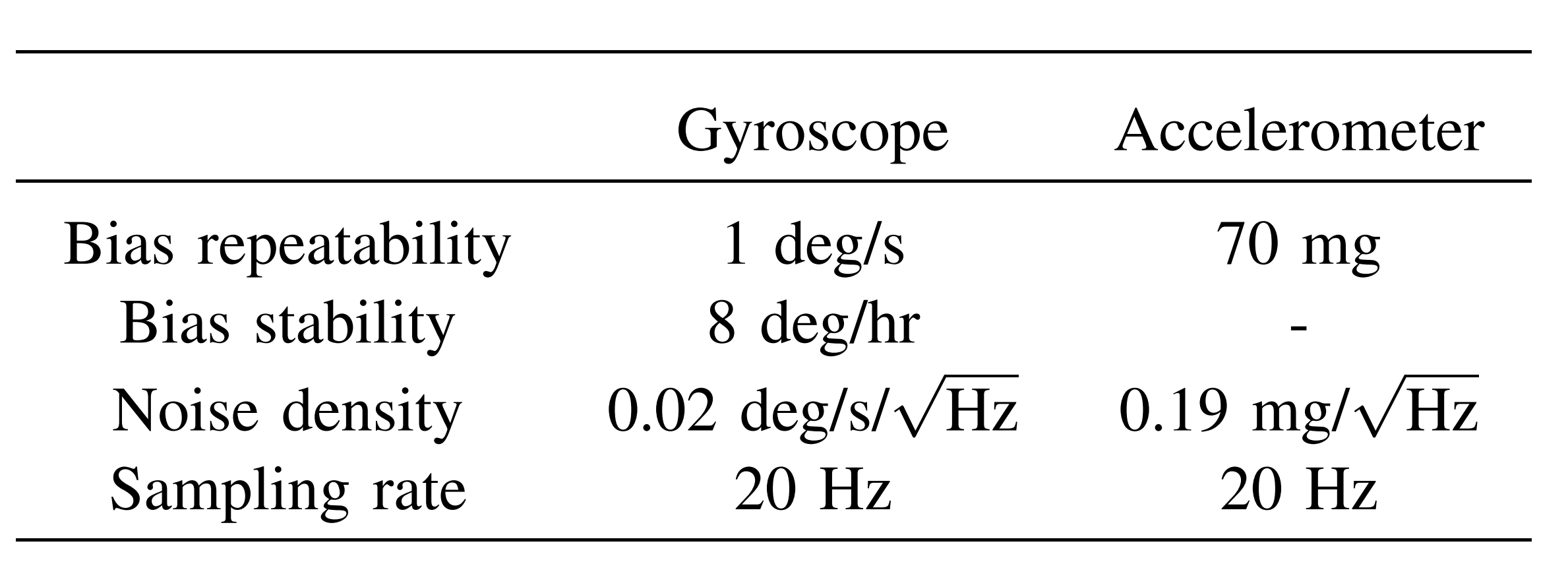

模拟传感器的规格基于我们的测试车辆。请注意,IMU的性能基于BOSCHSMI130(安装在我们的测试车辆中)以使模拟条件尽可能真实,并且我们在生成IMU测量时添加了偏置稳定性。规范总结在表I中。对于里程计测量,我们添加了一个密度为的高斯白噪声,并将比例因子设置为。对于虚像,空间分辨率为1280×800视野(FOV)为57.2度,采样率为7fps,测量噪声为2.5像素。和之间的空间标定参数的初始不确定性分别设置为1度和30厘米作为标准偏差。

表 1 低级IMU规格

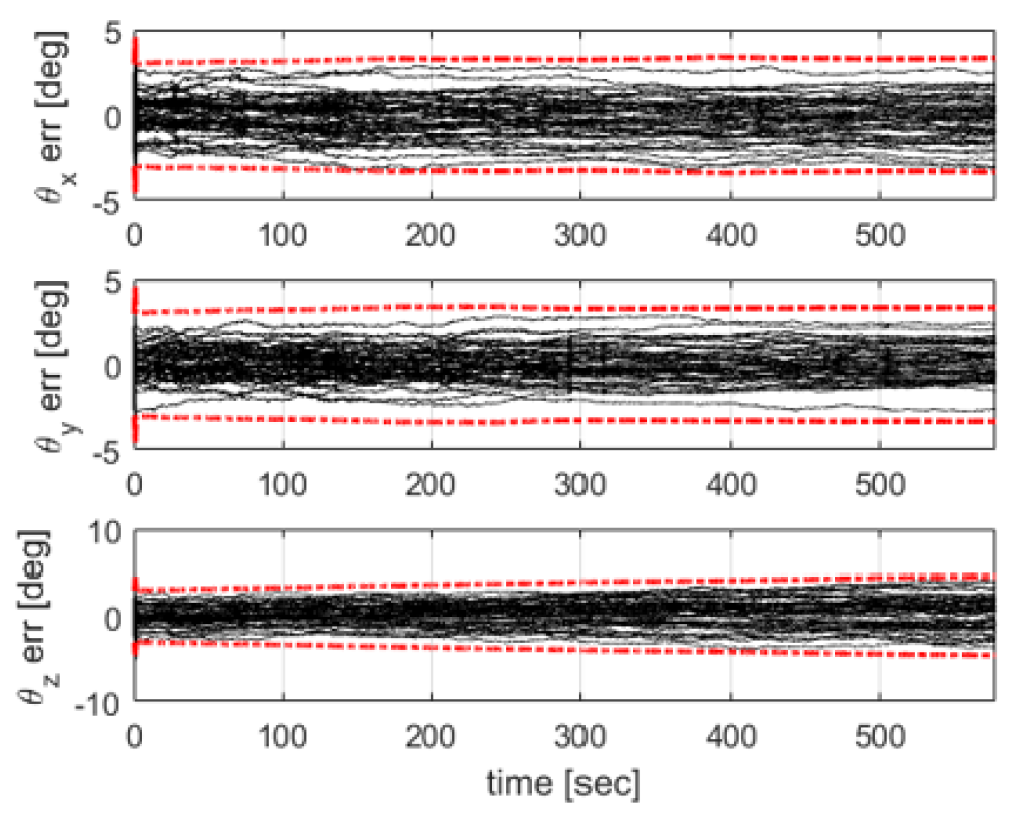

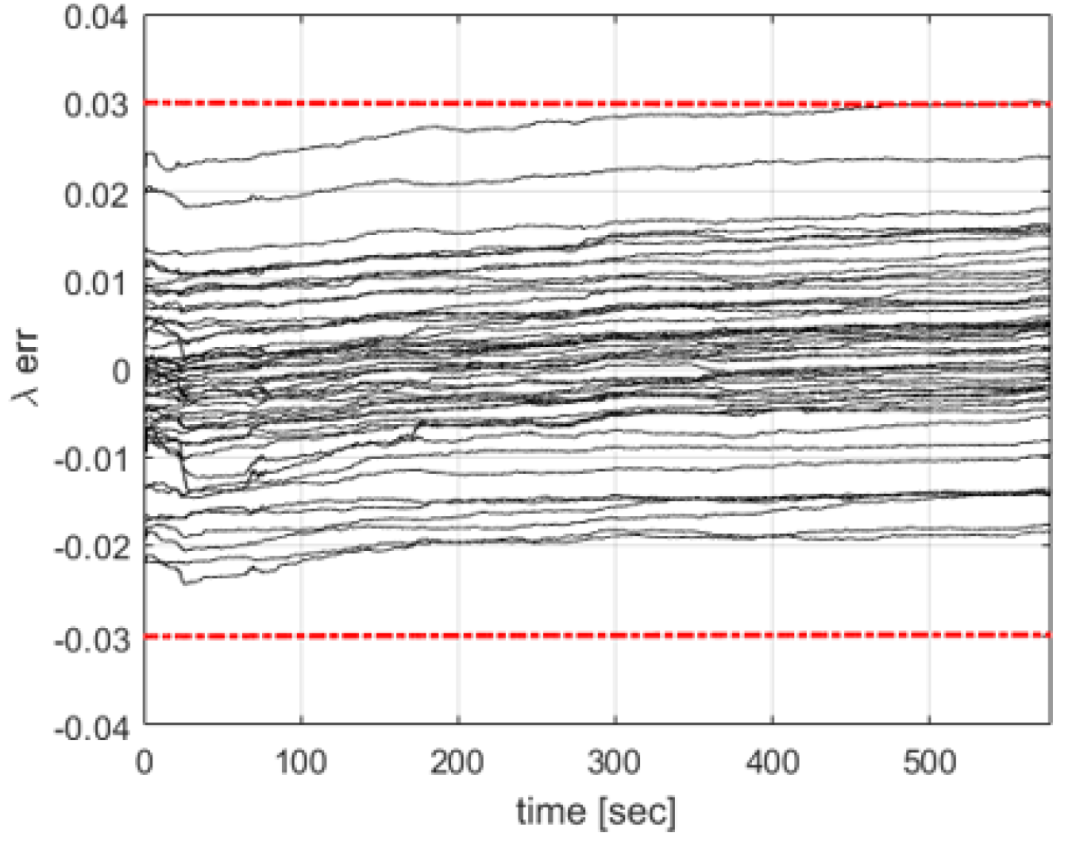

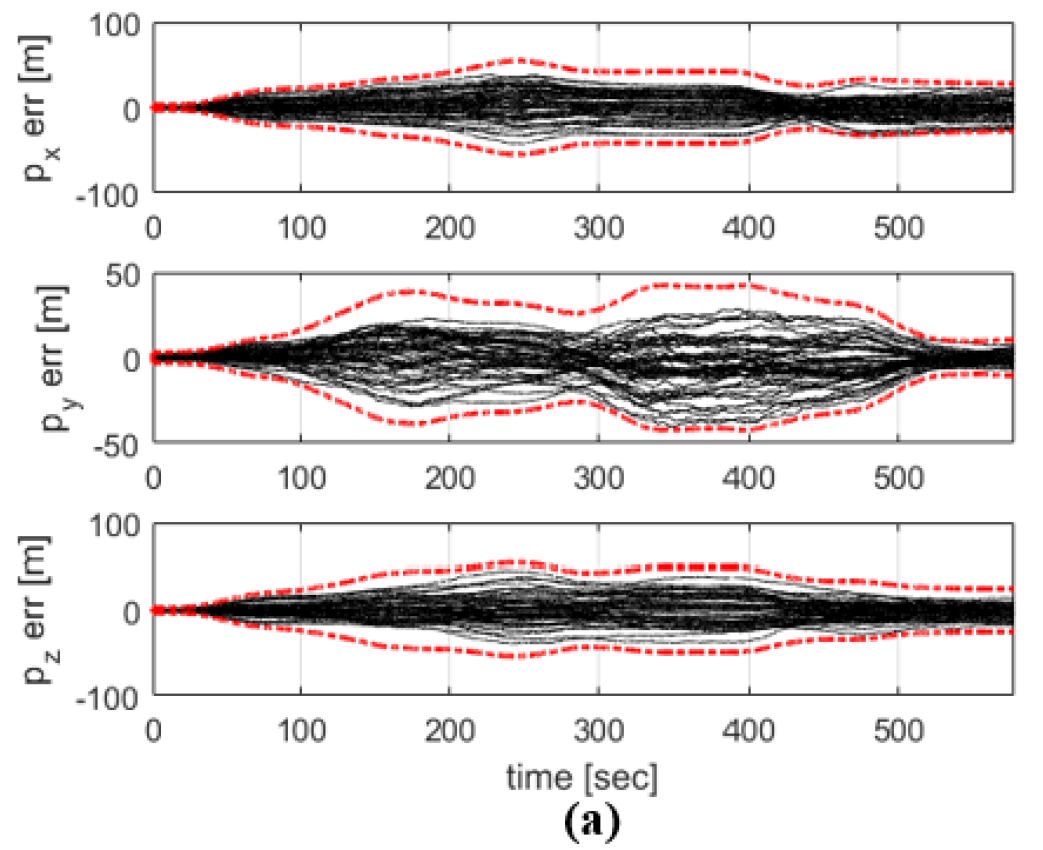

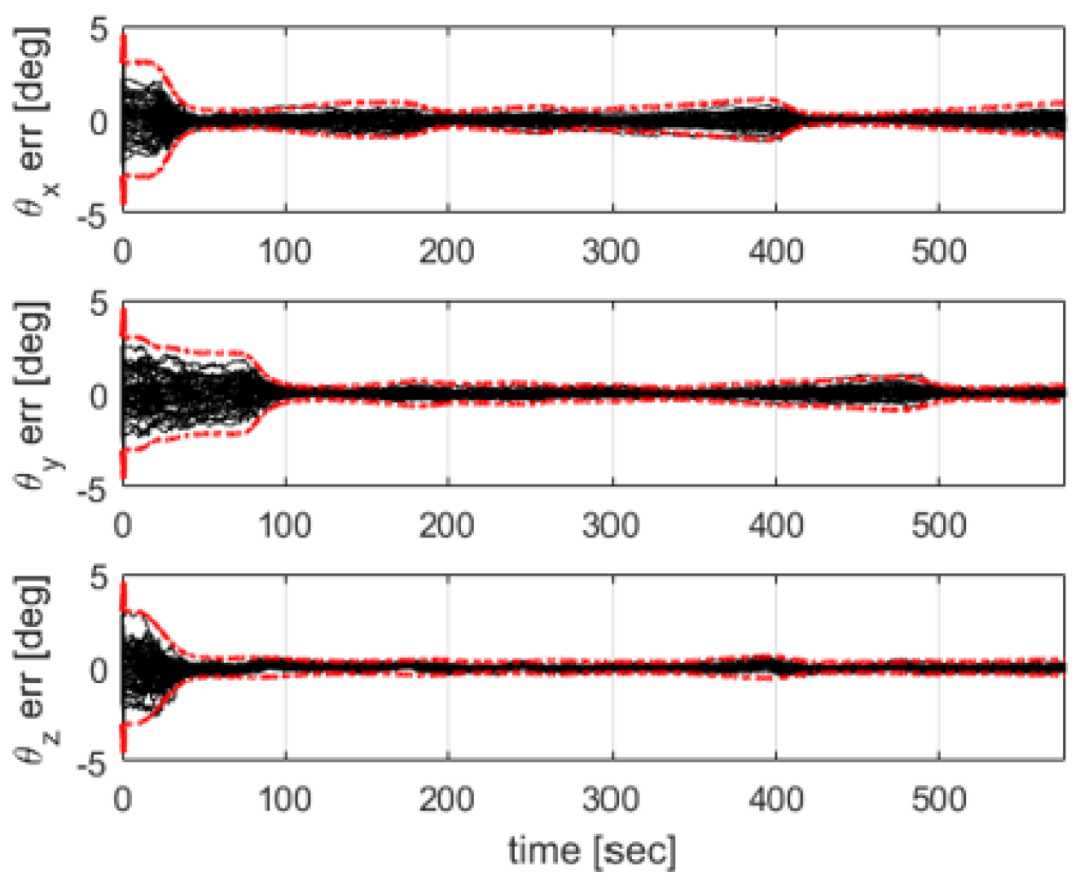

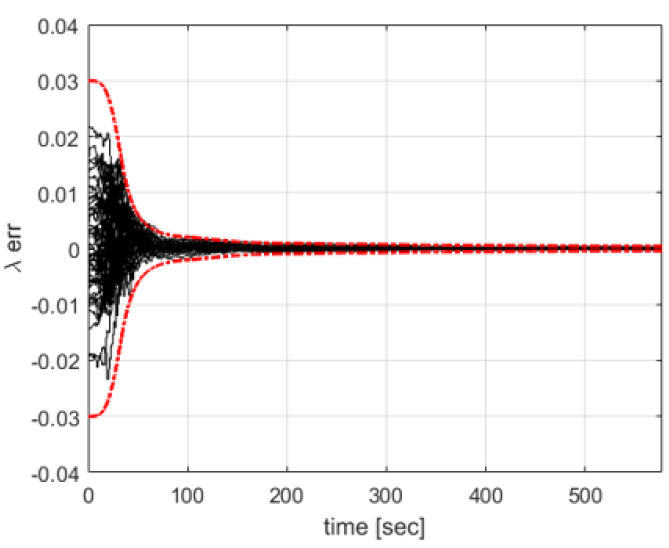

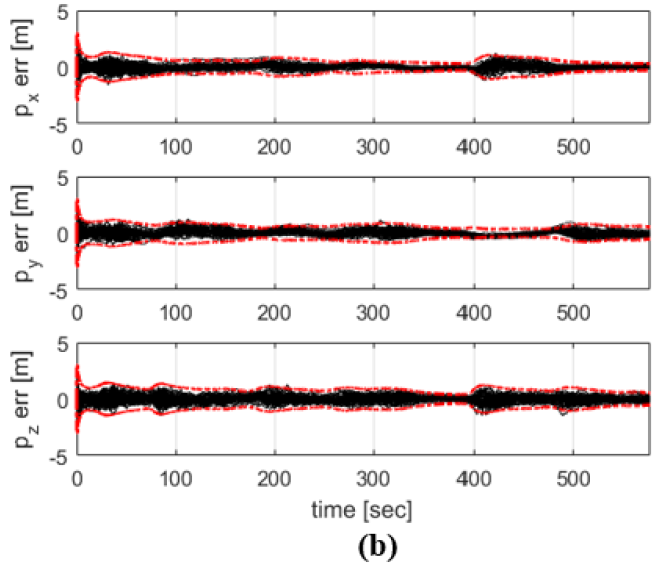

最后,我们假设身体框架的全局位置是用来自GNSS信号的的不确定性来测量的。我们仅使用视觉测量(VIS)和视觉、倾斜和位置测量(VIS+ARS+GNSS)在两个场景中进行了50次蒙特卡罗模拟。图4绘制了仅使用视觉测量时位于不可观察子空间上的选定误差状态,即和。在图5(a)中,姿态和比例因子的不确定性分别单调增加并保持不变。在某些情况下,位置不确定性会降低,但这并不一定意味着由于测量而导致的不确定性降低,因为(53)的状态转移矩阵包括产生波动的旋转矩阵。相比之下,所选状态不再停留在图5(b)中的不可观察子空间中,正如我们在第IV-E节中的分析所示。在实践中,只要GNSS信号可靠,我们就会更新VIWO;因此,不可观察的模式不会对估计器造成恶化的影响。

图5选定状态的50次Monte-Carlo模拟结果;具有3σ包络的姿态、位置和比例因子误差:(a)仅使用视觉测量VIS,(b)使用视觉、加速度计和GNSS位置测量, VIS + ARS + GNSS

B.KITTI基准数据集

我们将我们的方法与最先进的VIO进行比较:OpenVINS[20]是基于MSCKF的具有长期SLAM特征和在线传感器标定的VIO,没有VINS-Mono[8]使用IMU预集成的基于优化的VIO的闭环,以及基于关键帧的VIO优化视觉和惯性因素的OKVIS[15]。该实验的目的是针对最先进的VIO方法定量评估VIWO。

使用原始KITTI[44]数据的5个住宅序列。我们使用原始IMU测量(TacticalIMU)进行了两个实验,其中OXTSRT3003报告其偏置可重复性为1mg和0.01deg/s,偏置添加的IMU(LowIMU)具有70mg和1deg/s偏置以研究性能退化取决于IMU等级。注意为了尽可能公平地比较方法,我们提取每张图像最多150个点的特征,并将初始车辆速度设置为地面实况。估计器参数根据每个算法的IMU的偏差水平进行调整。

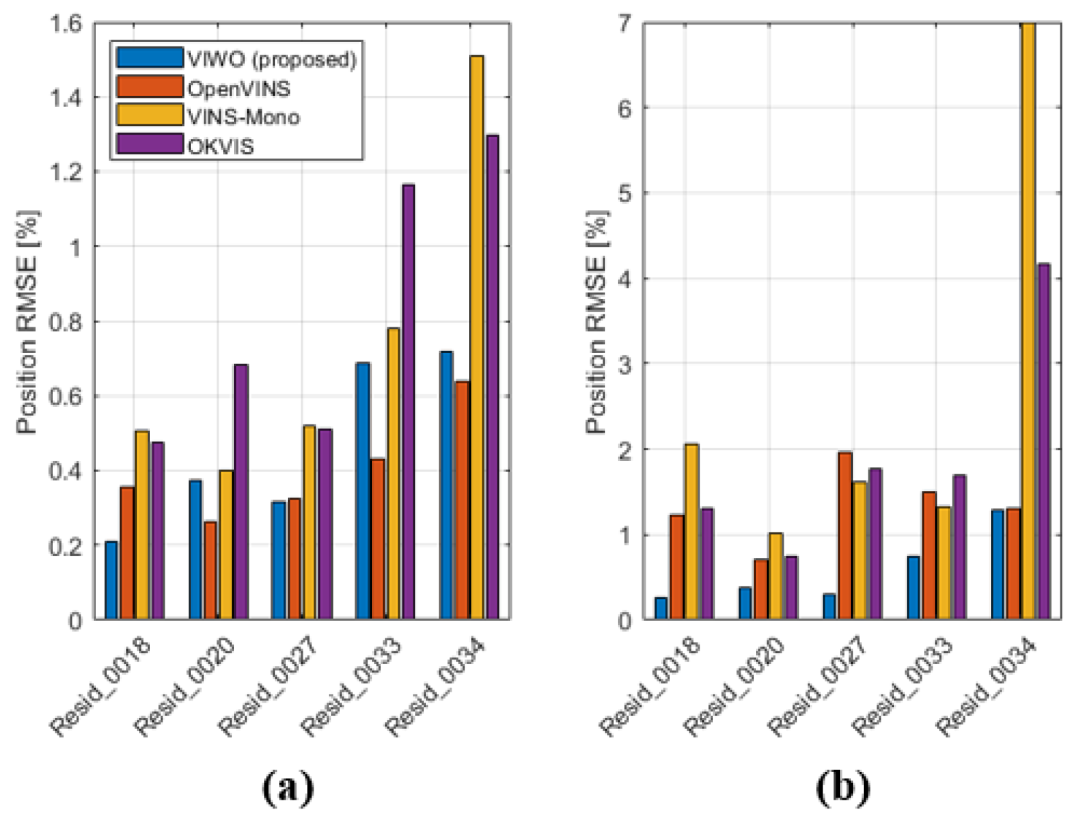

图6显示了3D位置误差漂移除以总距离。在TacticalIMU的第一个实验中,OpenVINS在5个序列中的3个序列中实现了最小的位置漂移,而我们的方法在图6(a)中的5个序列中的2个序列中显示了最小的位置漂移。也就是说,由于传感器偏差低,战术级IMU无法观察到我们方法的优势。然而,当使用图6(b)中的低级IMU时,我们的方法在整体位置漂移方面记录了最佳性能。在大传感器偏差下采用RISS避免了加速度计测量的直接集成。

图6位置RMSE为(a)战术级IMU和(b)低级别IMU的KITTI住宅序列中的漂移百分比。

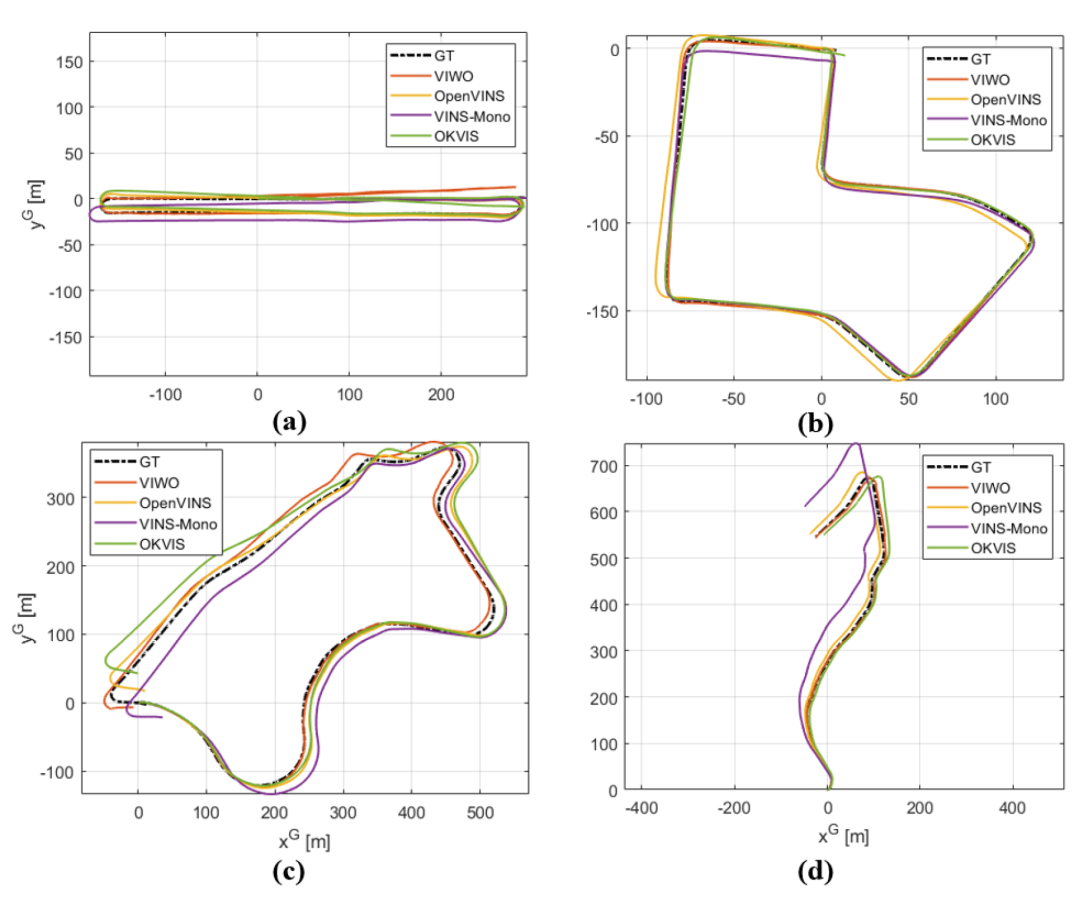

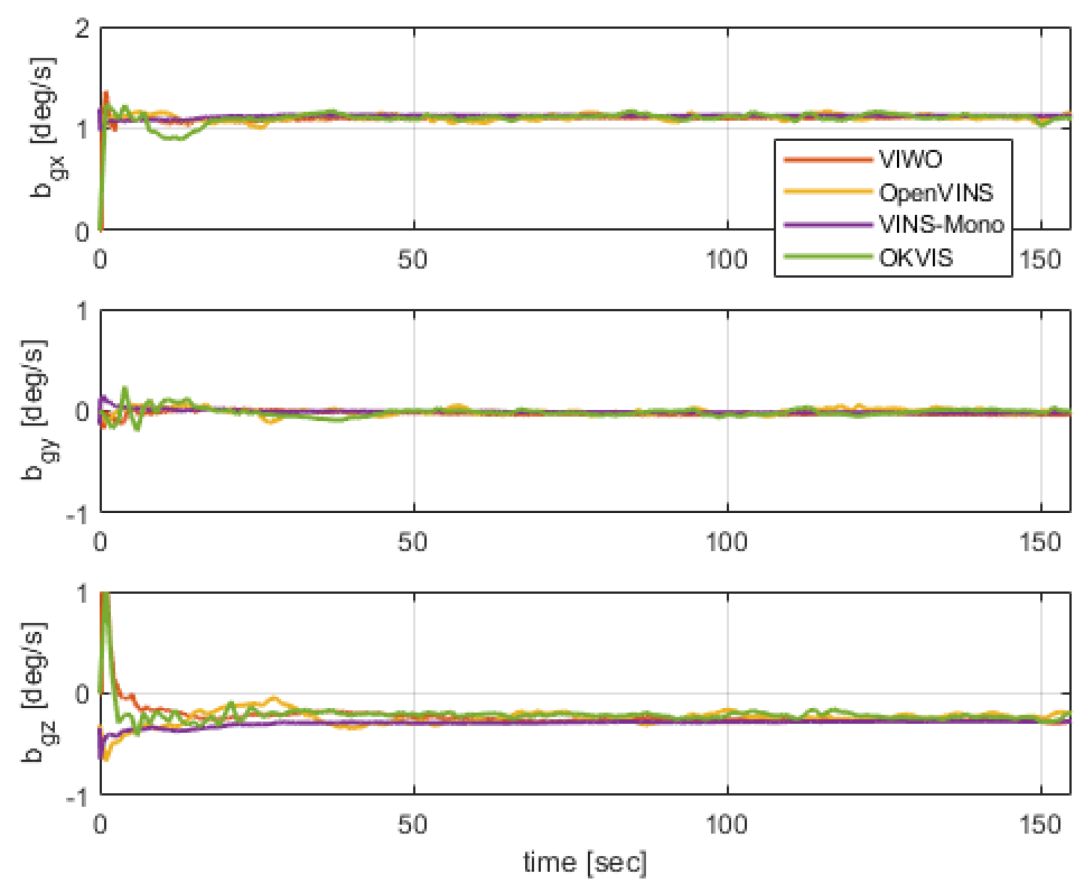

图7绘制了KITTI轨迹的俯视图以及位置漂移可视化的地面实况轨迹。陀螺仪偏差都收敛到大致相同的值,如图8所示。

图7在KITTI数据集中的估计轨迹:在低级别IMU设置下的(a)0930_0020、(b)0930_0027、(c)0930_0033和(d)0930_0034序列。

图8估计了低级别IMU中0930_0033的陀螺仪x、y、z轴偏差

所提出的方法的强度是明显的:当使用车轮里程计和带有几十mg偏差的低级别imu时,VIWO提供了最有效的融合结构之一。仅限加速度计偏差可以退化倾斜角。我们认为这是一个小缺点,因为陀螺仪偏差在VIWO中很好,如图8所示。但是,需要注意的是,VIWO不能纠正位置漂移如我们的可观测性分析显示,在没有绝对位置测量的里程计中的比例因子。为了解决尺度模糊,我们使用间歇的GNSS位置更新真实世界的驱动数据集。

C.实车实验

为了在充满视觉异常值(如移动物体和亮度变化)的远程和具有挑战性的现实环境中测试VIWO,我们使用图9所示的车辆记录了一个驾驶数据集。它包括一个IMU(博世,SMI130)、单目视觉(Onsemiconductor,AR0141CS)、GNSS接收器(Ublox,Neo-M8P)和参考模块(Novatel,SPAN-CPT)以提供真实轨迹。我们使用的IMU将陀螺仪和加速度计的零点偏移报告为1deg/s、70mg,噪声RMS报告为0.02、0.19。与第V-A节的模拟一样,图像传感器的分辨率为1280×800,FOV为57.2度。

图9后备箱内安装了输入模块和参考模块,摄像头安装在挡风玻璃上

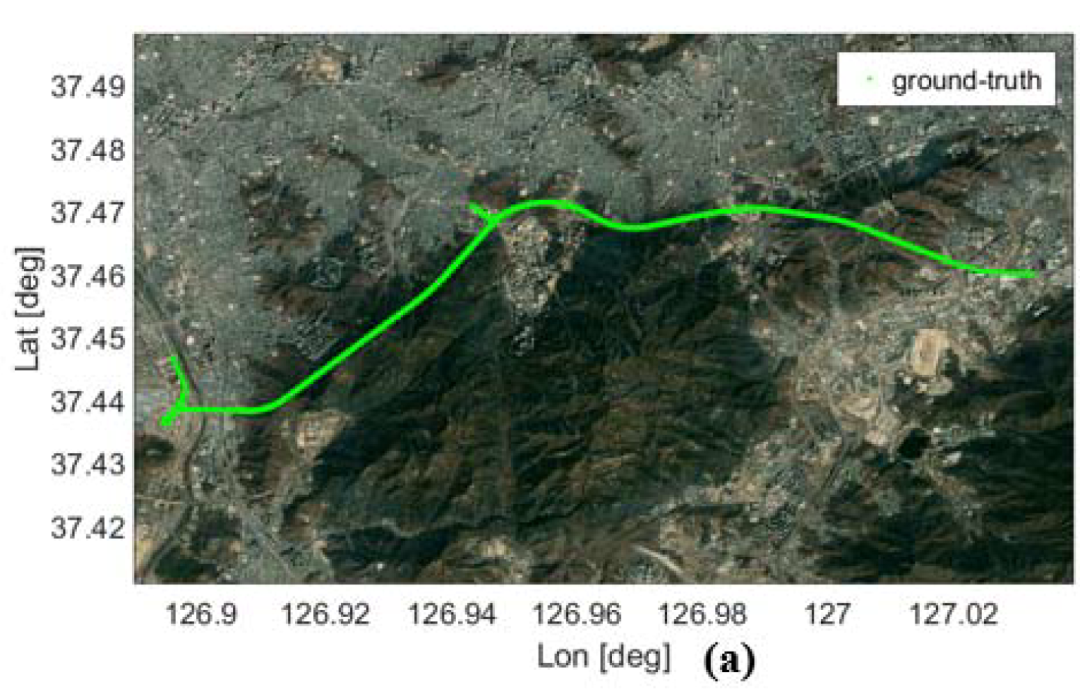

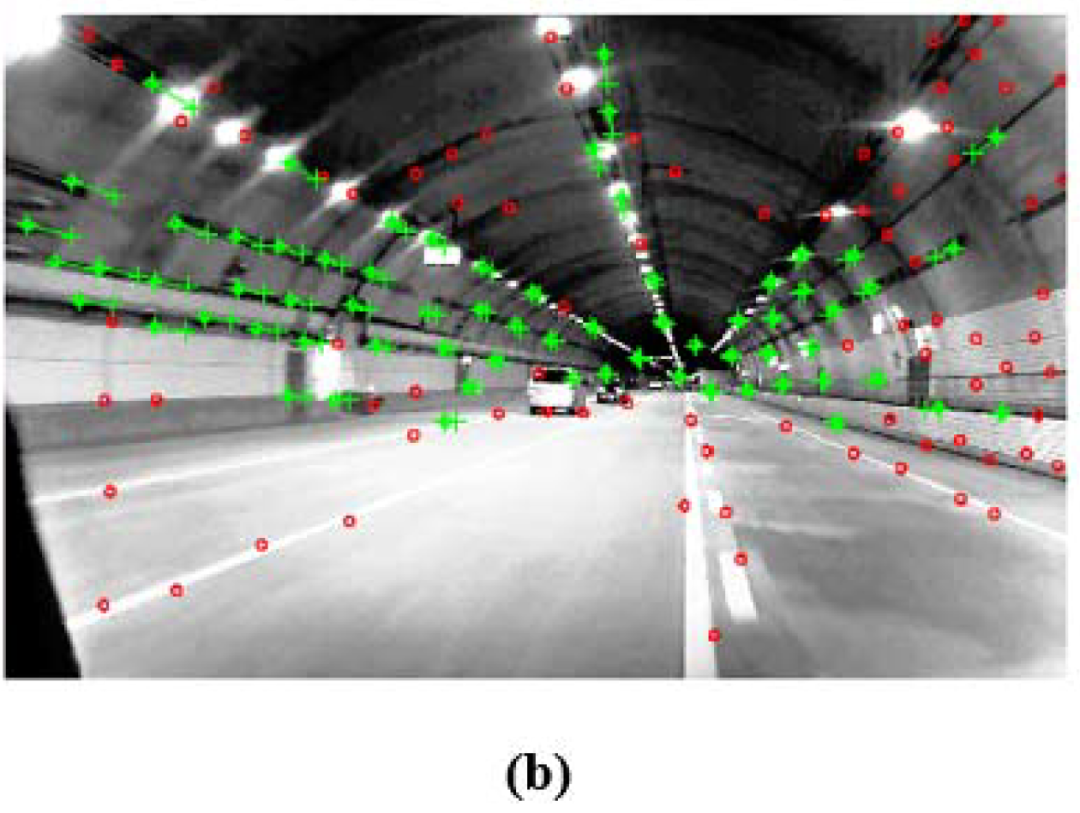

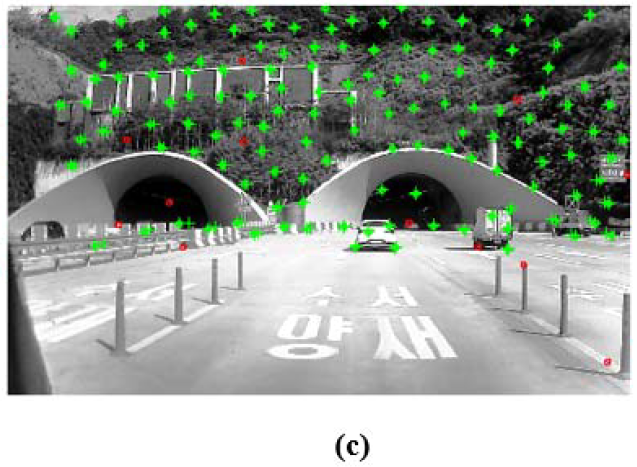

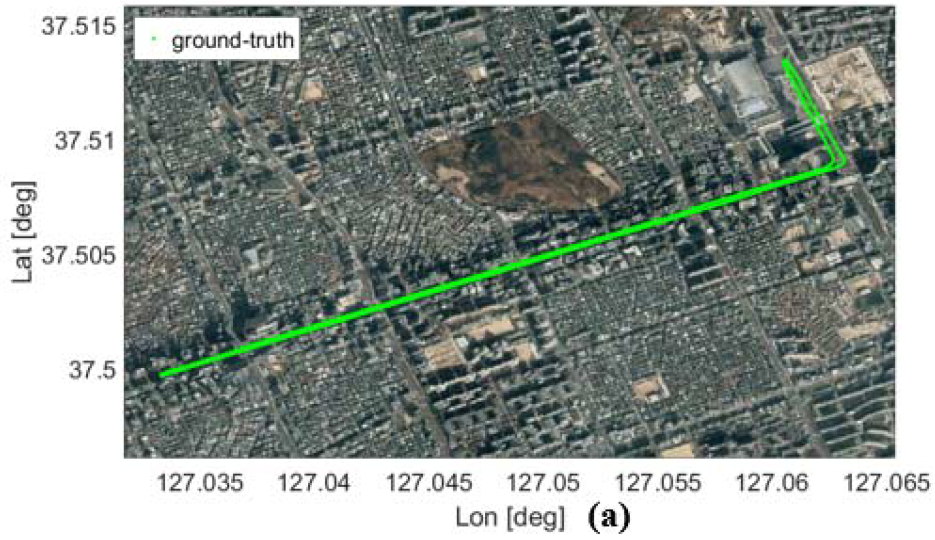

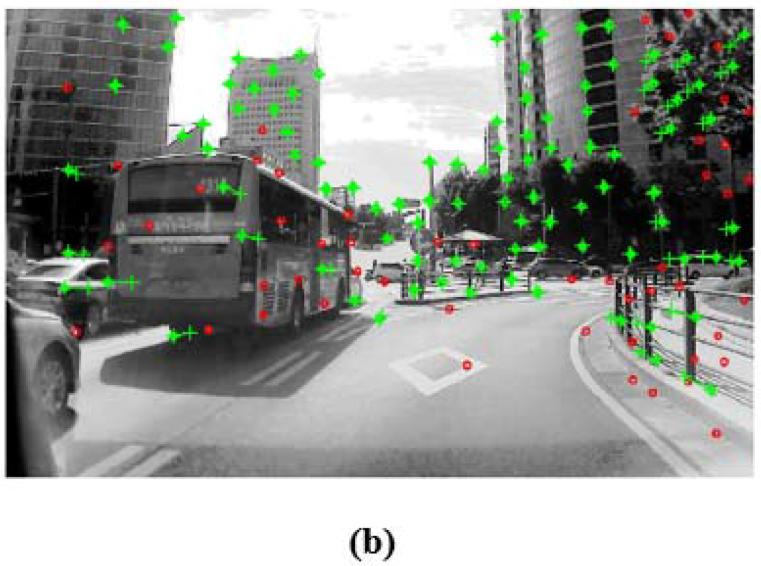

我们选择包括隧道和街道峡谷在内的驾驶课程,其中GNSS信号不可用且间歇性不可靠。隧道数据集的整个轨迹如图10(a)所示。司机往返31.3公里,用时30.4分钟,往返3条隧道,共6趟。图10(b,c)分别显示了穿越和进入隧道期间的示例图像。图像中的绿点表示跟踪到的特征,而红点表示未跟踪到的特征。同样,建筑数据集的图11(a)在29.7分钟内绘制了街道峡谷中6.74公里的路线的地面实况。图11(b,c)给出了具有驾驶视觉特征的样本图像。

图10隧道数据集:(a)3条隧道31.3公里30.4分钟,隧道(b)样本图像,隧道前(c)有绿点(跟踪特征)和红点(跟踪失败)。

图11建筑数据集:(a)在一个街道峡谷中,全长6.74公里,持续29.7分钟,(b,c)其样本图像。

视觉前端通过带有8点RANSAC的KLT跟踪器跟踪150个FAST角点[48],以排除一对连续图像中的视觉异常值。此外,为了在图像上均匀分布角落,我们将每个角落的最小距离设置为40像素。滑动窗口数量设置为12,并且通过在过滤器更新之前使用Levenberg-Marquardt算法最小化重投影误差来对超过3个视图的跟踪特征进行三角剖分。VIWO是在JetsonTX2中实现的,仅使用CPU的一个实时内核。在现场测试中,包括视觉前端和过滤器后端的CPU负载平均为38%。

我们将提议的VIWO与通过视觉特征跟踪以及来自里程表和GNSS接收器的速度和位置测量值更新的MSCKF进行比较。请注意,为了使两种算法尽可能公平,MSCKF还估计{C}和{B}之间的外部标定参数。我们将这种传统的VIO称为VIO。

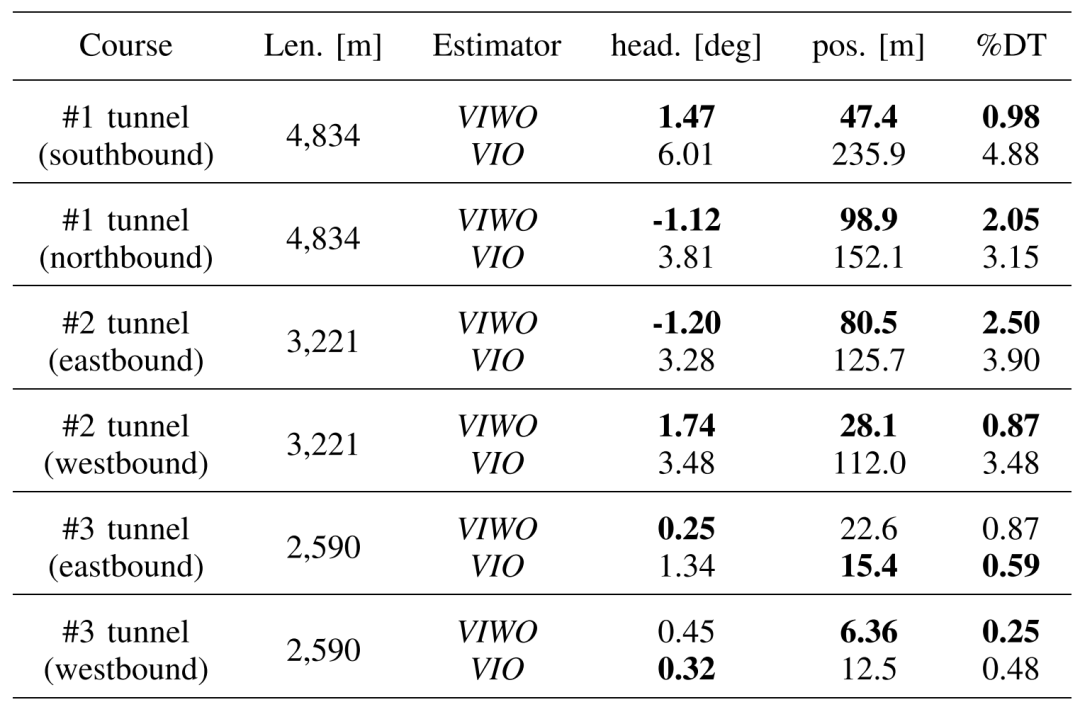

表 2 隧道数据中的航向和位置出口误差

表二总结了每个隧道出口处车辆的航向和水平位置误差,%DT报告位置误差除以相应隧道的长度。我们之所以选择出口误差是为了在GNSS中断区域竞争位置误差漂移。VIWO的平均%DT在6次遍历中为1.25%,而VIO显示为2.75%。这种改进源于以基于里程计的系统模型取代基于加速度计的系统模型。尽管VIO中的加速度计偏差是通过视觉特征和速度更新来估计的,但其70mg偏差水平的巨大不确定性会在估计器上产生很大的线性化误差。在数量上,与VIO相比,VIWO将位置误差降低了54.6%。

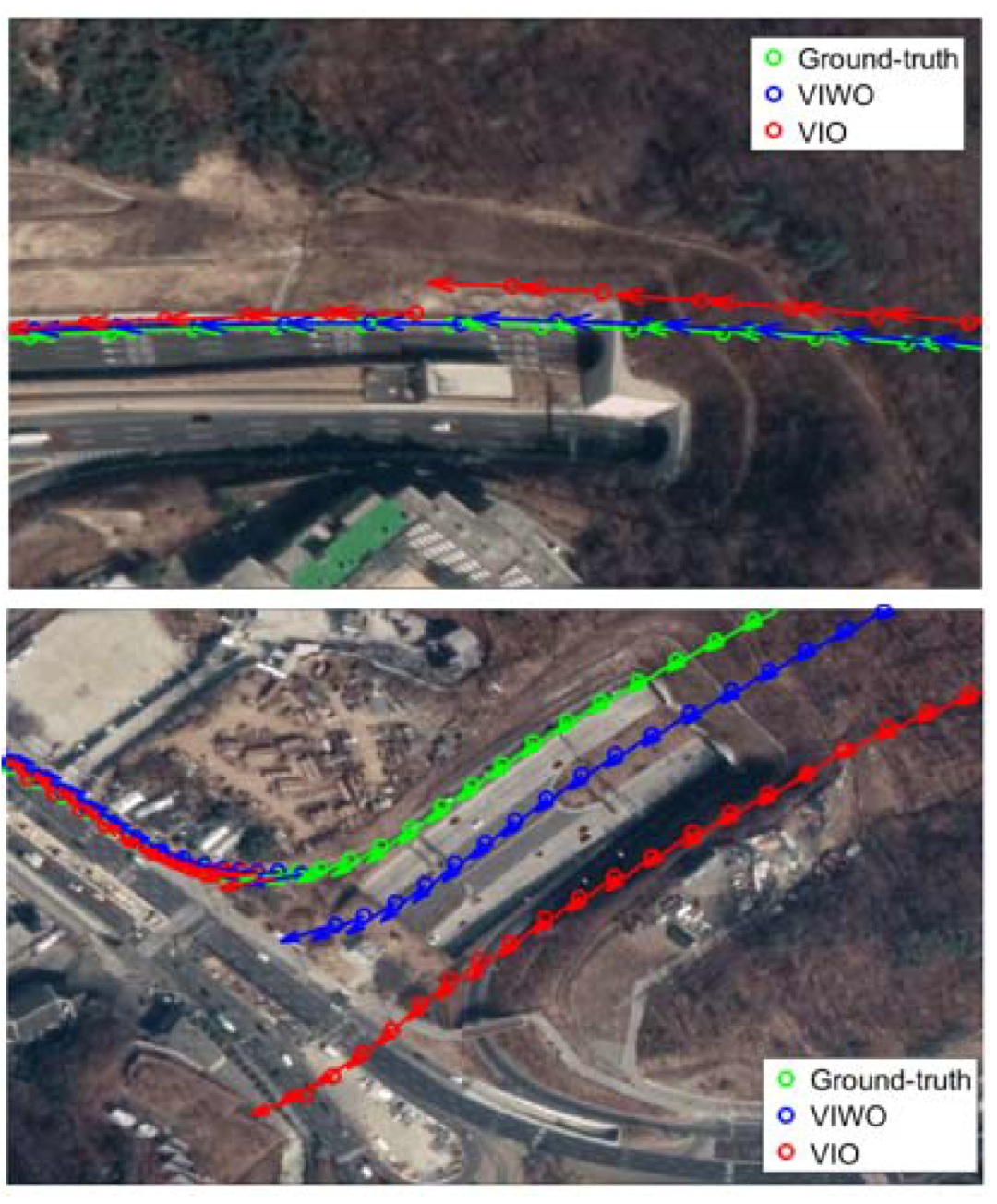

图12在2号和3号西行路线出口的隧道数据集中,每秒采样一次的带有航向(箭头)的车辆位置(圆圈)。

此外,图12显示了西行#2隧道(顶部)和#3隧道(底部)出口处的位置漂移。GNSS测量在信号可用时对位置进行校正,在校正前明显观察到地面实况和估计轨迹之间的差异。所提出的VIWO表现出比VIO低得多的误差漂移。

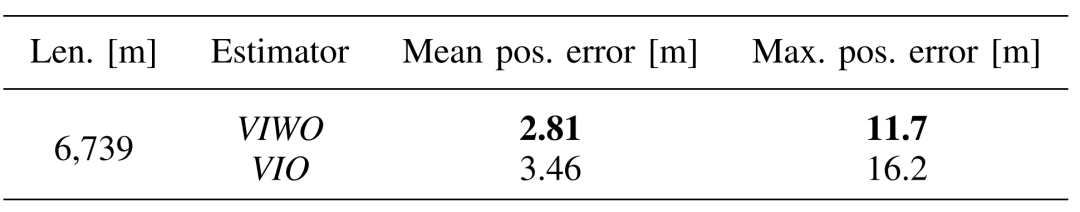

在建筑数据集中,我们评估了车辆在整个驾驶过程中的平均和最大最大位置误差,包括GNSS中断和开放天空区域。我们根据精度稀释度(DOP)和可见卫星数量整理出可靠的GNSS定位方案,数据集中GNSS可用率为55.4%。表III报告了街道峡谷整个过程中的平均和最大水平位置误差。与VIO相比,VIWO将平均位置误差降低了0.65m。

表 3 建筑数据中的平均和最大位置误差

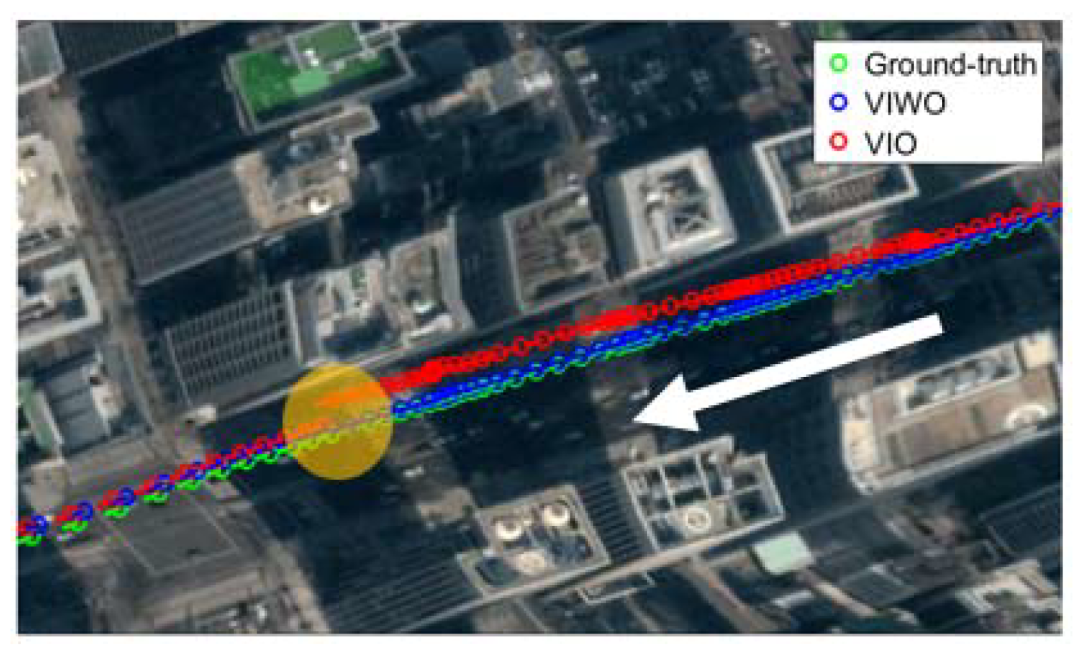

图13显示了一个GNSS中断区域,其中VIO产生的最大位置误差为16.2m,而VIWO在位置校正之前仅给出1.0m的误差。VIO中的这个大错误部分源于零速度更新。尽管可以从里程表读数中感知到车辆是静止的,但VIO的状态向量会根据速度的测量不确定性进行校正。结果,车辆的位置偏离了真实位置。相反,VIWO在车辆停止时输出静止运动,因为它基于速度读数传播位置。

图13建筑数据集中的GNSS中断区域:VIWO和VIO随时间漂移的位置估计,其中GNSS位置在黄色圆圈中可用

鉴于市区充满了视觉异常值,例如移动的汽车、行人等,如图11(c)所示,当大部分特征放置在移动物体上时,8-ptRANSAC无法成功消除异常值。结果,VIWO和VIO都不可避免地被视觉异常值更新。在本实验中,仅使用图像来检测和擦除移动物体上的特征。作为我们未来的工作之一,我们可以利用估计的自我运动提供有用的信息来放弃异常值,这将进一步提高VIWO的估计准确性。

6结论

在本文中,我们提出了视觉惯性轮里程计(VIWO),它通过分别从陀螺仪和里程计获得的角速率和速度测量来传播系统模型。VIWO的优势和独创性在于这种简单而强大的变化,即在使用低档IMU时,从基于加速度计的方法到基于里程计的陆地车辆方法。此外,当假设测量视觉特征、倾斜角和位置时,我们分析得出了VIWO的不可观察子空间。它揭示了7个方向(态度、位置、尺度)位于不可观测的子空间上,当全球位置测量可用时,这些都变得可观测。此外,我们的数值模拟通过检查状态向量的不确定性证实了理论结果。最后,我们在GNSS信号不可用且不可靠的隧道和街道峡谷等具有挑战性的环境中将VIWO与传统VIO进行了比较。在隧道中,与传统VIO相比,VIWO将位置误差平均减少了54.6%,在街道峡谷中减少了0.65m。

我们未来的工作包括使用估计的自我运动来进一步减少导航误差的异常值拒绝方案。鉴于我们在这项工作中只使用了点特征,因此也可以在图像中提取额外的视觉信息,如线条、消失点和表面。这些与VIWO融合的测量将进一步提高导航性能。

-

传感器系统

+关注

关注

0文章

38浏览量

13084 -

矩阵

+关注

关注

1文章

450浏览量

36235 -

视觉传感器

+关注

关注

3文章

277浏览量

23910 -

IMU

+关注

关注

6文章

427浏览量

48094

原文标题:在城市地区使用低等级IMU的单目视觉惯性车轮里程计

文章出处:【微信号:3D视觉工坊,微信公众号:3D视觉工坊】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

【CIE全国RISC-V创新应用大赛】+基于MUSE Pi Pro的3d激光里程计实现

如何理解SLAM用到的传感器轮式里程计IMU、雷达、相机的工作原理与使用场景?精选资料分享

视觉里程计的研究和论文资料说明免费下载

视觉里程计的详细介绍和算法过程

视觉语义里程计的详细资料说明

基于单个全景相机的视觉里程计

轮式移动机器人里程计分析

介绍一种基于编码器合成里程计的方案

SLAM领域中的VIO(视觉惯性里程计)

一种新型激光雷达惯性视觉里程计系统介绍

在城市地区使用低等级IMU的单目视觉惯性车轮里程计

在城市地区使用低等级IMU的单目视觉惯性车轮里程计

评论