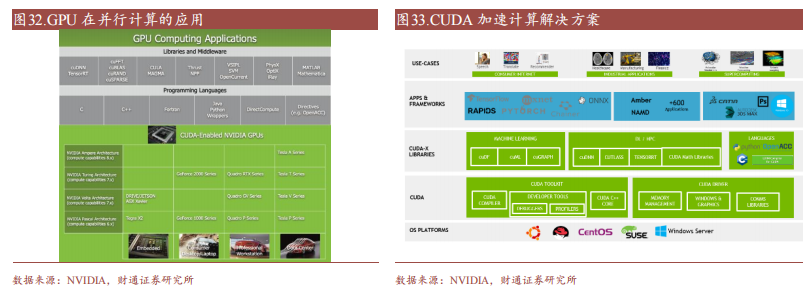

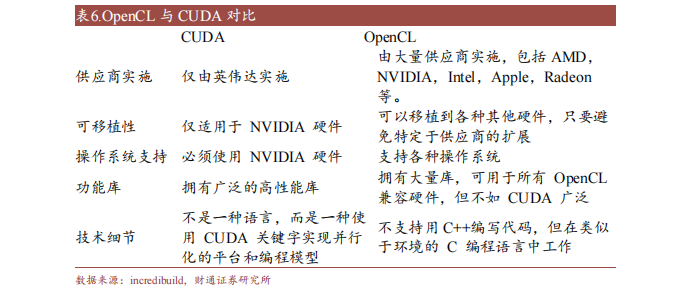

成熟且完善的平台生态是GPU厂商的护城河。相较于持续迭代的微架构带来的技术壁垒硬实力,成熟的软件生态形成的强大用户粘性将在长时间内塑造GPU厂商的软实力。以英伟达CUDA为例的软硬件设计架构提供了硬件的直接访问接口,不必依赖图形API映射,降低GPGPU开发者编译难度,以此实现高粘性的开发者生态。目前主流的开发平台还包括AMD ROCm以及OpenCL。

CUDA(Compute Unified Device Architectecture),是NVIDIA于2006年推出的通用并行计算架构,包含CUDA指令集架构(ISA)和GPU内部的并行计算引擎。该架构允许开发者使用高级编程语言(例如C语言)利用GPU硬件的并行计算能力并对计算任务进行分配和管理,CUDA提供了一种比CPU更有效的解决大规模数据计算问题的方案,在深度学习训练和推理领域被广泛使用。

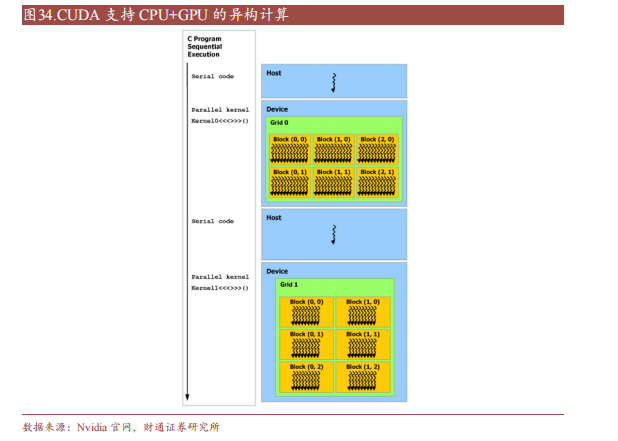

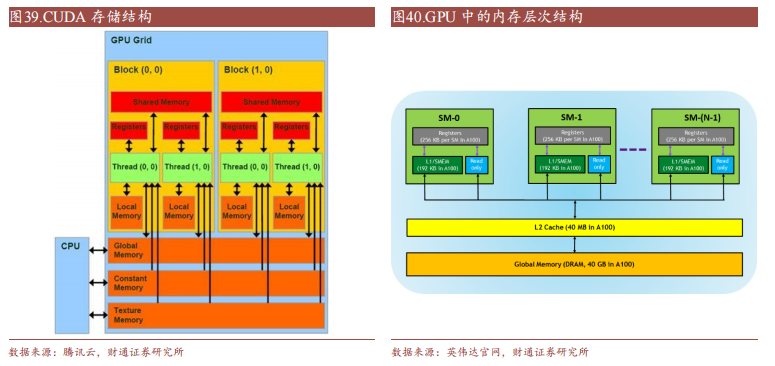

CUDA除了是并行计算架构外,还是CPU和GPU协调工作的通用语言。在CUDA编程模型中,主要有Host(主机)和Device(设备)两个概念,Host包含CPU和主机内存,Device包含GPU和显存,两者之间通过PCI Express总线进行数据传输。在具体的CUDA实现中,程序通常划分为两部分,在主机上运行的Host代码和在设备上运行的Device代码。Host代码负责程序整体的流程控制和数据交换,而Device代码则负责执行具体的计算任务。

一个完整的CUDA程序是由一系列的设备端函数并行部分和主机端的串行处理部分共同组成的,主机和设备通过这种方式可以高效地协同工作,实现GPU的加速计算。

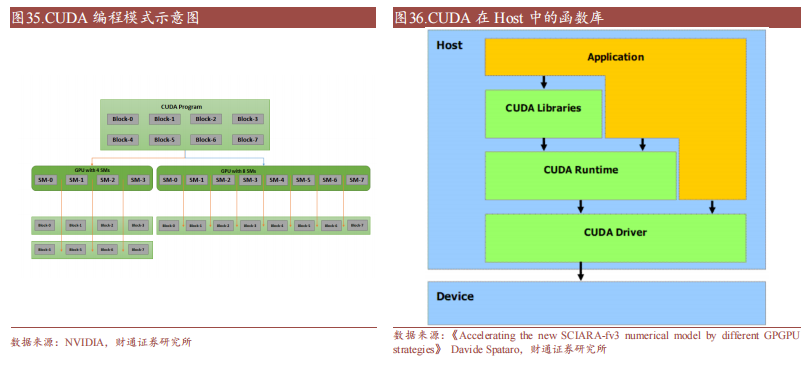

CUDA在Host运行的函数库包括了开发库(Libraries)、运行时(Runtime)和驱动(Driver)三大部分。其中,Libraries提供了一些常见的数学和科学计算任务运算库,Runtime API提供了便捷的应用开发接口和运行期组件,开发者可以通过调用API自动管理GPU资源,而Driver API提供了一系列C函数库,能更底层、更高效地控制GPU资源,但相应的开发者需要手动管理模块编译等复杂任务。

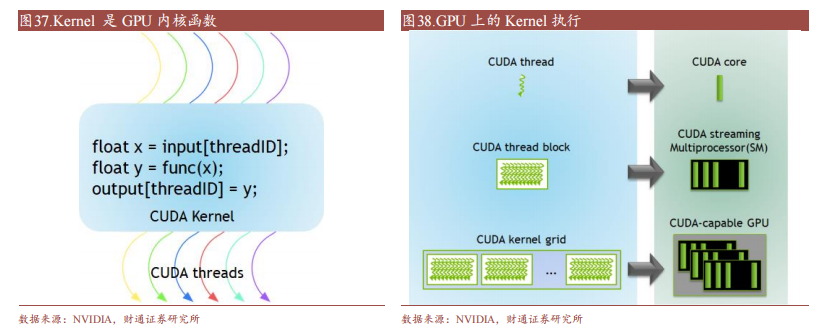

CUDA在Device上执行的函数为内核函数(Kernel)通常用于并行计算和数据处理。在Kernel中,并行部分由K个不同的CUDA线程并行执行K次,而有别于普通的C/C++函数只有1次。每一个CUDA内核都以一个声明指定器开始,程序员通过使用内置变量__global__为每个线程提供一个唯一的全局ID。一组线程被称为CUDA块(block)。CUDA块被分组为一个网格(grid),一个内核以线程块的网格形式执行。每个CUDA块由一个流式多处理器(SM)执行,不能迁移到GPU中的其他SM,一个SM可以运行多个并发的CUDA块,取决于CUDA块所需的资源,每个内核在一个设备上执行,CUDA支持在一个设备上同时运行多个内核。

丰富而成熟的软件生态是CUDA被广泛使用的关键原因。

(1)编程语言:CUDA从最初的1.0版本仅支持C语言编程,到现在的CUDA 12.0支持C、C++、Fortran、Python等多种编程语言。此外,NVIDIA还支持了如PyCUDA、ltimesh Hybridizer、OpenACC等众多第三方工具链,不断提升开发者的使用体验。

(2)库:NVIDIA在CUDA平台上提供了名为CUDA-X的集合层,开发人员可以通过CUDA-X快速部署如cuBLA、NPP、NCCL、cuDNN、TensorRT、OpenCV等多领域常用库。

(3)其他:NVIDIA还为CUDA开发人员提供了容器部署流程简化以及集群环境扩展应用程序的工具,让应用程序更易加速,使得CUDA技术能够适用于更广泛的领域。

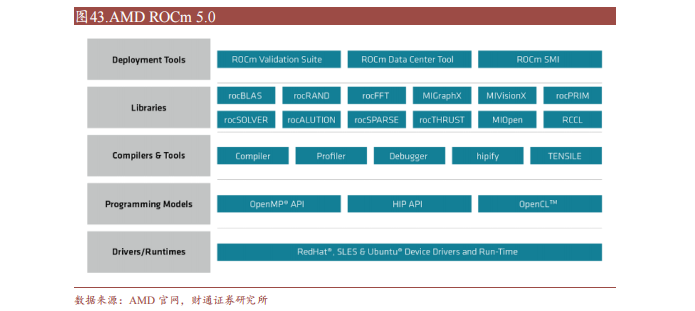

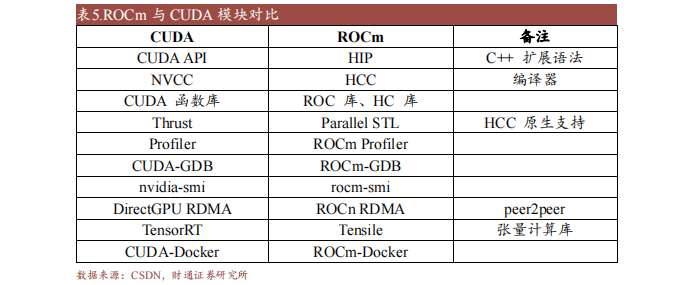

ROCm(Radeon Open Compute Platform)是AMD基于开源项目的GPU计算生态系统,类似于NVIDIA的CUDA。ROCm支持多种编程语言、编译器、库和工具,以加速科学计算、人工智能和机器学习等领域的应用。ROCm还支持多种加速器厂商和架构,提供了开放的可移植性和互操作性。

ROCm支持HIP(类CUDA)和OpenCL两种GPU编程模型,可实现CUDA到ROCm的迁移。最新的ROCm 5.0支持AMD Infinity Hub上的人工智能框架容器,包括TensorFlow 1.x、PyTorch 1.8、MXNet等,同时改进了ROCm库和工具的性能和稳定性,包括MIOpen、MIVisionX、rocBLAS、rocFFT、rocRAND等。

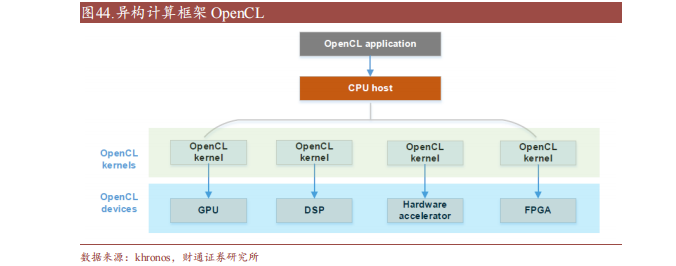

OpenCL(Open Compute Language),是面向异构系统通用并行编程、可以在多个平台和设备上运行的开放标准。OpenCL支持多种编程语言和环境,并提供丰富的工具来帮助开发和调试,可以同时利用CPU、GPU、DSP等不同类型的加速器来执行任务,并支持数据传输和同步。

此外,OpenCL支持细粒度和粗粒度并行编程模型,可根据应用需求选择合适模型提高性能和效率。而OpenCL可移植性有限,不同平台和设备的功能支持和性能表现存在一定差异,与CUDA相比缺少广泛的社区支持和成熟的生态圈。

-

amd

+关注

关注

25文章

5707浏览量

140414 -

gpu

+关注

关注

28文章

5271浏览量

136069 -

C语言

+关注

关注

183文章

7646浏览量

146154 -

CUDA

+关注

关注

0文章

128浏览量

14545 -

英伟达

+关注

关注

23文章

4115浏览量

99619

原文标题:GPU平台生态:英伟达CUDA和AMD ROCm对比分析

文章出处:【微信号:AI_Architect,微信公众号:智能计算芯世界】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

英伟达、AMD、英特尔GPU产品及优势汇总

打破英伟达CUDA壁垒?AMD显卡现在也能无缝适配CUDA了

aicube的n卡gpu索引该如何添加?

英伟达发布新一代 GPU 架构图灵和 GPU 系列 Quadro RTX

恩智浦S32V/英伟达DRIVE PX2/TI的TDA4/寒武纪1M/高通SA8155对比分析哪个好?

英伟达DPU的过“芯”之处

国产GPU绕不开的CUDA生态

GPU平台生态,英伟达CUDA和AMD ROCm对比分析

GPU平台生态:英伟达CUDA和AMD ROCm对比分析

GPU平台生态:英伟达CUDA和AMD ROCm对比分析

评论