6月,在第五届智源大会AI系统分论坛上,上海天数智芯半导体有限公司(以下简称“天数智芯”)对外宣布,在天垓100加速卡的算力集群,基于北京智源人工智能研究院(以下简称“智源研究院”)70亿参数的Aquila语言基础模型,使用代码数据进行继续训练,稳定运行19天,模型收敛效果符合预期,证明天数智芯有支持百亿级参数大模型训练的能力。

在北京市海淀区的大力支持下,智源研究院、天数智芯与爱特云翔共同合作,联手开展基于自主通用GPU的大模型CodeGen(高效编码)项目,通过中文描述来生成可用的C、Java、Python代码以实现高效编码。智源研究院负责算法设计、训练框架开发、大模型的训练与调优,天数智芯负责提供天垓100加速卡、构建算力集群及全程技术支持,爱特云翔负责提供算存网基础硬件及智能化运维服务。

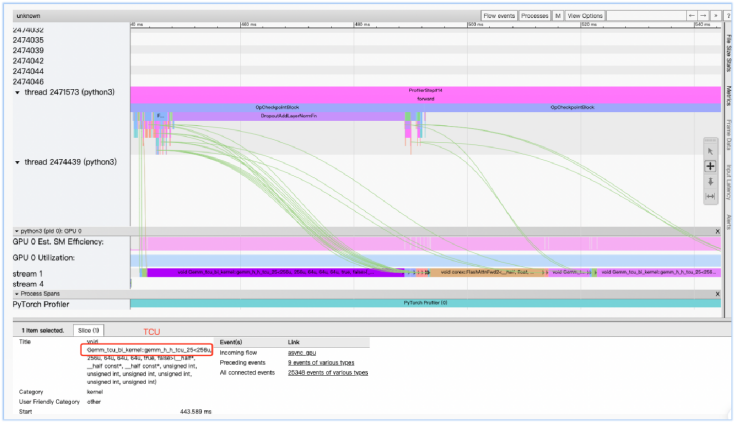

在三方的共同努力下,在基于天垓100加速卡的算力集群上,100B Tokens编程语料、70亿参数量的AquilaCode大模型参数优化工作结果显示,1个Epoch后loss下降到0.8,训练速度达到87K Tokens/s,线性加速比高达95%以上。与国际主流的A100加速卡集群相比,天垓100加速卡集群的收敛效果、训练速度、线性加速比相当,稳定性更优。在HumanEval基准数据集上,以Pass@1作为评估指标,自主算力集群训练出来的模型测试结果达到相近参数级别大模型的SOAT水平,在AI编程能力与国际主流GPU产品训练结果相近。

图 基于天垓100算力集群的AquilaCode大模型训练性能采样

天垓100率先完成百亿级参数大模型训练,迈出了自主通用GPU大模型应用的重要的一步。这一成果充分证明了天垓产品可以支持大模型训练,打通了国内大模型创新发展的关键“堵点”,对于我国大模型自主生态建设、产业链安全保障具有十分重大的意义。

接下来,天数智芯将与合作伙伴们继续深入合作,建设更大规模的天垓100算力集群,完成更大参数规模的大模型训练,以自主通用GPU产品更好支持国内大模型创新应用,进一步夯实我国算力基础,助力人工智能产业自主生态建设。

责任编辑:彭菁

-

编程

+关注

关注

88文章

3578浏览量

93551 -

模型

+关注

关注

1文章

3140浏览量

48672 -

天数智芯

+关注

关注

0文章

94浏览量

5525

原文标题:天垓100率先完成百亿级参数大模型训练,天数智芯迎来新的里程碑

文章出处:【微信号:IluvatarCoreX,微信公众号:天数智芯】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

摩尔线程与羽人科技完成大语言模型训练测试

llm模型训练一般用什么系统

天数智芯参与建设的中国移动智算中心(呼和浩特)项目圆满完成

深度学习模型训练过程详解

依图天问大模型4.0重磅发布

摩尔线程与师者AI携手完成70亿参数教育AI大模型训练测试

摩尔线程和滴普科技完成大模型训练与推理适配

【大语言模型:原理与工程实践】大语言模型的预训练

【大语言模型:原理与工程实践】揭开大语言模型的面纱

天数智芯主导DeepSpark开源社区百大应用开放平台24.03版本正式发布

名单公布!【书籍评测活动NO.30】大规模语言模型:从理论到实践

天数智芯DeepSpark开源社区正式发布百大应用开放平台23.12版本

天数智芯天垓100率先完成百亿级参数大模型训练

天数智芯天垓100率先完成百亿级参数大模型训练

评论