对象SLAM被认为对于机器人高级感知和决策制定越来越重要。现有研究在数据关联、对象表示和语义映射方面存在不足,并且经常依赖于额外的假设,从而限制了它们的性能。在本文中,我们提出了一个综合的对象SLAM框架,该框架专注于基于对象的感知和面向对象的机器人任务。首先,我们提出了一种集成数据关联方法,用于通过结合参数和非参数统计测试来关联复杂条件下的对象。此外,我们建议基于iForest和线对齐的对象建模的离群鲁棒质心和尺度估计算法。然后由估计的通用对象模型表示轻量级和面向对象的地图。考虑到对象的语义不变性,我们将对象图转换为拓扑图以提供语义描述符以实现多图匹配。最后,我们提出了一种对象驱动的主动探索策略,以在抓取场景中实现自主建图。

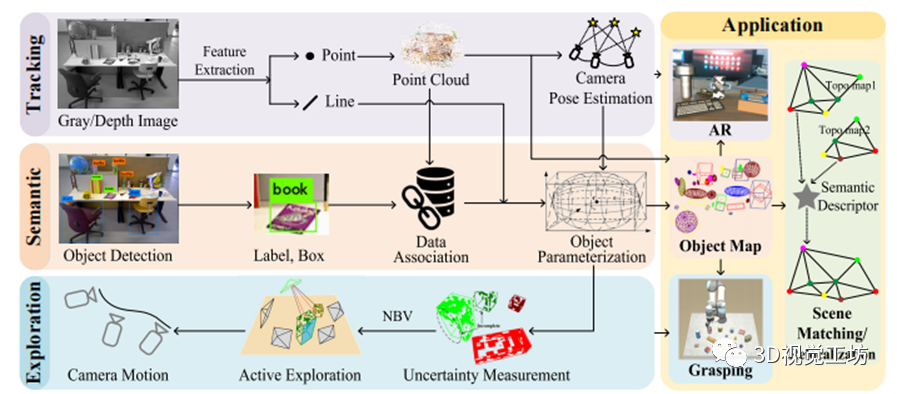

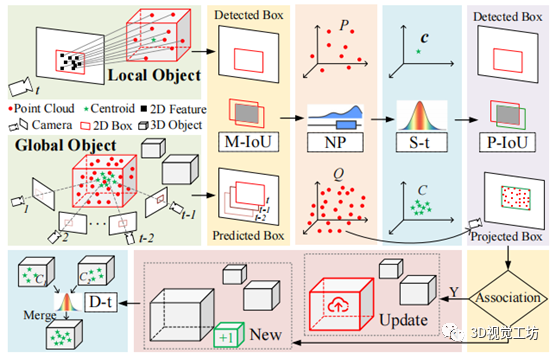

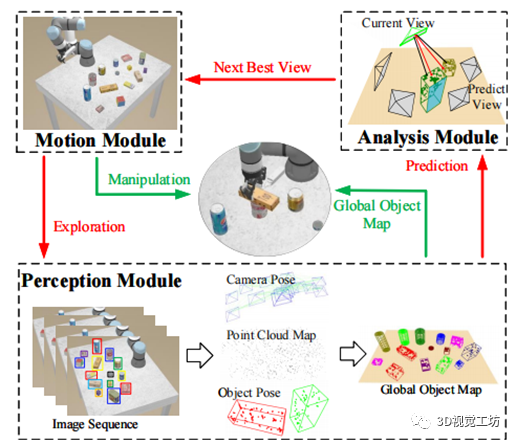

提出的对象SLAM框架。

1 系统框架

本框架主要包含4个模块:

1.Tracking module:基于ORB-SLAM2实现相机轨迹跟踪并生成稀疏点云。

2.Semantic module:采用YOLO物体检测网络,结合点云测量与2D检测结果进行数据关联。利用iForest和线段对齐算法优化点云和线段。基于关联和优化结果参数化物体。

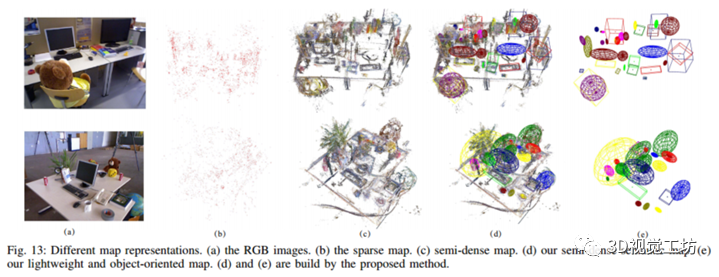

3.Object map:实现基于物体的轻量语义地图表示。

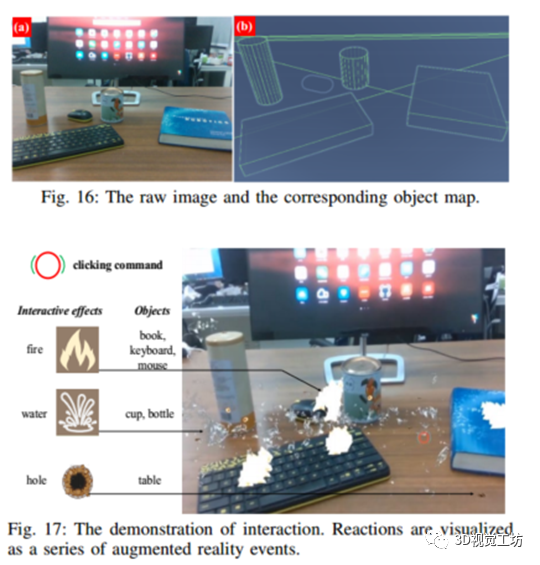

4.Application module:Augmented reality:基于实际物体姿态实现虚实模型配准,考虑遮挡和碰撞效果。Scene matching:将对象地图转换为拓扑图,设计物体描述子实现多情景匹配。Active exploration:利用物体不完整度量式信息熵驱动主动构建全局对象地图,实现抓握场景。

总的来说,框架实现稳健的数据关联、精确的物体参数化以及基于语义对象地图的高层应用,解决了对象SLAM涉及的主要挑战。语义对象地图能为机器人抓取、导航、规划等复杂任务提供必要信息,有助于实现智能机器人

2 对象级数据关联

本文提出一个集成方法来执行多帧间的对象数据关联。关联算法主要包含4部分:

(1) 运动IOU模型:如果全局物体在前两帧(t-1和t-2)可观测,则基于匀速运动假设预测当前帧(t)的边界框,与检测到的本地物体计算IOU值。

(2) 非参数检验模型:如果连续观测到物体失败,则直接应用非参数Wilcoxon检验对P和Q(代表物体点云)进行验证。假设它们来自同一物体,则应满足同一分布 fP = fQ 。

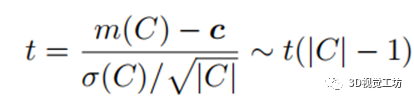

(3) 单样本t检验模型:分析不同视角下物体质心C和c是否来自同一物体。建立t统计量并与临界值比较:

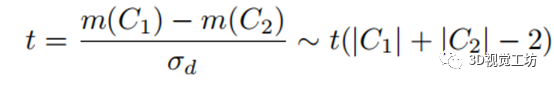

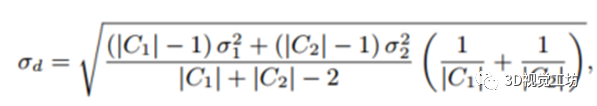

(4)投影IOU模型:将三维点云投影到二维图像,拟合投影边界框与检测框的IOU(5) 双样本t检验模型:如果存在重复物体,则对两个物体的历史质心C1和C2建立t统计量并比较,实现合并:

其中d为两个物体的池化标准差。通过集成利用不同统计特征,提高了数据关联的鲁棒性和成功率。实验结果表明,与单一方法相比,集成方法能更有效地关联不同视角下的物体,为下一步的参数化奠定基础。总的来说,该方法充分利用了点云和质心分别显示的非高斯分布和高斯分布特性,通过不同统计模型集成提高关联性能。

对象级数据关联示意图

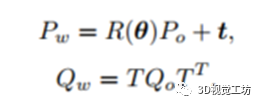

3 对象参数化

我们利用立方体和二次曲面、圆柱体来表示对象,而不是复杂的实例级或类别级模型。对于具有规则形状的对象,例如书本、键盘和椅子,我们使用立方体(由它们的顶点 Po 编码)来表示它们。对于球、瓶、杯等没有明确方向的非规则物体,采用二次/圆柱(由其半轴Qo编码)表示,忽略其方向参数。这里,Po 和 Qo 在对象坐标系中表示,仅取决于尺度 s。为了将这些元素对准到全局地图,我们还需要估计它们的平移 t 和方向 θ。全局坐标系中的立方体和二次曲面表示如下:

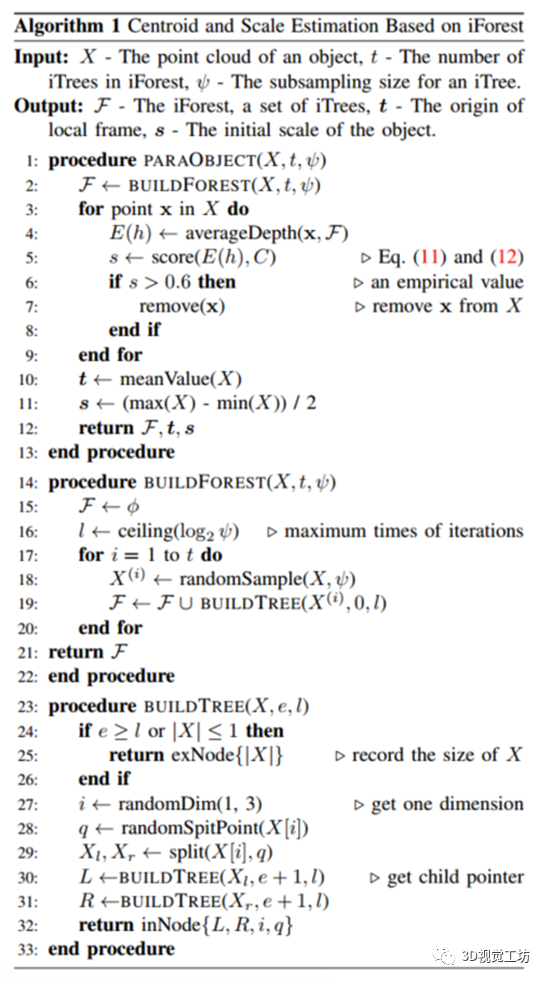

随后,提出了基于iForest和线段对齐的离群点过滤算法,实现精确的对象尺度、位置和方位估计。主要包括以下部分:

(1) 平移和尺度估计:利用iForest去除点云中的离群点,剩余点云实现对象的初始尺度s和位置t估计。算法1描述了基于iForest的算法:

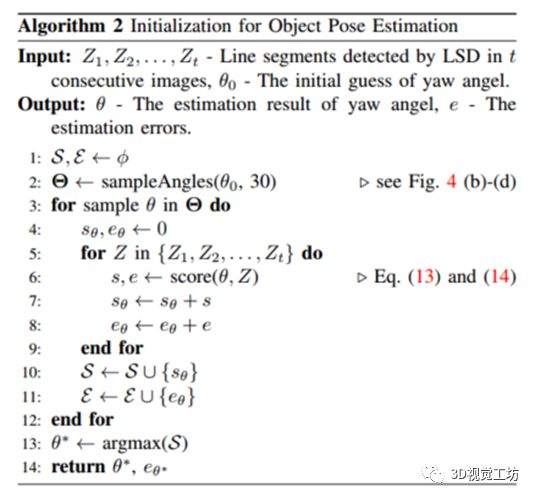

(2) 方位估计:分为初始化和优化两个阶段。

算法2描述了初始化算法:

(3) 对象表示:根据物体形状使用立方体或对角模型表示,编码尺度s、位置t和方位角θ。

总的来说,采用iForest过滤离群点和线段对齐初始化方位角,有效实现了精确的6DOF姿态估计。最终构建了基于物体类型的通用模型,实现了轻量级语义对象地图:

3 对象描述子

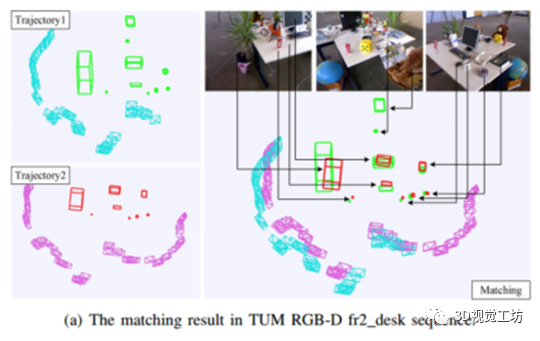

为了描述不同物体间的关系,文章构建了语义拓扑图和基于此的随机游走描述子。

拓扑图:通过物体的语义标签、位置、姿态和尺寸信息,构建不同物体及物体与情景的关系图:

表示物体节点,编码物体信息

表示物体节点,编码物体信息

表示边,编码两个物体的距离d和角度α

表示边,编码两个物体的距离d和角度α

描述子:基于拓扑图中不同物体间的关系,采用随机游走的方式构建物体描述子υ:

r是一个随机行走路径,起始于被描述的物体,最多到达i个物体。每行重复j次随机行走。

多维度信息:为了提高鲁棒性,描述子中考虑物体标签l、尺寸s、距离d和角度α四个维度:

4. 场景匹配:基于多个物体对的描述子匹配,求解两个情景的转换矩阵T:

4. 场景匹配:基于多个物体对的描述子匹配,求解两个情景的转换矩阵T:

· 生成两个情景T1和T2的描述子V1和V2。

· 对每个对象v1在V1中找到在V2中的最佳匹配v2。

· 根据多个物体对,利用奇异值分解(SVD)求解转换矩阵T。

鲁棒性:采用RANSAC算法去除误匹配物体对,提高匹配的鲁棒性。总的来说,基于拓扑图实现的物体描述子充分利用了物体的语义、尺寸和相对关系,能有效实现不同视角下的场景匹配。考虑更多非物体的语义特征可能进一步提高鲁棒性和准确性。

4 实验结果

数据关联:实验结果表明,集成不同统计模型超过单一方法。表明点云和质心确实呈现非高斯分布和高斯分布。

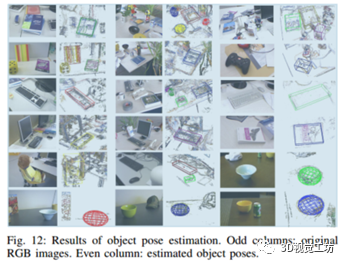

2. 对象参数化: 实验结果表明, iForest和线段对齐有效实现精确的6DOF姿态估计。并构建了基于形状的通用对象模型

3. 对象地图构建:可在不同数据集上构建语义对象地图,处理不同类、数量、尺寸和方位角的物体。实验表明系统的鲁棒性。

4. 增强现实:基于精确的物体姿态信息,实现虚拟模型与实物精准配准。考虑遮挡和碰撞效果,提高虚拟可信度。

5. 场景匹配:基于物体描述子,可在不同视角和照明条件下实现场景匹配和多地图融合。具有鲁棒性。

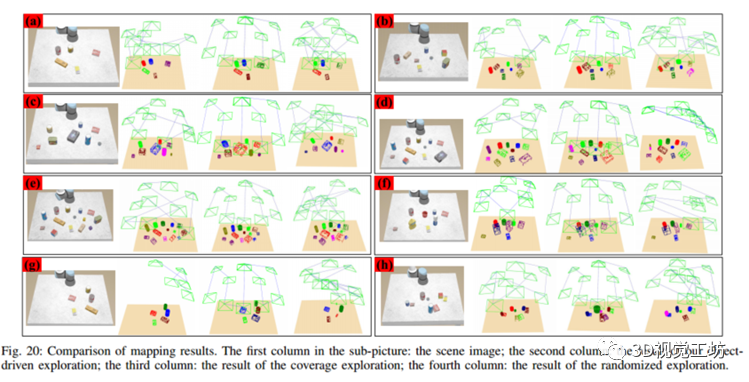

6. 主动地图构建:通过信息熵量化物体观测完整度,驱动主动建设语义对象地图。实验表明比随机探索和全面覆盖策略更高效和更准确。

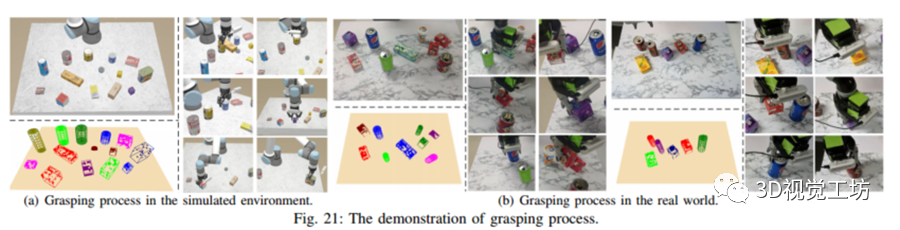

7. 机器人抓取:基于语义对象地图信息,实现机器人抓握。在虚拟环境和实际环境下的成功率分别达到86%和81%。

局限性:数据关联在极端情况下存在问题;对象姿态估计受离群点影响而不准确;场景匹配依赖精确的对象建模。改进方向:优化数据关联鲁棒性;采用机器学习提高姿态估计精度;构建更通用的物体描述子;采用多源感知实现全景对象地图。

总的来说,实验结果充分证明了对象SLAM框架在不同应用上的有效性和潜力。同时指出了当前的局限性和未来的改进方向。这对促进对象SLAM技术的发展至关重要。

-

框架

+关注

关注

0文章

403浏览量

17609 -

智能机器人

+关注

关注

17文章

877浏览量

83358 -

SLAM

+关注

关注

23文章

428浏览量

31998

原文标题:TRO新文:用于数据关联、建图和高级任务的对象级SLAM框架

文章出处:【微信号:3D视觉工坊,微信公众号:3D视觉工坊】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

TRO新文:用于数据关联、建图和高级任务的对象级SLAM框架

TRO新文:用于数据关联、建图和高级任务的对象级SLAM框架

评论