之所以写这篇文章,是因为对当今大火大热的人工智能(AI)感觉到失望。

太多的科技公司,汽车公司等,为了蹭热点,强行把自己的产品“人工智能”化。高端的“人工智能”,运用复杂的算法更好的实现特定的逻辑,结合大数据的分析和运用更好的展现出特定的交互结果。而低端的“人工智能”,则仅仅是有个输入输出的逻辑处理过程而已。如果简单的下雨了关闭电动窗,已经是十几二十年前有传感器能做到的事情了,所以他们增加了一些判断逻辑和反馈技能,形而上的加上物联网和手机APP,就当成是“人工智能”了,本质和20年前用传感器和继电器完成的工作没什么区别。

举例,所谓“人工智能”助手,就是设置足够多的关键词(或者是语义分析后提取的关键词)回复功能,当你想要问一个全新的问题,则全部进入其else判断中:“您说的啥我不懂,您难住我了,我会改进来学习理解你的话”……看看你手里或者朋友家的“智能音箱”就知道了,弱智程度让你感觉不如siri、Bixby、GoogleAssistant好玩,只是有了点物联网的硬件支持。其实说个语音就给电视换台,不管是有线电视的机顶盒还是智能电视,三四年前都已经非常普遍了。仔细想想,现在的“人工智能”,和那有区别么?

举例,所谓“人工智能”自动驾驶,也就是足够多的传感器和条件处理。水平高的AI自动驾驶,传感器更丰富,利用传感器组合的环境判断更合理一些,运算速度更快,大数据、语义识别更准确,车主的信息维度更宽更深——低端的AI自动驾驶则所有指标相应的都比较新。他们的水平怎么样呢?我觉得可以这样描述,目前市面所有的人工智能自动驾驶技术,甚至都比不上一个正在走神的三四年持续驾龄的司机。一个正在打电话的司机,或者正在思考着重要事情而走神的司机,都能够利用每天驾车的条件反射对路面有足够的预判,对大部分危险自动反应处理,识别老旧的或者不清晰的信号灯和路标,用条件反射感知周围车辆的转向灯或者转向意图,而这些人类走神的操作、感知和反应,恰恰是目前所谓AI自动驾驶所追求的的最高境界了。

诚如这些科技大佬自己所见,当前的“人工智能”大多是“人工智障”,但是科技的发展和科技从业者(不含纯商人)的追求肯定不会止步于现有的智障模式,一种更先进,更理想且可实现的技术概念必然是值得期待的和可预期会出现的。为了方便区分,我将下一个跨层次的人工智能升级版概念,称之为人工意识。

人工意识到底比人工智能有多大区别呢?

我认为,最显著的区别,可能在于人工意识可以自我学习,自我决策。

举例一,我们研发生产了一台“人工智能”的服务机器人,这台机器人尝试向一位客户服务,但是恰恰遇到了一个刚进城的湖南小城市老乡,还习惯用自己的家乡话与人沟通。我们假设这台机器人还没有这个地区的方言库和足够多的样本,客人说了一通后,机器不能识别,会怎么处理呢?我们按智能的程度,尝试分析一下可能的处理方式:

方式一,粗暴强行翻译,语义不通直接说抱歉无法理解。

方式二,粗暴强行翻译,语义不通的时候,尝试外语和方言库,还是不行就说抱歉无法理解,建议客户使用普通话。

方式三,有强大的云和大数据支持,语义不通后,调用云支持,匹配可能的方言来理解,无法理解建议客户使用普通话或者通过触屏手写表达自己的想法,或者叫旁边的真人来协助处理。

以上三种方式,如果提前能够预判这种情况,则可以做的可以说足够人性化了,这是例子一。

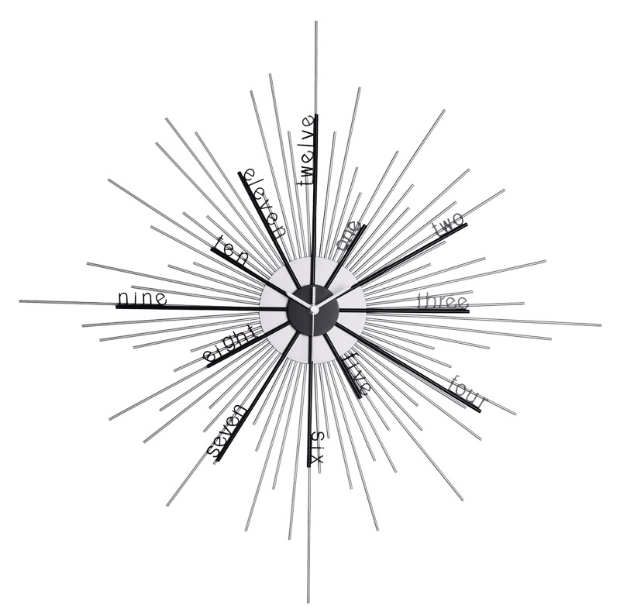

例子二,一个人工智能保姆,可以调用扫地机器人遍历整个房间的地板扫地,可以使用机器人擦玻璃,用协议交电费,用智能家电判断冰箱设定的食物是否需要补充,如果需要的话,自动在电商下单到附近的自提设备中,给主人发个消息叫他取。但是,如果主人家里挂了这么一个表,这个表的时间不对了,我赌五毛钱目前的人工智能机器人是无法发现并提醒主人的。

来自网络,侵权删除

例子三:我相信现在任何一个人工智能系统,都无法知道什么时候应该对一个人撒谎;也不知道什么时候用户给他说话是开玩笑的,不需要执行的,什么时候是想要它执行的,如:“你再往前一步试试!”

案例一,揭示了人工智能的一个短板,就是无法预判所有的情况,并一一作出处理,因为当前的逻辑层涵盖的情况都是有限的,产品经理想的足够多,这个产品看起来就足够的智能,但是能作出反应的情况始终有限的。人类则是无限的,哪怕只是五六岁的孩子,都能面对不同的情况,作出不同的判断。

案例二,表明了人工智能能识别和感应的内容是有限的,他无法对一个全新的事物进行自主定义和归类,也无法像人类一样有效收集周边环境信息。一个普通的成年人可以一眼认出这是一个表,但是目前的人工智能敢下出结论,它“看”到的就是一个表么?

案例三,说明人工智能没有思考机制,没有任何感情概念。

人工意识应该是这样的:

它有着仿照人类学习的过程,自我进行类比,比如“好像带三个时针的都是表,但是有时候两个时针的人类也称之为表,有时候表有12个刻度,有时候只有四个刻度甚至没有刻度,但是这些都是表”。

它能自我验证“上次王xx说那个表很好看,我问哪里有表,他指示了一个环形带刻度有表针的墙面挂装物体给我,这次这个有可能也是个表,我可以问一下旁边的人,以对我的认知加以验证,你好,这是一个表么?”。

它能学会对事情辩证的看待“这可能是个装饰,可能是个表,是个表的概率为80%,如果主人说客厅的挂表,指代这个物品的概率更高,但是我仍需要确认一下是这个物体,因为我没有95%以上的把握就是它,不能直接做决策”

它自我判断后果和做出决策,主人说叫我买个买一份午餐来,他平时只吃水果披萨,今天水果披萨没了,如果我换成田园披萨,应该没问题,因为之前主人说过田园也可以,所以换成田园披萨我可以立刻做出决定。但是如果只有榴莲披萨,那么我无法自己做出决定,因为大众对这个口味接受度不高,我对主人是否吃得惯榴莲一无所知,我无法自己做出判断。

在12年8月份,随着安卓系统的普及,一众智能识别软件覆盖了语音、实物、歌曲、文字ORC等,当时我如下写到:

一个足够智能的机器人,在自主学习之前要先学会感触、表达和辨识,WIN7的语音控制功能很多人一定都体验过,如果能移植在机器人身上,会让机器人的语音辨识变得非常强大,当然,这对业内高手来说并不难,也一定有人在实验、实现。表达上现在的主流表达水平已经基本满足需求了,这里说的是非顶端机器人。比如我们将Simsimi嵌入到机器人系统中,这样你和他聊天的时候就顺畅有趣的多,这个相信也不难,顶多你放整部安卓手机在机器人里。对于视觉图像的辨识,除了强大的算法,还有就是庞大的云知识库。我在玩Goggles的时候,想如果机器人能将拍到的图片经过这个软件处理(当然这个软件目前还没足够的强大、足够的成熟),就可以轻而易举的认出排到的东西来,当机器人想去寻找墙上的开关面板的时候,自己就可以辨识了。类似的有midomi的哼唱搜索功能,你对他哼唱一首歌,他会处理出来,你在唱歌,唱的哪一首歌。当然自主学习的机器人比这个更进一步,他可以通过不断地积累,从而辨识出新款的挂钟是个挂钟,就像我们小时候慢慢总结的过程一样,这个想法在我的博客中应该是有记载的。

总之,如果你想让人工意识认识纸币面额,万不可直接存储不同面额的图像给它,应该设计出既能认识纸币面额,又能认识广告传单的一套自主学习体系。

人工意识,下一个人工智障聚集地。

-

传感器

+关注

关注

2551文章

51159浏览量

754095 -

人工智能

+关注

关注

1791文章

47349浏览量

238732 -

自动驾驶

+关注

关注

784文章

13838浏览量

166524

原文标题:下一个科技方向,叫人工意识

文章出处:【微信号:ZHISHIKU-Pro,微信公众号:知识酷Pro】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

人工意识到底比人工智能有多大区别呢?

人工意识到底比人工智能有多大区别呢?

评论