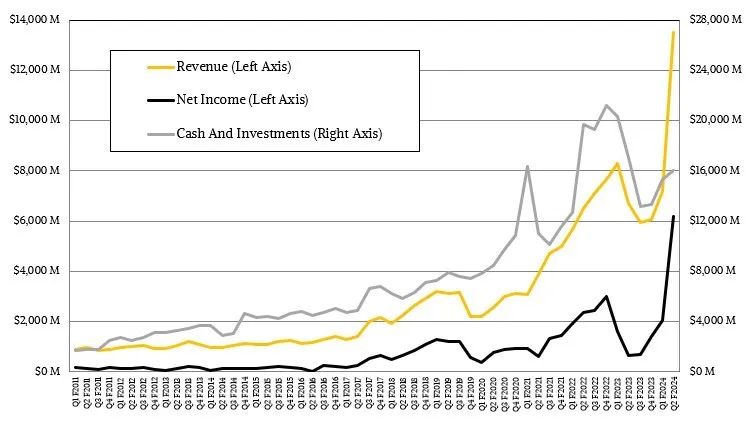

近日,英伟达公布了新一季度财报,在截至 7 月份的季度中,英伟达的收入同比增长了一倍多,达到 135.1 亿美元,创下了公司的新纪录,净利润增长了 9.4 倍,达到 61.9 亿美元。英伟达预计第三财季收入将达到 160 亿美元。

自去年11月ChatGPT上市后,人们对人工智能领域的兴趣可以说达到了疯狂的程度,震动范围远远超出了科技行业。ChatGPT 使用 10,000 个英伟达图形处理单元 (GPU) 进行训练。CB Insights最近的一份报告指出,英伟达占据了机器学习 GPU 市场约 95% 的份额。

“一个新的计算时代已经开始。全球企业正在从通用计算向生成式人工智能转型,”英伟达首席执行官黄仁勋表示。

英伟达已然主导人工智能芯片市场。

TechInsights 分析师Dan Hutcheson补充道:“英伟达之于人工智能几乎就像英特尔之于个人电脑一样。”

英伟达在AI硬件方面的地位“近乎垄断”。英伟达目前最受欢迎的 AI 硬件产品包括A100和H100数据中心GPU,英伟达还将 H100 和 CPU 组合成一个名为GH200“Grace Hopper”芯片组的封装,为英伟达的计算机系统系列提供动力。

英伟达的市场主导地位使得AMD等竞争对手竞相追赶。但目前,英伟达的领先地位几乎不可撼动。5月,英伟达成为第一家市值突破万亿美元的芯片公司。

“各行业和客户对我们人工智能数据中心平台的需求巨大且广泛。”英伟达首席财务官Colette Kress在公司财报电话会议上谈到。

02 GPU 短缺带来的地位危机

然而,尽管英伟达的主导地位目前看起来已经确定,但长期来看却很难预测。TIRIAS Research 的另一位行业分析师Kevin Krewell表示:“英伟达现在是每个人都想击败的目标。”

目前英伟达GPU短缺的问题愈演愈烈,短缺的主要原因在于行业需求的迅速增长与供应链的不足。人工智能的热潮让GPU的算力再度成为宝贵资源,云厂商们的算力储备竞赛愈发激烈。

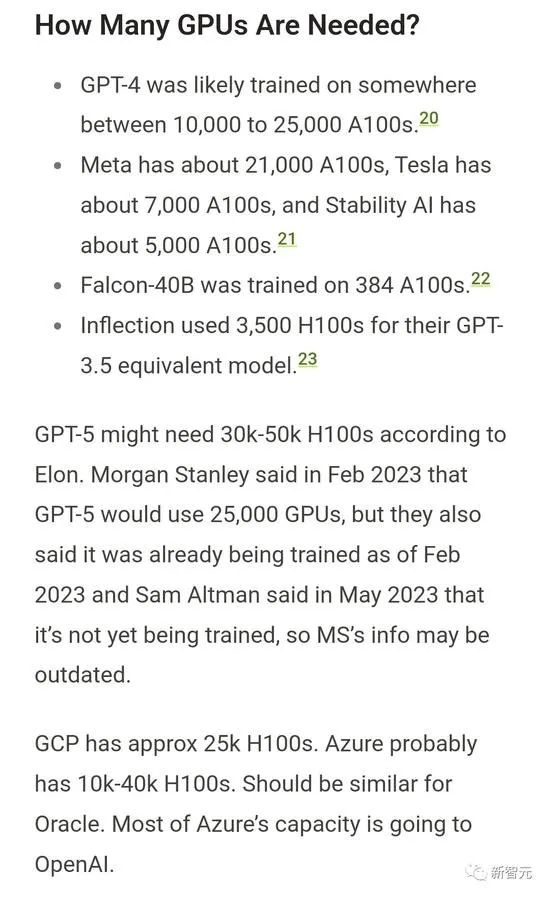

据了解:

GPT-4可能在大约10000-25000张A100上进行训练

Meta大约21000 A100

特斯拉大约7000 A100

Stability AI大约5000 A100

Falcon-40B大约384个A100

Inflection使用了3500个H100

另外,预计GPT-5可能需要30000-50000个H100。Inflection需要22000个,Meta需要 25000,大型云服务商可能需要30000(比如Azure、Cloud、AWS、)。

国内互联网巨头也加入了这场 GPU 储备赛。据报道,百度、字节跳动、腾讯和阿里巴巴已共同订购了价值10亿美元的英伟达A800处理器,预计于今年交付。他们还购买了价值40亿美元的GPU,这部分订单将于2024年交付。

持续上涨的需求让GPU的供应紧缩看不到任何要结束的迹象。

英国《金融时报》的一篇报道称,英伟达H100 AI 处理器到2024年的产量至少需要增加两倍,从今年的约 50 万台增加到150万至 200 万台。虽然这对英伟达的盈利来说是个好消息,但对于市场需求来说可能还远远不够,如果短缺继续,一些公司不会有耐心等待英伟达,而是寻找替代架构。

03 其他厂商能否抓住机会?

持续的短缺意味着竞争对手的机会到来了。

最引人注目的例子之一是阿联酋G42 Cloud,该公司利用Cerebras Systems 构建了 9 台 AI 超级计算机,每台计算机的成本仅为 1 亿美元,能够实现 36 exaflops 的稀疏FP16 性能。

Cerebras 的加速器与为英伟达的 HGX 和 DGX 系统提供动力的 GPU 有很大不同。Cerebra 的加速器不是将四个或八个 GPU 装入机架式机箱中,而是采用餐盘大小的巨大硅片封装了 850000 个内核和 40GB SRAM。该芯片制造商声称,只需 16 个此类加速器即可实现 1 exaflop 的稀疏 FP16 性能,而这需要超过 500 个英伟达H100。

对于其他等不及英伟达提高产能的企业来说,并不缺乏替代方案。

英特尔和AMD 都以制造中央处理器(CPU)而闻名,但他们也为人工智能应用制造专用 GPU(英特尔最近才加入竞争)。

据了解,亚马逊正在使用英特尔的 Gaudi AI 训练加速器来补充自己的定制 Trainium 芯片,目前还不清楚具体数量。与英伟达的 A100 相比,去年 5 月推出的英特尔 Gaudi2 处理器声称其性能大约是 A100 的两倍,至少在 ResNet-50 图像分类模型和 BERT 自然语言处理模型中是如此。英特尔还针对中国市场推出了该芯片的精简版。英特尔预计将在明年某个时候推出更强大的处理器版本,预计称为 Gaudi3,与 Nvidia 当前的 H100 竞争。

在 6 月份的数据中心和人工智能活动中,AMD详细介绍了其 Instinct MI300X,该产品预计于今年年底开始发货。Instinct MI300X将 192GB 高速 HBM3 内存和8个 CDNA 3 GPU 芯片封装在一起。The Next Platform 估计该芯片将提供大约 3 petaflops 的 FP8 性能。虽然 MI300X 的性能只有 Nvidia H100 的 75%,但内存容量提高了 2.4 倍,这可以让客户使用更少的GPU来训练他们的模型。

此外,谷歌拥有张量处理单元(TPU),不仅用于搜索结果,还用于某些机器学习任务,而亚马逊则拥有用于训练人工智能模型的定制芯片。据报道,微软也在开发人工智能芯片,Meta也有自己的人工智能芯片项目。

因此,如果英伟达目前只能满足人工智能芯片三分之一的需求,那么为什么其竞争对手不加紧填补这一空白并从中获利呢?

不过仅目前来看,英伟达著名的平台战略和以软件为中心的方法仍然非常难以被击败。

“虽然其他厂商也提供类似的芯片或系统,但英伟达已经建立了一个强大的生态系统,其中包括芯片、相关硬件以及针对其芯片和系统进行优化的完整稳定的软件和开发系统,”分析师Jack Gold表示。

此外,英伟达在将新功能集成到其系统方面也非常灵活。其他人工智能芯片初创公司在软件工具方面的投资不足,因此尽管他们创建的云计算平台可能比英伟达的更快或更便宜,但他们在当前的编程体验上并没有相应的改进。

对于拥有强大资源,致力于开发、优化或将遗留代码移植到更新的架构的大型企业来说,选择替代的硬件平台可能能够节省潜在的成本或缩短交付时间。谷歌和亚马逊已经分别通过 TPU 和 Trainium 加速器走上了这条道路。

但对于缺乏这些资源的企业来说,在没有经过验证的软件堆栈的情况下采用基础设施,无论它的性能如何,都可能被视为一种负担。在这种情况下,英伟达仍然是安全的选择。

-

数据中心

+关注

关注

16文章

4507浏览量

71584 -

人工智能

+关注

关注

1787文章

46011浏览量

234723 -

英伟达

+关注

关注

22文章

3628浏览量

89794

原文标题:英伟达Q2利润增长9.4倍,数据中心供应链短缺遭“踢馆候补”

文章出处:【微信号:SDNLAB,微信公众号:SDNLAB】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

英伟达单季营收破300亿美元!Q2全球半导体Top15,几家欢喜几家愁?

英伟达Q2利润增长9.4倍,数据中心供应链短缺遭“踢馆候补”

英伟达Q2利润增长9.4倍,数据中心供应链短缺遭“踢馆候补”

评论