1. 这篇文章希望解决什么问题?

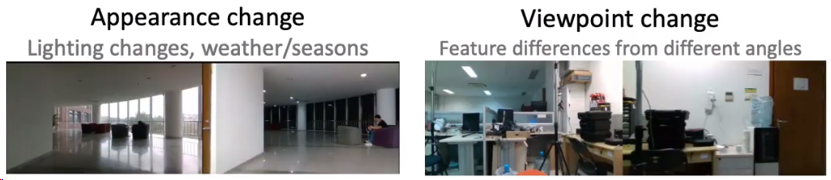

服务机器人、巡检机器人、自动驾驶车辆等SLAM应用,需要进行长时间的定位和导航,但是可能会遇到很多光照变化(甚至天气季节变化)、不同视角提取的不同特征、原先场景的目标已经移除等等很多的环境变化问题,如果处理不好的话很容易引发轨迹漂移甚至跟踪丢失。

作者认为,产生这种问题的关键在于,现有的视觉SLAM方法依赖于低级的特征描述子。这些特征描述子对环境变化不鲁棒,并导致地图尺寸过大,不利于机器人的长期部署。也有一些SLAM方案使用语义信息来辅助定位,但主要面向短期定位导航过程。

2. 具体原理是什么?

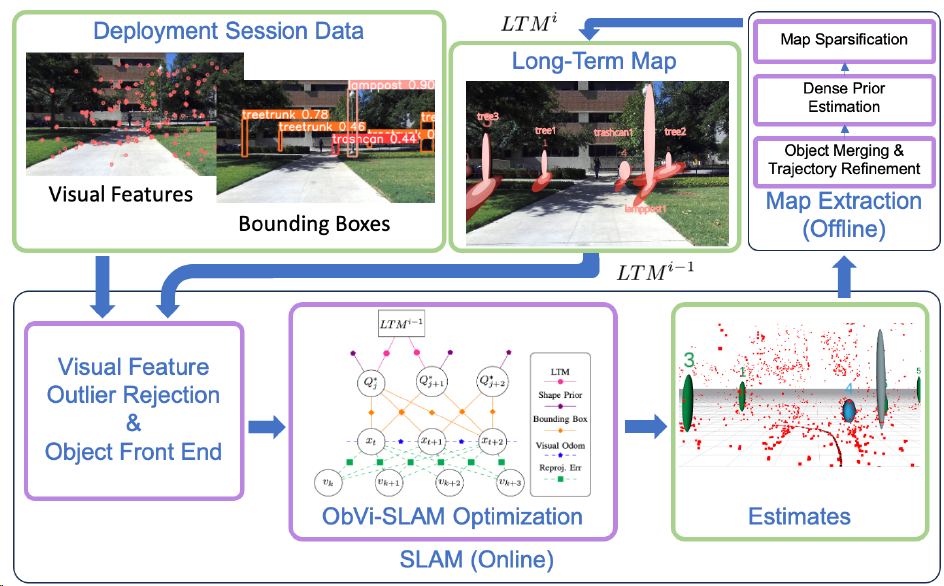

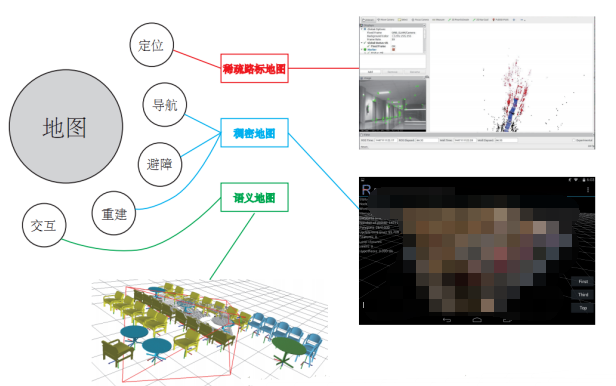

ObVi-SLAM希望同时利用上述两种方法的优点,首先利用低级视觉特征来做高质量的短时VO。然后为了保证全局的长期一致性,构建一个不确定感知的持久目标的长期地图,并在每次部署后进行更新。

具体来说,ObVi-SLAM实际是利用环境中静态物体的长期地图来做辅助定位,因为目标检测是对外观不敏感的,所以ObVi-SLAM也就可以对环境变化有鲁棒性。同时每个语义目标都会计算不确定性,随时间推移进行更新。

3. 和其他SOTA方法对比如何?

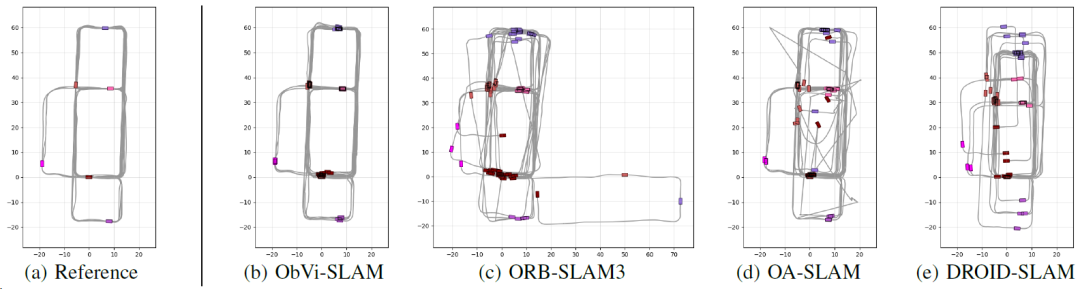

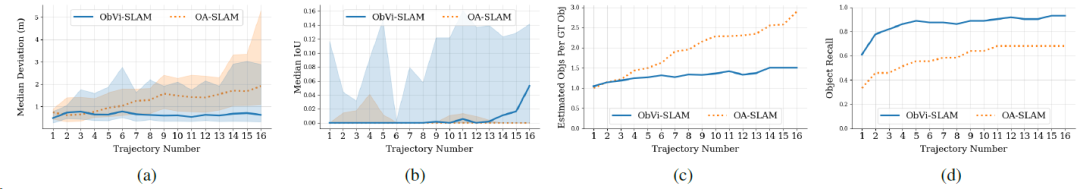

ObVi-SLAM在两个月内收集室外不同时间的16组数据,估计Lifelong轨迹的稳定性,可以发现其他方案都不同程度的出现了很大的轨迹漂移。

OA-SLAM也是一种物体级SLAM,刚开始性能也很好,但是随着时间增加,定位精度明显降低。

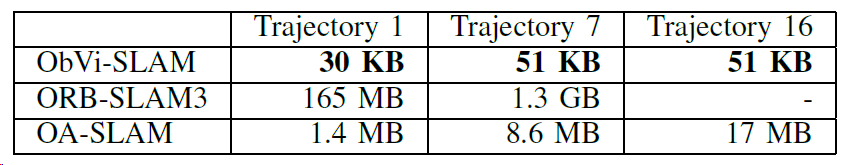

地图文件的大小对比,可以发现ObVi-SLAM比ORB3的地图小很多,有利于机器人的实际落地。

审核编辑:刘清

-

机器人

+关注

关注

212文章

28990浏览量

209900 -

SLAM

+关注

关注

23文章

430浏览量

32044 -

自动驾驶

+关注

关注

788文章

14022浏览量

167959

原文标题:如何处理视觉SLAM长期定位中的外观变化和轨迹漂移?

文章出处:【微信号:3D视觉工坊,微信公众号:3D视觉工坊】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

机器视觉系统应用于标签外观视觉检查!

基于视觉的slam自动驾驶

单目视觉SLAM仿真系统的设计与实现

视觉SLAM技术浅谈

视觉SLAM深度解读

科普|视觉SLAM是什么——三种视觉SLAM方案

机器人主流定位技术:激光SLAM与视觉SLAM谁更胜一筹

教你们视觉SLAM如何去提高定位精度

使用OptiTrack光学跟踪系统和Turtlebot机器人进行视觉SLAM定位实验

视觉SLAM开源方案汇总 视觉SLAM设备选型

怎么去处理视觉SLAM长期定位中的外观变化和轨迹漂移呢?

怎么去处理视觉SLAM长期定位中的外观变化和轨迹漂移呢?

评论