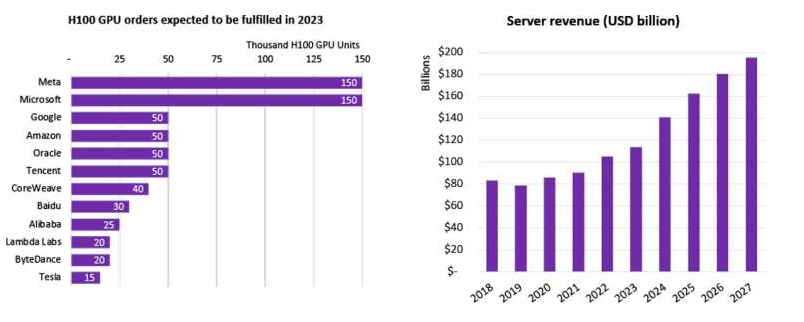

随着人工智能(ai)热潮的持续,微软(ms)、meta、谷歌(google)等全球科技大企业正在积极确保高性能ai gpu芯片。据市场调查机构omdia称,英伟达在2023年第三季度共售出50万个主力产品h100 gpu。

这款产品最大购买客户是Meta与微软,各自购买了15万块;谷歌、亚马逊、甲骨文、腾讯各自购买了5万块,榜单中还出现了百度、阿里巴巴、字节跳动这几家中国公司。集微网了解到,目前H100 80GB单卡售价将近4万美元,约合28万元人民币。

《omdia re报告》预测说,英伟达的h100和a100需求第四季度也将保持较高水平,并表示,h100服务器的待机时间达36至52周。

据数据显示,大部分服务器gpu直接提供给超大型云端服务提供商,但戴尔、联想、惠普等oem服务器设备制造商尚未确保足够的ai和hpc gpu。业界预测,服务器市场价值将从目前的约1000亿美元,到2027年将增长到约1956亿美元,达到2023年的2倍。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

微软

+关注

关注

4文章

6599浏览量

104093 -

人工智能

+关注

关注

1791文章

47314浏览量

238599 -

GPU芯片

+关注

关注

1文章

303浏览量

5820

发布评论请先 登录

相关推荐

英伟达H100芯片市场降温

随着英伟达新一代AI芯片GB200需求的不断攀升,其上一代明星产品H100芯片却遭遇了市场的冷落。据业内人士透露,搭载H100的服务器通常以8卡的形式进行出售或出租,而在去年,这类服务

马斯克自曝训练Grok 3用了10万块NVIDIA H100

在科技界的前沿阵地上,埃隆·马斯克再次以其前瞻性的视野和大胆的尝试引领着新的风潮。近日,马斯克在社交媒体X上的一则回应,不经意间透露了其即将推出的AI聊天机器人Grok 3背后的惊人秘密——这款被马斯克誉为“非常特别”的AI产品,竟然是通过10万块

英伟达去年数据中心GPU出货量占比约98%

半导体分析公司TechInsights的最新报告揭示了英伟达在数据中心GPU领域的惊人增长。据悉,在2023年,英伟达在数据中心

特斯拉加码AI布局:xAI将采购30万块英伟达B200芯片

特斯拉CEO埃隆·马斯克近日在社交平台上公布了一项重要消息,旗下的人工智能初创公司xAI计划采购30万块英伟达B200 AI芯片。这一大规模采购计划标志着特斯拉在人工智能领域布局的进一步加深。

首批1024块H100 GPU,正崴集团将建中国台湾最大AI计算中心

中国台湾当地正崴集团5月27日宣布,将与日本公司Ubitus共同打造人工智能(AI)计算中心,其中第一期将导入128个机柜,共计1024张英伟达H100旗舰计算卡,旨在构建台湾最大的AI计算中心。

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

冷却技术,提高计算密度,减少占地面积,并通过高带宽、低延迟的GPU通信,有效减少数据中心的碳足迹和能源消耗。相较于传统的NVIDIA H100风冷基础设施,GB200在相同功耗下实现25倍的性能提升

发表于 05-13 17:16

特斯拉和xAI筹集H100芯片,以推动L5级自动驾驶和“终极真相人工”的实现

近期,X平台用户“技术兄弟”报导称,Meta已成为全球最具实力的H100 GPU持有者,总计为35万块,但马斯克对此却并不认同(特斯拉与xAI的持有量均为1万颗),并坚持认为“如若计算

英伟达H200带宽狂飙

英伟达H200带宽的显著提升主要得益于其强大的硬件配置和先进的技术创新。H200配备了高达141GB的HBM3e显存,与前代产品

英伟达H200显卡价格

英伟达H200显卡的具体价格尚未公布。根据上一代H100显卡的价格范围,预计H200的单片价格将超过40000美元。由于新芯片通常定价较高,

英伟达缩短AI GPU交付周期,持续推进算力产业链发展

与此同时,随着人工智能的迅猛发展及其广泛应用,对像H100和A100这类专为数据中心设计的高性能GPU的需求也大幅增长。而包括Yotta在内的多家公司因此纷纷加大向英伟

英伟达H100 GPU Q3售出50万块,科技巨头争抢

英伟达H100 GPU Q3售出50万块,科技巨头争抢

评论