说到机器学习,大相信大家自然而然想到的就是现在大热的卷积神经网络,或者换句话来说,深度学习网络。对于这些网络或者模型来说,能够大大降低进入门槛,具体而言,卷积神经网络具有以下优势:

自动特征提取

相较于传统的机器学习方法,如支持向量机(SVM),CNN能够自动地从原始数据中学习到有用的特征。这使得初学者无需手动设计复杂的特征工程过程,从而降低了入门门槛。

网络结构直观

CNN的基本结构包括卷积层、池化层和全连接层,这些层次之间的连接关系相对简单明了。初学者可以通过阅读相关教程和论文,快速理解CNN的工作原理。

丰富的资源

目前,关于CNN的学习资料非常丰富,包括在线教程、博客文章、视频课程等。这些资源通常以通俗易懂的语言介绍CNN的基本概念和实际应用,有助于初学者快速掌握相关知识。

成熟的框架

许多成熟的深度学习框架(如TensorFlow、PyTorch等)都提供了对CNN的支持,并提供了丰富的预训练模型和示例代码。这大大降低了初学者实现CNN的难度,同时也为他们提供了更多的实践机会。

广泛的应用领域

CNN在计算机视觉、自然语言处理、语音识别等多个领域都有广泛的应用。初学者可以根据自己的兴趣选择合适的领域进行学习和实践,从而提高学习的积极性和效果。

看起来是不是非常的诱人?但是深度神经网络往往需要更多的计算资源,尤其是针对于资源受限的MCU平台,可以说有一种,可望不可及的感觉。当然,不是说完全没有可能啊,经过一些模型架构以及运行代码的优化,还是可以运行在我们的MCU平台的。不过,今天的主角不是卷积神经网络,让我们回归传统,给大家介绍一个新东西,支持向量机(Support Vector Machine,SVM),先来介绍何为SVM:

SVM是一种常见的机器学习算法,用于分类和回归分析,它通过在不同类别之间寻找最优的超平面来实现分类,其中超平面是将数据集划分为两个或多个类别的决策边界。

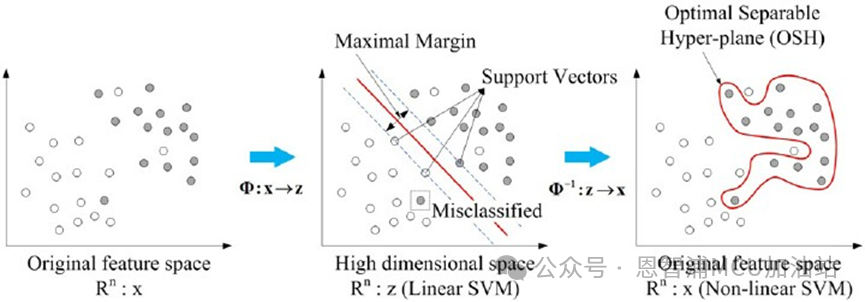

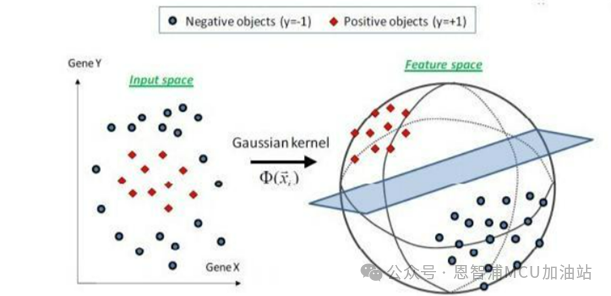

如上图所示,核心思想是将数据映射到高维空间中,使得数据在该空间中可以更容易地分离为不同的类别。在高维空间中,SVM算法通过寻找最大间隔超平面来实现分类,该超平面可以使不同类别之间的距离最大化。此外,SVM算法还可以使用核函数来处理非线性分类问题。

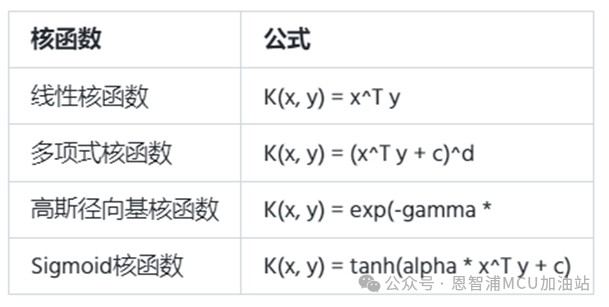

当数据集无法通过简单的线性分割时,SVM算法仍然可以有效地进行分类。这是因为SVM算法使用了核函数,一些常用的核函数为:  它可以将数据映射到更高维度的特征空间中,使得原本线性不可分的数据在新的空间中变得线性可分。常用的核函数包括线性核函数、多项式核函数和径向基函数(RBF)核函数等。这些核函数使得SVM算法可以处理复杂的非线性分类问题:

它可以将数据映射到更高维度的特征空间中,使得原本线性不可分的数据在新的空间中变得线性可分。常用的核函数包括线性核函数、多项式核函数和径向基函数(RBF)核函数等。这些核函数使得SVM算法可以处理复杂的非线性分类问题:

另一个SVM算法的重要概念是支持向量。支持向量是离超平面最近的训练样本点,它们对于确定最优超平面起着关键作用。通过使用支持向量,SVM算法可以忽略大部分训练数据,只关注那些对于分类决策起重要作用的样本点,从而提高了算法的效率和泛化能力。

SVM算法具有许多优点,例如可以处理高维数据、具有较高的分类准确率和较好的泛化能力等。它已经被广泛应用于许多领域,例如图像识别、自然语言处理、生物信息学等。

然而,在处理大规模数据集时,SVM算法可能会面临计算复杂度较高的挑战。因此,研究人员一直在探索如何加速SVM算法以适应大规模数据集的需求。

总体而言,SVM算法是一种强大且灵活的机器学习算法,适用于分类和回归问题。它在实际应用中具有广泛的应用和良好的性能,并且随着研究的深入和技术的发展,它将继续在各个领域发挥重要作用。

那么本期小编就先带着大家先见一下我们的新朋友,下一篇就来看看如何使用SVM真实训练一个模型,并完成一个分类任务。

审核编辑:汤梓红

-

SVM

+关注

关注

0文章

154浏览量

32675 -

机器学习

+关注

关注

66文章

8460浏览量

133387 -

深度学习

+关注

关注

73文章

5527浏览量

121842 -

卷积神经网络

+关注

关注

4文章

368浏览量

11980

原文标题:机器学习回归传统,神奇的SVM还挺简单

文章出处:【微信号:NXP_SMART_HARDWARE,微信公众号:恩智浦MCU加油站】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

卷积神经网络的优势和应用领域

卷积神经网络的优势和应用领域

评论