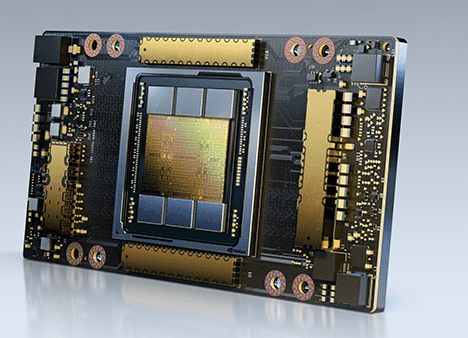

据海外报道,NVIDIA目前热门AI芯片H100的交货周期已明显缩短,先前需半年,现仅需三四个月即可。此外,由于各大云服务供应商如AWS、谷歌云和Microsoft Azure提供便捷的AI计算服务,使得之前批量采购H100 GPU的企业决定出售。

值得注意的是,H100 GPU的供求关系已经缓解,且维护成本高起,部分客户正在置换这类硬件以转向云服务,这种转变在过去的市场紧缩中很少见到。同时,市场上虽然有其他选择如AMD的MI300 GPU,性能稳定且价格低廉。

根据TrendForce研究机构预测,2024年全球高级AI服务器需求将激增至1.5亿台,NVIDIA、AMD等领先ASIC芯片厂商将主导这一市场,分别占据至少六七成以上份额。其中,NVIDIA的H100芯片仍处于前列,预计于2024年在整体需求中的占比逾70%。

然而,NVIDIA在AI领域面临潜在威胁。首当其冲的便是美国对华科技出口限制,这可能减损NVIDIA在中国市场的销售业绩;其次,大型科技公司如亚马逊AWS、Google、Microsoft和Meta等已经开始研发自有的ASIC芯片;再者,AMD以其高性价比产品给NVIDIA造成竞争压力,尤其在旗舰客户市场的争夺上,预计到2024年,Microsoft将成为AMD Mi300 GPU解决方案的最大客户之一。

-

amd

+关注

关注

25文章

5507浏览量

134832 -

gpu

+关注

关注

28文章

4805浏览量

129585 -

AI芯片

+关注

关注

17文章

1918浏览量

35300

发布评论请先 登录

相关推荐

H100 GPU供应改善,AI市场需求依旧强劲

H100 GPU供应改善,AI市场需求依旧强劲

评论