据报道,硅谷晶圆芯片创企 Cerebras 近日公布了其 WSE-3 芯片型号,声称在保持相同能耗的基础上,性能较前作 WSE-2 提升逾一倍。主要技术规格如下:

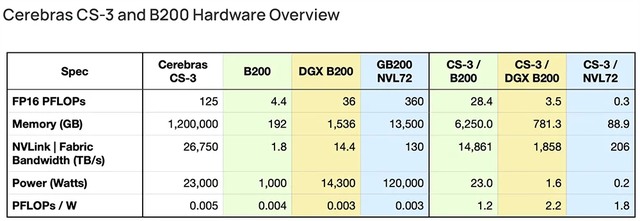

首先,WSE-3采用台积电最新的5nm工艺制作(目前领先业界)。其次,该芯片拥有超过4万亿个晶体管以及90万个AI核心,配合44GB片上SRAM高速缓存及三种可选片外存储方案(分别是1.5TB、12TB与1.2PB)。此外,WSE-3还具备125 PFLOPS的AI运算能力。

Cerebras指出,新款CS-3系统基于WSE-3芯片设计,最高支持1.2PB的内存容量,适于训练比GPT-4及Gemini更大的未来模型。借助独特的逻辑内存空间技术,能将24000T模型参数集中储存,大幅减轻了开发者负担。

尤为值得关注的是,CS-3强大的卓越的训练性能使其成为满足大规模AI需求的最佳选择,甚至可以在单日内完成70B模型的精炼。借助最大规模的2048套CS-3系统集群,仅仅一天便能够完成长毛羊 70B 神经网络(Netrep Tempo)模型的深度学习。同时,CS-3系统在用户友好性设计方面也表现出色,与GPU相比,大模型训练中的编码量降低高达97%,更多人可以轻松掌握超大规模AI处理技能。

值得一提的是,阿联酋G42财团已经表态将创建含64套 CS-3系统在内的Condor Galaxy 3超级计算机,预计综合AI运算能力可达8 exaFLOPs。

-

芯片

+关注

关注

455文章

50714浏览量

423142 -

台积电

+关注

关注

44文章

5632浏览量

166411 -

sram

+关注

关注

6文章

767浏览量

114675 -

晶体管

+关注

关注

77文章

9682浏览量

138080

发布评论请先 登录

相关推荐

Zettabyte与纬创携手打造台湾首个超大规模AI数据中心

谷歌正在考虑在越南建设超大规模数据中心

燧原科技与清程极智携手共创AI未来:共筑超大规模智算集群新篇章

AI初出企业Cerebras已申请IPO!称发布的AI芯片比GPU更适合大模型训练

世界第一AI芯片发布!世界纪录直接翻倍 晶体管达4万亿个

Cerebras推出性能翻倍的WSE-3 AI芯片

Cerebras Systems推出迄今最快AI芯片,搭载4万亿晶体管

最强AI芯片发布,Cerebras推出性能翻倍的WSE-3 AI芯片

Cerebras发布WSE-3 AI芯片,性能翻倍达4万亿晶体,能耗不变

Cerebras推出WSE-3 AI芯片,比NVIDIA H100大56倍

Cerebras推WSE-3芯片,性能翻倍,助力超大规模AI模型训练

Cerebras推WSE-3芯片,性能翻倍,助力超大规模AI模型训练

评论